Clear Sky Science · it

Migliorare la valutazione educativa tramite la classificazione automatica delle domande usando un modello ensemble basato su RoBERTa

Test più intelligenti per le classi moderne

Ogni anno gli insegnanti scrivono migliaia di domande d’esame per valutare quanto gli studenti stiano apprendendo — non solo quali fatti ricordano, ma quanto profondamente sappiano ragionare. Stabilire quali domande misurano la semplice memorizzazione e quali richiedono un vero problem‑solving è importante, ma farlo a mano è lento e spesso incoerente. Questo studio presenta un sistema di intelligenza artificiale in grado di classificare automaticamente le domande d’esame in base al grado di impegno richiesto alle capacità di pensiero degli studenti, promettendo verifiche più eque e più tempo per l’insegnamento.

Perché i livelli di pensiero contano

Per decenni gli educatori si sono affidati a un quadro noto come Tassonomia di Bloom per strutturare lezioni e verifiche. Esso descrive sei livelli di pensiero, dal ricordare fatti di base fino a comprendere, applicare, analizzare e valutare, fino a creare qualcosa di nuovo. Un buon esame dovrebbe coprire tutto questo spettro invece di concentrarsi sui livelli più facili. Ma classificare ogni domanda in uno di questi livelli è una valutazione soggettiva, e insegnanti diversi possono essere in disaccordo. Automatizzare questo passaggio può rendere le valutazioni più oggettive e può rivelare rapidamente se una prova mette davvero alla prova la mente degli studenti invece di limitarsi a verificare la memoria.

Insegnare a una macchina a leggere le domande d’esame

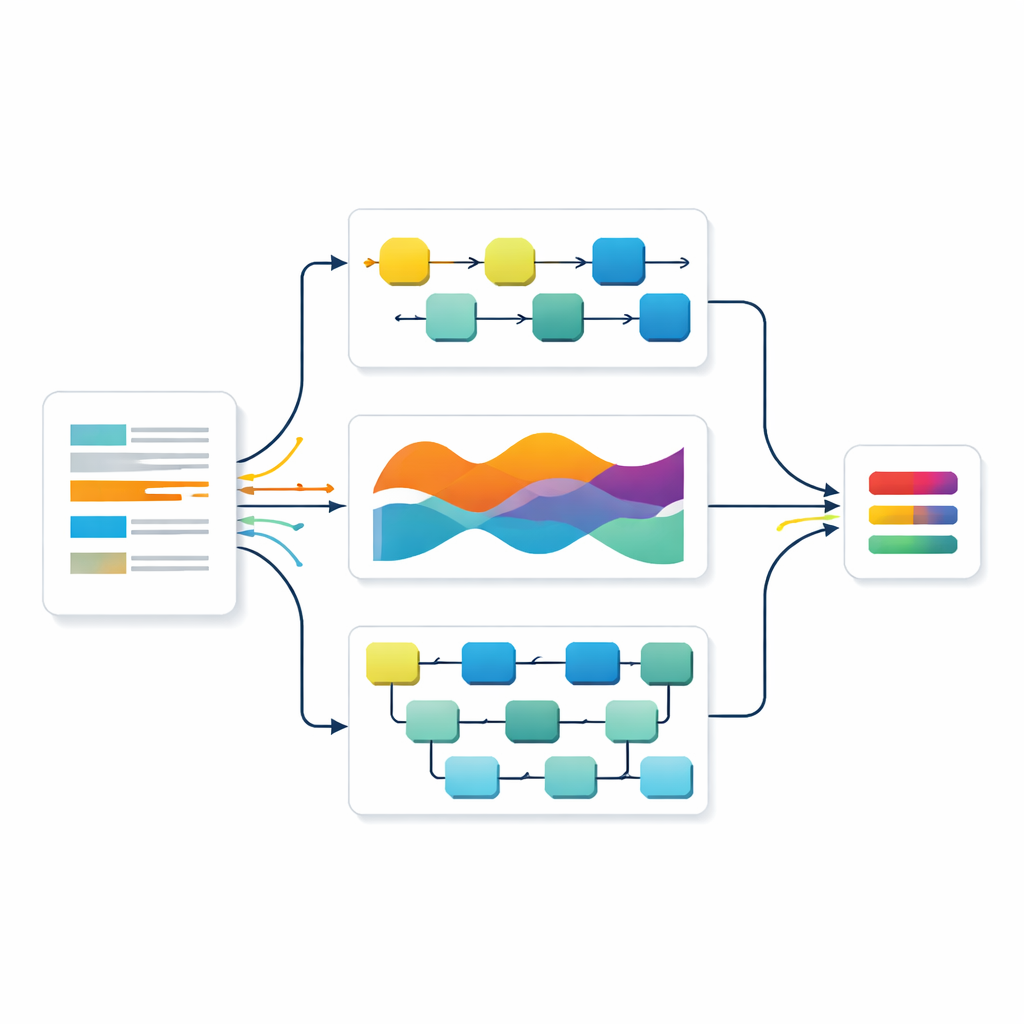

Gli autori hanno costruito il loro sistema su un potente modello linguistico chiamato RoBERTa, addestrato su enormi quantità di testo per catturare sfumature di significato. Quando il modello legge una domanda d’esame, converte ogni parola in una ricca rappresentazione numerica che riflette il modo in cui si relaziona alle parole circostanti. Queste rappresentazioni vengono poi elaborate da tre reti neurali specializzate. Una si concentra su come l’informazione si sviluppa in ordine lungo la frase, un’altra traccia pattern a lungo termine e una terza cerca frasi locali chiave. Insieme, imparano a rilevare i tipi di formulazione che segnalano se una domanda chiede agli studenti di ricordare, spiegare, applicare o innovare.

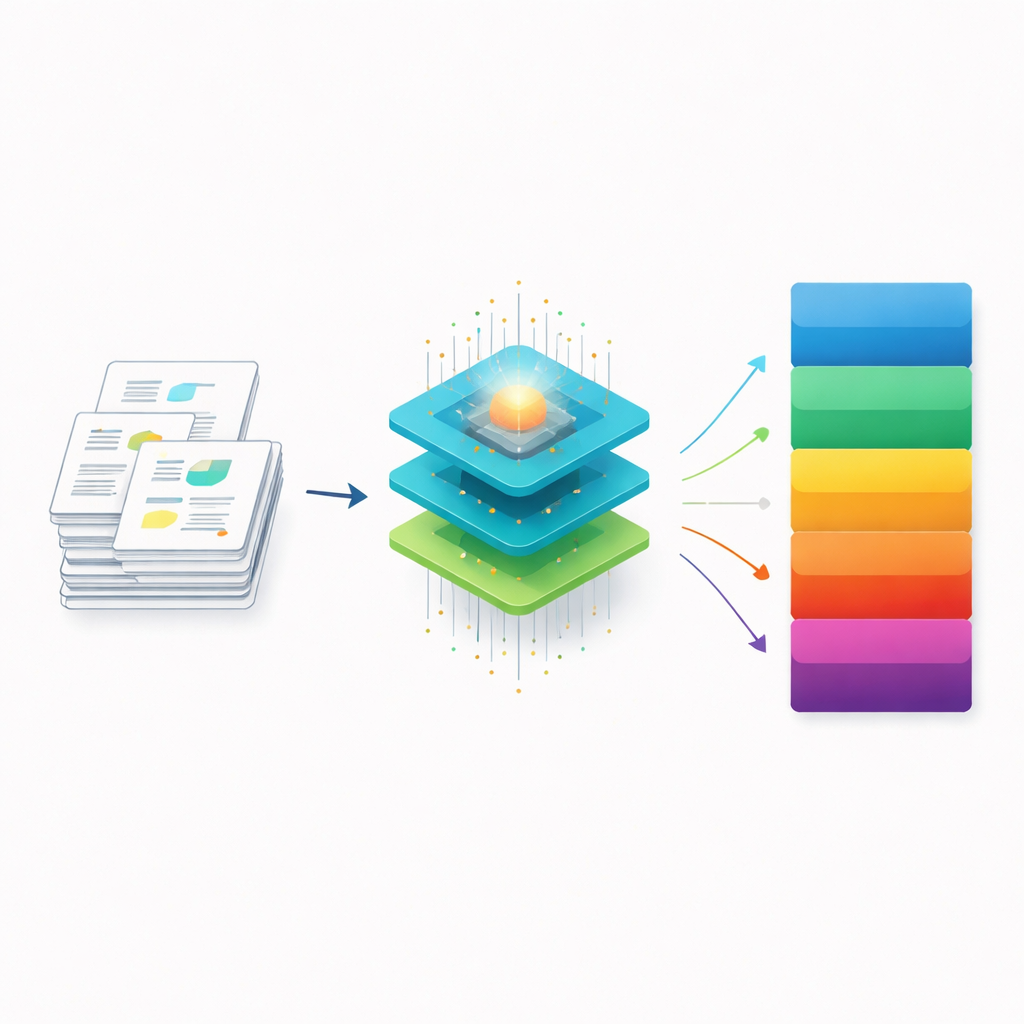

Combinare diversi punti di vista dell’IA

Piuttosto che fidarsi di una singola rete, i ricercatori hanno combinato le tre usando una strategia tratta dai sistemi di voto. Ogni modello produce la propria ipotesi sul livello della domanda, insieme a una misura di confidenza. Queste ipotesi vengono poi mediate, ma non in modo uguale: i modelli che risultano più accurati su un set di validazione separato ricevono maggior peso. Questo approccio a "ensemble pesato" permette ai punti di forza di un modello di compensare le debolezze di un altro. Il team ha inoltre preparato i dati in modo rigoroso, ampliando un dataset pubblico di domande d’esame con parafrasi accuratamente verificate in modo che il sistema potesse apprendere da più esempi senza introdurre rumore.

Quanto è efficace?

Su un set di test tenuto da parte che i modelli non hanno mai visto durante l’addestramento, tutte e tre le reti singole hanno classificato le domande con oltre il 90 percento di accuratezza, superando già molte approcci precedenti nella letteratura. L’ensemble combinato ha fatto ancora meglio, etichettando correttamente circa il 92 percento delle domande e mantenendo prestazioni bilanciate su tutti e sei i livelli di pensiero, compresi quelli più avanzati. Un test statistico ha confermato che questo miglioramento rispetto al migliore modello singolo è improbabile che sia dovuto al caso. Analisi dettagliate degli errori hanno mostrato che l’ensemble ha ridotto la confusione tra livelli adiacenti di pensiero, che spesso sono i più difficili anche per gli esseri umani da distinguere.

Cosa significa per insegnanti e studenti

Classificando automaticamente le domande d’esame in livelli di pensiero, questo sistema potrebbe aiutare gli insegnanti a verificare rapidamente se le loro prove misurano davvero una gamma di competenze, dalla memorizzazione di base al problem‑solving creativo. Può segnalare lacune — per esempio, se un esame contiene troppe domande facili e poche che stimolano un ragionamento più profondo — e può aiutare le scuole a progettare valutazioni più coerenti nel tempo. Sebbene lo strumento non sostituisca il giudizio professionale, offre un punto di partenza rapido e basato su evidenze che riduce il carico di lavoro e i bias umani. Guardando avanti, gli autori intendono integrare tali sistemi nelle piattaforme di apprendimento online ed estenderli a nuovi tipi di competenze che conteranno in un’epoca in cui gli studenti lavorano sempre più spesso insieme all’IA.

Citazione: Hamid, M., Malik, S., Saleem, M. et al. Enhancing educational assessment through automated question classification using a RoBERTa-based ensemble model. Sci Rep 16, 13754 (2026). https://doi.org/10.1038/s41598-026-45486-1

Parole chiave: valutazione educativa, Tassonomia di Bloom, classificazione automatica delle domande, deep learning nell’istruzione, modelli linguistici