Clear Sky Science · he

שיפור הערכה חינוכית באמצעות סיווג אוטומטי של שאלות בעזרת מודל אנסמבל מבוסס RoBERTa

מבחנים חכמים לכיתות של ימינו

בכל שנה מנסחים מורים אלפי שאלות מבחן כדי למדוד עד כמה התלמידים לומדים — לא רק אילו עובדות הם זוכרים, אלא גם עד כמה הם מסוגלים לחשוב לעומק. ההבחנה אילו שאלות בודקות שליפת זיכרון פשוטה ואילו דורשות פתרון בעיות מהותי חשובה, אך ביצוע המשימה באופן ידני איטי ולעתים לא עקבי. מאמר זה מציג מערכת בינה מלאכותית שיכולה למיין אוטומטית שאלות מבחן לפי דרישות כישורי החשיבה שהן מציבות בפני התלמידים, ומציעה מבחנים הוגנים יותר וזמן רב יותר להוראה.

מדוע רמות החשיבה חשובות

בעשורים האחרונים הסתמכו מחנכים על מסגרת מוכרת בשם טקסונומיית בלום לעיצוב שיעורים ומבחנים. המסגרת מתארת שישה מעמדי חשיבה, מהשליפה של עובדות בסיסיות, דרך הבנה, יישום, ניתוח והערכה, ועד יצירה של משהו חדש. מבחן טוב צריך לכסות את טווח זה במקום להתרכז ברמות הקלות בלבד. אך סיווג כל שאלה לאחת מהרמות האלה הוא שיקול מקצועי, ומורים שונים עלולים לחלוק על ההערכה. אוטומציה של השלב הזה יכולה להפוך את ההערכות לאובייקטיביות יותר ולחשוף במהירות האם מבחן אכן מאתגר את חשיבת התלמידים במקום רק לבדוק זיכרון.

ללמד מכונה לקרוא שאלות מבחן

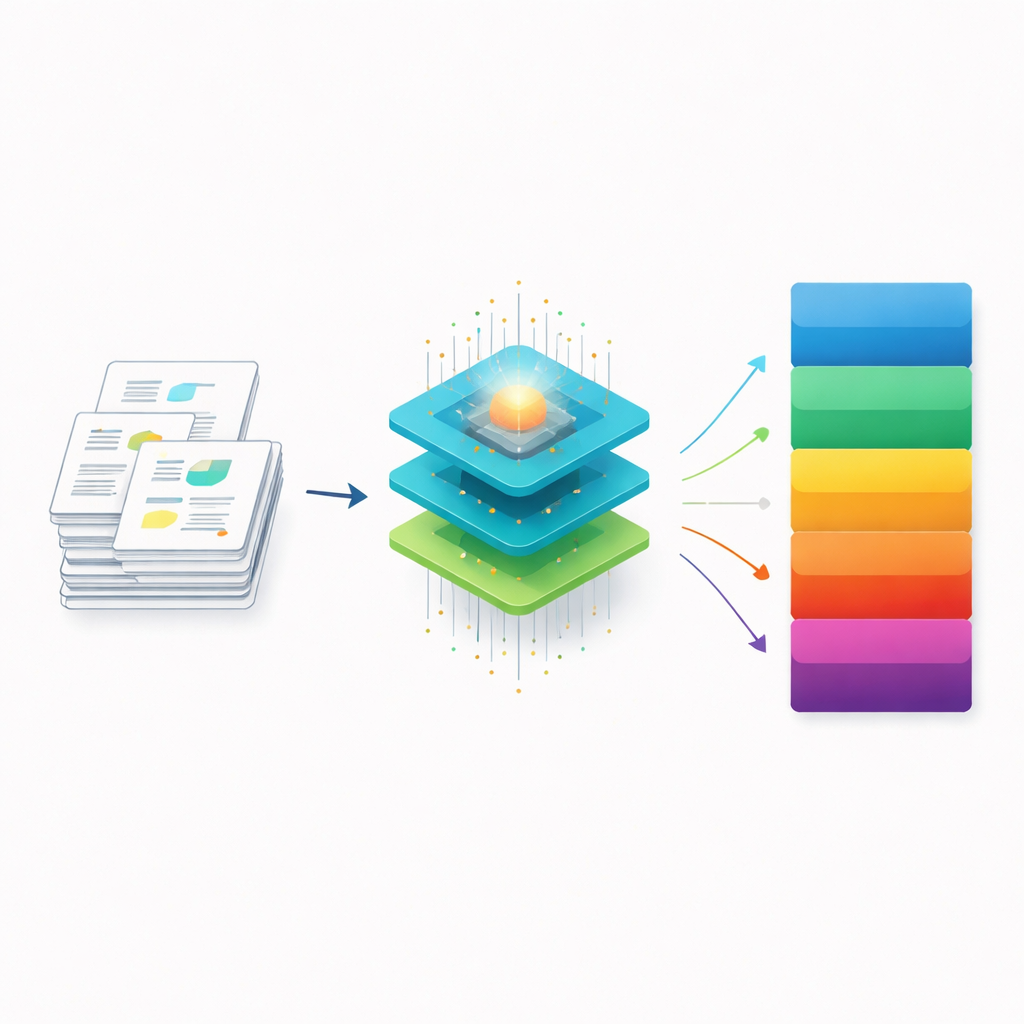

המחברים בנו את המערכת שלהם על מודל לשוני חזק בשם RoBERTa, שהתאמן על כמויות גדולות של טקסט כדי ללכוד גוונים עדינים של משמעות. כאשר המודל קורא שאלה, הוא ממיר כל מילה לייצוג מספרי עשיר שמשקף כיצד היא מקושרת למילים שמסביבה. ייצוגים אלה מוזרמים לאחר מכן לשלושה רשתות עצביות מתמחות. אחת מתמקדת באופן שבו המידע מתפתח בסדר המילים במשפט, אחרת עוקבת אחרי תבניות לטווח ארוך, ושלישית מחפשת ביטויים מקומיים מרכזיים. יחד הן לומדות לזהות ניסוחים שמרמזים האם שאלה מבקשת מהתלמידים לשלוף מידע, להסביר, ליישם או ליזום חדשנות.

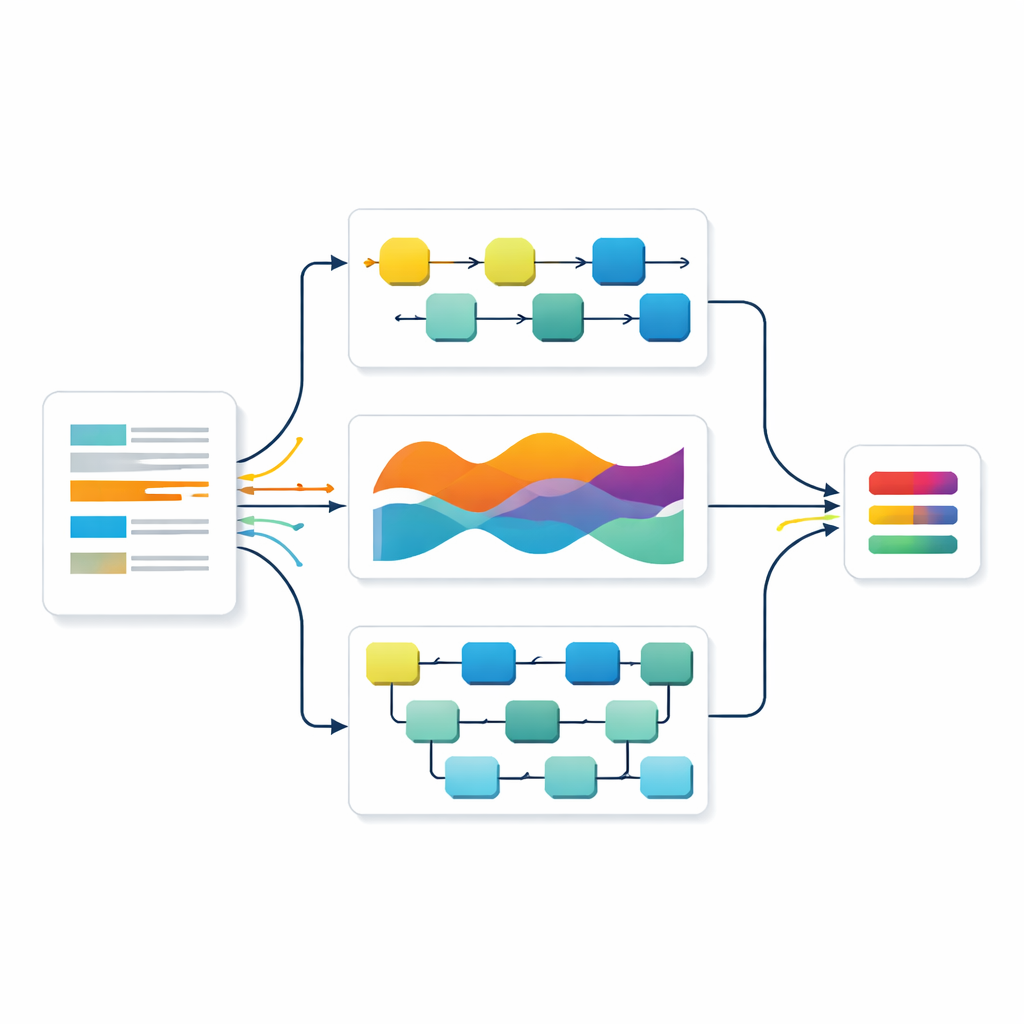

שילוב נקודות מבט שונות של בינה מלאכותית

במקום להסתמך על רשת יחידה, החוקרים שילבו את שלושת הרשתות באמצעות אסטרטגיה שמזכירה מערכות הצבעה. כל מודל מייצר את הניחוש שלו לגבי רמת השאלה, יחד עם מדד ביטחון. הניחושים אלה מאומצים בממוצע, אך לא באופן שווה — למודלים שהוכיחו דיוק גבוה יותר על סט אימות נפרד ניתנת משקל גדול יותר. גישת ה"אנסמבל המשוקלל" הזו מאפשרת לחזקות של מודל אחד לפצות על חולשות של אחר. הצוות גם הכין בקפידה את הנתונים, והרחיב מאגר ציבורי של שאלות מבחן עם פרפראזות שנבדקו בקפידה, כדי לאפשר למערכת ללמוד מדוגמאות רבות יותר מבלי להכניס רעש.

כמה טוב זה עובד?

על סט מבחן מופרד שהמודלים לא ראו במהלך האימון, שלוש הרשתות הבודדות סיווגו שאלות עם דיוק של מעל 90 אחוזים, ובכך כבר עלו על רבות מהשיטות הקודמות בספרות המחקר. האנסמבל המשולב השיג תוצאה טובה אף יותר, וסימן נכון כ־92 אחוזים מהשאלות תוך שמירה על ביצועים מאוזנים בכל שש רמות החשיבה, כולל הרמות המתקדמות יותר. בדיקה סטטיסטית אישרה שהשיפור הזה על פני המודל הטוב ביותר לבד לא צפוי להיות תוצאה של מקרה. ניתוחים מפורטים של שגיאות הראו שהאנסמבל הקטין את הבלבול בין רמות שכנות של חשיבה — שבדרך כלל גם קשה לאנשים להבחין ביניהן.

מה המשמעות עבור מורים ותלמידים

באמצעות מיון אוטומטי של שאלות מבחן לפי רמות חשיבה, המערכת עשויה לסייע למורים לבדוק במהירות האם מבחניהם מודדים טווח כישורים אמיתי — מהשליפה הבסיסית ועד לפתרון בעיות יצירתי. היא יכולה להצביע על חללים — למשל, אם מבחן מכיל יותר מדי שאלות קלות ומעט מדי שאלות שמעודדות נימוק עמוק — ולעזור לבתי ספר לעצב הערכות עקביות יותר לאורך זמן. כלי זה אינו מחליף שיקול מקצועי, אך מספק נקודת פתיחה מהירה ומבוססת ראיות שמפחיתה עומס וקביעות אנושית. מבט לעתיד: המחברים מתכננים לשלב מערכות כאלה בפלטפורמות למידה מקוונות ולהרחיב אותן לסוגי מיומנויות חדשים שיהיו משמעותיים בעידן שבו תלמידים עובדים יותר ויותר לצד בינה מלאכותית.

ציטוט: Hamid, M., Malik, S., Saleem, M. et al. Enhancing educational assessment through automated question classification using a RoBERTa-based ensemble model. Sci Rep 16, 13754 (2026). https://doi.org/10.1038/s41598-026-45486-1

מילות מפתח: הערכה חינוכית, טקסונומיית בלום, סיווג אוטומטי של שאלות, למידה עמוקה בחינוך, מודלים לשוניים