Clear Sky Science · de

Verbesserung von Bildungsbewertungen durch automatisierte Frageklassifikation mithilfe eines RoBERTa-basierten Ensemble-Modells

Klügere Tests für moderne Klassenzimmer

Jedes Jahr formulieren Lehrkräfte Tausende von Prüfungsfragen, um zu beurteilen, wie gut Schülerinnen und Schüler lernen – nicht nur welche Fakten sie sich merken, sondern wie tiefgehend sie denken können. Zu entscheiden, welche Fragen bloß Erinnerung abfragen und welche echtes Problemlösen erfordern, ist wichtig; dies manuell zu tun ist jedoch langsam und oft inkonsistent. Dieser Beitrag stellt ein System der künstlichen Intelligenz vor, das Prüfungsfragen automatisch nach dem Anspruch an die Denkfähigkeiten der Lernenden sortieren kann und so gerechtere Tests und mehr Zeit fürs Unterrichten verspricht.

Warum die Ebenen des Denkens wichtig sind

Seit Jahrzehnten stützen sich Pädagogen auf ein Rahmenwerk, das als Blooms Taxonomie bekannt ist, um Unterricht und Prüfungen zu gestalten. Es beschreibt sechs Denkebenen, vom Erinnern grundlegender Fakten über Verstehen, Anwenden, Analysieren und Bewerten bis hin zum Schaffen von etwas Neuem. Eine gute Prüfung sollte dieses Spektrum abdecken und sich nicht auf die einfachsten Ebenen konzentrieren. Die Zuordnung jeder Frage zu einer dieser Ebenen ist jedoch eine Wertentscheidung, bei der Lehrkräfte unterschiedlicher Meinung sein können. Die Automatisierung dieses Schritts kann Bewertungsprozesse objektiver machen und schnell aufzeigen, ob ein Test die Denkfähigkeit der Lernenden wirklich herausfordert statt nur das Gedächtnis abzufragen.

Der Maschine beibringen, Prüfungsfragen zu lesen

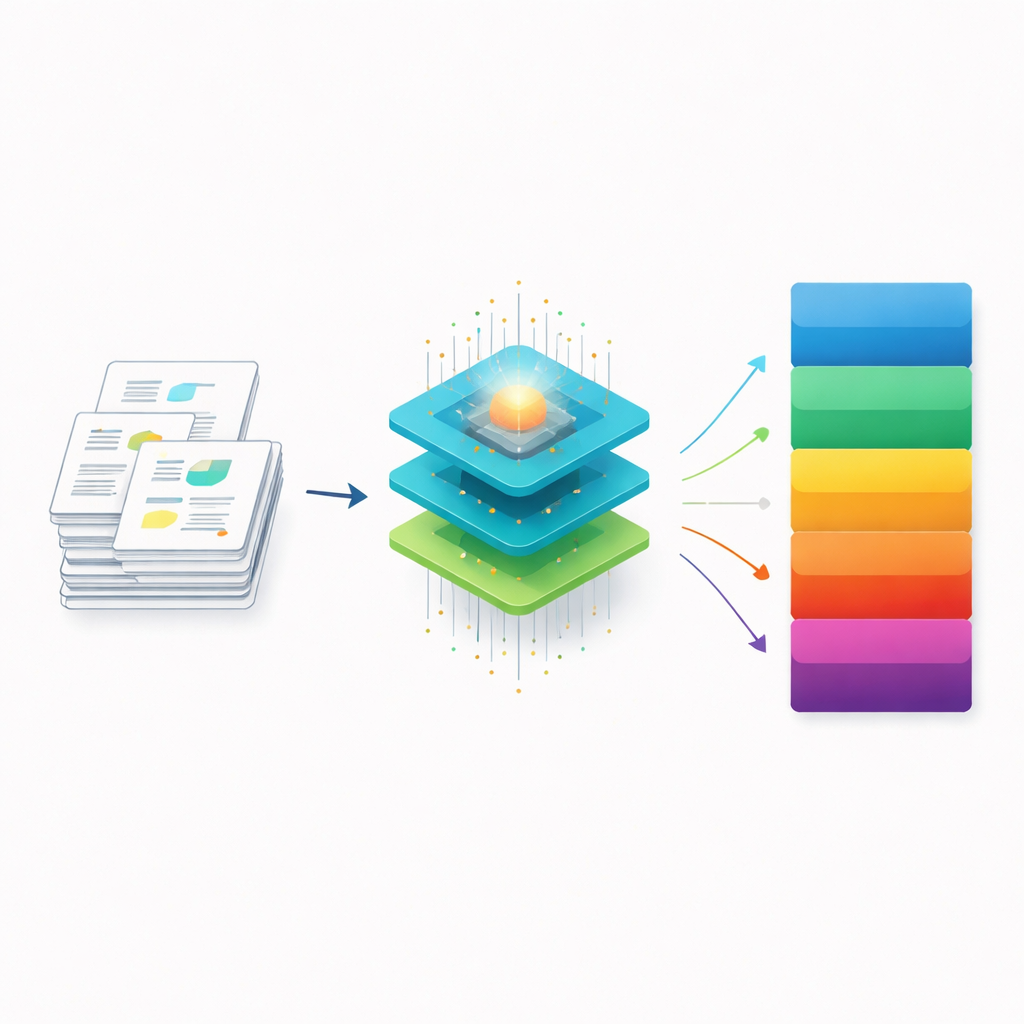

Die Autorinnen und Autoren bauten ihr System auf einem leistungsfähigen Sprachmodell namens RoBERTa auf, das auf großen Textmengen trainiert wurde, um feine Bedeutungsnuancen zu erfassen. Wenn das Modell eine Prüfungsfrage liest, wandelt es jedes Wort in eine reichhaltige numerische Darstellung um, die widerspiegelt, wie es sich zu den umliegenden Wörtern verhält. Diese Darstellungen fließen dann in drei spezialisierte neuronale Netze: Eines konzentriert sich auf die Reihenfolge, in der Informationen im Satz auftauchen, ein anderes verfolgt langfristige Muster, und ein drittes sucht nach wichtigen lokalen Phrasen. Gemeinsam lernen sie, Formulierungen zu erkennen, die darauf hindeuten, ob eine Frage von den Lernenden Erinnerung, Erklärung, Anwendung oder Innovation verlangt.

Verschiedene KI-Perspektiven kombinieren

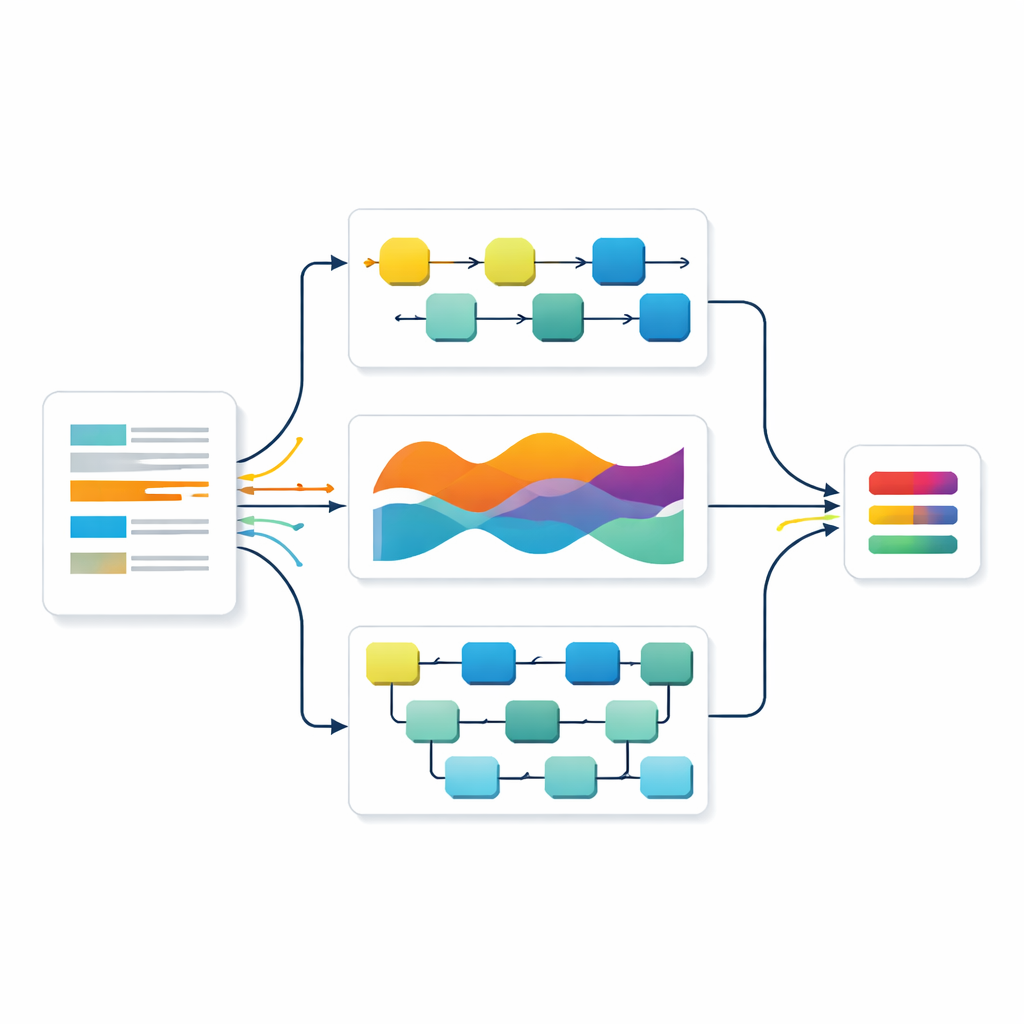

Statt einem einzelnen Netzwerk zu vertrauen, kombinierten die Forschenden alle drei mithilfe einer Strategie, die aus Abstimmungssystemen entlehnt ist. Jedes Modell gibt eine eigene Vermutung über die Denkstufe einer Frage ab, zusammen mit einem Vertrauensmaß. Diese Vermutungen werden dann gemittelt, jedoch nicht gleichgewichtet – Modelle, die auf einem separaten Validierungsdatensatz genauer waren, erhalten mehr Gewicht. Dieser "gewichtete Ensemble"-Ansatz erlaubt es, dass die Stärken eines Modells die Schwächen eines anderen ausgleichen. Das Team bereitete zudem seine Daten sorgfältig vor und erweiterte einen öffentlichen Datensatz mit Prüfungsfragen um geprüftes Paraphrasenmaterial, damit das System aus mehr Beispielen lernen kann, ohne Rauschen einzuführen.

Wie gut funktioniert es?

Auf einem zurückgehaltenen Testdatensatz, den die Modelle während des Trainings nie gesehen hatten, klassifizierten alle drei Einzelnetze Fragen mit über 90 Prozent Genauigkeit und übertrafen damit viele frühere Ansätze in der Fachliteratur. Das kombinierte Ensemble war noch besser und etikettierte etwa 92 Prozent der Fragen korrekt, wobei es eine ausgeglichene Leistung über alle sechs Denkebenen zeigte, einschließlich der anspruchsvolleren. Ein statistischer Test bestätigte, dass diese Verbesserung gegenüber dem besten Einzelmodell höchstwahrscheinlich nicht zufällig war. Detaillierte Fehleranalysen zeigten, dass das Ensemble Verwechslungen zwischen benachbarten Denkebenen reduzierte – jene Unterschiede, die auch Menschen oft schwerfallen zu trennen.

Was das für Lehrkräfte und Lernende bedeutet

Indem das System Prüfungsfragen automatisch nach Denkebenen sortiert, könnte es Lehrkräften helfen, schnell zu überprüfen, ob ihre Tests tatsächlich ein Spektrum an Fähigkeiten messen – vom einfachen Erinnern bis hin zu kreativem Problemlösen. Es kann Lücken aufzeigen, etwa wenn eine Prüfung zu viele leichte Fragen und zu wenige solche enthält, die tieferes Denken fördern, und Schulen dabei unterstützen, im Laufe der Zeit konsistentere Bewertungen zu gestalten. Das Werkzeug ersetzt zwar nicht fachliche Urteile, bietet aber einen schnellen, evidenzbasierten Ausgangspunkt, der Arbeitsaufwand und menschliche Verzerrungen vermindert. Für die Zukunft planen die Autorinnen und Autoren, solche Systeme in Online-Lernplattformen zu integrieren und auf neue Fähigkeiten auszudehnen, die in einer Zeit wichtig sind, in der Lernende zunehmend Seite an Seite mit KI arbeiten.

Zitation: Hamid, M., Malik, S., Saleem, M. et al. Enhancing educational assessment through automated question classification using a RoBERTa-based ensemble model. Sci Rep 16, 13754 (2026). https://doi.org/10.1038/s41598-026-45486-1

Schlüsselwörter: Bildungsbewertung, Blooms Taxonomie, automatisierte Frageklassifikation, Deep Learning in der Bildung, Sprachmodelle