Clear Sky Science · ru

Улучшение оценки в образовании с помощью автоматической классификации вопросов на основе ансамблевой модели RoBERTa

Более умные тесты для современных классов

Каждый год преподаватели составляют тысячи экзаменационных вопросов, чтобы оценить, насколько хорошо учащиеся усваивают материал — не только какие факты они помнят, но и насколько глубоко умеют мыслить. Определение того, какие вопросы проверяют простое восстановление знаний, а какие требуют реального решения задач, важно, однако делать это вручную медленно и часто непоследовательно. В этой статье представлена система искусственного интеллекта, которая автоматически сортирует экзаменационные вопросы по уровню когнитивной нагрузки, обещая более справедливые тесты и больше времени на преподавание.

Почему уровни мышления имеют значение

Десятилетиями педагоги опираются на рамочную модель, известную как таксономия Блума, для формирования уроков и экзаменов. Она описывает шесть уровней мышления — от запоминания базовых фактов через понимание, применение, анализ и оценивание до создания чего‑то нового. Хороший экзамен должен охватывать весь этот спектр, а не сосредотачиваться только на самых простых уровнях. Но отнесение каждого вопроса к одному из этих уровней — это субъективное суждение, и разные преподаватели могут не соглашаться. Автоматизация этого шага может сделать оценивание более объективным и быстро показать, действительно ли тест проверяет мышление учащихся, а не лишь память.

Обучение машины «читать» экзаменационные вопросы

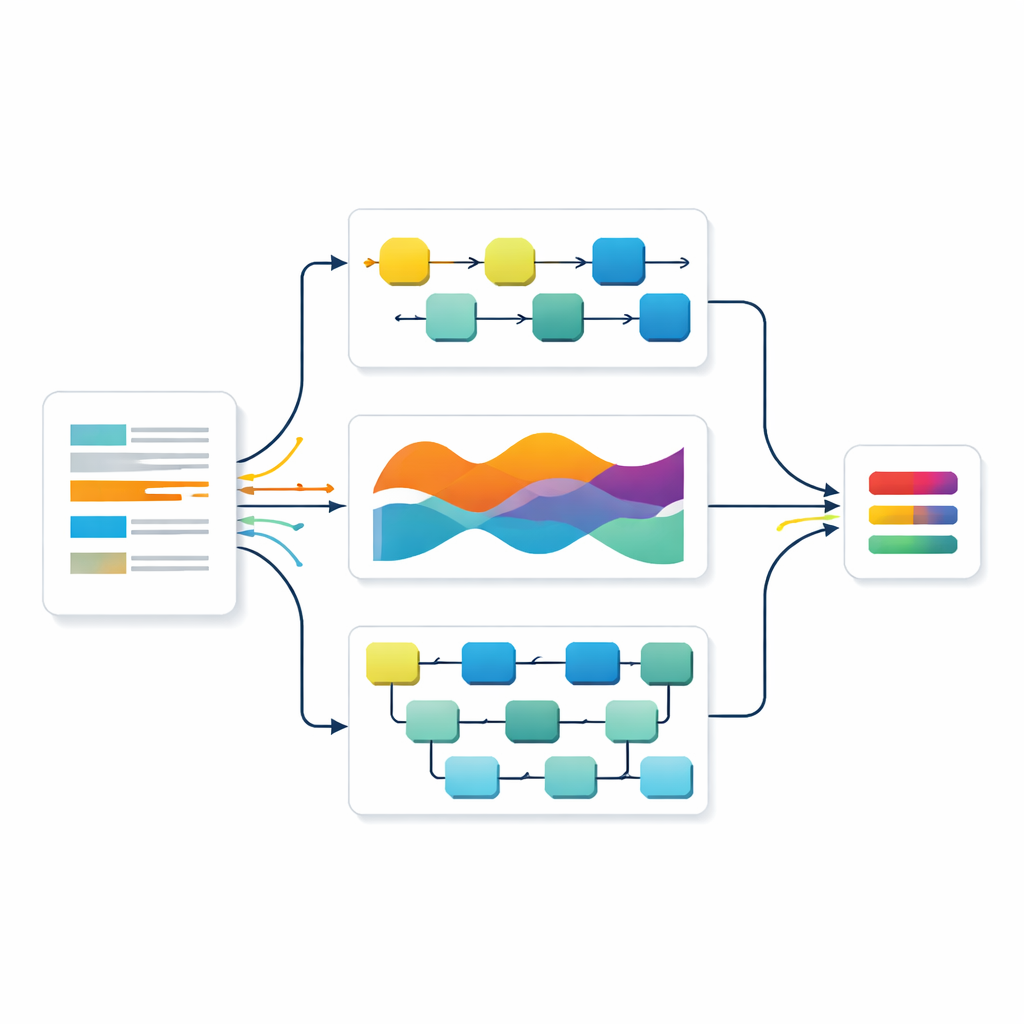

Авторы построили свою систему на мощной языковой модели под названием RoBERTa, обученной на огромных объёмах текста для захвата тонких смысловых оттенков. Когда модель читает экзаменационный вопрос, она переводит каждое слово в богатое числовое представление, отражающее его связь с окружающими словами. Эти представления затем поступают в три специализированные нейронные сети. Одна сосредоточена на том, как информация развивается в предложении в порядке следования слов, другая отслеживает долгосрочные закономерности, а третья ищет ключевые локальные фразы. Вместе они учатся обнаруживать виды формулировок, которые сигнализируют о том, просит ли вопрос учащихся вспомнить, объяснить, применить или придумать что‑то новое.

Смешение разных взглядов ИИ

Вместо того чтобы полагаться на одну сеть, исследователи объединили все три, используя стратегию, заимствованную из систем голосования. Каждая модель делает собственное предположение о уровне вопроса и оценивает степень уверенности. Эти предположения затем усредняют, но не поровну — моделям, показавшим большую точность на отдельном валидационном наборе, дают больший вес. Такой «взвешенный ансамбль» позволяет сильным сторонам одной модели компенсировать слабости другой. Команда также тщательно подготовила данные, расширив открытый набор экзаменационных вопросов тщательно проверенными парафразами, чтобы система могла учиться на большем числе примеров без ввода шума.

Насколько хорошо это работает?

На отложенном тестовом наборе, который модели не видели во время обучения, все три отдельные сети классифицировали вопросы с точностью выше 90 процентов, уже превосходя многие ранние подходы в научной литературе. Объединённый ансамбль показал ещё лучший результат, правильно маркируя около 92 процентов вопросов и демонстрируя сбалансированную производительность по всем шестим уровням мышления, включая более продвинутые. Статистический тест подтвердил, что это улучшение по сравнению с лучшей отдельной моделью вряд ли объясняется случайностью. Детальные разборы ошибок показали, что ансамбль уменьшил путаницу между соседними уровнями мышления, которые зачастую труднее всего разделять и людям.

Что это значит для преподавателей и учащихся

Автоматическая сортировка экзаменационных вопросов по уровням мышления может помочь преподавателям быстро проверить, действительно ли их тесты измеряют весь диапазон навыков — от простого воспроизведения до творческого решения задач. Система может выявлять пробелы — например, если в экзамене слишком много лёгких вопросов и недостаточно заданий, стимулирующих более глубокое рассуждение — и помогать школам проектировать более согласованные оценки во времени. Хотя инструмент не заменяет профессиональное суждение, он предлагает быстрый, основанный на доказательствах отправной пункт, уменьшающий нагрузку и человеческие предубеждения. В перспективе авторы планируют интегрировать такие системы в онлайн‑платформы обучения и расширить их на новые виды навыков, которые будут важны в эпоху, когда учащиеся всё чаще работают бок о бок с ИИ.

Цитирование: Hamid, M., Malik, S., Saleem, M. et al. Enhancing educational assessment through automated question classification using a RoBERTa-based ensemble model. Sci Rep 16, 13754 (2026). https://doi.org/10.1038/s41598-026-45486-1

Ключевые слова: оценка в образовании, таксономия Блума, автоматическая классификация вопросов, глубокое обучение в образовании, языковые модели