Clear Sky Science · fr

Améliorer l’évaluation éducative grâce à la classification automatisée des questions à l’aide d’un modèle d’ensemble basé sur RoBERTa

Des tests plus intelligents pour les salles de classe modernes

Chaque année, les enseignant·e·s rédigent des milliers de questions d’examen pour apprécier dans quelle mesure les élèves apprennent — non seulement quels faits ils retiennent, mais aussi la profondeur de leur pensée. Déterminer quelles questions évaluent la simple restitution et lesquelles exigent une véritable résolution de problème est important, mais cette tâche manuelle est lente et souvent incohérente. Cet article présente un système d’intelligence artificielle capable de trier automatiquement les questions d’examen selon l’exigence cognitive qu’elles sollicitent, promettant des évaluations plus équitables et plus de temps pour l’enseignement.

Pourquoi les niveaux de pensée comptent

Pendant des décennies, les éducateur·rice·s se sont appuyé·e·s sur un cadre connu sous le nom de taxonomie de Bloom pour concevoir cours et examens. Il décrit six niveaux de pensée, depuis la mémorisation de faits jusqu’à la compréhension, l’application, l’analyse, l’évaluation et enfin la création. Un bon examen devrait couvrir l’ensemble de cette gamme plutôt que de se concentrer sur les niveaux les plus faciles. Mais classer chaque question dans l’un de ces niveaux reste un acte d’appréciation, sujet à désaccord entre enseignant·e·s. Automatiser cette étape peut rendre les évaluations plus objectives et révéler rapidement si une épreuve met réellement les élèves au défi, plutôt que de simplement vérifier la mémoire.

Apprendre à une machine à lire les questions d’examen

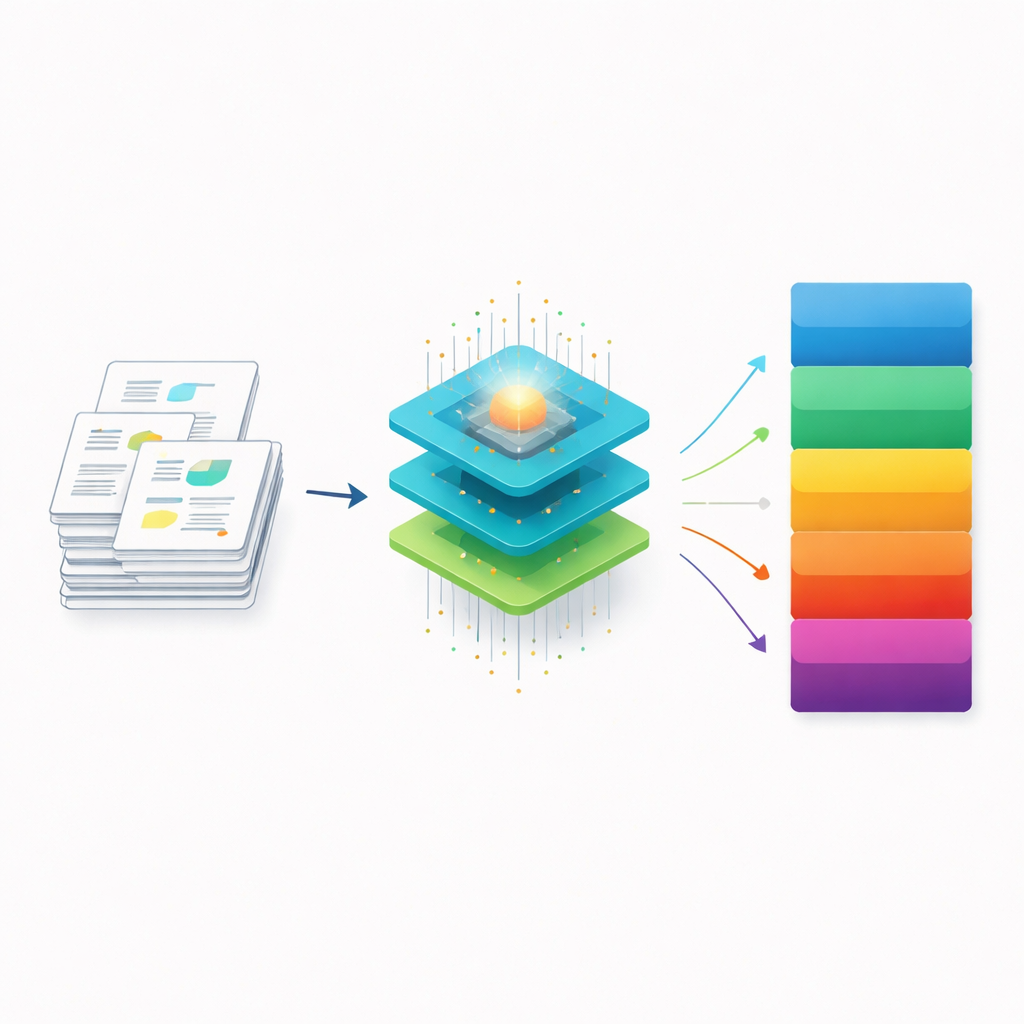

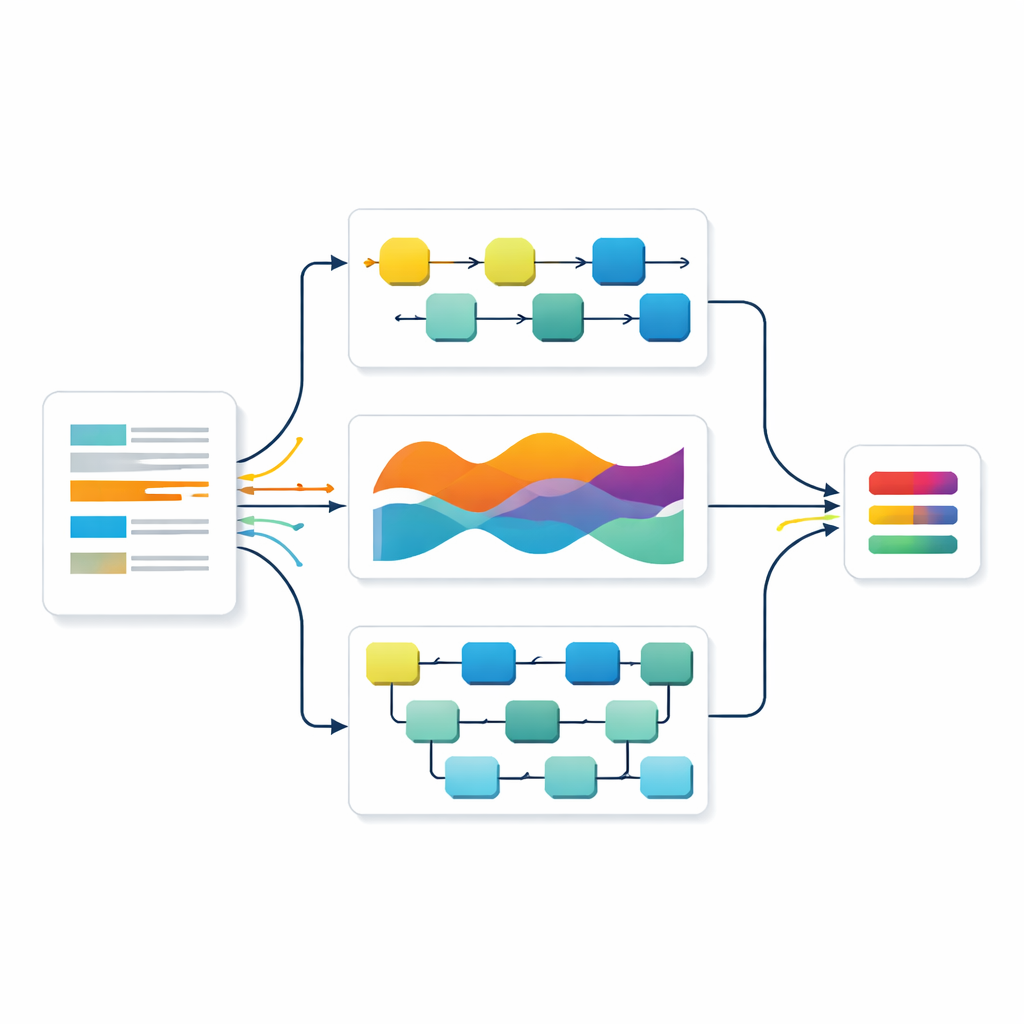

Les auteur·rice·s ont construit leur système sur un puissant modèle de langage appelé RoBERTa, entraîné sur d’immenses quantités de texte pour capter des nuances sémantiques fines. Lorsque le modèle lit une question d’examen, il convertit chaque mot en une représentation numérique riche qui reflète ses relations avec les mots environnants. Ces représentations sont ensuite traitées par trois réseaux neuronaux spécialisés. L’un se concentre sur le déroulement séquentiel de l’information dans la phrase, un autre suit des motifs à long terme, et un troisième repère des syntagmes locaux clés. Ensemble, ils apprennent à détecter les formulations qui indiquent si une question demande aux élèves de restituer, d’expliquer, d’appliquer ou d’innover.

Mélanger différents points de vue de l’IA

Plutôt que de se fier à un seul réseau, les chercheur·se·s ont combiné les trois en s’inspirant des systèmes de vote. Chaque modèle produit sa propre prédiction du niveau d’une question, accompagnée d’une mesure de confiance. Ces prédictions sont ensuite moyennées, mais pas de manière égale — les modèles qui montrent une meilleure précision sur un ensemble de validation séparé reçoivent un poids plus important. Cette approche d’« ensemble pondéré » permet aux forces d’un modèle de compenser les faiblesses d’un autre. L’équipe a également préparé rigoureusement ses données, en enrichissant un jeu de données public de questions d’examen par des paraphrases soigneusement vérifiées afin que le système puisse apprendre à partir de plus d’exemples sans introduire de bruit.

Quel est le niveau de performance ?

Sur un jeu de test tenu à l’écart, que les modèles n’avaient jamais vu pendant l’entraînement, les trois réseaux individuels ont classé les questions avec plus de 90 % de précision, dépassant déjà de nombreuses approches antérieures dans la littérature. L’ensemble combiné a fait encore mieux, étiquetant correctement environ 92 % des questions et maintenant une performance équilibrée sur les six niveaux de pensée, y compris les plus avancés. Un test statistique a confirmé que cette amélioration par rapport au meilleur modèle unique était peu susceptible d’être due au hasard. Des analyses détaillées des erreurs ont montré que l’ensemble réduisait la confusion entre niveaux voisins de pensée, qui sont souvent aussi les plus difficiles à distinguer pour les humains.

Ce que cela signifie pour les enseignant·e·s et les élèves

En triant automatiquement les questions d’examen selon les niveaux de pensée, ce système pourrait aider les enseignant·e·s à vérifier rapidement si leurs évaluations mesurent réellement une gamme de compétences, de la simple restitution à la résolution créative de problèmes. Il peut signaler des lacunes — par exemple, si une épreuve contient trop de questions faciles et trop peu de questions stimulant un raisonnement approfondi — et aider les établissements à concevoir des évaluations plus cohérentes dans le temps. Bien que l’outil ne remplace pas le jugement professionnel, il offre un point de départ rapide et fondé sur des preuves qui réduit la charge de travail et les biais humains. Pour l’avenir, les auteur·rice·s prévoient d’intégrer de tels systèmes aux plateformes d’apprentissage en ligne et de les étendre à de nouveaux types de compétences qui seront importantes à une époque où les élèves travaillent de plus en plus aux côtés de l’IA.

Citation: Hamid, M., Malik, S., Saleem, M. et al. Enhancing educational assessment through automated question classification using a RoBERTa-based ensemble model. Sci Rep 16, 13754 (2026). https://doi.org/10.1038/s41598-026-45486-1

Mots-clés: évaluation éducative, Taxonomie de Bloom, classification automatisée des questions, apprentissage profond en éducation, modèles de langage