Clear Sky Science · sv

Förbättrad utbildningsbedömning genom automatisk frågeklassificering med en RoBERTa‑baserad ensemblemodell

Smartare prov för dagens klassrum

Varje år skriver lärare tusentals provfrågor för att mäta hur väl eleverna lär sig — inte bara vilka fakta de minns, utan hur djupt de kan tänka. Att avgöra vilka frågor som testar enkel återgivning och vilka som kräver verklig problemlösning är viktigt, men att göra detta för hand är långsamt och ofta inkonsekvent. Denna artikel presenterar ett artificiellt intelligenssystem som automatiskt kan sortera provfrågor efter hur krävande de är för elevernas tänkande, vilket lovar rättvisare prov och mer tid för undervisning.

Varför nivåerna av tänkande spelar roll

I årtionden har pedagoger förlitat sig på ett ramverk känt som Blooms taxonomi för att utforma lektioner och prov. Det beskriver sex tänkenivåer, från att minnas grundläggande fakta via förståelse, tillämpning, analys och värdering, upp till att skapa något nytt. Ett bra prov bör täcka detta hela spektrum snarare än att klustra sig kring de enklaste nivåerna. Men att klassificera varje fråga i en av dessa nivåer är en bedömningsfråga, och olika lärare kan vara oense. Att automatisera detta steg kan göra bedömningar mer objektiva och snabbt visa om ett prov verkligen utmanar elevernas tänkande snarare än bara kontrollerar minnet.

Att lära en maskin att läsa provfrågor

Författarna byggde sitt system på en kraftfull språkmodell kallad RoBERTa, som tränats på stora mängder text för att fånga nyansskillnader i betydelse. När modellen läser en provfråga omvandlar den varje ord till en rik numerisk representation som speglar hur det relaterar till orden runt omkring. Dessa representationer förs sedan in i tre specialiserade neurala nätverk. Ett fokuserar på hur information utvecklas i ordning genom satsen, ett annat spårar långsiktiga mönster, och ett tredje söker efter viktiga lokala fraser. Tillsammans lär de sig känna igen de typer av formuleringar som signalerar om en fråga ber eleverna att återkalla, förklara, tillämpa eller förnya.

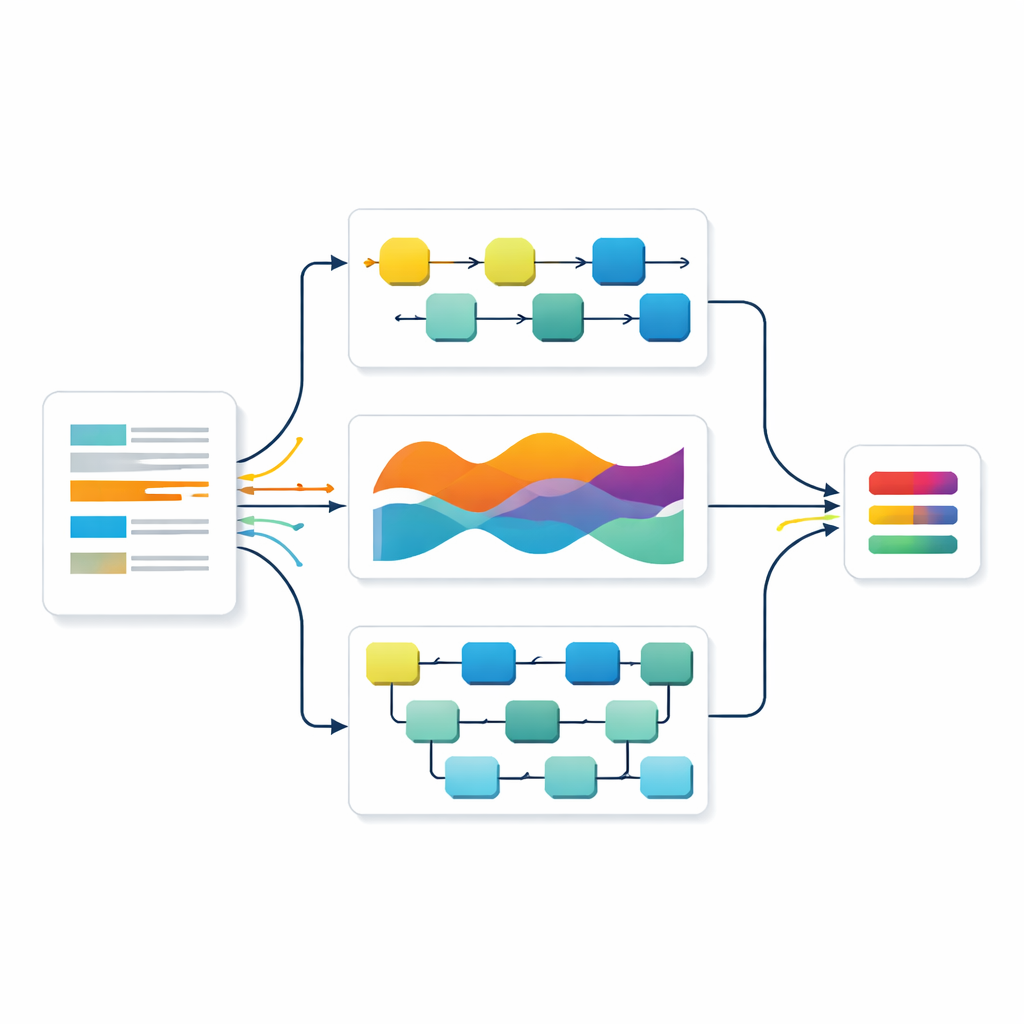

Att blanda olika AI‑vinklar

I stället för att förlita sig på ett enda nätverk kombinerade forskarna alla tre med en strategi hämtad från omröstningssystem. Varje modell producerar sin egen gissning om en frågas nivå, tillsammans med en måttstock för säkerhet. Dessa gissningar genomsnittas sedan, men inte lika — modeller som visat sig mer precisa på en separat valideringsmängd får större vikt. Detta ”vikta ensemble”‑angreppssätt låter styrkorna hos en modell väga upp svagheterna hos en annan. Teamet förberedde också sina data noggrant och utökade en offentlig datamängd av provfrågor med omsorgsfullt kontrollerade parafraser så att systemet kunde lära sig från fler exempel utan att introducera brus.

Hur bra fungerar det?

På en reserverad testmängd som modellerna aldrig såg under träningen klassificerade alla tre individuella nätverken frågor med över 90 procent noggrannhet, vilket redan överträffade många tidigare angreppssätt i forskningslitteraturen. Den kombinerade ensemblen presterade ännu bättre och märkte korrekt cirka 92 procent av frågorna och upprätthöll balanserad prestanda över alla sex tänkenivåer, inklusive de mer avancerade. Ett statistiskt test bekräftade att denna förbättring jämfört med den bästa enskilda modellen sannolikt inte berodde på slumpen. Detaljerade felanalyser visade att ensemblen minskade förväxling mellan angränsande tänkenivåer, som ofta också är svårast för människor att skilja åt.

Vad detta betyder för lärare och elever

Genom att automatiskt sortera provfrågor i tänkenivåer kan detta system hjälpa lärare att snabbt kontrollera om deras prov verkligen mäter ett spektrum av färdigheter, från grundläggande återgivning till kreativ problemlösning. Det kan peka ut luckor — till exempel om ett prov innehåller för många lätta frågor och för få som främjar djupare resonemang — och kan hjälpa skolor att utforma mer konsekventa bedömningar över tid. Medan verktyget inte ersätter professionellt omdöme erbjuder det en snabb, evidensbaserad utgångspunkt som minskar arbetsbelastning och mänsklig partiskhet. Framöver planerar författarna att integrera sådana system i nätbaserade lärplattformar och utvidga dem till nya sorters färdigheter som kommer att vara viktiga i en tid där elever i allt högre grad arbetar sida vid sida med AI.

Citering: Hamid, M., Malik, S., Saleem, M. et al. Enhancing educational assessment through automated question classification using a RoBERTa-based ensemble model. Sci Rep 16, 13754 (2026). https://doi.org/10.1038/s41598-026-45486-1

Nyckelord: utbildningsbedömning, Blooms taxonomi, automatisk frågeklassificering, djupt lärande i utbildning, språkmodeller