Clear Sky Science · ja

RoBERTaベースのアンサンブルモデルを用いた自動問題分類による教育評価の高度化

現代の教室のためのより賢いテスト

教師は毎年何千もの試験問題を作成し、学生がどれだけ学んでいるかを測ります。単に事実を記憶しているかだけでなく、どれだけ深く考えられるかを把握することが重要です。どの問題が単純な想起を試すもので、どれが真の問題解決を要するかを判断する作業は、手作業では遅く、一貫性に欠けることが多い。本論文は、試験問題を学生の思考負荷に応じて自動的に分類できる人工知能システムを紹介し、公正なテストと教授活動に回せる時間の増加を期待させます。

思考のレベルが重要な理由

何十年にもわたり教育者はブルームのタキソノミーという枠組みに頼り、授業や試験を設計してきました。それは、基本的な事実の想起から理解、適用、分析、評価を経て新たな創造に至る6つの思考層を記述します。良い試験は最も易しいレベルに偏るのではなく、この全範囲をカバーすべきです。しかし、各問題をどのレベルに分類するかは判断を伴う作業であり、教師間の意見が分かれることもあります。この過程を自動化することで、評価の客観性が高まり、テストが単なる記憶チェックに留まらず本当に思考を問うものかを迅速に示せます。

試験問題を読み解く機械を教える

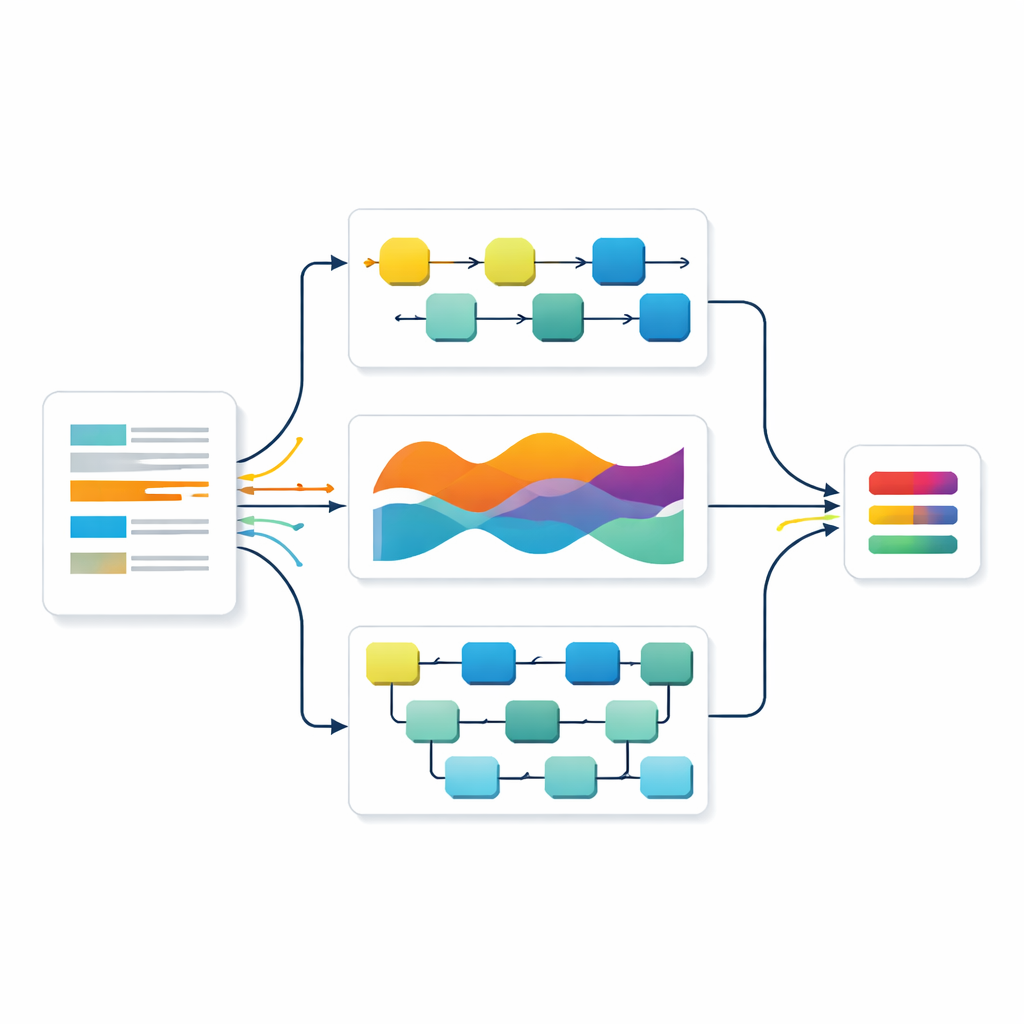

著者らは強力な言語モデルRoBERTaを基盤にシステムを構築しました。RoBERTaは膨大なテキストで学習しており、微妙な意味の違いを捉えます。モデルが試験問題を読むとき、各単語はその周囲の語との関係を反映した豊かな数値表現に変換されます。これらの表現はさらに3つの専門化されたニューラルネットワークに流れ込みます。1つは文中で情報がどのように展開するかに焦点を当て、もう1つは長期的なパターンを追跡し、3つ目は重要な局所句を検出します。これらが協働して、問題が想起、説明、応用、あるいは革新を求めるかを示す語法パターンを学習します。

異なるAIの視点を融合する

研究者たちは単一のネットワークに頼るのではなく、投票システムに由来する戦略を用いて3つを組み合わせました。各モデルは問題のレベルに関する予測とその確信度を出力します。これらの予測は平均化されますが、等しく重み付けされるわけではありません。別の検証セットでより高い精度を示したモデルにはより大きな重みが与えられます。この「重み付きアンサンブル」手法により、あるモデルの強みが他の弱みを相殺できます。チームはデータの準備も厳密に行い、公開されている試験問題データセットを注意深く検証した言い換え例で拡張することで、ノイズを増やさずに学習例を増やしました。

どれほど効果があるか

モデルが訓練中に一度も見ていない保持用テストセット上で、3つの個別ネットワークはいずれも90パーセントを超える精度で問題を分類し、研究文献にある多くの従来手法を既に上回りました。アンサンブルはさらに優れ、約92パーセントの正答率を達成し、より高度なレベルを含む6つの思考レベル全体でバランスの取れた性能を保ちました。統計検定により、この改善が最良の単一モデルに対する偶然によるものではないことが確認されました。誤分類の詳細分析では、アンサンブルが隣接する思考レベル間の混同を減らしており、これらは人間にとっても区別が難しいことが多いことが示されました。

教師と学生にとっての意義

このシステムが試験問題を思考レベル別に自動仕分けできれば、教師はテストが基本的な想起から創造的な問題解決まで幅広い能力を本当に測っているかを素早くチェックできます。例えば、試験に易しい問題が多く深い推論を促す問題が少ないといったギャップを指摘し、学校が時間をかけてより一貫した評価を設計するのを助けられます。ツールは専門的判断を代替するものではありませんが、負担と人間の偏りを軽減する迅速で証拠に基づく出発点を提供します。将来に向けて、著者らはこうしたシステムをオンライン学習プラットフォームに組み込み、学生がAIと共に働く時代に重要となる新しい種類の能力へと拡張する計画です。

引用: Hamid, M., Malik, S., Saleem, M. et al. Enhancing educational assessment through automated question classification using a RoBERTa-based ensemble model. Sci Rep 16, 13754 (2026). https://doi.org/10.1038/s41598-026-45486-1

キーワード: 教育評価, ブルームのタキソノミー, 自動問題分類, 教育における深層学習, 言語モデル