Clear Sky Science · pt

Aprimorando a avaliação educacional por meio da classificação automatizada de questões usando um modelo ensemble baseado em RoBERTa

Provas mais inteligentes para salas de aula modernas

Cada ano, professores elaboram milhares de questões de prova para avaliar o quanto os alunos estão aprendendo — não apenas quais fatos lembram, mas com que profundidade conseguem pensar. Decidir quais questões testam simples memorização e quais exigem resolução real de problemas é importante, porém fazer isso manualmente é lento e frequentemente inconsistente. Este artigo apresenta um sistema de inteligência artificial que pode ordenar automaticamente as questões de prova segundo o grau de exigência das habilidades cognitivas dos alunos, prometendo avaliações mais justas e mais tempo para o ensino.

Por que os níveis de pensamento importam

Por décadas, educadores se apoiaram em um quadro conhecido como Taxonomia de Bloom para orientar aulas e provas. Ela descreve seis camadas de pensamento, desde lembrar fatos básicos até compreender, aplicar, analisar, avaliar e, por fim, criar algo novo. Uma boa prova deve abranger toda essa gama em vez de se concentrar apenas nos níveis mais fáceis. Mas classificar cada questão em um desses níveis é uma avaliação subjetiva, e diferentes professores podem discordar. Automatizar essa etapa pode tornar as avaliações mais objetivas e revelar rapidamente se um teste realmente desafia o raciocínio dos alunos em vez de apenas checar a memória.

Ensinando uma máquina a ler questões de prova

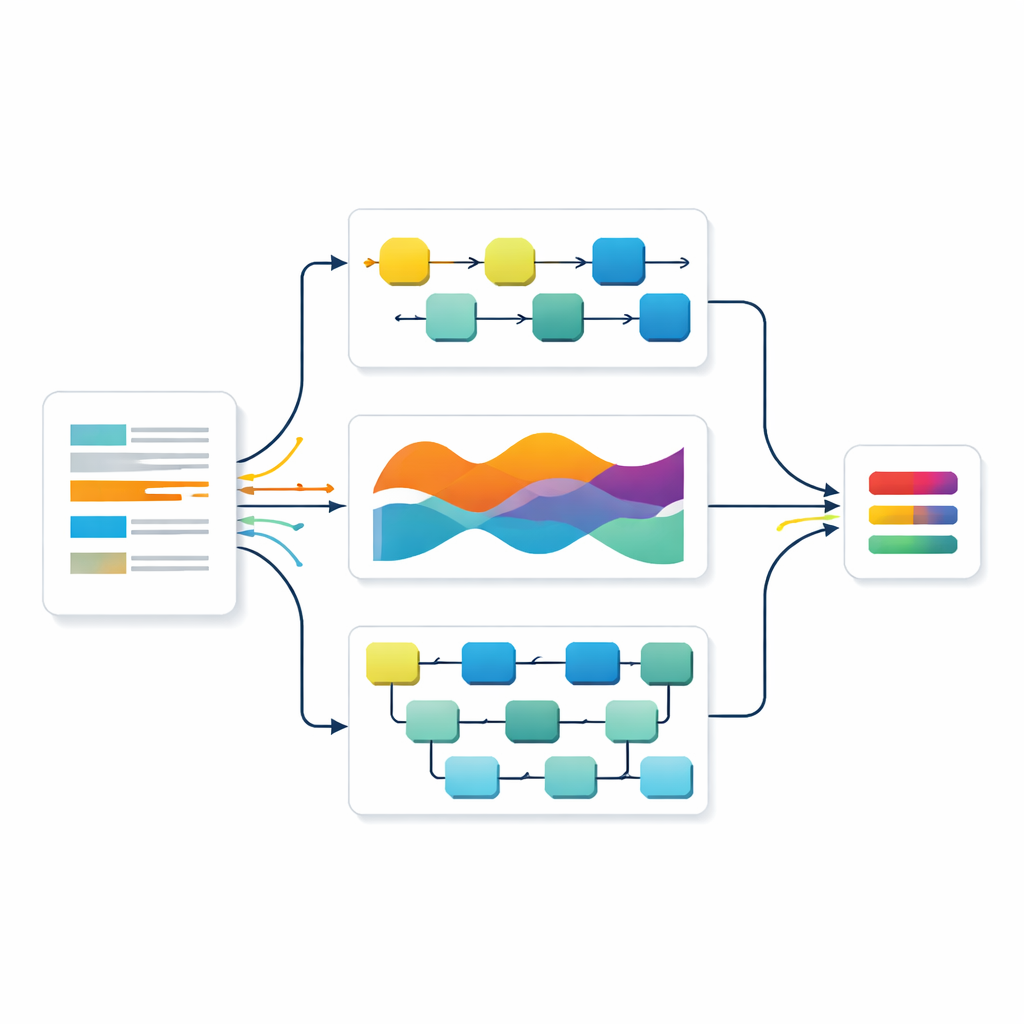

Os autores construíram o sistema sobre um poderoso modelo de linguagem chamado RoBERTa, treinado em grandes volumes de texto para captar sutilezas de significado. Quando o modelo lê uma questão de prova, ele converte cada palavra em uma representação numérica rica que reflete como ela se relaciona com as palavras ao seu redor. Essas representações então fluem para três redes neurais especializadas. Uma se concentra em como a informação se desenrola na sentença em ordem, outra rastreia padrões de longo prazo e uma terceira procura por frases locais-chave. Em conjunto, elas aprendem a detectar os tipos de formulação que sinalizam se uma questão pede que os alunos lembrem, expliquem, apliquem ou inovem.

Combinando diferentes pontos de vista da IA

Em vez de confiar em uma única rede, os pesquisadores combinaram as três usando uma estratégia emprestada de sistemas de votação. Cada modelo produz sua própria hipótese sobre o nível da questão, juntamente com uma medida de confiança. Essas hipóteses são então combinadas por média, mas não de forma igual — modelos que demonstram maior acurácia em um conjunto de validação separado recebem maior peso. Essa abordagem de “ensemble ponderado” permite que os pontos fortes de um modelo compensem as fraquezas de outro. A equipe também preparou rigorosamente seus dados, ampliando um conjunto público de questões de prova com paráfrases cuidadosamente verificadas para que o sistema pudesse aprender com mais exemplos sem introduzir ruído.

Quão bem isso funciona?

Em um conjunto de teste reservado que os modelos nunca viram durante o treinamento, as três redes individuais classificaram questões com mais de 90% de acurácia, já superando muitas abordagens anteriores da literatura. O ensemble combinado foi ainda melhor, rotulando corretamente cerca de 92% das questões e mantendo desempenho equilibrado em todos os seis níveis de pensamento, incluindo os mais avançados. Um teste estatístico confirmou que essa melhoria sobre o melhor modelo individual provavelmente não se deve ao acaso. Análises detalhadas dos erros mostraram que o ensemble reduziu a confusão entre níveis vizinhos de pensamento, que frequentemente são os mais difíceis até mesmo para humanos distinguir.

O que isso significa para professores e alunos

Ao ordenar automaticamente as questões de prova por nível de pensamento, esse sistema pode ajudar professores a verificar rapidamente se suas provas realmente medem uma variedade de competências, da memorização básica à resolução criativa de problemas. Pode sinalizar lacunas — por exemplo, se uma prova contém questões demais fáceis e poucas que promovam raciocínio mais profundo — e auxiliar escolas a desenhar avaliações mais consistentes ao longo do tempo. Embora a ferramenta não substitua o julgamento profissional, ela oferece um ponto de partida rápido e baseado em evidências que reduz carga de trabalho e viés humano. No futuro, os autores planejam integrar tais sistemas em plataformas de ensino online e estendê‑los a novos tipos de habilidades que serão importantes em uma era em que os alunos cada vez mais trabalham ao lado da IA.

Citação: Hamid, M., Malik, S., Saleem, M. et al. Enhancing educational assessment through automated question classification using a RoBERTa-based ensemble model. Sci Rep 16, 13754 (2026). https://doi.org/10.1038/s41598-026-45486-1

Palavras-chave: avaliação educacional, Taxonomia de Bloom, classificação automatizada de questões, aprendizado profundo na educação, modelos de linguagem