Clear Sky Science · ar

تعزيز التقييم التعليمي من خلال تصنيف الأسئلة الآلي باستخدام نموذج إجمالي قائم على RoBERTa

اختبارات أذكى للفصول الحديثة

كل عام، يكتب المعلمون آلاف الأسئلة الامتحانية لقياس مدى تعلم الطلاب — ليس فقط ما يتذكرونه من حقائق، بل مدى عمق تفكيرهم. تحديد أي الأسئلة تقيس الاستدعاء البسيط وأيها تتطلب حل مشكلات حقيقيًا أمر مهم، ومع ذلك فإن القيام بذلك يدويًا بطيء وغالبًا ما يكون متباينًا. تقدم هذه الورقة نظام ذكاء اصطناعي يمكنه فرز أسئلة الامتحان تلقائيًا حسب مدى استنفادها لمهارات التفكير لدى الطلاب، مما يعد باختبارات أكثر عدلاً ووقتًا أطول للتدريس.

لماذا تهم مستويات التفكير

على مدار عقود، اعتمد التربويون إطارًا يعرف بتصنيف بلوم لتوجيه الدروس والاختبارات. يصف ست طبقات من التفكير، بدءًا من تذكر الحقائق الأساسية مرورًا بالفهم والتطبيق والتحليل والتقييم، وصولًا إلى الإبداع وابتكار شيء جديد. ينبغي أن يغطي الامتحان الجيد هذا النطاق الكامل بدلًا من التكدس عند أسهل المستويات. لكن تصنيف كل سؤال ضمن أحد هذه المستويات قرار تقويمي، وقد يختلف المعلمون في ذلك. يمكن لأتمتة هذه الخطوة أن تجعل التقييمات أكثر موضوعية وأن تكشف بسرعة ما إذا كان الاختبار يتحدى عقول الطلاب فعلًا بدلًا من مجرد فحص الذاكرة.

تعليم الآلة قراءة أسئلة الامتحان

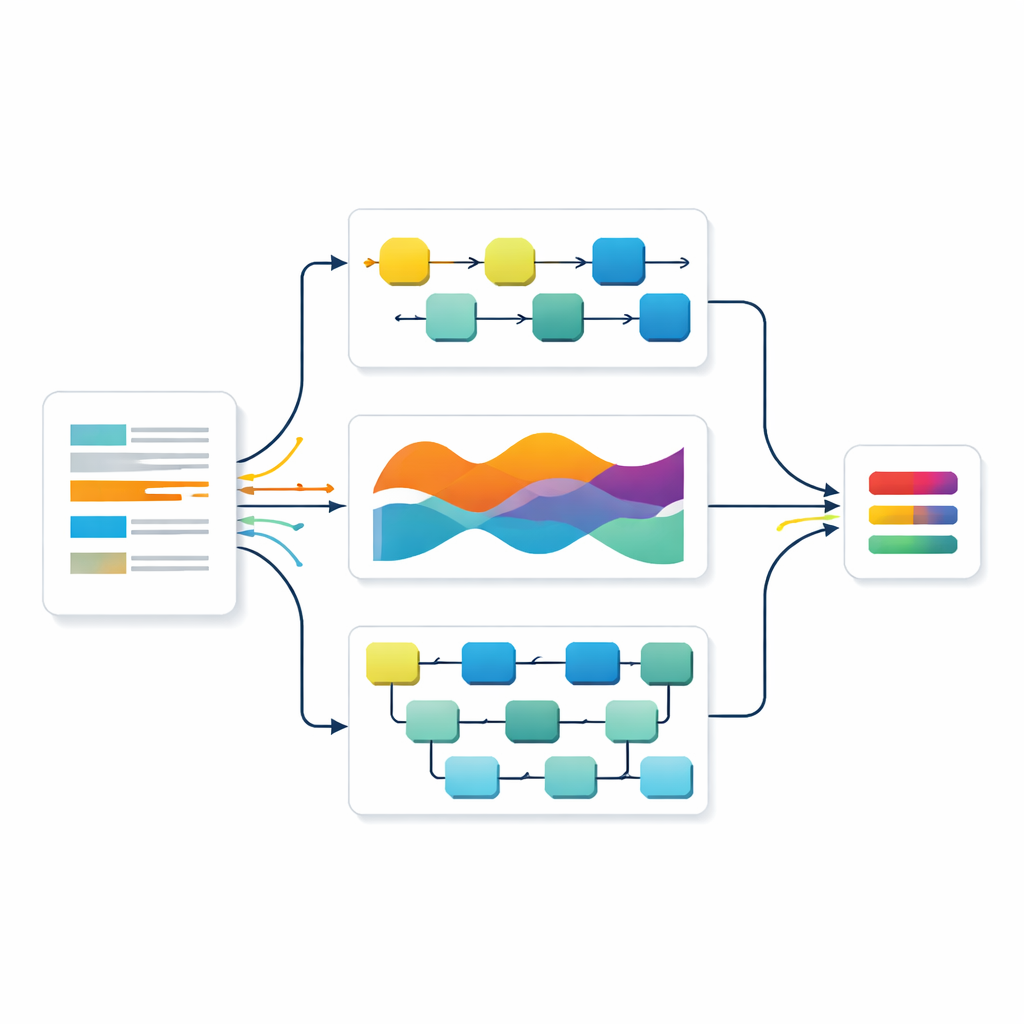

بنى المؤلفون نظامهم على نموذج لغة قوي يُدعى RoBERTa، تم تدريبه على كميات هائلة من النص لالتقاط الفروق الدقيقة في المعنى. عندما يقرأ النموذج سؤالًا امتحانيًا، يحول كل كلمة إلى تمثيل عددي غني يعكس كيفية ارتباطها بالكلمات المحيطة بها. ثم تتدفق هذه التمثيلات إلى ثلاث شبكات عصبية متخصصة. تركز إحداها على كيفية تسلسل المعلومات عبر الجملة، وتتتبع أخرى الأنماط طويلة الأمد، بينما تبحث الثالثة عن عبارات محلية رئيسية. معًا، تتعلم هذه المكونات اكتشاف أنواع الصياغة التي تشير إلى أن السؤال يطلب من الطلاب أن يستذكروا أو يشرحوا أو يطبّقوا أو يبتكروا.

دمج وجهات نظر مختلفة للذكاء الاصطناعي

بدلًا من الثقة في شبكة واحدة فقط، جمع الباحثون الثلاثة باستخدام استراتيجية مستعارة من أنظمة التصويت. ينتج كل نموذج تخمينه الخاص بشأن مستوى السؤال، مع قياس للثقة. تُجمَع هذه التخمينات بعد ذلك بمتوسط غير متساوٍ — حيث تُمنح النماذج التي أثبتت دقتها على مجموعة تحقق منفصلة وزنًا أكبر. يسمح هذا النهج «للتجمُع المرجَّح» بأن تعوّض نقاط قوة نموذج واحد ضعف آخر. كما أعد الفريق بياناتهم بعناية، موسعين مجموعة بيانات عامة لأسئلة الامتحانات بجمل معاد صياغتها تم التحقق منها بدقة حتى يتعلم النظام من أمثلة أكثر دون إدخال ضوضاء.

ما مدى فعاليته؟

على مجموعة اختبار احتُفظ بها ولم يرها النماذج أثناء التدريب، صنفت الشبكات الفردية الثلاث جميعها الأسئلة بدقة تزيد عن 90 بالمئة، متجاوزة بالفعل العديد من الأساليب السابقة في الأدبيات البحثية. أداؤه المجمع تحسن أكثر، حيث صنف نحو 92 بالمئة من الأسئلة بشكل صحيح وحافظ على أداء متوازن عبر جميع مستويات التفكير الستة، بما في ذلك المستويات المتقدمة. أكدت اختبار إحصائي أن هذا التحسن مقارنة بأفضل نموذج منفرد من غير المرجح أن يكون ناتجًا عن الصدفة. أظهرت تحليلات الأخطاء التفصيلية أن التجمع قلل الارتباك بين المستويات المجاورة من التفكير، وهي في الغالب الأصعب أيضًا للفصل بينها بواسطة البشر.

ماذا يعني هذا للمعلمين والطلاب

من خلال فرز أسئلة الامتحان تلقائيًا إلى مستويات التفكير، يمكن أن يساعد هذا النظام المعلمين على التحقق بسرعة مما إذا كانت اختباراتهم تقيس حقًا مجموعة من المهارات، من التذكر الأساسي إلى حل المشكلات الإبداعي. يمكنه الإشارة إلى الثغرات — على سبيل المثال، إذا احتوى الامتحان على الكثير من الأسئلة السهلة والقليل من الأسئلة التي تعزز التفكير الأعمق — ويمكن أن يساعد المدارس على تصميم تقييمات أكثر اتساقًا مع مرور الوقت. بينما لا يحل الأداة محل الحكم المهني، فهي تقدم نقطة انطلاق سريعة قائمة على الأدلة تقلل من عبء العمل والتحيز البشري. ونظرًا للمضي قدمًا، يخطط المؤلفون لدمج مثل هذه الأنظمة في منصات التعلم عبر الإنترنت وتوسيعها لتشمل أنواعًا جديدة من المهارات التي ستهم في عصر يعمل فيه الطلاب بشكل متزايد إلى جانب الذكاء الاصطناعي.

الاستشهاد: Hamid, M., Malik, S., Saleem, M. et al. Enhancing educational assessment through automated question classification using a RoBERTa-based ensemble model. Sci Rep 16, 13754 (2026). https://doi.org/10.1038/s41598-026-45486-1

الكلمات المفتاحية: التقييم التعليمي, تصنيف بلوم, التصنيف الآلي للأسئلة, التعلم العميق في التعليم, نماذج اللغة