Clear Sky Science · zh

通过迭代策略精炼使用大型语言模型进行感觉-运动控制

教会机器自主运动

想象一个机器人学会使杆保持平衡、把摆锤摆正,或从山谷中驶出——而不需要人工工程师逐一编写每一个细小动作或收集成千上万的示例演示。本文探讨如何将大型语言模型(LLM)——与聊天机器人所用的同类系统——转变为设计和改进此类移动机器控制策略的“头脑”,主要依赖文字描述并辅以少量试错。

从文字到动作

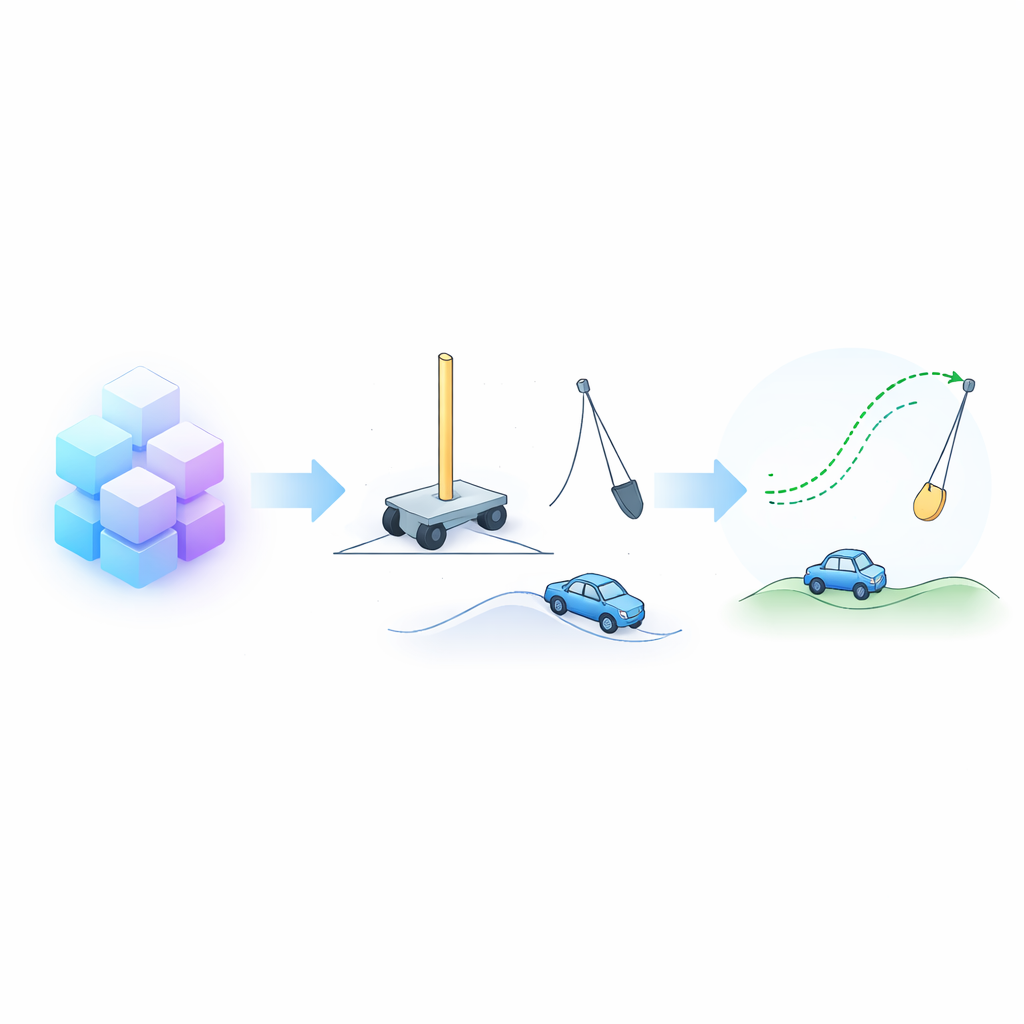

传统的机器人控制经常将运动分解为固定的构建模块,例如预定义的行走步态或到达动作;上层程序再选择并组合这些模块。虽然在简单场景中这种方法可行,但在动作相互融合、需要逐时刻精细调整的流动情形中,它的表现会受限。作者转而让LLM生成完整的控制规则,直接将机器人感知到的信息——位置、速度、角度等——映射为连续的电机指令。模型收到的初始信息仅是对机器人结构、传感器与执行器、周围环境及目标的自然语言描述。

反思与精炼的循环

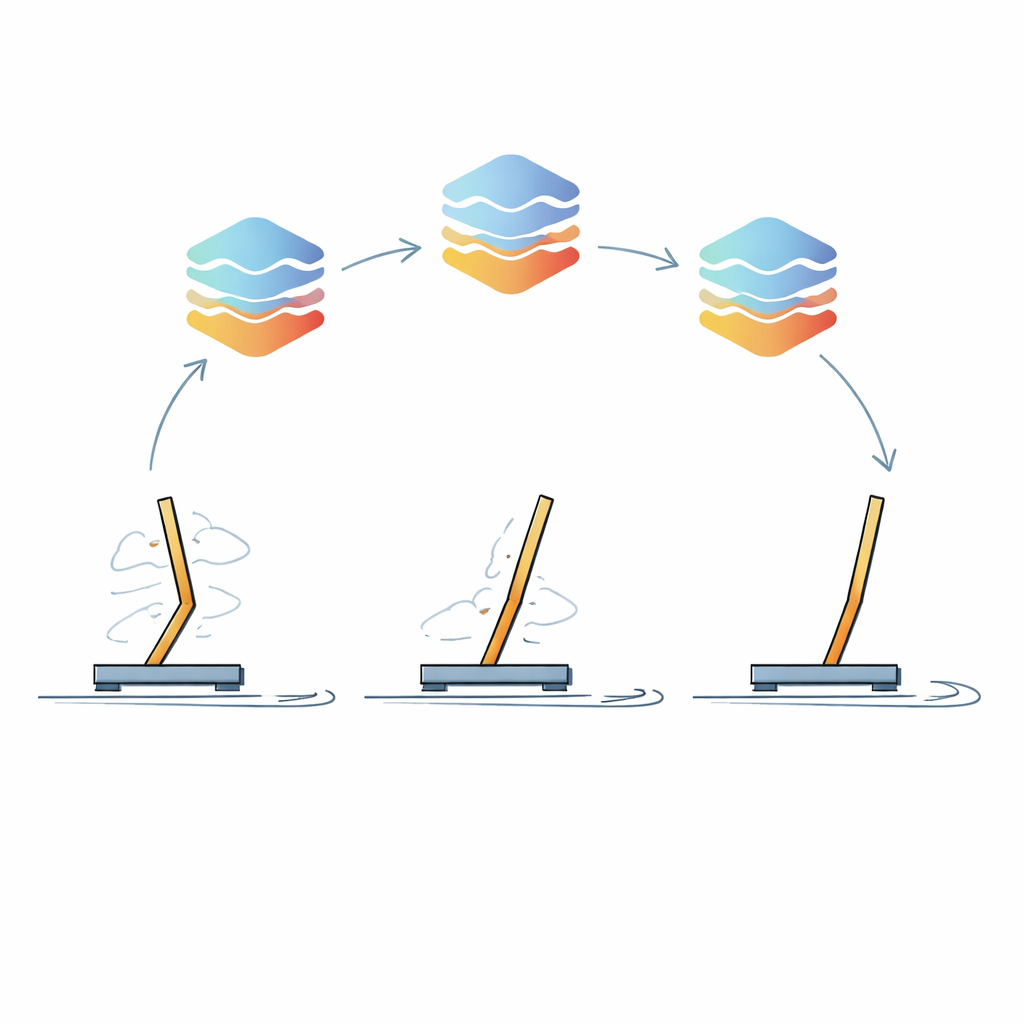

该方法的核心是作者称之为“迭代策略精炼”的学习循环。第一步,LLM被提示按阶段思考问题:先以通俗语言概述高层策略,然后把它转成清晰的IF–THEN–ELSE式规则,最后将这些规则转换为可执行代码。初始控制器在模拟环境中运行——例如需要保持杆直立的推车系统——并对机器人的表现进行评估。关键在于,将机器人若干短片段的传感器读数及对应动作连同策略表现的摘要一并反馈给LLM,要求其分析这些轨迹、发现弱点并生成改进后的控制器。该循环反复多次,逐步打磨出更好的行为。

把想法付诸检验

为了验证该方法的有效性,研究人员在一组强化学习经典基准任务上进行了测试:平衡推车-杆系统、摆动并稳定摆锤、驾驶汽车爬陡坡,以及将双连杆系统摆到目标高度的 acrobot 任务。他们还在一个流行物理模拟器中尝试了倒立摆任务。这些任务足够简单以便深入研究,但仍包含关键挑战:机器人无法一次性观测到全部信息、奖励存在延迟且物理可能高度不稳定。团队比较了若干现代开源语言模型(参数规模约为70–1200亿),调整模型输出中的随机性,并对每项实验重复多次以获得可靠统计结果。

语言模型能多好地控制机器?

表现最好的模型是一个名为 GPT-oss 的1200亿参数系统,它在大多数任务上持续发现高质量的控制策略,常常达到最优或接近最优的得分。另一个模型 Qwen2.5 在某些问题上表现尤为出色,甚至在倒立摆任务上超过了 GPT-oss,但在标准摆锤等任务上则表现较差。重要的是,LLM最初生成的控制器常常水平一般,这表明它们并非只是从训练数据中简单回忆现成方案。随着模型利用反馈调整哪些传感信号更重要以及它们应如何影响动作,性能在迭代中显著提升。作者还探究了在每次精炼提示中应包含多少时间步的传感数据以及哪些反馈信息最关键,发现中等量的数据和关于先前策略的丰富信息效果最佳。

这对未来机器人意味着什么

对非专业读者来说,主要结论是:语言模型不仅能用于对话,还能帮助设计使机器智能运动的细粒度运动规则。与从随机行为开始并依赖大量试错数据的方法不同,LLM可以从口头描述中提出合理的控制方案,然后通过阅读短小的执行记录逐步改进。先验知识与经验学习的这种融合,可能降低构建有能力机器人与其他自主系统的成本与工作量。尽管仍存在障碍——例如运行大型模型所需的大量计算以及扩展到非常复杂、长时任务的挑战——该研究为一种路径提供了依据:低层运动规则可以在一定程度上由最初仅被训练来预测句子中下一个词的系统来塑造。

引用: Carvalho, J.T., Nolfi, S. Sensory-motor control with large language models via iterative policy refinement. Sci Rep 16, 13575 (2026). https://doi.org/10.1038/s41598-026-42091-0

关键词: 大型语言模型, 机器人控制, 强化学习, 具身智能体, 迭代策略精炼