Clear Sky Science · ru

Сенсомоторное управление с помощью больших языковых моделей через итеративную доработку политик

Обучение машин самостоятельно двигаться

Представьте робота, который учится балансировать шест, размахивать маятником в вертикальное положение или выбраться из впадины — без того чтобы инженеры вручную программировали каждое движение или собирали тысячи примеров демонстраций. В этой работе изучается, как большие языковые модели (LLM) — те же системы, что используются в чатботах — можно превратить в «мозги», разрабатывающие и улучшающие стратегии управления такими движущимися машинами, опираясь в основном на текстовые описания и немного проб и ошибок.

От слов к движениям

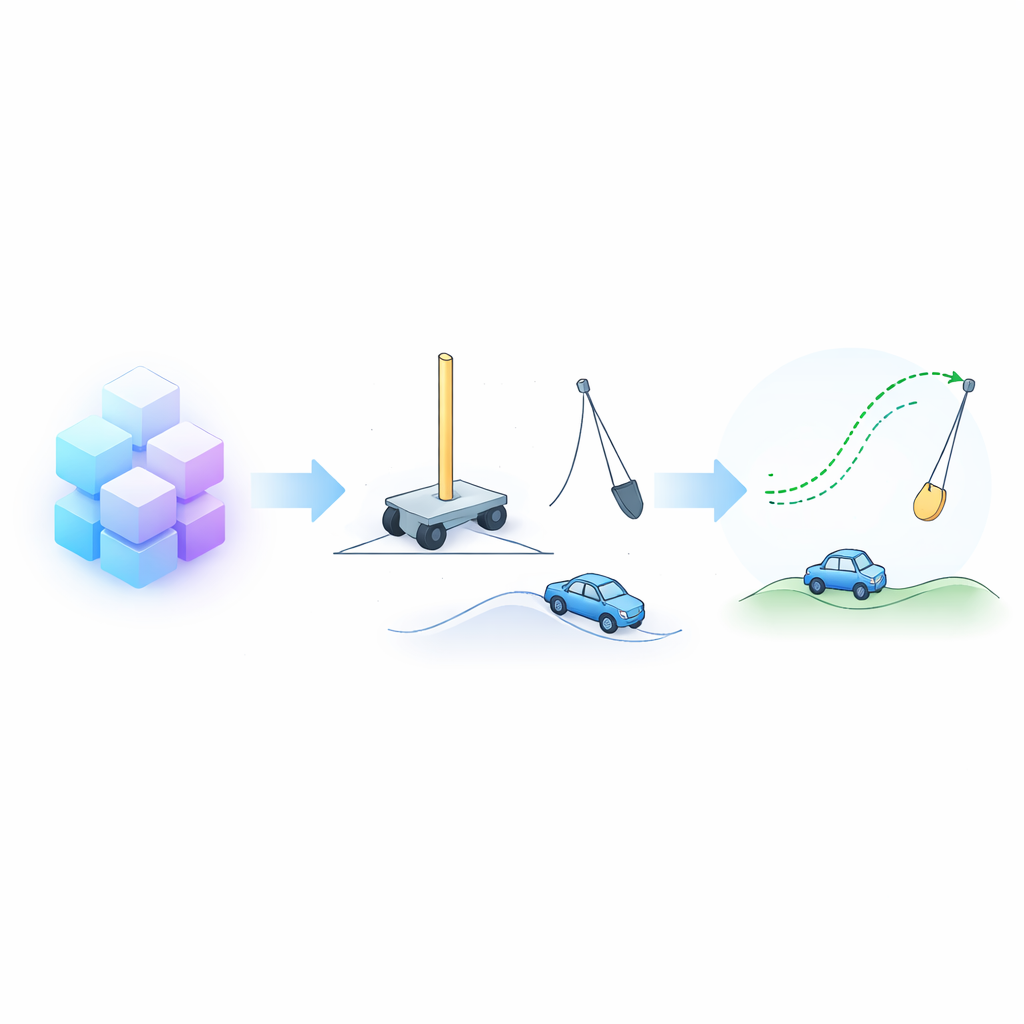

Традиционное управление роботами часто разбивает движение на фиксированные строительные блоки, такие как заранее определённые шаги при ходьбе или движения для захвата. Программа высокого уровня затем выбирает и соединяет эти фрагменты. Это работает в простых случаях, но испытывает трудности в более плавных ситуациях, когда движения переходят одно в другое и требуют точной настройки в каждый момент времени. Авторы предлагают LLM создавать полные правила управления, которые напрямую отображают то, что робот ощущает — его положение, скорость, углы и т. п. — в непрерывные команды моторам. Единственная исходная информация для модели — это описание на естественном языке конструкции робота, его датчиков и приводов, окружающей среды и поставленной задачи.

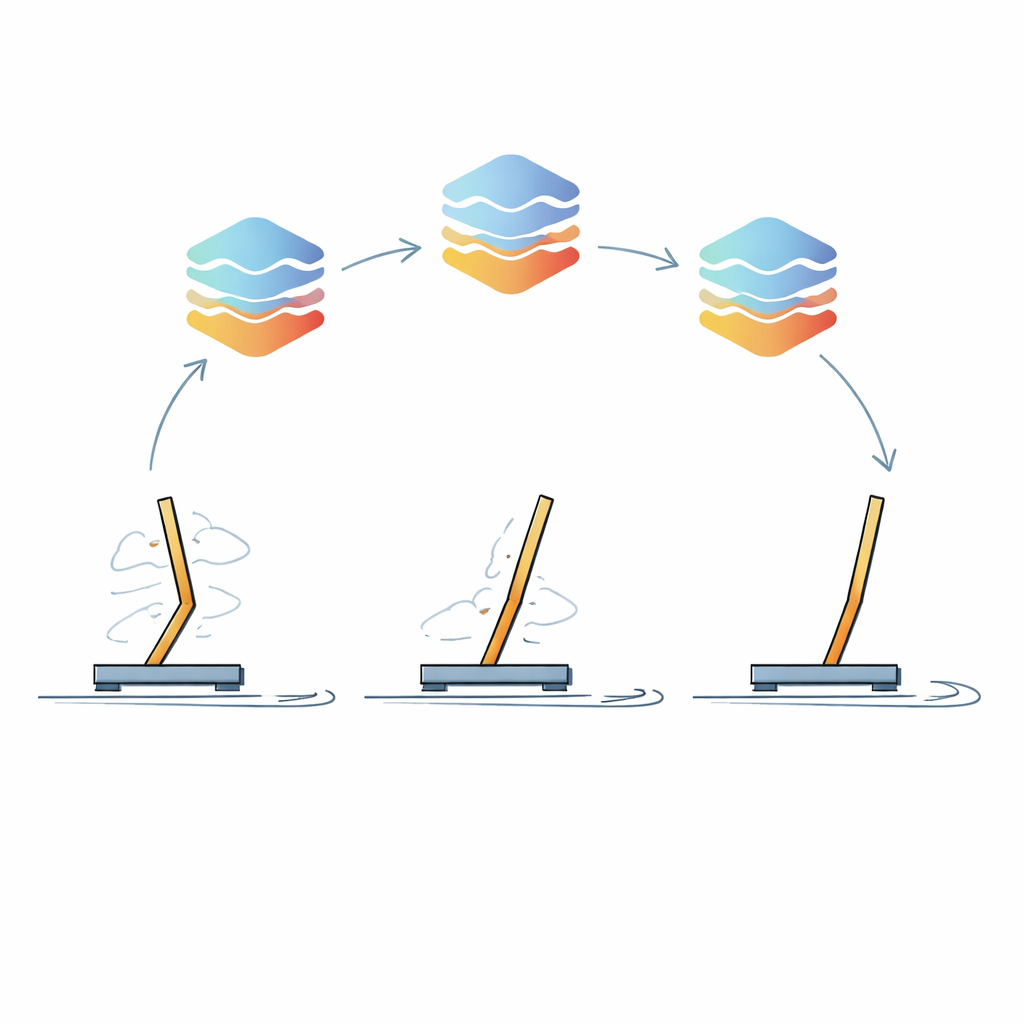

Цикл размышлений и доработки

Ключевой элемент подхода — итеративная обучающая петля, которую авторы называют Iterative Policy Refinement. На первом шаге LLM побуждают обдумать задачу по этапам: сначала она формулирует стратегию высокого уровня простым языком, затем переводит её в ясные правила в стиле ЕСЛИ–ТО–ИНАЧЕ, и, наконец, конвертирует эти правила в исполняемый код. Этот начальный контроллер запускают в симулированной среде — например, в системе «тележка с шестом», которую нужно удержать вертикально — и измеряют поведение робота. Существенно, что короткие фрагменты сенсорных показаний робота и соответствующих им действий затем возвращаются в LLM вместе с краткой сводкой о том, насколько хорошо сработала стратегия. Модель просят проанализировать эти трассы, выявить слабые места и сгенерировать улучшённый контроллер. Этот цикл повторяется многократно, постепенно шлифуя поведение.

Проверка идеи на практике

Чтобы проверить работоспособность метода, исследователи опробовали его на наборе классических бенчмарков из обучения с подкреплением: балансировка системы тележка–шест, раскачивание и стабилизация маятника, подъём автомобиля на крутой холм и задача acrobot, где двухзвенная система должна быть размахнута до целевой высоты. Они также решили задачу перевёрнутого маятника в популярном физическом симуляторе. Эти задачи достаточно просты для детального изучения, но всё же отражают ключевые трудности: робот не видит всё сразу, награды приходят с задержкой, а физика может быть крайне нестабильной. Команда сравнила несколько современных открытых языковых моделей с примерно 70–120 миллиардами параметров, варьировала степень стохастичности в ответах модели и повторяла каждый эксперимент несколько раз для получения надёжной статистики.

Насколько хорошо языковые модели управляют машинами?

Лучше всего показала себя модель с 120 миллиардами параметров под названием GPT-oss: она последовательно находила стратегии высокого качества для большинства задач, часто достигая оптимальных или близких к оптимальным результатов. Другая модель, Qwen2.5, особенно хорошо справлялась с некоторыми задачами и даже превзошла GPT-oss по перевёрнутому маятнику, хотя испытывала трудности в других случаях, например со стандартным маятником. Важно, что первые контроллеры, которые генерировали LLM, часто были посредственными, что показывает — модель не просто воспроизводит готовые решения из тренировочных данных. Производительность заметно улучшалась с итерациями, когда модели использовали обратную связь, чтобы скорректировать, какие сенсорные сигналы важны и как они должны влиять на действия. Авторы также изучили, сколько временных шагов сенсорных данных включать в каждый запрос и какие фрагменты обратной связи наиболее критичны, обнаружив, что оптимально среднее количество данных и подробная информация о предыдущих стратегиях.

Почему это важно для будущих роботов

Для неспециалиста главный вывод таков: языковые модели могут делать больше, чем просто разговаривать — они могут помогать проектировать тонкие моторные правила, которые заставляют машины двигаться разумно. Вместо того чтобы начинать с случайного поведения и требовать огромного количества проб и ошибок, LLM может предложить разумный план управления на основе словесного описания, а затем последовательно улучшать его, читая короткие записи о том, что случилось при испытаниях. Такое сочетание априорных знаний и обучения на опыте может снизить затраты и трудоемкость создания способных роботов и других автономных систем. Хотя остаются препятствия — например, большие вычислительные затраты на запуск крупных моделей и сложность масштабирования на очень сложные длительные задачи — исследование указывает путь к роботам, низкоуровневые движения которых во многом формируются системами, изначально обученными просто предсказывать следующее слово в предложении.

Цитирование: Carvalho, J.T., Nolfi, S. Sensory-motor control with large language models via iterative policy refinement. Sci Rep 16, 13575 (2026). https://doi.org/10.1038/s41598-026-42091-0

Ключевые слова: большие языковые модели, управление роботом, обучение с подкреплением, воплощённые агенты, итеративная доработка политик