Clear Sky Science · pl

Sterowanie sensoryczno-ruchowe z użyciem dużych modeli językowych poprzez iteracyjną poprawę polityki

Nauka samodzielnego poruszania się maszyn

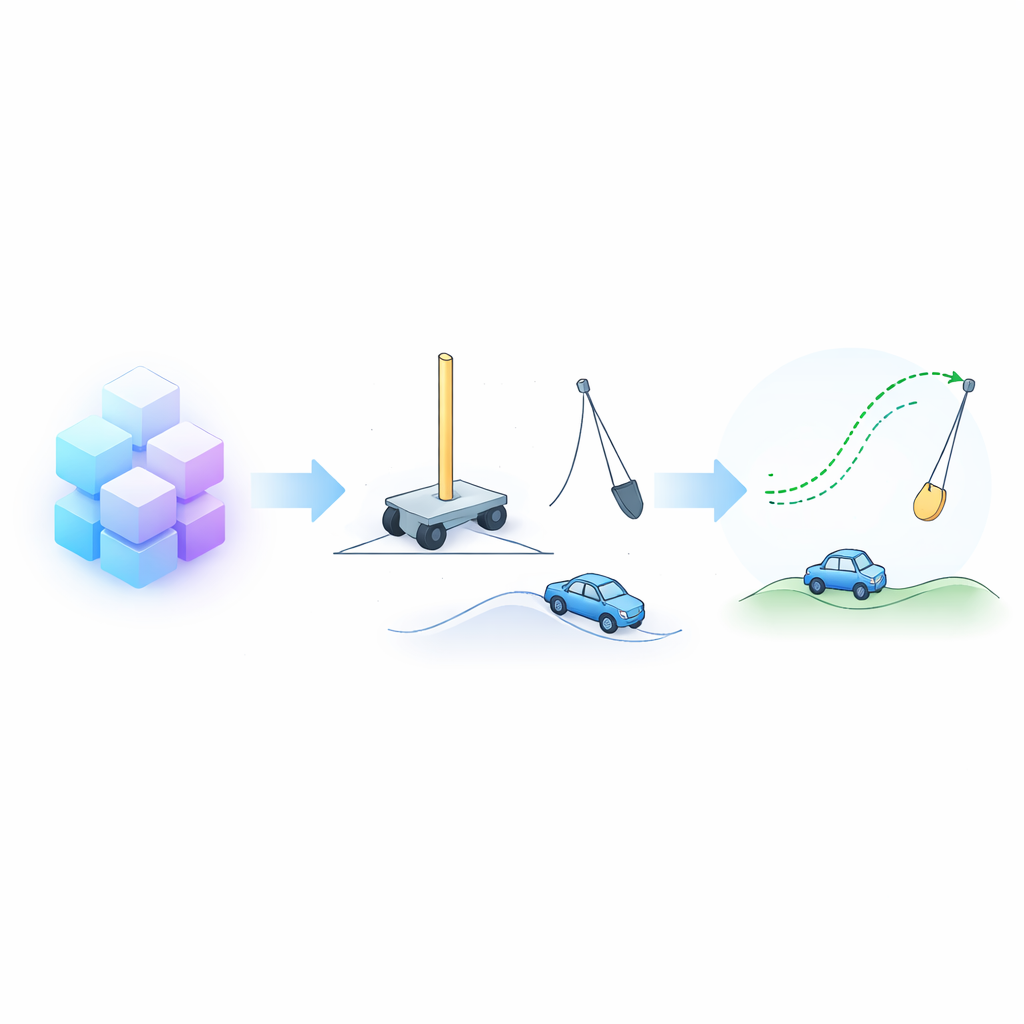

Wyobraź sobie robota, który uczy się utrzymywać równowagę drążka, zamachnąć się i wyprostować wahadłem albo wyjechać z kotliny — bez tego, by inżynierowie szczegółowo programowali każdy ruch albo zbierali tysiące przykładów demonstracji. W artykule badane jest, jak duże modele językowe (LLM) — te same systemy wykorzystywane w chatbotach — mogą zostać przekształcone w „mózgi” projektujące i udoskonalające strategie sterowania takimi ruchomymi maszynami, opierając się głównie na opisach tekstowych i odrobinie prób oraz błędów.

Z słów do ruchów

Tradycyjne sterowanie robotów często rozbija ruch na stałe bloki konstrukcyjne, takie jak zdefiniowane kroki chodu czy ruchy sięgania. Program wyższego poziomu wybiera i łączy te fragmenty. To działa w prostych sytuacjach, ale ma trudności tam, gdzie ruchy płynnie się łączą i wymagają precyzyjnego dopasowania w każdej chwili. Autorzy proszą zamiast tego LLM o stworzenie pełnych reguł sterowania, które bezpośrednio mapują dane z czujników robota — pozycję, prędkość, kąty itp. — na ciągłe sygnały do silników. Jedyną informacją początkową przekazaną modelowi jest opis w języku naturalnym budowy robota, jego czujników i napędów, otoczenia oraz celu, jaki ma osiągnąć.

Pętla refleksji i udoskonalania

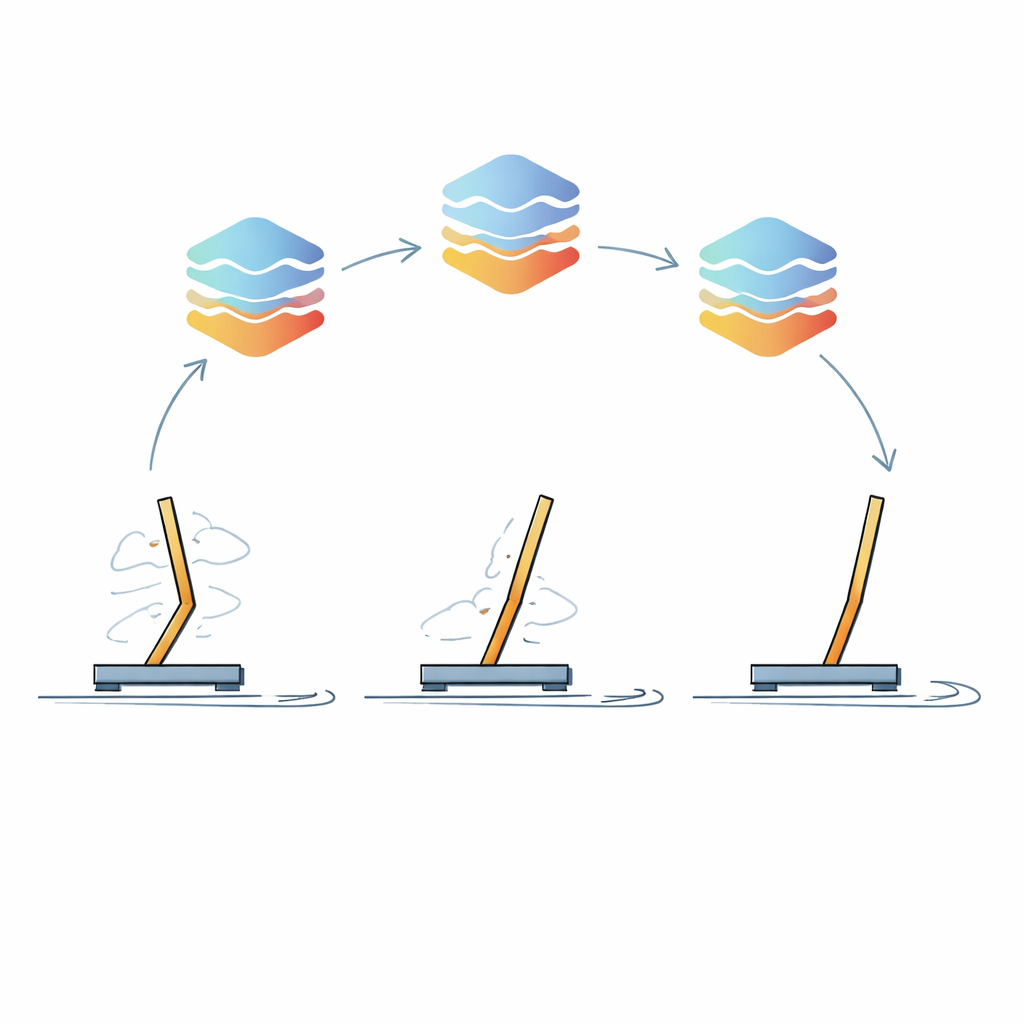

Rdzeniem podejścia jest iteracyjna pętla uczenia, którą autorzy nazywają Iterative Policy Refinement. W pierwszym kroku LLM jest nakłaniany do przemyślenia problemu etapami: najpierw szkicuje strategię wysokiego poziomu w prostym języku, następnie przekształca ją w jasne reguły w stylu IF–THEN–ELSE, a na koniec konwertuje te reguły do wykonalnego kodu. Początkowy kontroler uruchamiany jest w symulowanym środowisku — na przykład w układzie wózka z drążkiem, który trzeba utrzymać pionowo — i mierzy się jego działanie. Istotne jest to, że krótkie fragmenty odczytów czujników robota i odpowiadających im działań są następnie podawane z powrotem do LLM wraz ze streszczeniem skuteczności strategii. LLM proszony jest o analizę tych śladów, wskazanie słabych stron i wygenerowanie poprawionego kontrolera. Cykl ten powtarza się wielokrotnie, stopniowo dopracowując zachowanie.

Sprawdzenie pomysłu w praktyce

Aby ocenić skuteczność metody, badacze przetestowali ją na zestawie klasycznych zadań referencyjnych stosowanych w uczeniu przez wzmacnianie: utrzymanie równowagi w układzie wózek–drążek, zamachnięcie i ustabilizowanie wahadła, wjazd samochodem na stromą górę oraz zadanie acrobot, gdzie układ dwóch członów musi zostać zamachnięty do wymaganej wysokości. Zajęli się także odwróconym wahadłem z popularnego symulatora fizyki. Zadania te są na tyle proste, że można je szczegółowo badać, a jednocześnie odzwierciedlają kluczowe wyzwania: robot nie widzi wszystkiego naraz, nagrody pojawiają się z opóźnieniem, a dynamika może być wysoce niestabilna. Zespół porównał kilka nowoczesnych otwartych modeli językowych o rozmiarach rzędu 70–120 miliardów parametrów, zmieniał stopień losowości wyjść modelu i powtarzał każde doświadczenie wielokrotnie, by uzyskać wiarygodne statystyki.

Na ile dobrze modele językowe kontrolują maszyny?

Najlepiej radzący sobie model, system o 120 miliardach parametrów nazwany GPT-oss, konsekwentnie odkrywał wysokiej jakości strategie sterowania dla większości zadań, często osiągając wyniki optymalne lub bliskie optymalnym. Inny model, Qwen2.5, wypadł szczególnie dobrze w niektórych problemach, przewyższając GPT-oss w przypadku odwróconego wahadła, choć miał trudności w innych zadaniach, jak standardowe wahadło. Ważne jest, że początkowe kontrolery generowane przez LLM-y często były przeciętne, co pokazuje, że nie odtwarzały po prostu gotowych rozwiązań z danych treningowych. Wydajność poprawiała się znacząco wraz z iteracjami, gdy modele korzystały z informacji zwrotnej, by dostosować, które sygnały czujników są najważniejsze i w jaki sposób powinny wpływać na działania. Autorzy zbadali też, ile kroków czasowych danych z czujników dołączyć do każdego promptu poprawiającego i które elementy informacji zwrotnej są kluczowe, wykazując, że najlepsze wyniki daje umiarkowana ilość danych i szczegółowe informacje o poprzednich strategiach.

Dlaczego to ważne dla przyszłych robotów

Dla laika główny wniosek jest taki, że modele językowe potrafią znacznie więcej niż prowadzić rozmowy: mogą pomagać w projektowaniu precyzyjnych reguł ruchu, które sprawiają, że maszyny poruszają się inteligentnie. Zamiast zaczynać od losowych zachowań i potrzebować ogromnych ilości danych z prób i błędów, LLM może zaproponować rozsądny plan sterowania na podstawie opisu słownego, a następnie stopniowo go udoskonalać, analizując krótkie zapisy tego, co się stało podczas prób. To połączenie wiedzy uprzedniej i uczenia z doświadczenia może zmniejszyć koszty i wysiłek budowy zdolnych robotów i innych systemów autonomicznych. Oczywiście pozostają trudności — jak duże zapotrzebowanie obliczeniowe przy uruchamianiu dużych modeli oraz wyzwania związane ze skalowaniem do bardzo złożonych, długotrwałych zadań — ale badanie wskazuje ścieżkę ku robotom, których niskopoziomowe ruchy są kształtowane przynajmniej częściowo przez systemy pierwotnie trenowane po prostu do przewidywania następnego słowa w zdaniu.

Cytowanie: Carvalho, J.T., Nolfi, S. Sensory-motor control with large language models via iterative policy refinement. Sci Rep 16, 13575 (2026). https://doi.org/10.1038/s41598-026-42091-0

Słowa kluczowe: duże modele językowe, sterowanie robotem, uczenie przez wzmacnianie, agenci ucieleśnieni, iteracyjna poprawa polityki