Clear Sky Science · pt

Controle sensório-motor com grandes modelos de linguagem via refinamento iterativo de políticas

Ensinando Máquinas a Se Moverem Sozinhas

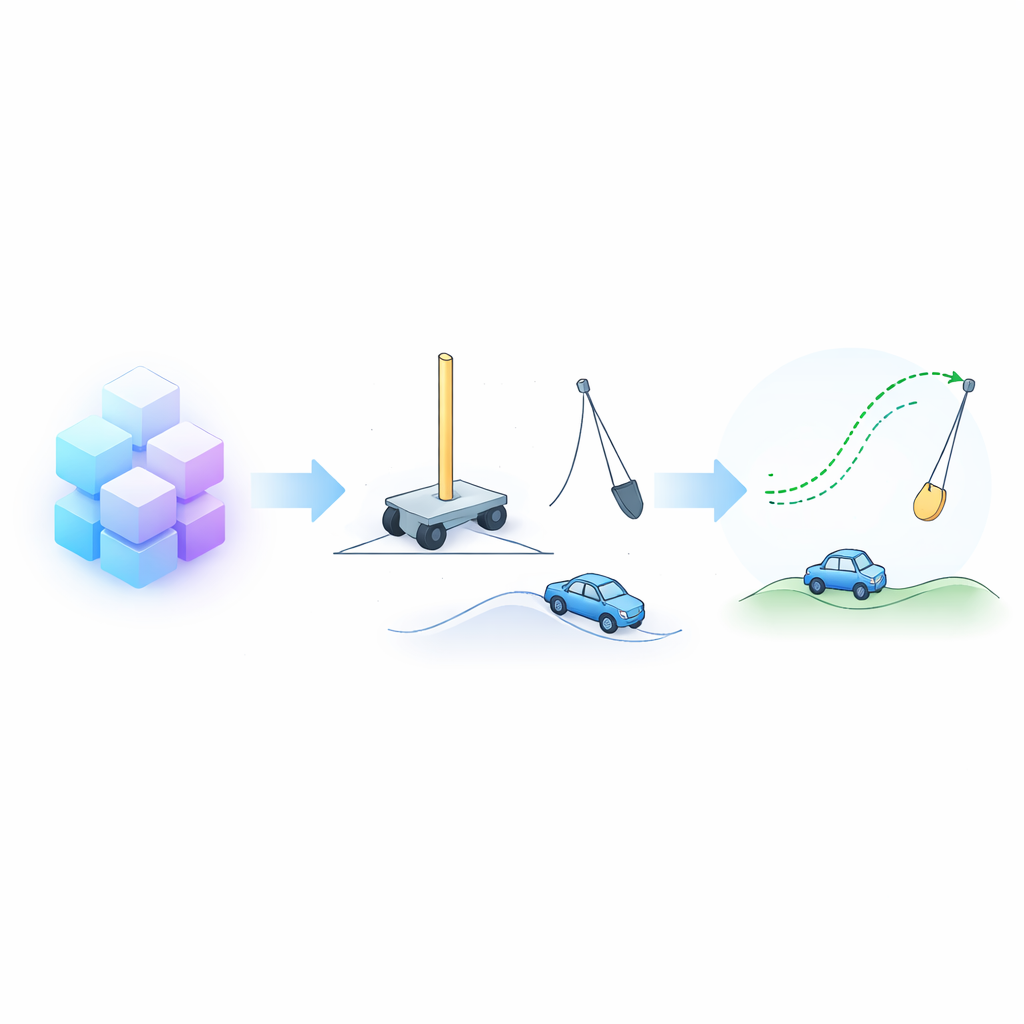

Imagine um robô que aprende a equilibrar um bastão, impulsionar um pêndulo para a posição vertical ou sair de um vale—sem engenheiros humanos programando meticulosamente cada pequeno movimento ou coletando milhares de demonstrações. Este artigo explora como grandes modelos de linguagem (LLMs)—o mesmo tipo de sistema usado em chatbots—podem ser transformados em "cérebros" que projetam e aprimoram estratégias de controle para máquinas em movimento, apoiando-se principalmente em descrições em texto e um pouco de tentativa e erro.

Das Palavras aos Movimentos

O controle robótico tradicional frequentemente divide o movimento em blocos fixos, como passos de caminhada pré-definidos ou movimentos de alcance. Um programa de nível superior então seleciona e sequencia esses pedaços. Embora isso funcione em cenários simples, tem dificuldade em situações mais fluidas, onde os movimentos se misturam e precisam ser ajustados finamente a cada instante. Os autores pedem, em vez disso, que os LLMs criem regras de controle completas que mapeiem diretamente o que o robô sente—sua posição, velocidade, ângulos e assim por diante—para comandos motores contínuos. A única informação inicial que o modelo recebe é uma descrição em linguagem natural do corpo do robô, seus sensores e atuadores, o ambiente ao redor e o que se espera que ele alcance.

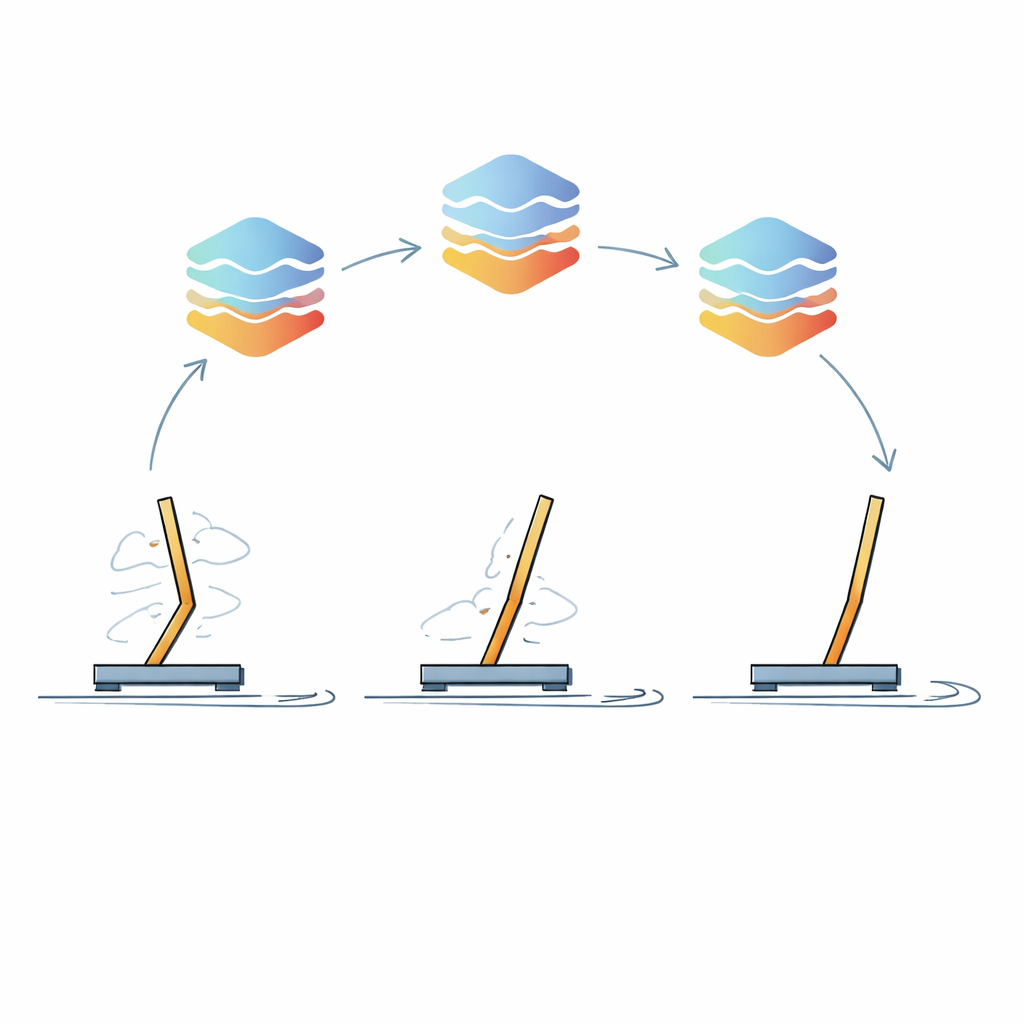

Um Ciclo de Reflexão e Refinamento

O cerne da abordagem é um laço de aprendizado iterativo que os autores chamam de Refinamento Iterativo de Políticas. No primeiro passo, o LLM é solicitado a pensar o problema em etapas: primeiro esboça uma estratégia de alto nível em linguagem natural, depois transforma isso em regras claras no estilo IF–THEN–ELSE e, finalmente, converte essas regras em código executável. Esse controlador inicial é executado dentro de um ambiente simulado—como um carrinho com um bastão que deve ser mantido em pé—e o desempenho do robô é medido. Crucialmente, trechos curtos das leituras sensoriais do robô e as ações correspondentes são então retornados ao LLM, juntamente com um resumo de quão bem a estratégia funcionou. Pede-se ao LLM que analise esses rastros, identifique pontos fracos e gere um controlador melhorado. Esse ciclo se repete muitas vezes, polindo gradualmente o comportamento.

Colocando a Ideia à Prova

Para verificar se esse método realmente funciona, os pesquisadores o testaram em um conjunto de tarefas clássicas de referência usadas em aprendizado por reforço: equilibrar um sistema carrinho–pêndulo, impulsionar e estabilizar um pêndulo, dirigir um carro morro acima íngreme e resolver uma tarefa acrobot onde um sistema de dois elos deve ser impulsionado até uma altura alvo. Eles também enfrentaram uma tarefa de pêndulo invertido em um simulador físico popular. Essas tarefas são simples o suficiente para serem estudadas em detalhe, mas ainda capturam desafios-chave: o robô não vê tudo de uma vez, as recompensas chegam com atraso e a física pode ser altamente instável. A equipe comparou vários modelos de linguagem modernos de código aberto com cerca de 70–120 bilhões de parâmetros, variou quanta aleatoriedade permitiam nas saídas do modelo e repetiu cada experimento várias vezes para obter estatísticas confiáveis.

Quão Bem Modelos de Linguagem Controlam Máquinas?

O modelo com melhor desempenho, um sistema de 120 bilhões de parâmetros chamado GPT-oss, descobriu de forma consistente estratégias de controle de alta qualidade na maioria das tarefas, frequentemente alcançando pontuações ótimas ou quase ótimas. Outro modelo, Qwen2.5, teve desempenho particularmente bom em alguns problemas, superando até o GPT-oss no pêndulo invertido, embora tenha apresentado dificuldades em outros, como a tarefa do pêndulo padrão. Importante notar que os primeiros controladores produzidos pelos LLMs costumavam ser medíocres, mostrando que não estavam apenas recordando soluções prontas dos dados de treinamento. O desempenho melhorou marcadamente ao longo das iterações, à medida que os modelos usavam o feedback para ajustar quais sinais de sensores eram mais relevantes e como eles deveriam influenciar as ações. Os autores também investigaram quantos passos de tempo de dados sensoriais incluir em cada prompt de refinamento e quais partes do feedback eram mais críticas, constatando que uma quantidade intermediária de dados e informações ricas sobre estratégias anteriores funcionaram melhor.

Por que Isso Importa para Robôs do Futuro

Para um não especialista, a conclusão principal é que modelos de linguagem podem fazer mais do que conversar: eles podem ajudar a projetar regras motoras finas que fazem máquinas se moverem de forma inteligente. Em vez de começar com comportamento aleatório e exigir enormes quantidades de dados de tentativa e erro, um LLM pode propor um plano de controle razoável a partir de uma descrição verbal e, em seguida, aprimorá‑lo continuamente lendo registros curtos do que aconteceu quando o robô o executou. Essa mistura de conhecimento prévio e aprendizado experiencial pode reduzir o custo e o esforço de construir robôs e outros sistemas autônomos capazes. Embora ainda existam obstáculos—como o grande poder computacional necessário para executar modelos volumosos e o desafio de escalar para tarefas muito complexas e de longa duração—o estudo sugere um caminho para robôs cujos movimentos de baixo nível sejam moldados, ao menos em parte, por sistemas originalmente treinados apenas para prever a próxima palavra em uma frase.

Citação: Carvalho, J.T., Nolfi, S. Sensory-motor control with large language models via iterative policy refinement. Sci Rep 16, 13575 (2026). https://doi.org/10.1038/s41598-026-42091-0

Palavras-chave: grandes modelos de linguagem, controle de robôs, aprendizado por reforço, agentes incorporados, refinamento iterativo de políticas