Clear Sky Science · nl

Sensorimotorische controle met grote taalmodellen via iteratieve beleidsverbetering

Machines leren zichzelf te bewegen

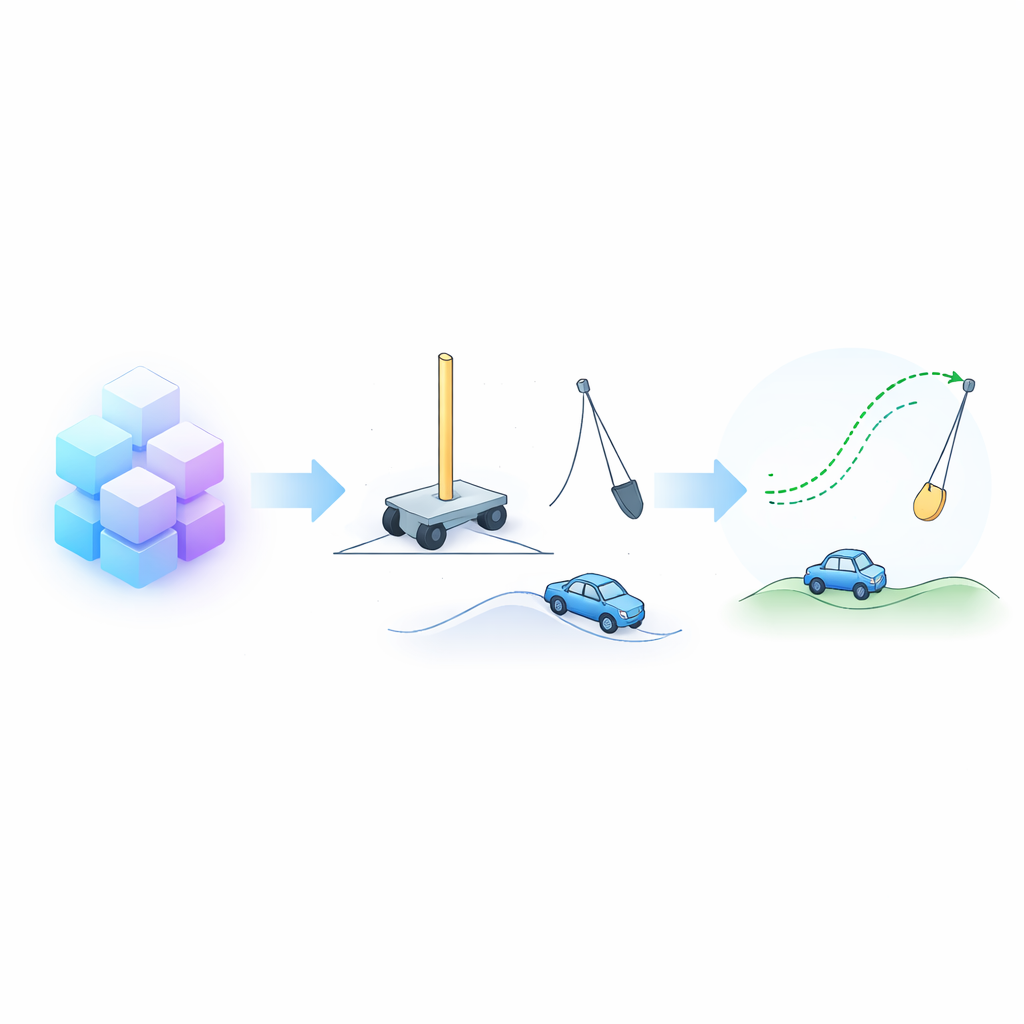

Stel je een robot voor die leert een paal in balans te houden, een slingerrechtop te brengen of uit een vallei te rijden—zonder dat menselijke ingenieurs elke beweging nauwgezet programmeren of duizenden voorbeelddemonstraties verzamelen. Dit artikel onderzoekt hoe grote taalmodellen (LLM’s)—dezelfde soort systemen die voor chatbots worden gebruikt—kunnen worden omgevormd tot "breinen" die besturingsstrategieën voor bewegende machines ontwerpen en verbeteren, grotendeels op basis van tekstuele beschrijvingen en wat proef-en-fout.

Van woorden naar bewegingen

Traditionele robotbesturing deelt beweging vaak op in vaste bouwstenen, zoals vooraf gedefinieerde stappen of reikbewegingen. Een hoger niveau programma kiest en rangschikt vervolgens deze onderdelen. Dat werkt in eenvoudige situaties, maar faalt in meer vloeiende omstandigheden waarin bewegingen in elkaar overvloeien en moment tot moment fijngestemd moeten worden. De auteurs vragen LLM’s daarom volledige controlevormen te maken die direct vertalen wat de robot waarneemt—positie, snelheid, hoeken, enzovoort—naar continue motorcommando’s. De enige begininformatie die het model krijgt is een natuurlijke-taalbeschrijving van het robotlichaam, zijn sensoren en motoren, de omgeving en het doel.

Een lus van reflectie en verfijning

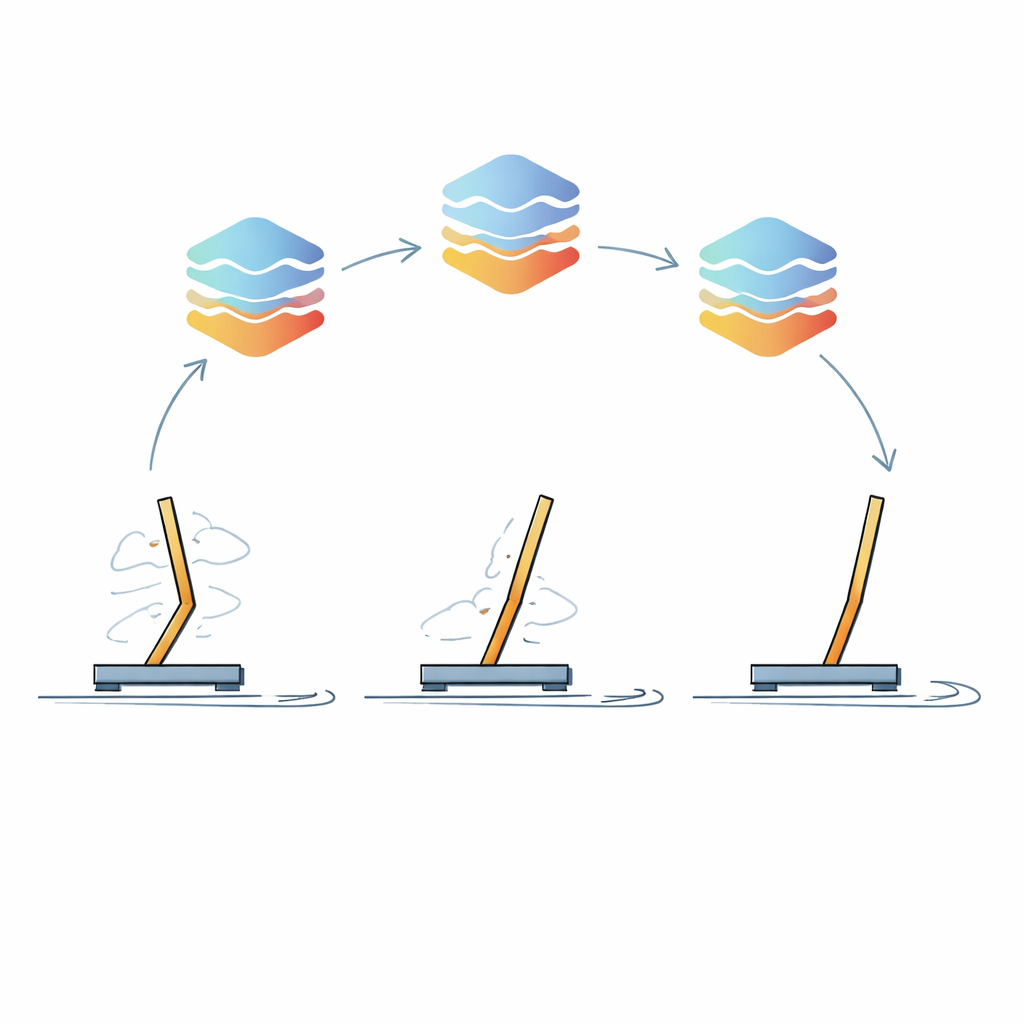

De kern van de aanpak is een iteratieve leerlus die de auteurs Iterative Policy Refinement noemen. In de eerste stap wordt het LLM geïnstrueerd het probleem in fasen te doordenken: eerst schetst het een strategie op hoog niveau in gewone taal, vervolgens zet het die om in heldere IF–THEN–ELSE-achtige regels en ten slotte converteert het die regels naar uitvoerbare code. Die initiële controller wordt uitgevoerd in een gesimuleerde omgeving—zoals een karretje met een paal die recht moet blijven—en de prestatie van de robot wordt gemeten. Cruciaal is dat korte fragmenten van de sensorgegevens en overeenkomstige acties van de robot teruggevoerd worden naar het LLM, samen met een samenvatting van hoe goed de strategie werkte. Het LLM wordt gevraagd deze traces te analyseren, zwaktes te herkennen en een verbeterde controller te genereren. Deze cyclus herhaalt zich vele malen, waarbij het gedrag geleidelijk wordt verfijnd.

Het idee op de proef gesteld

Om te controleren of deze methode echt werkt, probeerden de onderzoekers het op een reeks klassieke benchmarktaken uit het versterkend-leren-veld: het balanceren van een cart–pole-systeem, het slingeren en stabiliseren van een slinger, het besturen van een auto omhoog een steile heuvel en het oplossen van een acrobot-taak waarbij een twolinksysteem richting een doelhoogte moet worden gezwaaid. Ze namen ook een inverted-pendulum-taak uit een bekende fysicasimulator op. Deze taken zijn eenvoudig genoeg om gedetailleerd te bestuderen maar vangen toch belangrijke uitdagingen: de robot ziet niet alles tegelijk, beloningen komen met vertraging en de fysica kan erg instabiel zijn. Het team vergeleek meerdere moderne open-source taalmodellen van ongeveer 70–120 miljard parameters, varieerde hoeveel willekeur ze in de modeluitvoer toelieten en herhaalde elk experiment meerdere keren om betrouwbare statistieken te verkrijgen.

Hoe goed besturen taalmodellen machines?

Het best presterende model, een 120-miljard-parameter systeem genaamd GPT-oss, ontdekte consequent hoogwaardige besturingsstrategieën voor de meeste taken, en behaalde vaak optimale of bijna-optimale scores. Een ander model, Qwen2.5, deed het bijzonder goed op sommige problemen en overtrof GPT-oss zelfs op het inverted-pendulum, hoewel het op andere taken zoals de standaard slingerprobleem moeite had. Belangrijk is dat de eerste controllers die de LLM’s produceerden vaak middelmatig waren, wat aangeeft dat ze niet simpelweg vooraf opgeborgen oplossingen uit de trainingsdata opdoken. De prestatie verbeterde aanzienlijk over de iteraties terwijl de modellen feedback gebruikten om te bepalen welke sensorsignalen het belangrijkst waren en hoe die acties moesten beïnvloeden. De auteurs onderzochten ook hoeveel tijdstappen aan sensordata in elke verfijningsprompt opgenomen moesten worden en welke feedbackstukken het meest cruciaal waren, en vonden dat een middelmatige hoeveelheid data en rijke informatie over eerdere strategieën het beste werkte.

Waarom dit belangrijk is voor toekomstige robots

Voor niet-specialisten is de belangrijkste conclusie dat taalmodellen meer kunnen dan praten: ze kunnen helpen de fijnmazige motorregels te ontwerpen die machines intelligent laten bewegen. In plaats van te beginnen met willekeurig gedrag en enorme hoeveelheden proef-en-foutdata te vereisen, kan een LLM een redelijk controleplan voorstellen op basis van een verbale beschrijving en dat vervolgens stelselmatig verbeteren door korte verslagen te lezen van wat er gebeurde toen de robot het probeerde. Deze combinatie van voorkennis en ervaringsleren kan de kosten en inspanning verminderen om capabele robots en andere autonome systemen te bouwen. Er blijven echter hindernissen—zoals de zware rekenkracht die nodig is om grote modellen te draaien en de uitdaging om op te schalen naar zeer complexe, langdurige taken—maar de studie wijst op een route naar robots waarvan de laag-niveau bewegingen deels gevormd worden door systemen die oorspronkelijk alleen getraind waren om het volgende woord in een zin te voorspellen.

Bronvermelding: Carvalho, J.T., Nolfi, S. Sensory-motor control with large language models via iterative policy refinement. Sci Rep 16, 13575 (2026). https://doi.org/10.1038/s41598-026-42091-0

Trefwoorden: grote taalmodellen, robotbesturing, versterkend leren, belichaamde agenten, iteratieve beleidsverbetering