Clear Sky Science · de

Sensomotorische Steuerung mit großen Sprachmodellen durch iterative Politikverfeinerung

Maschinen beibringen, sich selbst zu bewegen

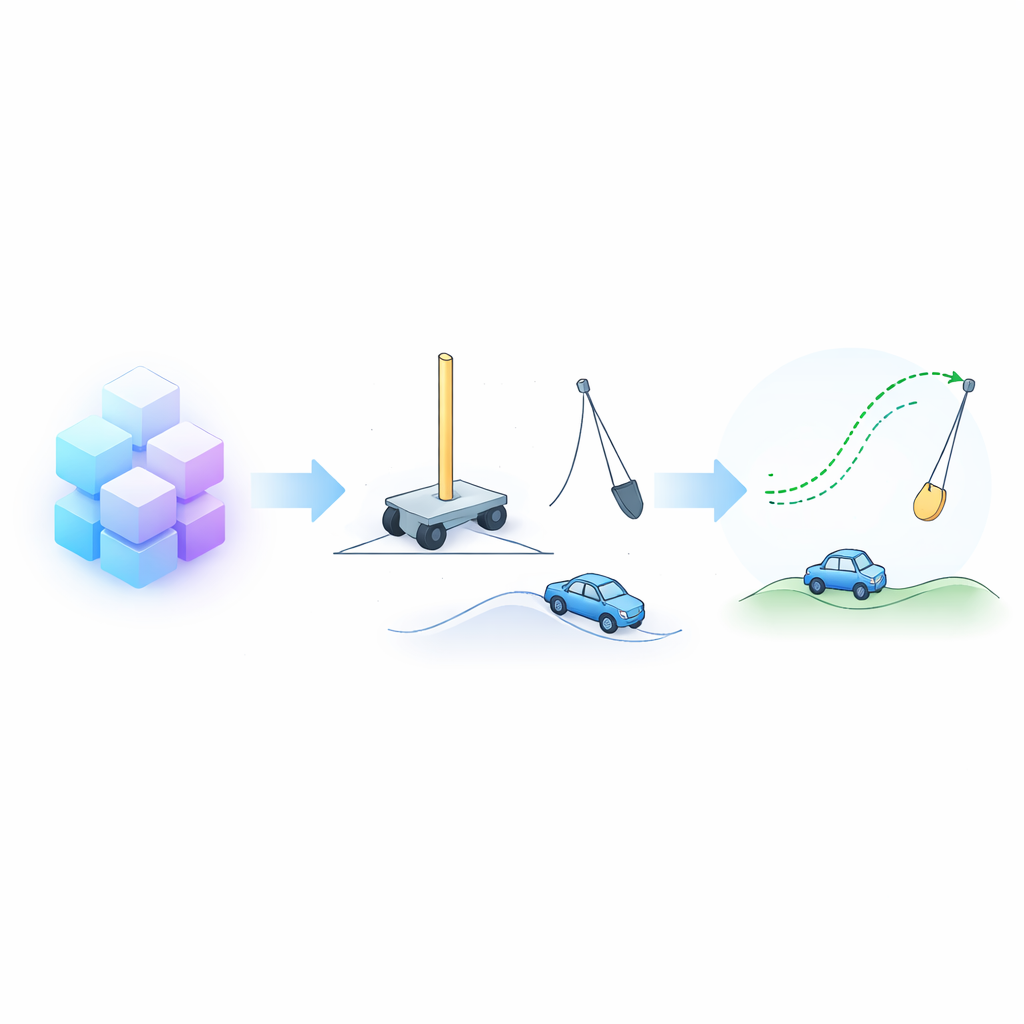

Stellen Sie sich einen Roboter vor, der lernt, eine Stange auszubalancieren, ein Pendel aufzuschwingen oder aus einem Tal herauszufahren—ohne dass Ingenieure jede einzelne Bewegung mühselig programmieren oder tausende Demonstrationen sammeln müssen. Dieses Paper untersucht, wie große Sprachmodelle (LLMs)—die selben Systeme, die für Chatbots verwendet werden—als "Gehirne" eingesetzt werden können, um Steuerungsstrategien für solche beweglichen Maschinen zu entwerfen und zu verbessern, wobei sie weitgehend auf Textbeschreibungen und etwas Versuch und Irrtum zurückgreifen.

Von Worten zu Bewegungen

Traditionelle Robotersteuerung zerlegt Bewegungen oft in feste Bausteine, wie vordefinierte Schritte beim Gehen oder Greifbewegungen. Ein höherstufiges Programm wählt dann diese Bausteine aus und setzt sie zusammen. Das funktioniert in einfachen Situationen, stößt jedoch an Grenzen, wenn Bewegungen ineinander übergehen und in jedem Moment fein abgestimmt werden müssen. Die Autoren lassen stattdessen LLMs vollständige Steuerungsregeln erstellen, die direkt das, was der Roboter wahrnimmt—Position, Geschwindigkeit, Winkel usw.—in kontinuierliche Motorbefehle übersetzen. Die einzige Ausgangsinformation, die das Modell erhält, ist eine natürlichsprachliche Beschreibung des Roboterkörpers, seiner Sensoren und Motoren, der Umgebung und des zu erreichenden Ziels.

Ein Kreislauf aus Reflexion und Verfeinerung

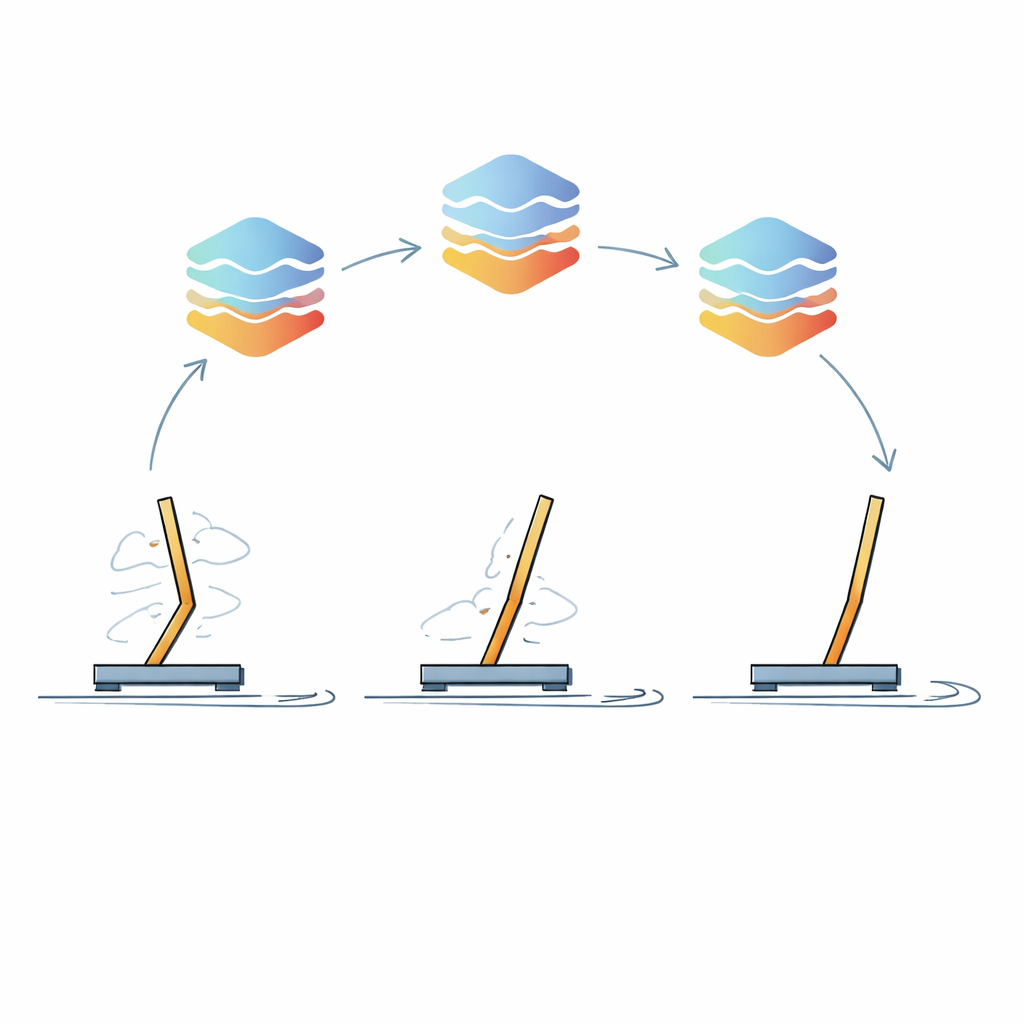

Kern des Ansatzes ist eine iterative Lernschleife, die die Autoren Iterative Policy Refinement nennen. Im ersten Schritt wird das LLM aufgefordert, das Problem schrittweise zu durchdenken: Es skizziert zunächst eine Strategie auf hoher Ebene in Klartext, formuliert diese dann als klare IF–THEN–ELSE–Regeln und wandelt diese schließlich in ausführbaren Code um. Der anfängliche Controller wird in einer simulierten Umgebung ausgeführt—etwa einem Wagen mit einer darauf stehenden Stange, die aufrecht gehalten werden muss—und die Leistung des Roboters wird gemessen. Entscheidend ist, dass kurze Ausschnitte aus den Sensormessungen des Roboters und den zugehörigen Aktionen zusammen mit einer Zusammenfassung, wie gut die Strategie funktionierte, an das LLM zurückgespeist werden. Das LLM soll diese Traces analysieren, Schwächen erkennen und einen verbesserten Controller erzeugen. Dieser Zyklus wiederholt sich viele Male und poliert das Verhalten schrittweise.

Die Idee in der Praxis prüfen

Um zu überprüfen, ob die Methode tatsächlich funktioniert, testeten die Forschenden sie an einer Reihe klassischer Benchmark-Aufgaben aus dem Verstärkungslernen: Ausbalancieren eines Wagen–Stange-Systems, Aufschwingen und Stabilisieren eines Pendels, Fahren eines Autos einen steilen Hang hinauf und Lösen einer Acrobot-Aufgabe, bei der ein zweigliedriges System auf eine Zielhöhe geschwungen werden muss. Sie behandelten außerdem eine invertierte Pendelaufgabe in einem verbreiteten Physiksimulator. Diese Aufgaben sind einfach genug, um sie detailliert zu untersuchen, fassen aber dennoch zentrale Herausforderungen zusammen: Der Roboter sieht nicht alles auf einmal, Belohnungen treten verzögert auf und die Physik kann hoch instabil sein. Das Team verglich mehrere moderne Open-Source-Sprachmodelle mit ungefähr 70–120 Milliarden Parametern, variierte, wie viel Zufälligkeit sie in den Modelloutputs zuließen, und wiederholte jede Experimentreihe mehrfach, um verlässliche Statistiken zu erhalten.

Wie gut steuern Sprachmodelle Maschinen?

Das am besten abschneidende Modell, ein 120‑Milliarden‑Parameter‑System namens GPT-oss, entdeckte beständig hochwertige Steuerungsstrategien in den meisten Aufgaben und erreichte oft optimale oder nahezu optimale Ergebnisse. Ein anderes Modell, Qwen2.5, zeigte in einigen Problemen besonders gute Leistungen und übertraf GPT-oss etwa bei der invertierten Pendelaufgabe, hatte aber in anderen Fällen, etwa beim Standardpendel, Schwierigkeiten. Wichtig ist, dass die ersten Controller, die die LLMs erzeugten, oft mittelmäßig waren—ein Hinweis darauf, dass sie nicht einfach vorgefertigte Lösungen aus Trainingsdaten abrufen. Die Leistung verbesserte sich deutlich über die Iterationen, als die Modelle Feedback nutzten, um zu entscheiden, welche Sensorsignale am wichtigsten sind und wie diese Aktionen beeinflussen sollten. Die Autoren untersuchten auch, wie viele Zeitschritte an Sensordaten in jeden Verfeinerungsprompt aufgenommen werden sollten und welche Feedbackbestandteile am kritischsten sind; sie fanden, dass eine mittlere Datenmenge und reichhaltige Informationen über frühere Strategien am besten wirkten.

Warum das für zukünftige Roboter wichtig ist

Für Nicht‑Spezialisten lautet die zentrale Erkenntnis: Sprachmodelle können mehr als nur reden—sie können dabei helfen, feingranulare Motorregeln zu entwerfen, die Maschinen intelligentes Bewegen ermöglichen. Anstatt mit zufälligem Verhalten zu beginnen und enorme Mengen an Trial‑and‑Error‑Daten zu benötigen, kann ein LLM aus einer verbalen Beschreibung einen vernünftigen Steuerungsplan vorschlagen und ihn dann durch das Lesen kurzer Protokolle dessen, was passiert ist, kontinuierlich verbessern. Diese Mischung aus Vorwissen und erfahrungsbasiertem Lernen könnte die Kosten und den Aufwand beim Aufbau leistungsfähiger Roboter und anderer autonomer Systeme verringern. Es bleiben zwar Hürden—etwa der hohe Rechenaufwand für große Modelle und die Herausforderung, auf sehr komplexe, lang andauernde Aufgaben zu skalieren—doch die Studie weist einen Weg zu Robotern, deren niedrigstufige Bewegungen zumindest teilweise von Systemen gestaltet werden, die ursprünglich lediglich darauf trainiert wurden, das nächste Wort in einem Satz vorherzusagen.

Zitation: Carvalho, J.T., Nolfi, S. Sensory-motor control with large language models via iterative policy refinement. Sci Rep 16, 13575 (2026). https://doi.org/10.1038/s41598-026-42091-0

Schlüsselwörter: große Sprachmodelle, Robotersteuerung, Verstärkungslernen, verkörperte Agenten, iterative Politikverfeinerung