Clear Sky Science · ar

التحكم الحسي-الحركي باستخدام نماذج اللغة الكبيرة عبر تنقيح السياسة التكراري

تعليم الآلات على الحركة ذاتياً

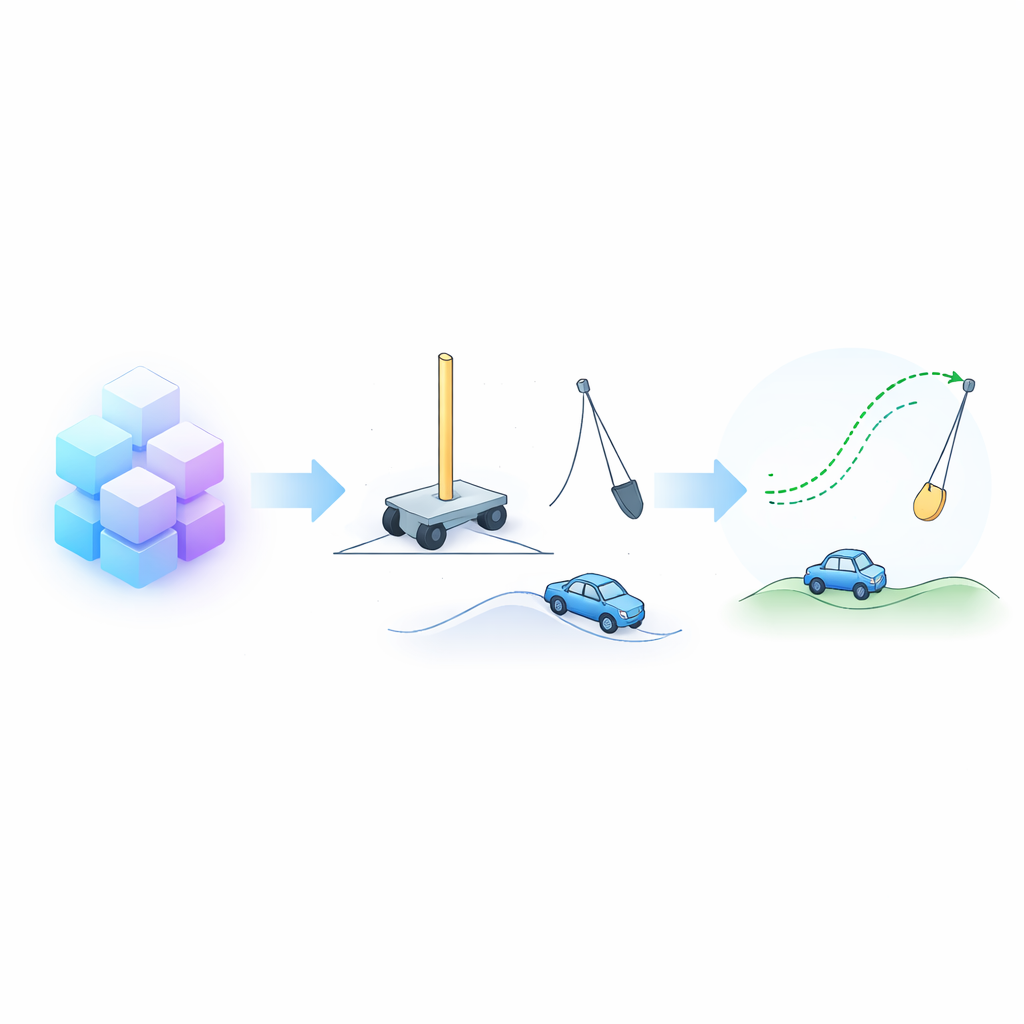

تخيل روبوتًا يتعلَّم الحفاظ على عمود متوازن، أو رفع بندول إلى وضع رأسي، أو الخروج من وادٍ—دون أن يبرمِج مهندسو البشر كل حركة بعناية أو يجمعوا آلاف الأمثلة التدريبية. تستكشف هذه الورقة كيف يمكن تحويل نماذج اللغة الكبيرة (LLMs)—نفس نوع الأنظمة المستخدمة في الدردشة—إلى «عقول» تصمم وتحسّن استراتيجيات التحكم لتلك الآلات المتحرِّكة، اعتمادًا بشكل كبير على أوصاف نصية وقليل من المحاولة والخطأ.

من الكلمات إلى الحركات

عادةً ما يكسر التحكم الروبوتي التقليدي الحركة إلى لبنات ثابتة، مثل خطوات مشي محددة مسبقًا أو حركات امتداد. ثم يختار برنامج على مستوى أعلى هذه الأشياء وينسقها. بينما ينجح هذا في إعدادات بسيطة، فإنه يواجه صعوبة في مواقف أكثر سيولة حيث تندمج الحركات وتحتاج إلى ضبط دقيق لحظة بلحظة. يسأل المؤلفون بدلًا من ذلك نماذج اللغة عن إنشاء قواعد تحكم كاملة تربط مباشرة بين ما يستشعره الروبوت—موقعه، سرعته، زواياه، وما إلى ذلك—وأوامر المحركات المستمرة. المعلومات الابتدائية الوحيدة التي يتلقاها النموذج هي وصف باللغة الطبيعية لجسم الروبوت، وحساساته ومحركاته، والبيئة المحيطة، وما يُفترض أن يحققه.

حلقة من التأمل والتنقيح

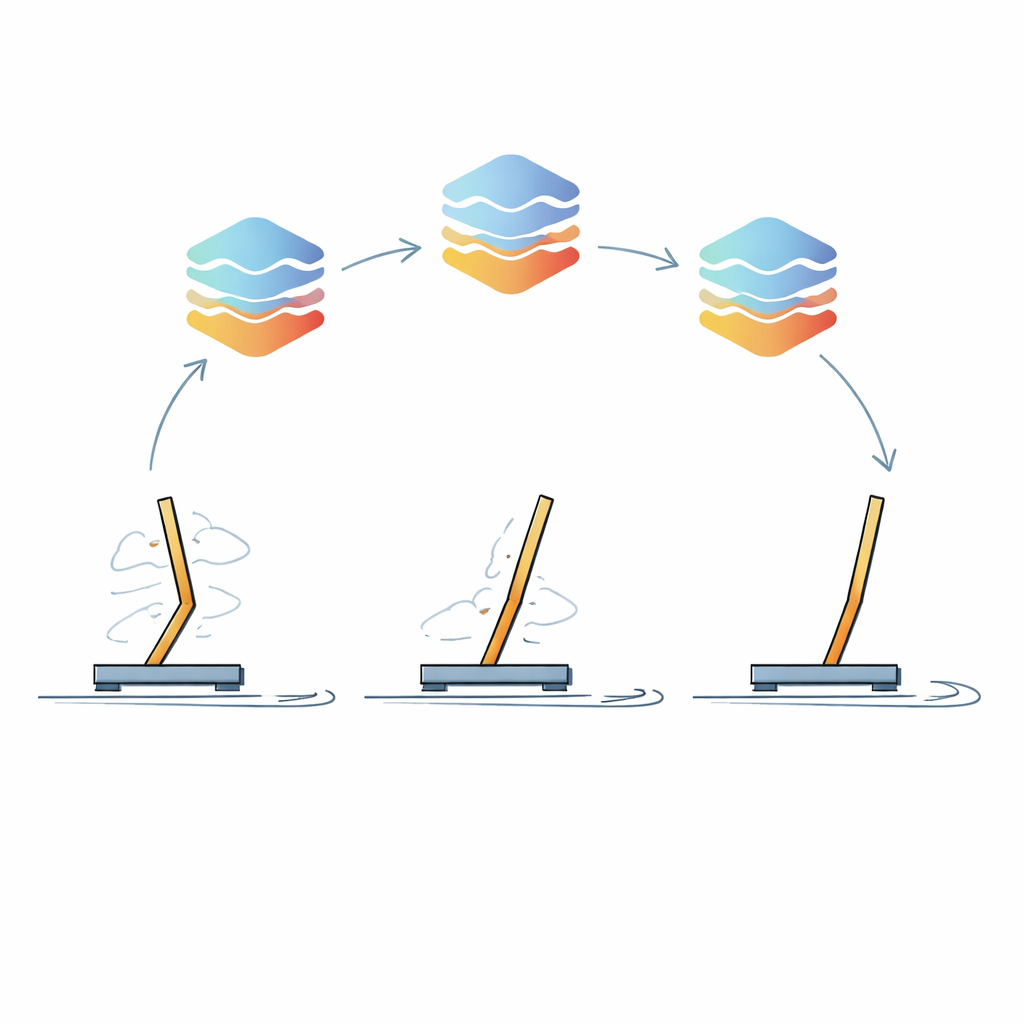

جوهر النهج هو حلقة تعلم تكرارية يسميها المؤلفون تنقيح السياسة التكراري. في الخطوة الأولى، يُحث النموذج على التفكير في المشكلة على مراحل: يوضّح أولًا استراتيجية عالية المستوى بلغة واضحة، ثم يحولها إلى قواعد بصيغة IF–THEN–ELSE، وأخيرًا يحوّل تلك القواعد إلى شفرة قابلة للتنفيذ. يُشغّل هذا المتحكم الأولي داخل بيئة محاكاة—مثل عربة ذات عمود يجب إبقاؤه منتصِبًا—وتُقيَّم أداء الروبوت. والأهم من ذلك، تُعاد إلى نموذج اللغة مقتطفات قصيرة من قراءات الحساسات والأفعال المقابلة، إلى جانب ملخص عن مدى نجاح الاستراتيجية. يُطلب من النموذج تحليل هذه الآثار، وبيان نقاط الضعف، وتوليد متحكم محسن. تتكرر هذه الدورة مرات عديدة، مُصقِلة السلوك تدريجيًا.

وضع الفكرة قيد الاختبار

للتأكد من جدوى هذه الطريقة، جرّب الباحثون تنفيذها على مجموعة من المهام القياسية المستخدمة في التعلم المعزز: موازنة نظام عربة-عمود، التأرجح واستقرار بندول، قيادة سيارة صعودًا على تلّ شديد الانحدار، وحل مهمة acrobot حيث يجب تأرجح نظام ذي رابطين إلى ارتفاع مستهدف. تعامَلوا أيضًا مع مهمة البندول المقلوب من محاكي فيزياء شائع. هذه المهام بسيطة بما يكفي للدراسة بالتفصيل لكنها تلتقط تحديات رئيسية: فالروبوت لا يرى كل شيء دفعة واحدة، والمكافآت قد تأتي بتأخير، والفيزياء قد تكون متقلبة للغاية. قارن الفريق عدة نماذج لغة مفتوحة المصدر حديثة بحجم تقريبًا 70–120 مليار معامل، وغيّروا مقدار العشوائية في مخرجات النموذج، وكرّروا كل تجربة عدة مرات للحصول على إحصاءات موثوقة.

إلى أي مدى تسيطر نماذج اللغة على الآلات؟

النموذج الأفضل أداءً، نظام بواقع 120 مليار معامل أُطلِق عليه اسم GPT-oss، اكتشف باستمرار استراتيجيات تحكم عالية الجودة عبر معظم المهام، وغالبًا ما بلغ درجات مثلى أو قريبة من المثلى. أظهر نموذج آخر، Qwen2.5، أداءً متميزًا في بعض المشكلات، متفوقًا حتى على GPT-oss في مهمة البندول المقلوب، رغم أنه واجه صعوبات في مهام أخرى مثل بندول القياسي. ومن المهم أن المتحكمات الأولى التي أنتجتها نماذج اللغة كانت غالبًا متوسطة، مما يشير إلى أنها لم تكن تسترجع حلولًا جاهزة من بيانات التدريب فقط. تحسّن الأداء بشكل ملحوظ عبر التكرارات بينما استخدمت النماذج الملاحظات لتعديل أي إشارات حسّية كانت الأكثر أهمية وكيف ينبغي أن تؤثر في الأفعال. استقصى المؤلفون أيضًا عدد خطوات الزمن من بيانات الحساسات التي يجب إدراجها في كل موجه لتنقيح وما هي قطع الملاحظات الأكثر حرجًا، فوجدوا أن كمية متوسطة من البيانات ومعلومات غنية عن الاستراتيجيات السابقة كانت الأفضل.

لماذا يهم هذا للروبوتات المستقبلية

لغير المتخصص، الخلاصة الرئيسية هي أن نماذج اللغة قادرة على أكثر من الكلام: فهي يمكن أن تساعد في تصميم قواعد المحرك الدقيقة التي تجعل الآلات تتحرَّك بذكاء. بدلًا من البدء بسلوك عشوائي والاعتماد على كميات هائلة من بيانات المحاولة والخطأ، يمكن لنموذج لغة أن يقترح خطة تحكم معقولة من وصف لفظي، ثم يحسّنها تدريجيًا بقراءة سجلات قصيرة لما حدث عند تجربة الروبوت لها. قد يقلل هذا المزيج من المعرفة المسبقة والتعلّم من الخبرة تكلفة وجهد بناء روبوتات وأنظمة مستقلة قادرة. وبينما لا تزال هناك معوقات—مثل الحساب الثقيل المطلوب لتشغيل النماذج الكبيرة وتحدي التدرج إلى مهام معقدة وطويلة الأمد—تقترح الدراسة مسارًا نحو روبوتات تُشكَّل حركاتها منخفضة المستوى، جزئيًا على الأقل، بواسطة أنظمة تدرّبت أصلاً ببساطة على التنبؤ بالكلمة التالية في جملة.

الاستشهاد: Carvalho, J.T., Nolfi, S. Sensory-motor control with large language models via iterative policy refinement. Sci Rep 16, 13575 (2026). https://doi.org/10.1038/s41598-026-42091-0

الكلمات المفتاحية: نماذج اللغة الكبيرة, التحكم بالروبوت, التعلم المعزز, وكلاء مجسَّدون, تنقيح السياسة التكراري