Clear Sky Science · ja

反復的方策改良による大規模言語モデルを用いた感覚運動制御

機械に自律的に動くことを教える

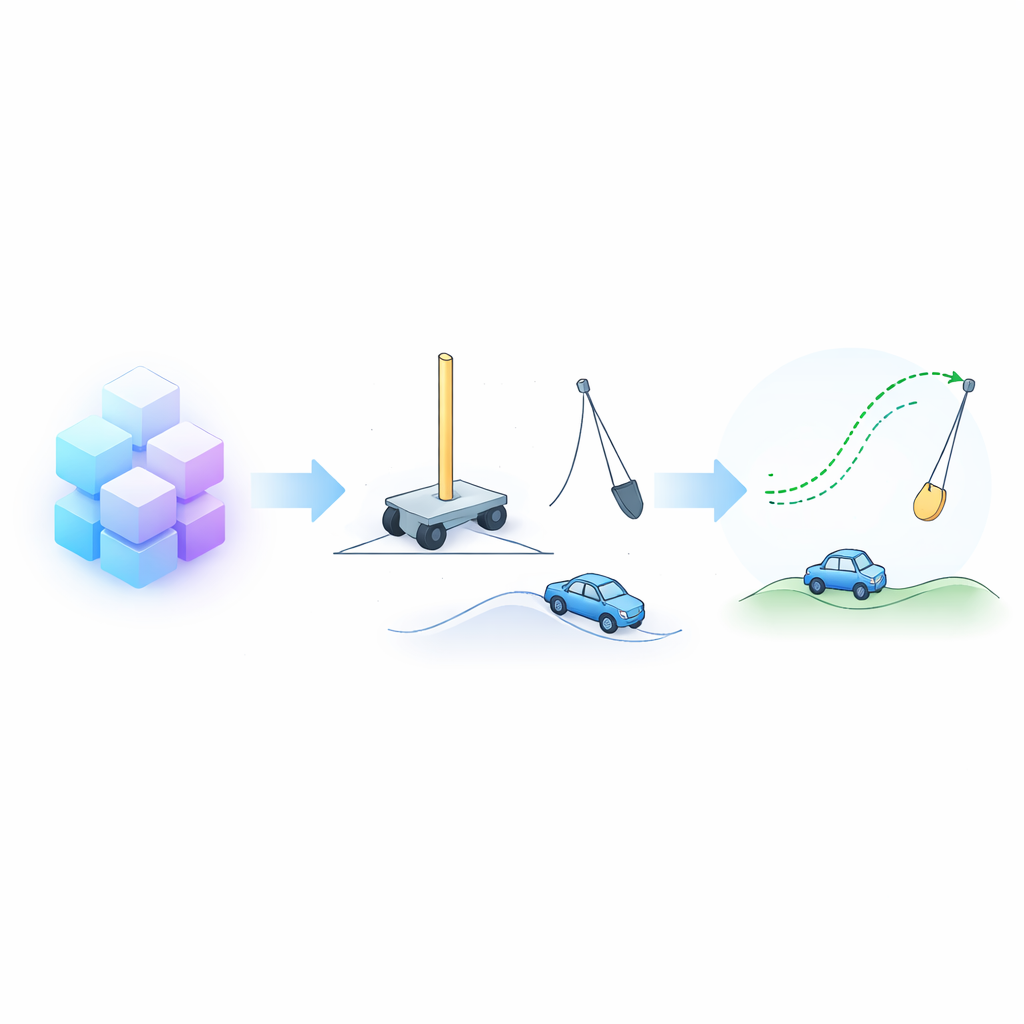

棒を立てて保持したり、振り子を振り上げたり、谷間から脱出して走り出したりするようなロボットを想像してください。人間の技術者がすべての動きを手作業で細かくプログラムしたり、何千ものデモを集めたりすることなく学習するロボットです。本稿は、チャットボットなどに使われるのと同じ種類の大規模言語モデル(LLM)を、「脳」として用い、主にテキスト記述とある程度の試行誤錯に基づいて、そのような動く機械の制御戦略を設計・改善させる方法を探ります。

言葉から動作へ

従来のロボット制御は、事前定義された歩行ステップや到達動作のような固定的なビルディングブロックに動きを分解し、それを上位プログラムが選択・配列することが多いです。これらは単純な環境では機能しますが、動作が連続的に混ざり合い、瞬間ごとに細かく調整が必要な流動的な状況では苦戦します。本研究の著者らは、代わりにLLMにロボットが感知する位置、速度、角度などの情報を直接連続値のモーター指令に写像する完全な制御規則を作らせることを試みます。モデルに与えられる初期情報は、ロボットの身体、センサーとモーター、周囲の環境、達成すべき目的を自然言語で記述したものだけです。

省察と改良のループ

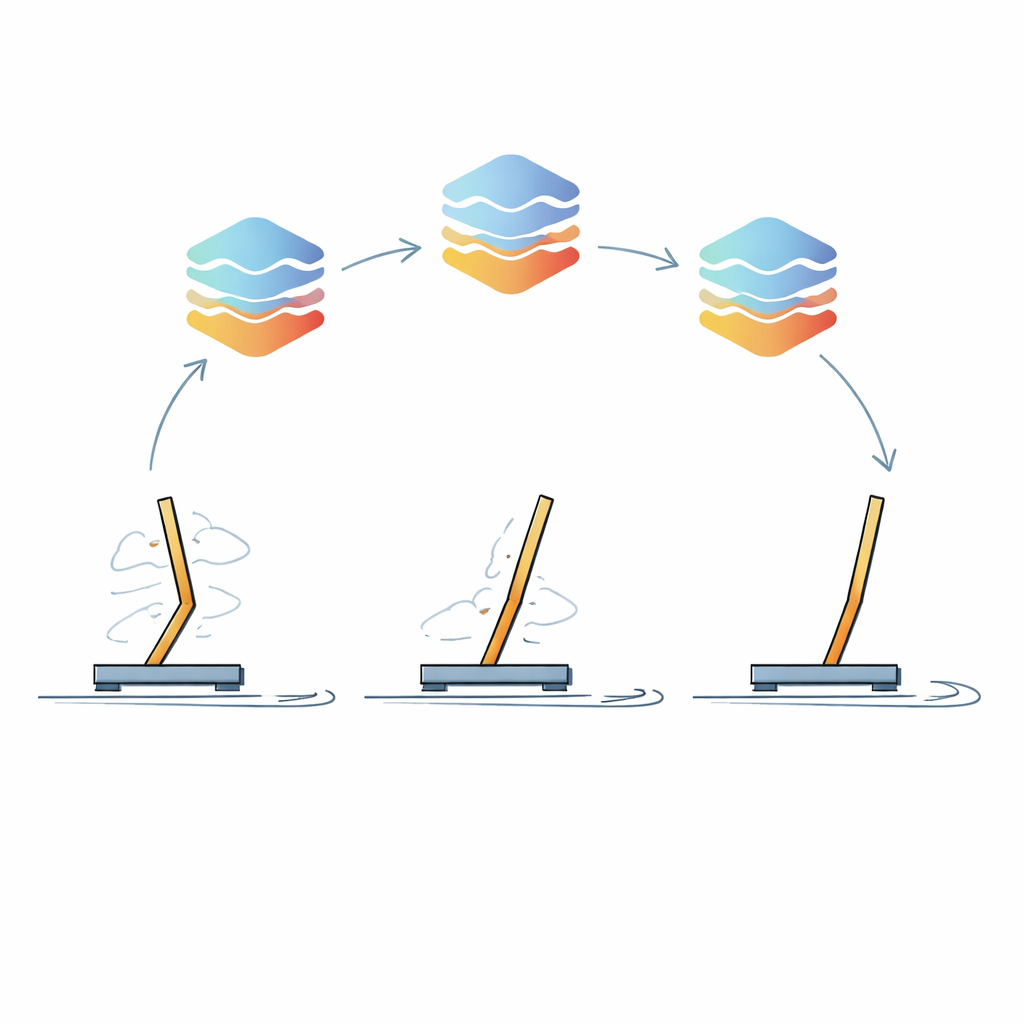

手法の核心は著者らが「反復的方策改良」と呼ぶ学習ループです。最初の段階では、LLMに問題を段階的に考えさせます:まず平易な言葉で高レベルの戦略を概説させ、それをIF–THEN–ELSE形式の明確な規則に変換し、最後にそれらの規則を実行可能なコードに変換します。初期のコントローラは、立てて保持すべき棒が載ったカートのようなシミュレーション環境内で実行され、ロボットの性能が測定されます。重要なのは、ロボットの短いセンサー読み取り値と対応する行動の断片が、戦略の有効性を示す要約とともにLLMにフィードバックされる点です。LLMはこれらのトレースを分析し、弱点を見つけ、改良されたコントローラを生成するよう求められます。このサイクルを何度も繰り返すことで、動作が徐々に磨かれていきます。

アイデアの実証

この手法が実際に機能するかを検証するため、研究者たちは強化学習で使われる古典的なベンチマーク課題群で試しました:カート=ポールの平衡、振り子の振り上げと安定化、急な坂を登る車の操作、二節系を目標高さまで振り上げるアクロボット課題などです。さらに、人気のある物理シミュレータからの逆転振り子課題にも取り組みました。これらの課題は詳細に調べるのに十分単純でありながら重要な課題を含んでいます:ロボットは全てを同時に観測できず、報酬は遅れて与えられ、物理は非常に不安定になり得ます。チームは約70〜1200億パラメータの複数の現代的なオープンソース言語モデルを比較し、モデル出力にどれだけのランダム性を許すかを変え、各実験を複数回繰り返して信頼できる統計を得ました。

言語モデルはどれほど機械を制御できるか?

最も成績の良かったモデルはGPT-ossと呼ばれる1200億パラメータのシステムで、多くの課題で一貫して高品質な制御戦略を発見し、しばしば最適またはそれに近いスコアに到達しました。別のモデルQwen2.5は一部の問題で特に良好な性能を示し、逆転振り子ではGPT-ossを上回った一方で、標準的な振り子課題では苦戦しました。重要なのは、LLMが最初に生成したコントローラはしばしば平凡であり、訓練データから既成の解を単に再現しているわけではないことを示している点です。モデルはフィードバックを用いてどのセンサー信号が重要か、またそれらが行動にどのように影響すべきかを調整することで、反復を重ねるごとに性能を大きく改善しました。著者らは各改良プロンプトに含めるセンサーデータのタイムステップ数や、どの種類のフィードバックが最も重要かも調べ、中程度の量のデータと過去の戦略に関する豊富な情報が最も効果的であることを見出しました。

将来のロボットにとっての意義

非専門家向けの主要な結論は、言語モデルは単に会話する以上のことができる、ということです:機械を知的に動かすための微細な運動規則の設計を助け得ます。ランダムな振る舞いから始めて大量の試行誤錯データを必要とする代わりに、LLMは口頭の説明から妥当な制御計画を提案し、ロボットが試したときに何が起きたかの短い記録を読み取ることでそれを着実に改善できます。この事前知識と経験的学習の組み合わせは、有能なロボットや他の自律システムを構築する際のコストと労力を削減する可能性があります。依然として課題は残ります──大規模モデルを実行するための大きな計算コストや、非常に複雑で長時間にわたるタスクへのスケールの難しさなど──が、本研究は、少なくとも部分的には、元来「次の単語を予測する」ことを目的に訓練されたシステムによって低レベルの動作が形作られる道筋を示唆しています。

引用: Carvalho, J.T., Nolfi, S. Sensory-motor control with large language models via iterative policy refinement. Sci Rep 16, 13575 (2026). https://doi.org/10.1038/s41598-026-42091-0

キーワード: 大規模言語モデル, ロボット制御, 強化学習, 具現化エージェント, 反復的方策改良