Clear Sky Science · es

Control sensoriomotor con grandes modelos de lenguaje mediante refinamiento iterativo de políticas

Enseñar a las máquinas a moverse por sí mismas

Imagínese un robot que aprende a equilibrar una barra, impulsar un péndulo hasta dejarlo en vertical o salir conduciendo de un valle, sin que ingenieros humanos programen minuciosamente cada pequeño movimiento ni recopilen miles de demostraciones. Este artículo explora cómo los grandes modelos de lenguaje (LLM), el mismo tipo de sistemas utilizados en chatbots, pueden convertirse en "cerebros" que diseñan y mejoran estrategias de control para máquinas en movimiento, apoyándose en gran medida en descripciones en texto y un poco de prueba y error.

De las palabras a los movimientos

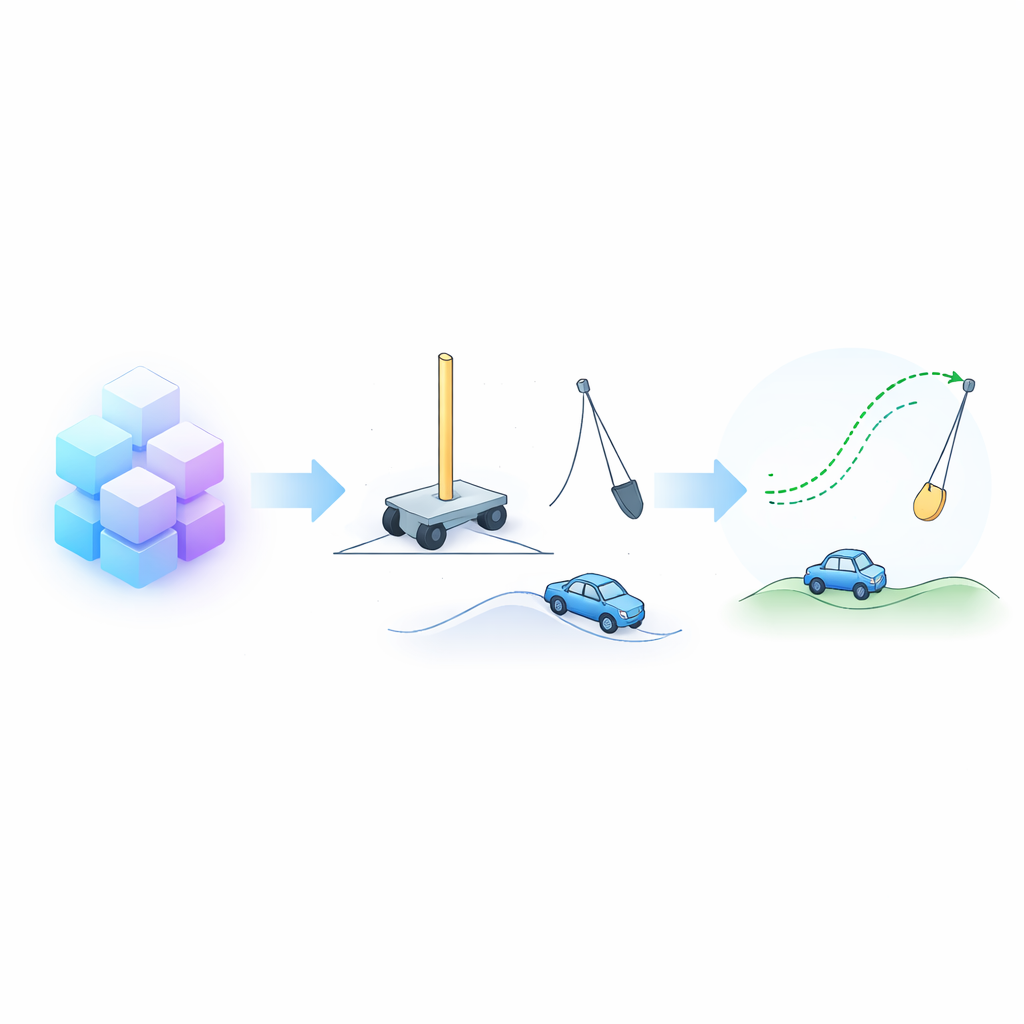

El control robótico tradicional suele descomponer el movimiento en bloques fijos, como pasos de marcha predefinidos o movimientos de alcance. Un programa de alto nivel selecciona y encadena luego esos elementos. Aunque esto funciona en entornos simples, falla en situaciones más fluidas donde los movimientos se funden y deben ajustarse finamente momento a momento. Los autores piden en cambio a los LLM que creen reglas de control completas que mapeen directamente lo que el robot percibe—su posición, velocidad, ángulos, etc.—a comandos motores continuos. La única información inicial que recibe el modelo es una descripción en lenguaje natural del cuerpo del robot, sus sensores y motores, el entorno circundante y el objetivo que debe alcanzar.

Un bucle de reflexión y refinamiento

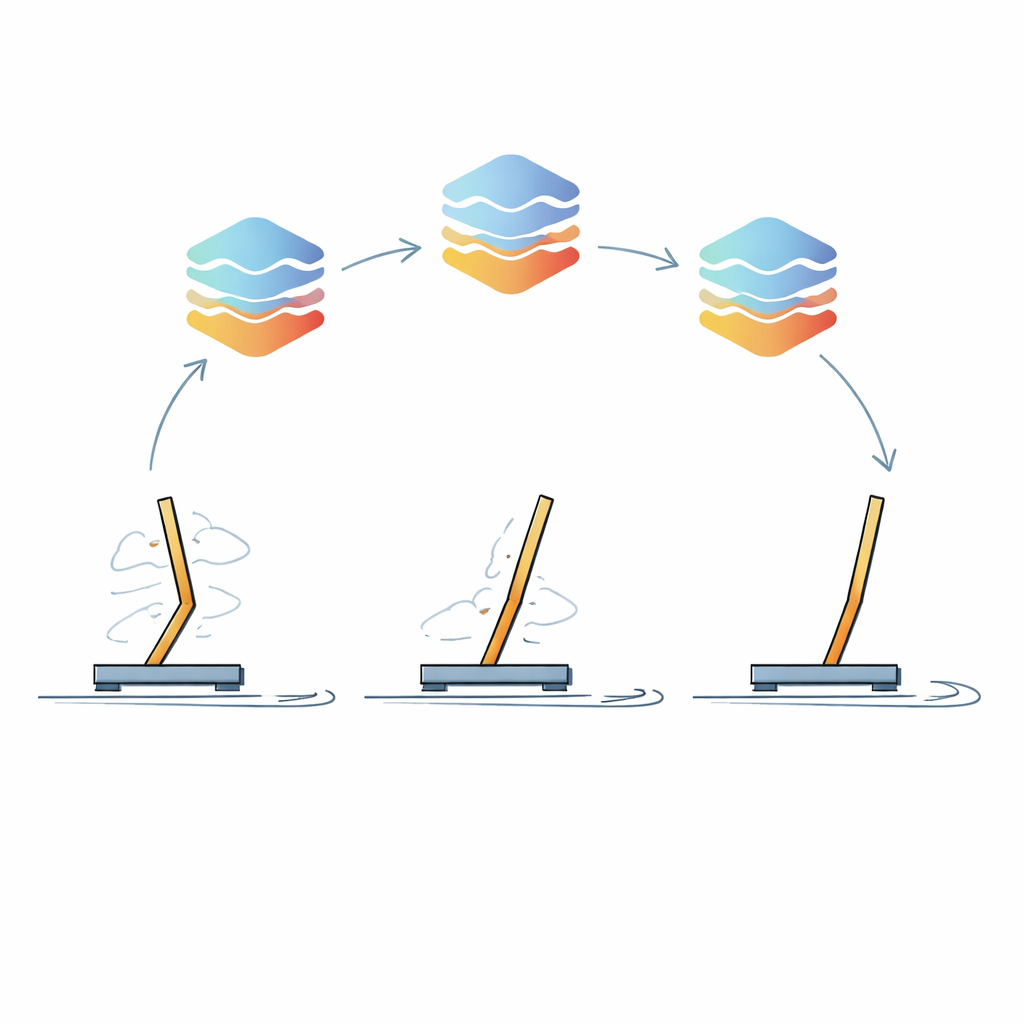

El núcleo del enfoque es un bucle de aprendizaje iterativo que los autores llaman Refinamiento Iterativo de Políticas. En el primer paso, se solicita al LLM que piense el problema por etapas: primero bosqueja una estrategia de alto nivel en lenguaje sencillo, luego la convierte en reglas claras de estilo SI–ENTONCES–SINO, y finalmente transforma esas reglas en código ejecutable. Ese controlador inicial se ejecuta dentro de un entorno simulado—por ejemplo, un carrito con una barra que debe mantenerse en vertical—y se mide el desempeño del robot. De forma crucial, breves fragmentos de las lecturas sensoriales del robot y las acciones correspondientes se retroalimentan al LLM, junto con un resumen de qué tan bien funcionó la estrategia. Se le pide al LLM que analice esos trazos, detecte debilidades y genere un controlador mejorado. Este ciclo se repite muchas veces, puliendo gradualmente el comportamiento.

Poner la idea a prueba

Para verificar si este método realmente funciona, los investigadores lo probaron en un conjunto de tareas clásicas de referencia usadas en aprendizaje por refuerzo: equilibrar un sistema carrito–barra, impulsar y estabilizar un péndulo, conducir un coche por una colina empinada y resolver una tarea de acrobot donde un sistema de dos eslabones debe impulsarse hasta una altura objetivo. También abordaron una tarea de péndulo invertido en un popular simulador de física. Estas tareas son lo bastante simples como para estudiarlas en detalle pero aún capturan desafíos clave: el robot no lo ve todo a la vez, las recompensas llegan con retraso y la física puede ser muy inestable. El equipo comparó varios modelos de lenguaje de código abierto modernos de aproximadamente 70–120 mil millones de parámetros, varió cuánta aleatoriedad permitían en las salidas del modelo y repitió cada experimento múltiples veces para obtener estadísticas fiables.

¿Qué tan bien controlan las máquinas los modelos de lenguaje?

El modelo de mejor rendimiento, un sistema de 120 mil millones de parámetros llamado GPT-oss, descubrió de forma consistente estrategias de control de alta calidad en la mayoría de las tareas, alcanzando a menudo puntuaciones óptimas o cercanas a lo óptimo. Otro modelo, Qwen2.5, se comportó particularmente bien en algunos problemas, incluso superando a GPT-oss en el péndulo invertido, aunque tuvo dificultades en otros como la tarea del péndulo estándar. Es importante destacar que los primeros controladores que producían los LLM solían ser mediocre, lo que muestra que no estaban simplemente recordando soluciones prefabricadas del conjunto de entrenamiento. El rendimiento mejoró notablemente con las iteraciones a medida que los modelos usaban la retroalimentación para ajustar qué señales de los sensores importaban más y cómo debían influir en las acciones. Los autores también investigaron cuántos pasos temporales de datos sensoriales incluir en cada indicación de refinamiento y qué piezas de retroalimentación eran más críticas, encontrando que una cantidad intermedia de datos y una información rica sobre las estrategias previas funcionaban mejor.

Por qué esto importa para los robots del futuro

Para un público no especialista, la idea principal es que los modelos de lenguaje pueden hacer más que hablar: pueden ayudar a diseñar las reglas motoras detalladas que permiten a las máquinas moverse de forma inteligente. En lugar de empezar con comportamientos aleatorios y requerir enormes cantidades de datos de prueba y error, un LLM puede proponer un plan de control razonable a partir de una descripción verbal y luego mejorarlo de manera continua leyendo registros breves de lo que ocurrió cuando el robot lo intentó. Esta mezcla de conocimiento previo y aprendizaje experiencial podría reducir el coste y el esfuerzo de construir robots capaces y otros sistemas autónomos. Aunque aún existen obstáculos—como el elevado coste computacional de ejecutar modelos grandes y el reto de escalar a tareas muy complejas y de larga duración—el estudio sugiere un camino hacia robots cuyos movimientos de bajo nivel estén moldeados, al menos en parte, por sistemas originalmente entrenados simplemente para predecir la siguiente palabra en una frase.

Cita: Carvalho, J.T., Nolfi, S. Sensory-motor control with large language models via iterative policy refinement. Sci Rep 16, 13575 (2026). https://doi.org/10.1038/s41598-026-42091-0

Palabras clave: grandes modelos de lenguaje, control de robots, aprendizaje por refuerzo, agentes incorporados, refinamiento iterativo de políticas