Clear Sky Science · it

Controllo sensomotorio con grandi modelli linguistici tramite raffinamento iterativo della policy

Insegnare alle macchine a muoversi da sole

Immaginate un robot che apprende a bilanciare un’asta, a far oscillare un pendolo fino a metterlo in posizione eretta o a uscire da una valle—senza che ingegneri umani debbano programmare meticolosamente ogni singolo movimento o raccogliere migliaia di dimostrazioni. Questo articolo esplora come i grandi modelli linguistici (LLM)—lo stesso tipo di sistemi usati per i chatbot—possano diventare dei “cervelli” che progettano e migliorano strategie di controllo per macchine mobili, basandosi in larga parte su descrizioni testuali e un po’ di prova ed errore.

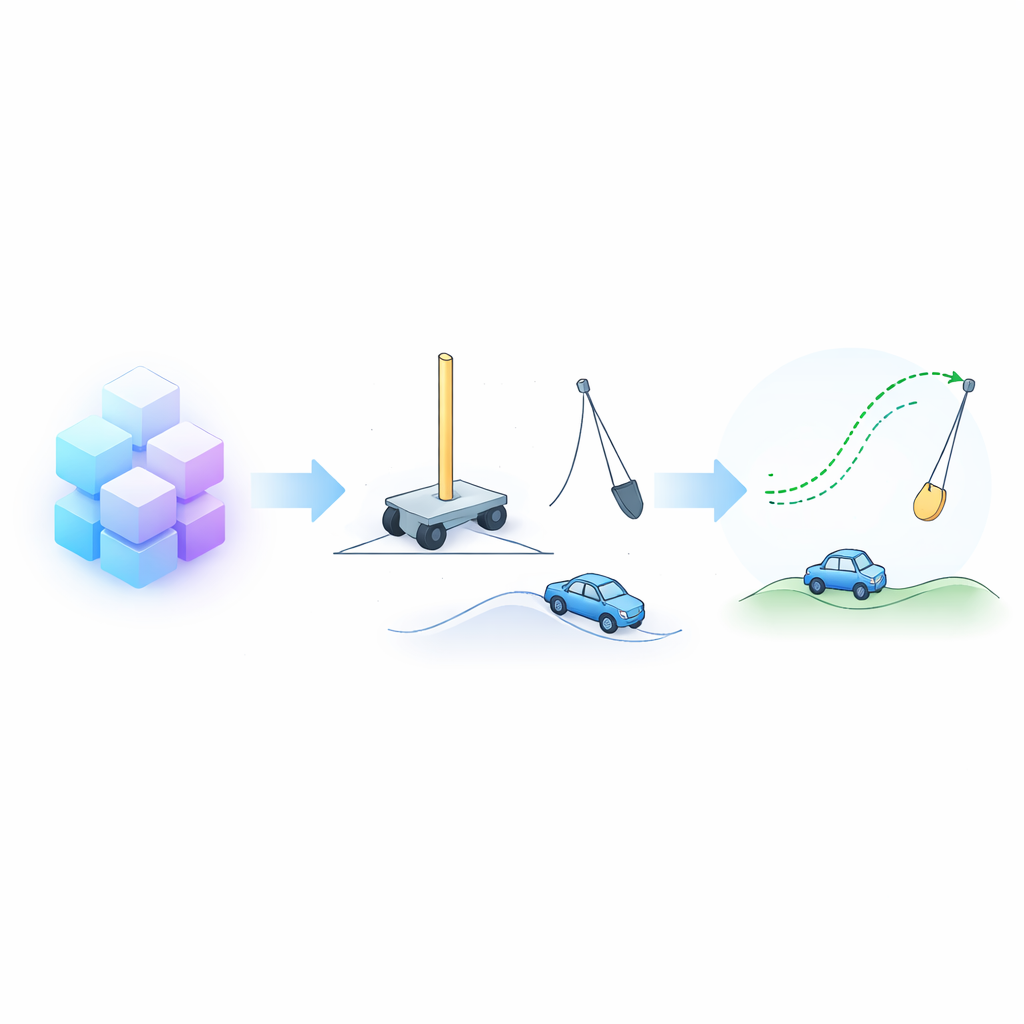

Dalle parole ai movimenti

Il controllo robotico tradizionale spesso suddivide il movimento in blocchi fissi, come passi di camminata predefiniti o movimenti di raggiungimento. Un programma di livello superiore quindi seleziona e sequenzia questi pezzi. Pur funzionando in contesti semplici, questo approccio fatica in situazioni più fluide dove i movimenti si sfumano l’uno nell’altro e devono essere regolati finemente momento per momento. Gli autori invece chiedono agli LLM di creare regole di controllo complete che mappino direttamente ciò che il robot percepisce—posizione, velocità, angoli e così via—in comandi motori continui. L’unica informazione iniziale che il modello riceve è una descrizione in linguaggio naturale del corpo del robot, dei suoi sensori e attuatori, dell’ambiente circostante e dell’obiettivo da raggiungere.

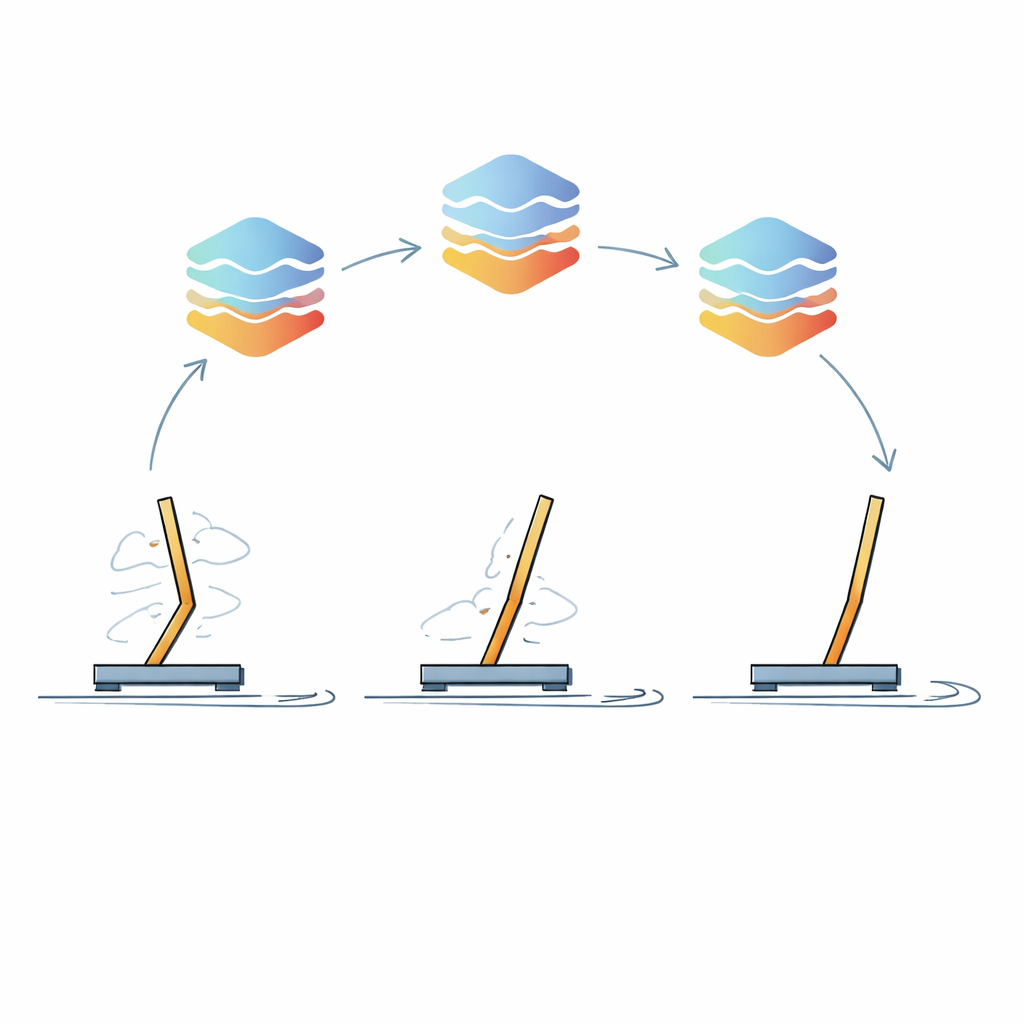

Un ciclo di riflessione e perfezionamento

Il fulcro dell’approccio è un ciclo di apprendimento iterativo che gli autori chiamano Raffinamento Iterativo della Policy. Nel primo passo, l’LLM viene stimolato a ragionare sul problema a tappe: prima delinea una strategia di alto livello in linguaggio naturale, poi la trasforma in regole chiare in stile IF–THEN–ELSE e infine converte queste regole in codice eseguibile. Quel controllore iniziale viene eseguito in un ambiente simulato—per esempio un carrello con un’asta da mantenere in posizione verticale—e si misura la performance del robot. In modo cruciale, brevi spezzoni delle letture sensoriali del robot e delle azioni corrispondenti vengono quindi reinviati all’LLM, insieme a un sommario di quanto la strategia abbia funzionato. All’LLM viene chiesto di analizzare queste tracce, individuare punti deboli e generare un controllore migliorato. Il ciclo si ripete molte volte, levigando gradualmente il comportamento.

Mettere l’idea alla prova

Per verificare se questo metodo funziona davvero, i ricercatori lo hanno testato su una serie di compiti classici usati come benchmark nell’apprendimento per rinforzo: bilanciare un sistema carrello–asta, far oscillare e stabilizzare un pendolo, guidare un’auto su una collina ripida e risolvere un compito di acrobot in cui un sistema a due bracci deve essere fatto oscillare fino a una certa altezza. Hanno inoltre affrontato un pendolo invertito in un noto simulatore fisico. Questi compiti sono abbastanza semplici da studiare in dettaglio ma rappresentano comunque sfide chiave: il robot non vede tutto in una volta, le ricompense sono ritardate e la dinamica può essere altamente instabile. Il team ha confrontato diversi modelli linguistici open-source moderni di circa 70–120 miliardi di parametri, ha variato quanta casualità permettere nelle uscite del modello e ha ripetuto ogni esperimento più volte per ottenere statistiche affidabili.

Quanto bene i modelli linguistici controllano le macchine?

Il modello con le prestazioni migliori, un sistema da 120 miliardi di parametri chiamato GPT-oss, ha scoperto in modo consistente strategie di controllo di alta qualità nella maggior parte dei compiti, spesso raggiungendo punteggi ottimali o vicini all’ottimo. Un altro modello, Qwen2.5, si è comportato particolarmente bene in alcuni problemi, superando talvolta GPT-oss sul pendolo invertito, sebbene abbia avuto difficoltà in altri compiti come il pendolo standard. È importante notare che i primi controllori prodotti dagli LLM erano spesso mediocri, a dimostrazione che non stavano semplicemente richiamando soluzioni preconfezionate dai dati di addestramento. Le prestazioni sono migliorate sensibilmente con le iterazioni man mano che i modelli usavano il feedback per aggiustare quali segnali sensoriali erano più rilevanti e come questi dovevano influenzare le azioni. Gli autori hanno anche esplorato quante misurazioni temporali includere in ciascun prompt di raffinamento e quali elementi di feedback fossero più critici, riscontrando che una quantità intermedia di dati e informazioni ricche sulle strategie precedenti funzionavano meglio.

Perché questo conta per i robot del futuro

Per un non specialista, la conclusione principale è che i modelli linguistici possono fare più che parlare: possono aiutare a progettare le regole motorie di dettaglio che fanno muovere le macchine in modo intelligente. Invece di partire da comportamenti casuali e richiedere enormi quantità di dati da prova ed errore, un LLM può proporre un piano di controllo sensato a partire da una descrizione verbale, quindi migliorarlo gradualmente leggendo brevi registri di ciò che è accaduto quando il robot lo ha provato. Questa combinazione di conoscenza a priori e apprendimento dall’esperienza potrebbe ridurre i costi e gli sforzi necessari per costruire robot e altri sistemi autonomi capaci. Pur rimanendo ostacoli—come l’elevato costo computazionale per eseguire modelli di grandi dimensioni e la sfida di scalare a compiti molto complessi e di lunga durata—lo studio indica una strada verso robot i cui movimenti di basso livello sono plasmati, almeno in parte, da sistemi originariamente addestrati semplicemente a prevedere la parola successiva in una frase.

Citazione: Carvalho, J.T., Nolfi, S. Sensory-motor control with large language models via iterative policy refinement. Sci Rep 16, 13575 (2026). https://doi.org/10.1038/s41598-026-42091-0

Parole chiave: grandi modelli linguistici, controllo dei robot, apprendimento per rinforzo, agenti incorporati, raffinamento iterativo della policy