Clear Sky Science · zh

从变分数据同化的角度可视化深度强化学习中的反向信息传播

这对计算机科学之外的重要性

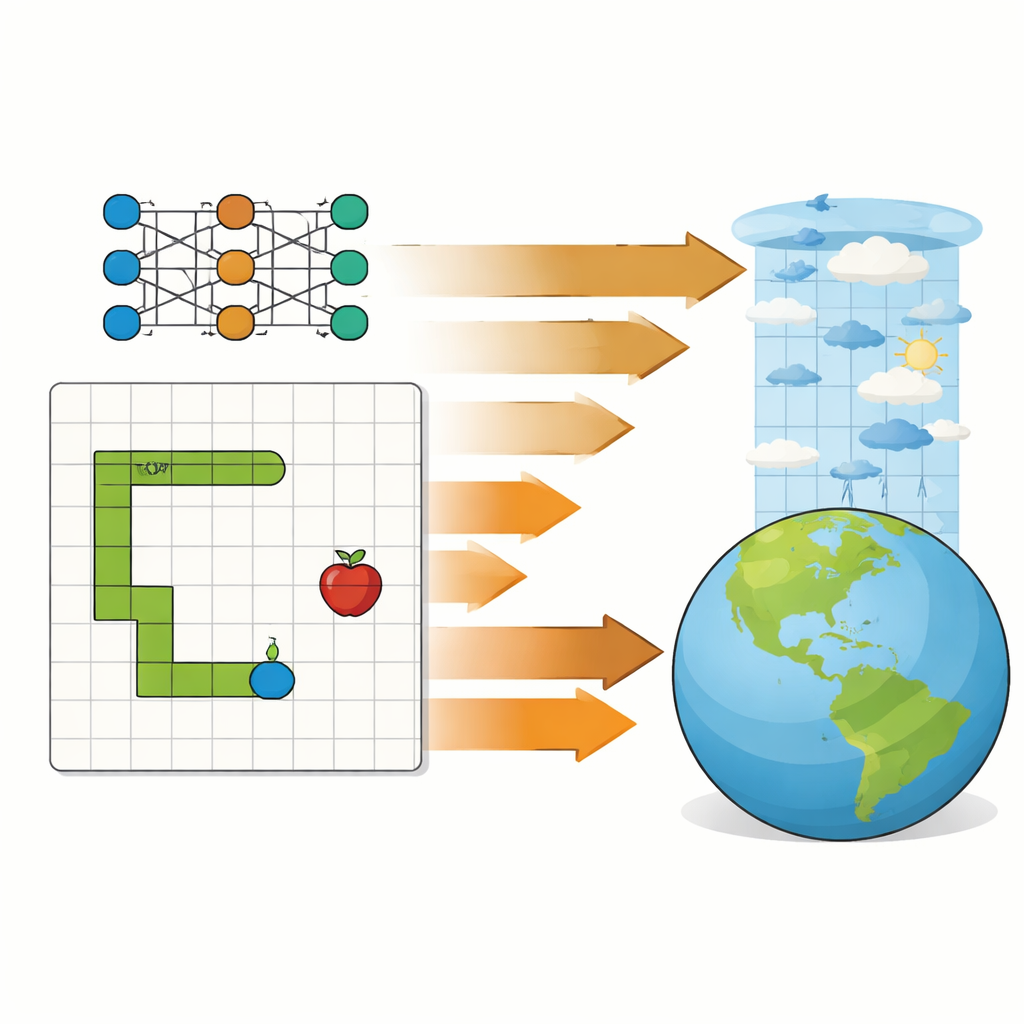

天气预报、气候模型和用于下棋或游戏的人工智能看似风马牛不相及,但它们都依赖相同的隐秘引擎:反复微调一个模型,使其更贴近实际发生的情况。本文打开了这个黑箱。作者以简化的“贪吃蛇”电子游戏为试验场,逐步并以可视化方式展示了学习算法改进其玩法的方式,如何与气象学家使用观测数据改进天气预报的做法密切对应。结果为现代人工智能与大气科学中长期使用的方法之间建立了一座清晰、直观的桥梁。

两个领域共享的隐秘引擎

在数值天气预报中,变分数据同化用于将一个大气物理模型与真实观测结合。科学家把预报模型向前积分,拿预测与观测比较,然后把这些不匹配的信息向后传播以调整模型的初始状态。驱动游戏或机器人控制系统的深度强化学习也以模型的前向运行为核心:智能体采取动作、获得奖励或惩罚,然后把信息通过神经网络向后传递以微调其内部参数。论文主张,在不同的术语之下,这两类过程做的其实是同一种工作——最小化衡量整个事件序列表现的单一评分。

以简单游戏作为清晰的实验室

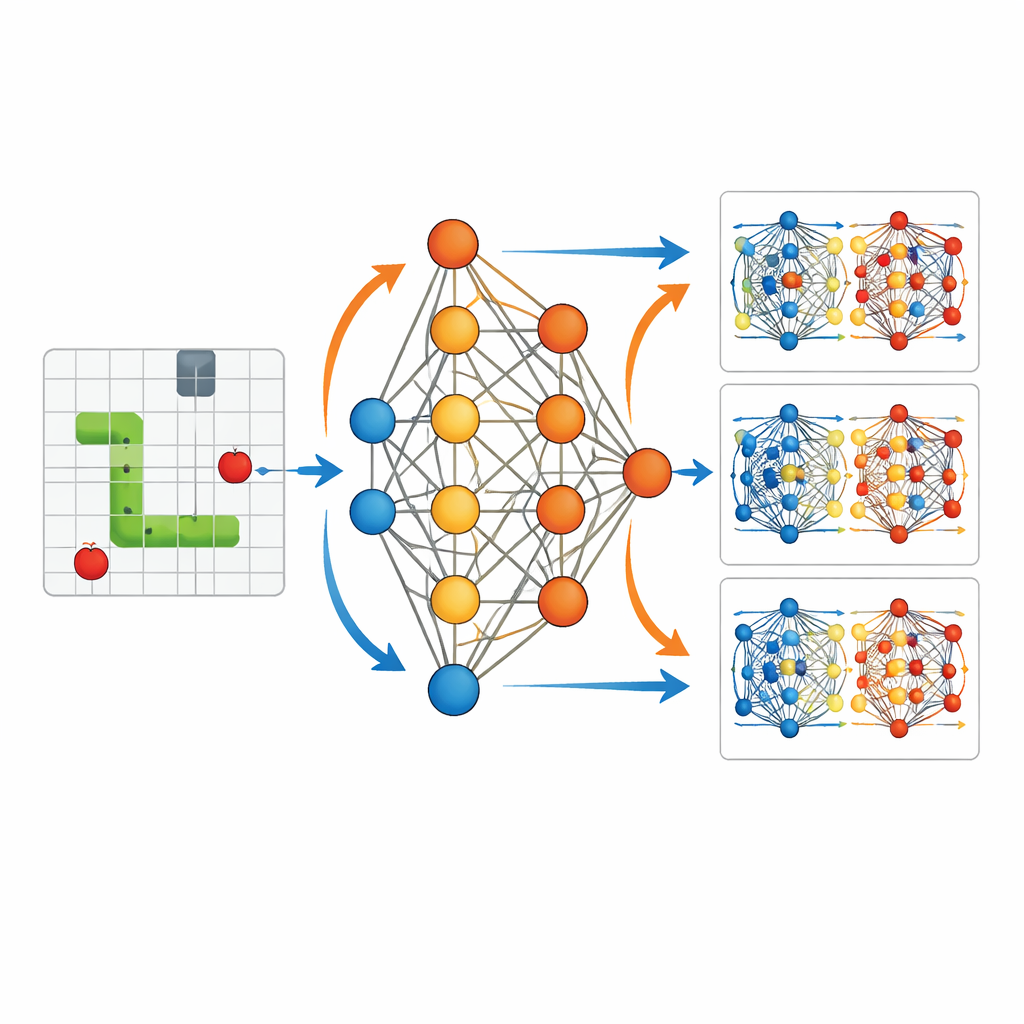

为使这一联系具体化,研究采用了一个简化设定:一个 AI 智能体学习玩经典的贪吃蛇游戏。智能体接收对环境的紧凑描述——食物、墙壁和蛇身相对于蛇头的位置——将这 11 位信息输入一个只有一层隐藏层的小型神经网络。网络输出三种选择:左转、直行或右转。每次蛇吃到食物,智能体获得正奖励;如果撞到墙或咬到自己,则得到负奖励并结束游戏。关键是,作者记录了该网络在每次训练步骤中的每一个参数——总计 3,584 个——从而可以完整回放并详尽检查整个学习过程。

从内部观察学习过程

拥有这一完整记录后,论文可视化了蛇学习过程中网络内部“权重”的变化。早期动作几乎随机,权重更新零散且微小。经过大量游戏,当智能体在网格中探索并经历许多成功与失败后,这些更新开始形成有结构的模式。蛇的行进路径变得更长、更有指向性地朝向食物。研究显示,每次移动之后的小幅学习爆发像是短程修正:来自即时奖励的信息向后扩散以调整产生该动作的参数。系统还会周期性地重用过去的游戏经验,基于最新参数重新计算这些旧选择的优劣。这类似于天气中心在四维变分数据同化中围绕更新的预报反复线性化并重新优化的做法。

从随机漫游到有目的的运动

受训与未受训智能体的对比使这些隐含更新的效果一目了然。未经训练时,蛇在起点附近徘徊,频繁撞墙或咬到自己,毫无明显策略。训练之后,相同的网络结构可以产生平滑、有目的的轨迹,主动朝向食物并规避危险。参数变化的可视化表明,特定时刻的奖励选择性地强化或削弱网络中某些连接,从而组织出相应的行为。这与数据同化中观测信息逐步重塑模型初始状态、使预报更符合实际轨迹的过程相呼应。

研究真正展示的是什么

该工作并未提出一种新的学习算法或新的天气预报方法。相反,它提供了一个清晰、教学式的图景,揭示了一个共享的原理:深度强化学习与变分数据同化都会反复前向运行模型、衡量其表现,然后把这些信息向后传递以改进某组可调变量。在贪吃蛇中,这些变量是编码策略的神经网络权重;在天气预报中,它们是播种预报的、大气状态。通过在一个小型、完全可观测的系统中将信息的反向流可视化,论文让大气科学家对现代机器学习动态有更直观的感受,同时也帮助人工智能研究者理解地球科学中长期存在的类似思想。

引用: Wang, KY. Visualising backward information propagation in deep reinforcement learning from a variational data assimilation perspective. Sci Rep 16, 11581 (2026). https://doi.org/10.1038/s41598-026-42086-x

关键词: 强化学习, 数据同化, 神经网络, 天气预报, 优化