Clear Sky Science · nl

Visualisatie van achterwaartse informatiepropagatie in deep reinforcement learning vanuit een variationale data-assimilatieblik

Waarom dit verder gaat dan computerwetenschap

Weerberichten, klimaatmodellen en spelspelende kunstmatige intelligentie lijken misschien ver uit elkaar te liggen, maar ze draaien op hetzelfde verborgen mechanisme: het herhaaldelijk bijsturen van een model zodat het beter overeenkomt met wat er in werkelijkheid gebeurt. Dit artikel opent die zwarte doos. Met het eenvoudige Snake-videospel als proefveld toont de auteur — visueel en stap voor stap — aan dat de manier waarop een leeralgoritme zijn spel verbetert sterk lijkt op hoe meteorologen weersvoorspellingen verfijnen met behulp van waarnemingsgegevens. Het resultaat is een duidelijke, intuïtieve brug tussen moderne AI en lang gekoesterde methoden in de atmosferische wetenschappen.

Twee werelden met een gedeelde verborgen motor

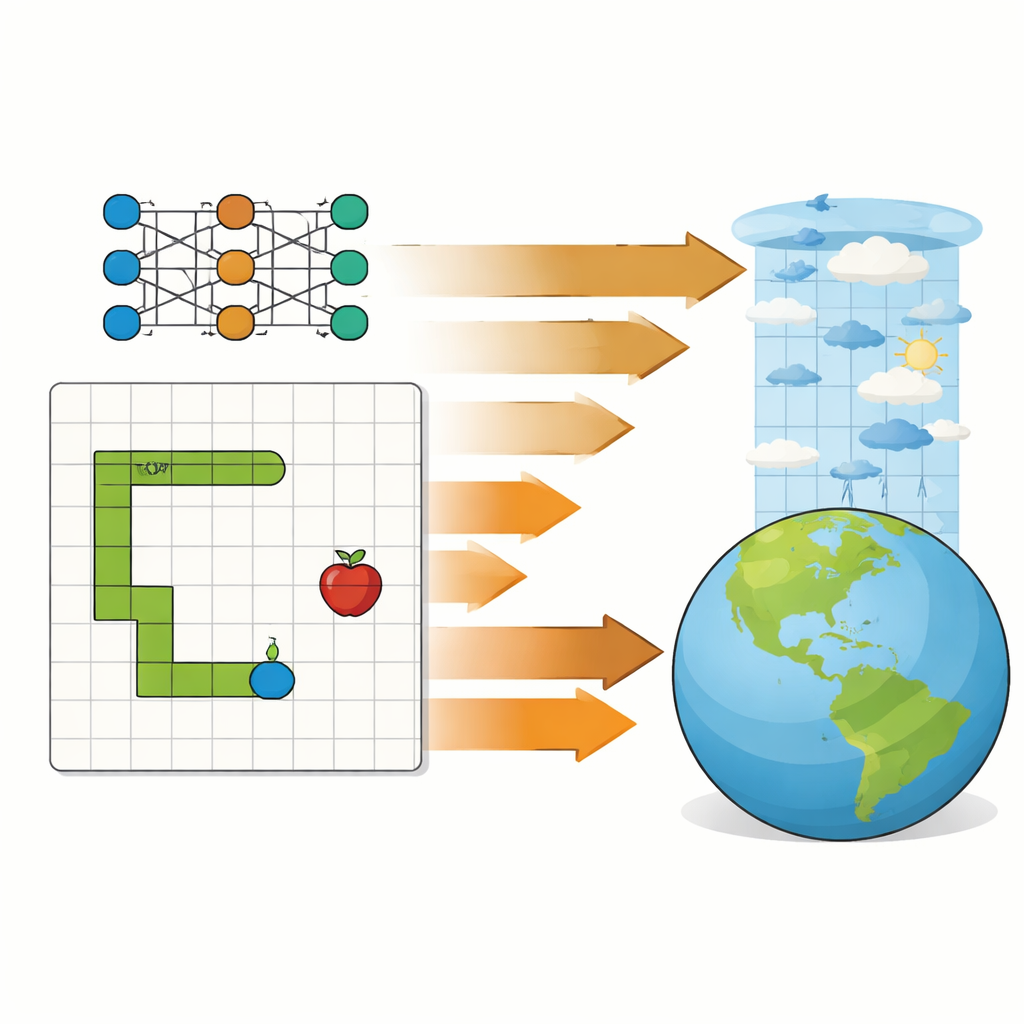

In numerieke weersvoorspelling wordt variationale data-assimilatie gebruikt om een fysisch model van de atmosfeer te combineren met waarnemingen uit de echte wereld. Wetenschappers draaien het voorspellingmodel vooruit in de tijd, vergelijken het met meetgegevens, en propageren vervolgens de informatie uit die discrepanties achterwaarts om de begintoestanden van het model aan te passen. Deep reinforcement learning, dat systemen aandrijft die leren spellen te spelen of robots te besturen, draait ook een model vooruit: een agent neemt acties, ontvangt beloningen of straffen, en stuurt daarna informatie achterwaarts door een neurale netwerk om interne parameters bij te schaven. Het artikel betoogt dat beide processen, ondanks verschillend jargon, hetzelfde soort werk doen — het minimaliseren van één enkele score die meet hoe goed het systeem presteert over een gehele reeks gebeurtenissen.

Een eenvoudig spel als schoon laboratorium

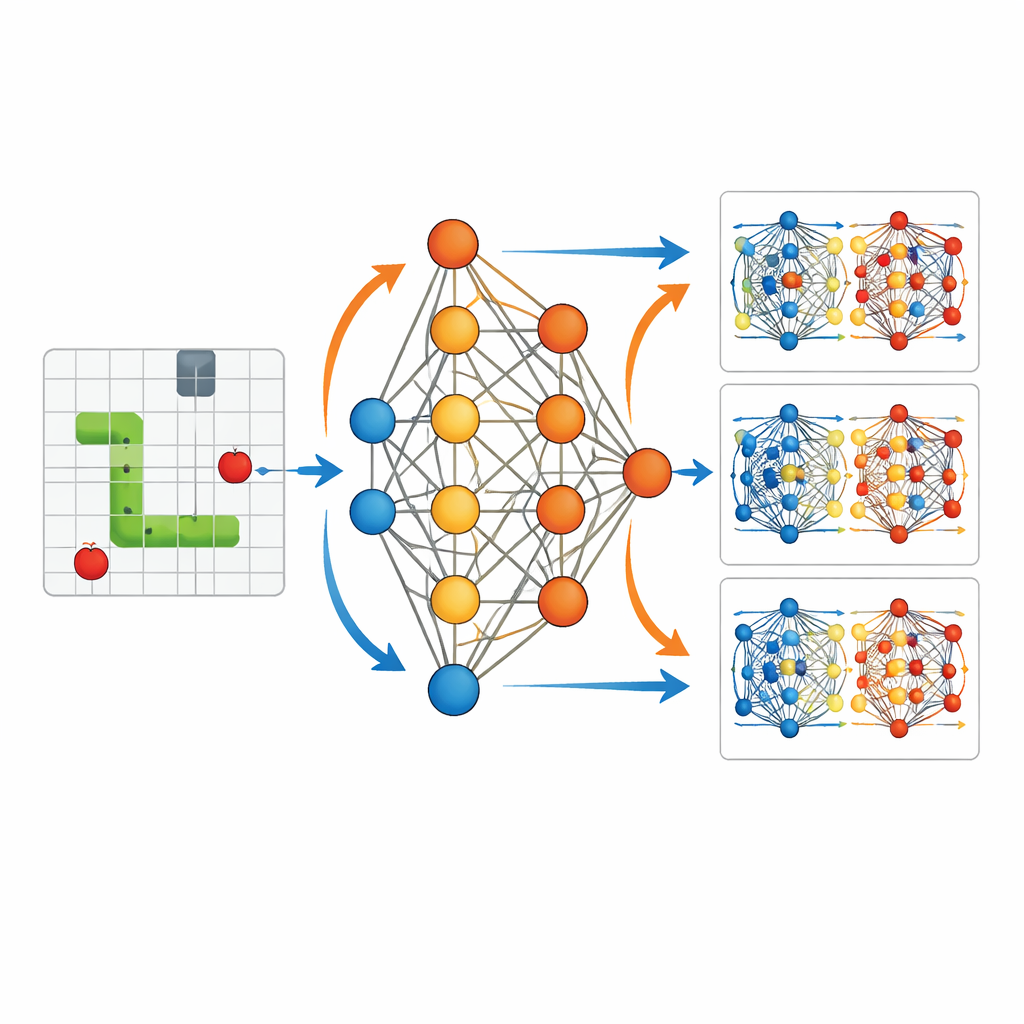

Om deze verbinding concreet te maken, gebruikt de studie een afgeslankte setting: een AI-agent die het klassieke Snake-spel leert spelen. De agent ziet een compacte beschrijving van zijn omgeving — waar voedsel, muren en zijn eigen lichaam liggen ten opzichte van zijn kop — en voert deze 11 bits informatie in een klein neuraal netwerk met één verborgen laag. Het netwerk geeft drie opties als output: linksaf, rechtdoor, of rechtsaf. Elke keer dat de slang voedsel eet, ontvangt de agent een positieve beloning; raakt hij een muur of zichzelf, dan krijgt hij een negatieve beloning en eindigt het spel. Cruciaal is dat de auteur elke enkele parameter van dit netwerk — in totaal 3.584 — bij elke trainingsstap registreert, zodat het hele leerproces kan worden afgespeeld en in detail kan worden onderzocht.

Het leren van binnenuit bekijken

Met dit volledige verslag visualiseert het artikel hoe de interne “gewichten” van het netwerk veranderen terwijl de slang leert. In het begin zijn de acties vrijwel willekeurig en zijn de gewichtsupdates verspreid en klein. Na vele spellen, terwijl de agent het rooster verkent en veel successen en mislukkingen ervaart, beginnen die updates gestructureerde patronen te vormen. De paden van de slang worden langer en meer gericht op voedsel. De studie laat zien dat elke kleine leerspurt na een zet als een kortetermijncorrectie werkt: informatie uit onmiddellijke beloningen golft achterwaarts om de parameters aan te passen die die zet hebben geproduceerd. Periodiek hergebruikt het systeem ook eerdere spelervaringen en berekent opnieuw hoe goed of slecht die oude keuzes eruitzien onder de nieuwste parameters. Dit lijkt op hoe weercentra herhaaldelijk lineariseren en her-optimaliseren rond een geüpdatete voorspelling in vierdimensionale variationale data-assimilatie.

Van willekeurig zwerven naar doelbewogen beweging

Het contrast tussen getrainde en niet-getrainde agenten maakt het effect van deze verborgen updates makkelijk zichtbaar. Zonder training zwalkt de slang rond het startpunt en botst tegen muren of zichzelf zonder duidelijke strategie. Na training levert dezelfde netwerkstructuur vloeiende, doelgerichte trajecten op die actief naar voedsel toe bewegen en gevaar vermijden. Visualisaties van parameterveranderingen tonen dat beloningen op specifieke momenten bepaalde verbindingen in het netwerk selectief versterken of verzwakken, waardoor het gedrag wordt georganiseerd. Dit weerspiegelt hoe observatie-informatie in data-assimilatie geleidelijk de modelbegintoestanden hervormt zodat voorspellingen trajecten volgen die beter overeenkomen met de realiteit.

Wat de studie werkelijk aantoont

Het werk introduceert geen nieuw leeralgoritme of een nieuwe manier om het weer te voorspellen. In plaats daarvan biedt het een helder, didactisch beeld van een gedeeld principe: zowel deep reinforcement learning als variationale data-assimilatie draaien herhaaldelijk een model vooruit, meten hoe goed het presteerde, en sturen die informatie vervolgens achterwaarts om een set aanpasbare grootheden te verbeteren. In Snake zijn die grootheden de gewichten van het neurale netwerk die een strategie coderen; in weersvoorspelling zijn het de atmosferische toestanden die een voorspelling opstarten. Door de achterwaartse informatiestroom zichtbaar te maken in een klein, volledig observeerbaar systeem, geeft het artikel atmosferenwetenschappers een meer intuïtief begrip van moderne machine-learningdynamiek en helpt het AI-onderzoekers de lange geschiedenis van soortgelijke ideeën in de geowetenschappen waarderen.

Bronvermelding: Wang, KY. Visualising backward information propagation in deep reinforcement learning from a variational data assimilation perspective. Sci Rep 16, 11581 (2026). https://doi.org/10.1038/s41598-026-42086-x

Trefwoorden: reinforcement learning, data-assimilatie, neurale netwerken, weervoorspelling, optimalisatie