Clear Sky Science · pt

Visualizando a propagação retroativa de informação em aprendizagem por reforço profundo na perspectiva da assimilação variacional de dados

Por que isso importa além da ciência da computação

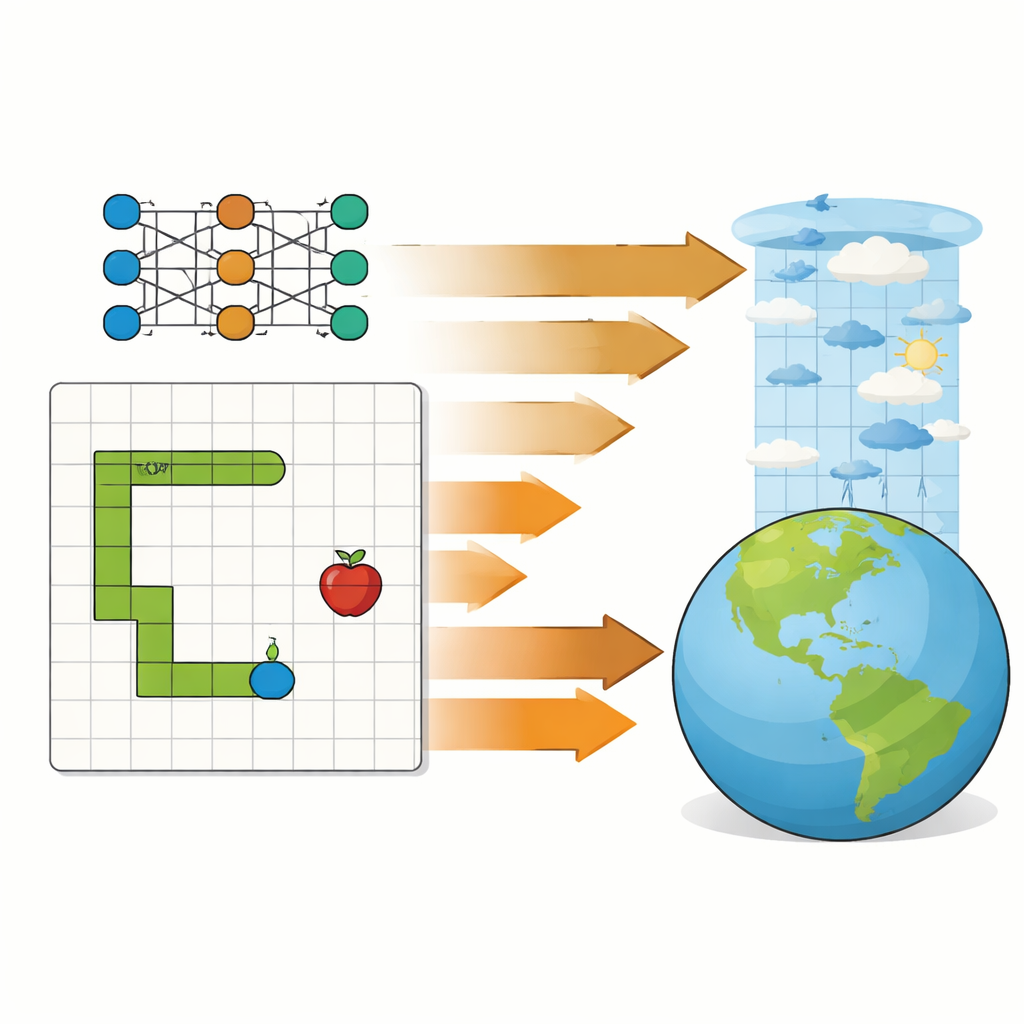

Previsões meteorológicas, modelos climáticos e inteligências artificiais que jogam jogos podem parecer mundos à parte, mas dependem do mesmo motor oculto: ajustar repetidamente um modelo para que ele se aproxime do que realmente acontece. Este artigo abre essa caixa-preta. Usando um simples jogo de video game Snake como laboratório, o autor mostra — visualmente e passo a passo — que a forma como um algoritmo de aprendizado melhora seu desempenho espelha de perto a maneira como meteorologistas refinam previsões do tempo usando dados observacionais. O resultado é uma ponte clara e intuitiva entre a IA moderna e métodos consagrados em ciências atmosféricas.

Dois mundos com um motor oculto compartilhado

Na previsão numérica do tempo, a assimilação variacional de dados é usada para combinar um modelo físico da atmosfera com observações do mundo real. Cientistas executam o modelo de previsão para frente no tempo, comparam-no com medições e então propagam a informação desses desajustes para trás a fim de ajustar as condições iniciais do modelo. O aprendizado por reforço profundo, que alimenta sistemas que aprendem a jogar ou controlar robôs, também executa um modelo para frente: um agente toma ações, recebe recompensas ou penalidades e então envia informação para trás por uma rede neural para ajustar seus parâmetros internos. O artigo argumenta que, sob a terminologia diferente, ambos os processos realizam o mesmo tipo de trabalho — minimizar uma única métrica que avalia quão bem o sistema atua ao longo de toda uma sequência de eventos.

Um jogo simples como um laboratório limpo

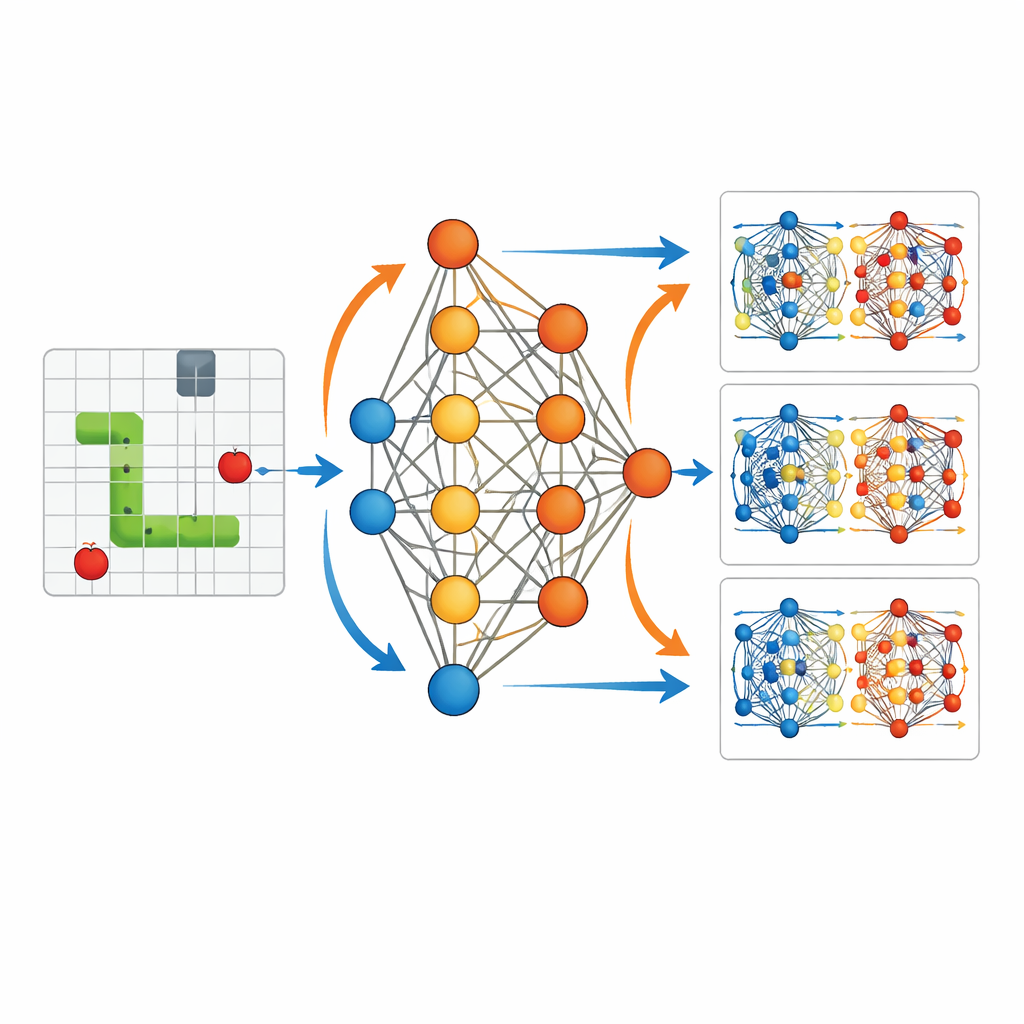

Para tornar essa conexão concreta, o estudo usa um ambiente reduzido: um agente de IA aprendendo a jogar o clássico Snake. O agente vê uma descrição compacta do entorno — onde estão a comida, as paredes e seu próprio corpo em relação à cabeça — e alimenta essas 11 informações em uma pequena rede neural com uma camada oculta. A rede produz três opções: virar à esquerda, seguir em frente ou virar à direita. Cada vez que a cobra come uma comida, o agente recebe uma recompensa positiva; se ela colide com uma parede ou consigo mesma, recebe uma recompensa negativa e o jogo termina. Crucialmente, o autor registra todos os parâmetros dessa rede — 3.584 no total — em cada passo de treinamento, para que todo o processo de aprendizado possa ser reproduzido e inspecionado em detalhe.

Observando o aprendizado acontecer por dentro

Com esse registro completo, o artigo visualiza como os “pesos” internos da rede mudam à medida que a cobra aprende. No começo, as ações são quase aleatórias e as atualizações de peso são dispersas e pequenas. Ao longo de muitos jogos, enquanto o agente explora a grade e acumula sucessos e fracassos, essas atualizações começam a formar padrões estruturados. Os trajetos da cobra tornam-se mais longos e mais direcionados à comida. O estudo mostra que cada pequeno surto de aprendizado após um movimento funciona como uma correção de curto alcance: informação das recompensas imediatas propaga-se para trás para ajustar os parâmetros que produziram aquele movimento. Periodicamente, o sistema também reutiliza experiências de jogos passados, recomputando quão boas ou ruins aquelas escolhas antigas parecem sob os parâmetros mais recentes. Isso se assemelha a como centros meteorológicos linearizam repetidamente e reotimizam em torno de uma previsão atualizada na assimilação variacional de dados em quatro dimensões.

Do vagar aleatório ao movimento com propósito

O contraste entre agentes treinados e não treinados torna o efeito dessas atualizações ocultas fácil de ver. Sem treinamento, a cobra vagueia perto do ponto de partida, batendo em paredes ou em si mesma sem estratégia aparente. Após o treinamento, a mesma estrutura de rede produz trajetórias suaves e dirigidas que se orientam ativamente em direção à comida enquanto evitam perigos. Visualizações das mudanças de parâmetros mostram que recompensas em instantes específicos fortalecem ou enfraquecem seletivamente conexões particulares na rede, organizando seu comportamento. Isso reflete como a informação observacional na assimilação de dados gradualmente remodela as condições iniciais do modelo para que as previsões sigam trajetórias mais consistentes com a realidade.

O que o estudo realmente demonstra

O trabalho não introduz um novo algoritmo de aprendizado nem uma nova forma de prever o tempo. Em vez disso, oferece uma imagem clara e didática de um princípio compartilhado: tanto o aprendizado por reforço profundo quanto a assimilação variacional de dados executam repetidamente um modelo para frente, medem quão bem ele foi e então enviam essa informação para trás para melhorar um conjunto de quantidades ajustáveis. Em Snake, essas quantidades são os pesos da rede neural que codificam uma estratégia; na previsão do tempo, são os estados atmosféricos que dão origem a uma previsão. Ao tornar visível o fluxo retroativo de informação em um sistema pequeno e totalmente observável, o artigo dá aos cientistas atmosféricos uma sensação mais intuitiva da dinâmica do aprendizado de máquina moderno e ajuda pesquisadores de IA a apreciar a longa história de ideias semelhantes nas geociências.

Citação: Wang, KY. Visualising backward information propagation in deep reinforcement learning from a variational data assimilation perspective. Sci Rep 16, 11581 (2026). https://doi.org/10.1038/s41598-026-42086-x

Palavras-chave: aprendizado por reforço, assimilação de dados, redes neurais, previsão do tempo, otimização