Clear Sky Science · ja

変分データ同化の観点から見る深層強化学習における情報の逆伝播の可視化

コンピュータサイエンスを超えて重要な理由

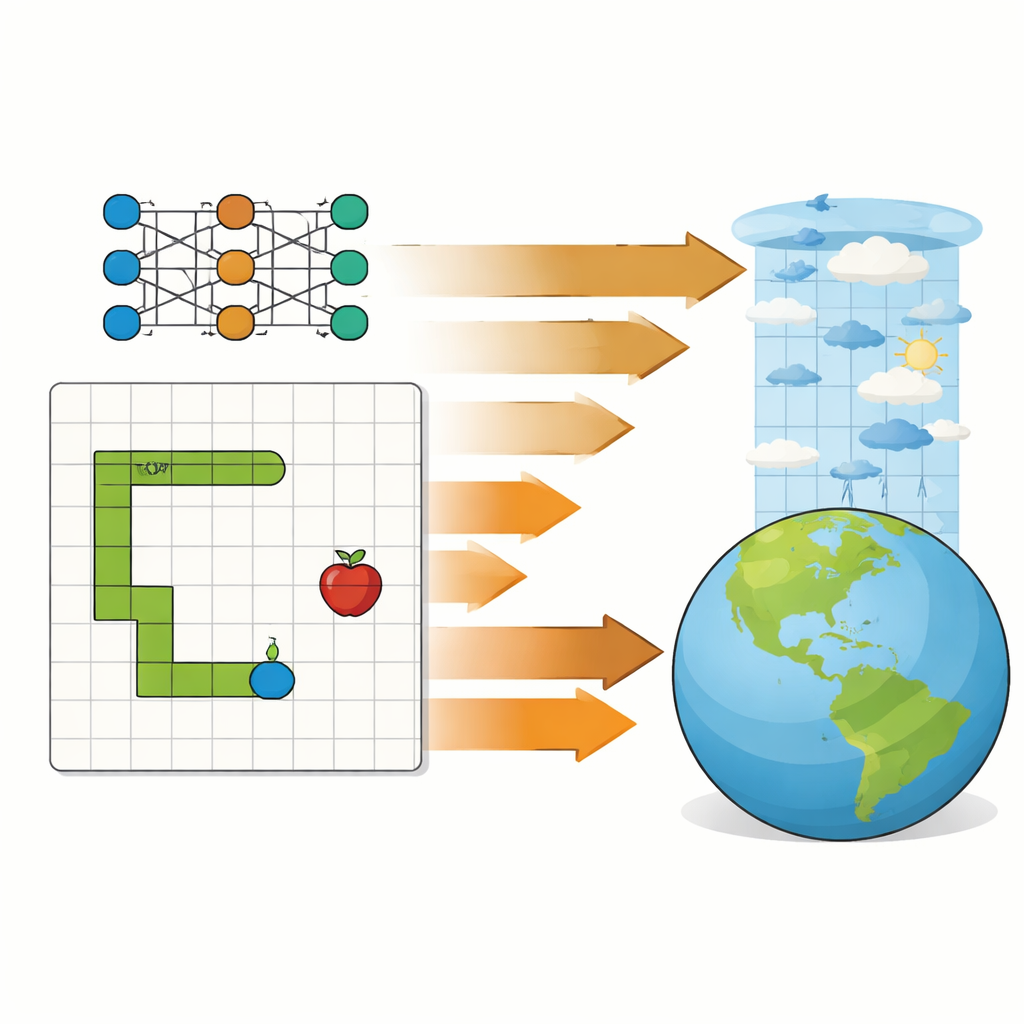

天気予報、気候モデル、ゲームをプレイする人工知能は一見すると別世界のようだが、実際には共通する見えない原動力に依存している。それは、モデルを反復的に調整して実際に起きたことにより良く一致させるという作業だ。本論文はそのブラックボックスを開く。単純なスネークのビデオゲームを実験台として用い、学習アルゴリズムがプレイを改善していく様子が、気象学者が観測データを使って天気予報を洗練させるやり方に極めて似ていることを、視覚的かつ段階的に示している。その結果、現代のAIと大気科学の長年の手法との間に明快で直感的な橋渡しが生まれる。

共通の見えない原動力を持つ二つの世界

数値天気予報では、変分データ同化を用いて大気の物理モデルと現実の観測を組み合わせる。科学者は予報モデルを時間方向に走らせ、観測と比較し、その不一致から得られる情報を逆に伝搬させてモデルの初期条件を調整する。一方、ゲームを学習したりロボットを制御したりする深層強化学習も同様にモデルを順方向に走らせる:エージェントが行動を取り、報酬や罰を受け取り、ニューラルネットワークを通じて情報を逆流させて内部パラメータを微調整する。本論文は、用語は異なっていても、両者は同じ種類の仕事―時系列全体にわたってシステムの性能を測る単一のスコアを最小化すること―を行っていると主張する。

単純なゲームを用いた明快な実験室

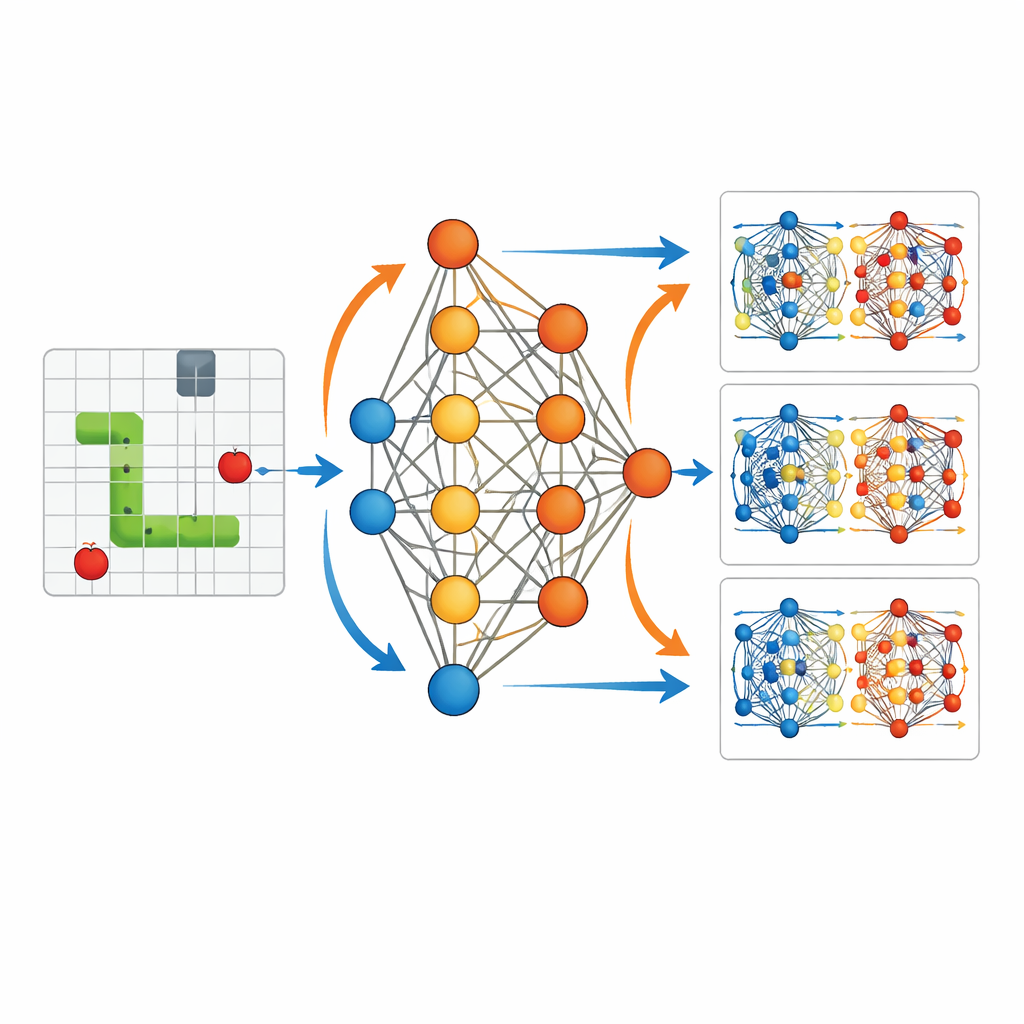

この接続を具体化するために、研究は簡素化された環境を使っている:古典的なスネークゲームを学習するAIエージェントだ。エージェントは周囲の簡潔な記述―餌、壁、自分の体が頭に対してどこにあるか―を見て、これら11ビットの情報を1つの隠れ層を持つ小さなニューラルネットワークに入力する。ネットワークは左折、直進、右折の三つの選択肢を出力する。餌を食べるたびに正の報酬が与えられ、壁や自身に衝突すると負の報酬が与えられてゲームは終了する。重要な点として、著者はこのネットワークの全てのパラメータ―合計3,584個―を各トレーニングステップで記録しており、学習過程全体を再生して詳細に検査できるようにしている。

内部から学習を観察する

この完全な記録を用いて、論文はスネークが学習する過程でネットワークの内部“重み”がどのように変化するかを可視化する。初期段階では行動はほとんどランダムで、重みの更新も散発的で小さい。多くのゲームを通じてエージェントがグリッドを探索し、多くの成功と失敗を経験するにつれて、更新は構造化されたパターンを形成し始める。スネークの経路はより長く、餌に向かって方向付けられるようになる。各行動後の小さな学習の爆発は短距離の補正のようなもので、即時の報酬からの情報がその行動を生み出したパラメータを逆に調整する。周期的に、システムは過去のゲーム経験を再利用し、最新のパラメータ下で当時の選択がどれほど良いかを再計算する。これは、気象センターが更新された予報の周りで何度も線形化と再最適化を行う四次元変分データ同化に似ている。

ランダムな徘徊から目的を持った動きへ

訓練前後のエージェントを比較すると、これら見えない更新の効果が鮮明に分かる。訓練されていないとき、スネークは出発点付近を徘徊し、明確な戦略もなく壁や自分自身にぶつかる。訓練後は同じネットワーク構造が滑らかで目的志向の軌跡を生み、餌に積極的に向かい危険を回避する。パラメータ変化の可視化は、特定の時刻の報酬がネットワーク内の特定の結合を選択的に強化または弱化し、それによって行動を組織していることを示す。これは、データ同化における観測情報が徐々にモデルの初期状態を再形成し、予報が現実とより一貫した軌道に従うようにする様子と一致する。

この研究が実際に示していること

本研究は新しい学習アルゴリズムや新たな気象予報法を導入するものではない。代わりに、共通の原理を明快かつ教育的に示している:深層強化学習と変分データ同化はどちらもモデルを順方向に何度も走らせ、どれだけうまくいったかを測定し、その情報を逆向きに伝えて調整可能な量を改善する。スネークではそれらの量は戦略を符号化するニューラルネットワークの重みであり、気象予報では予報を開始する大気状態である。小さく完全に観測可能な系で情報の逆流を可視化することで、この論文は大気科学者に現代の機械学習ダイナミクスの直感的理解を与え、AI研究者には地球科学における類似のアイデアの長い歴史を再認識させる助けとなる。

引用: Wang, KY. Visualising backward information propagation in deep reinforcement learning from a variational data assimilation perspective. Sci Rep 16, 11581 (2026). https://doi.org/10.1038/s41598-026-42086-x

キーワード: 強化学習, データ同化, ニューラルネットワーク, 気象予測, 最適化