Clear Sky Science · it

Visualizzazione della propagazione retroattiva dell'informazione nell'apprendimento profondo per rinforzo da una prospettiva di data assimilation variazionale

Perché questo è importante oltre l'informatica

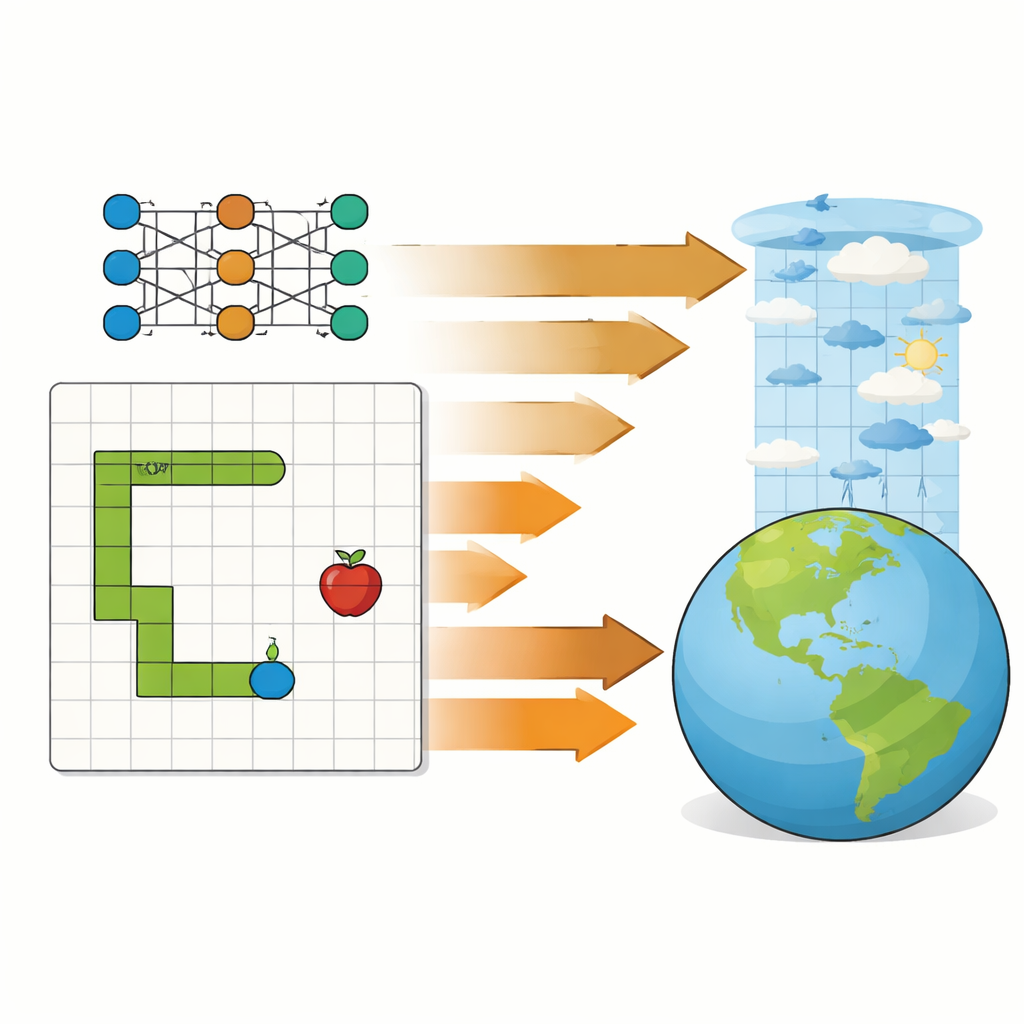

Le previsioni meteorologiche, i modelli climatici e l'intelligenza artificiale per il gioco possono sembrare mondi lontani, eppure si basano sullo stesso motore nascosto: spingere ripetutamente un modello in modo che corrisponda meglio a ciò che accade realmente. Questo articolo apre quella scatola nera. Usando il semplice videogioco Snake come banco di prova, l'autore mostra — visivamente e passo dopo passo — che il modo in cui un algoritmo di apprendimento migliora il proprio gioco rispecchia strettamente il modo in cui i meteorologi raffinano le previsioni usando dati osservativi. Il risultato è un ponte chiaro e intuitivo tra l'IA moderna e metodi consolidati nelle scienze atmosferiche.

Due mondi con un motore nascosto condiviso

Nella previsione numerica del tempo, la data assimilation variazionale viene usata per combinare un modello fisico dell'atmosfera con osservazioni del mondo reale. Gli scienziati eseguono il modello di previsione in avanti nel tempo, lo confrontano con le misure e poi propagano le informazioni derivanti da quegli scostamenti a ritroso per aggiustare le condizioni iniziali del modello. L'apprendimento profondo per rinforzo, che alimenta sistemi che imparano a giocare o a controllare robot, esegue anch'esso un modello in avanti: un agente compie azioni, riceve ricompense o penalità e poi invia informazioni a ritroso attraverso una rete neurale per modificare i suoi parametri interni. L'articolo sostiene che, sotto la diversa terminologia, entrambi i processi svolgono lo stesso tipo di lavoro — minimizzare un punteggio unico che misura quanto il sistema performa lungo un'intera sequenza di eventi.

Un gioco semplice come laboratorio pulito

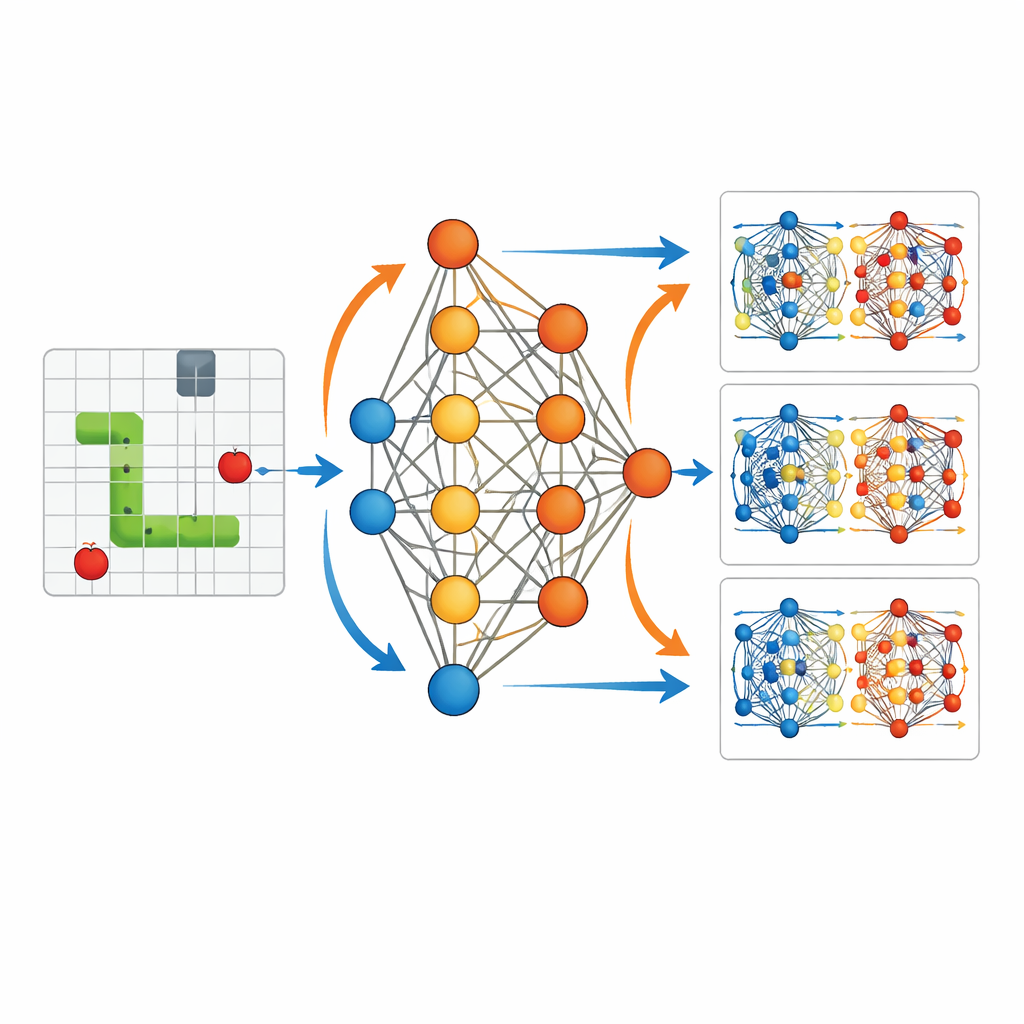

Per rendere concreta questa connessione, lo studio utilizza un contesto semplificato: un agente IA che impara a giocare al classico Snake. L'agente vede una descrizione compatta del suo intorno — dove si trovano cibo, muri e il proprio corpo rispetto alla testa — e fornisce queste 11 informazioni a una piccola rete neurale con un layer nascosto. La rete produce tre opzioni: girare a sinistra, andare dritto o girare a destra. Ogni volta che il serpente mangia cibo, l'agente riceve una ricompensa positiva; se si schianta contro un muro o contro se stesso, ottiene una ricompensa negativa e il gioco termina. È fondamentale che l'autore registra ogni singolo parametro di questa rete — 3.584 in totale — a ogni passo di addestramento, in modo che l'intero processo di apprendimento possa essere riprodotto e ispezionato nel dettaglio.

Osservare l'apprendimento dall'interno

Con questo registro completo, l'articolo visualizza come cambiano i «pesi» interni della rete mentre il serpente impara. All'inizio le azioni sono quasi casuali e gli aggiornamenti dei pesi sono sparsi e piccoli. Dopo molte partite, mentre l'agente esplora la griglia e sperimenta molti successi e fallimenti, quegli aggiornamenti cominciano a formare schemi strutturati. I percorsi del serpente diventano più lunghi e più diretti verso il cibo. Lo studio mostra che ogni piccolo scoppio di apprendimento dopo una mossa è come una correzione a corto raggio: le informazioni dalle ricompense immediate si propagano a ritroso per aggiustare i parametri che hanno prodotto quella mossa. Periodicamente, il sistema riusa anche esperienze di gioco passate, ricalcolando quanto buone o cattive quelle vecchie scelte appaiono sotto i parametri più recenti. Questo somiglia al modo in cui i centri meteorologici linearizzano e ri-ottimizzano ripetutamente attorno a una previsione aggiornata nella data assimilation variazionale quadridimensionale.

Dal vagare casuale al movimento intenzionale

Il contrasto tra agenti addestrati e non addestrati rende facile vedere l'effetto di questi aggiornamenti nascosti. Senza addestramento, il serpente si aggira vicino al punto di partenza, sbatte contro muri o contro se stesso senza una strategia apparente. Dopo l'addestramento, la stessa struttura di rete produce traiettorie fluide e intenzionali che puntano attivamente al cibo evitando il pericolo. Le visualizzazioni dei cambiamenti di parametro mostrano che le ricompense in momenti specifici rafforzano o indeboliscono selettivamente connessioni particolari nella rete, organizzandone il comportamento. Questo rispecchia come l'informazione osservativa nella data assimilation rimodella gradualmente le condizioni iniziali del modello affinché le previsioni seguano traiettorie più coerenti con la realtà.

Cosa mostra realmente lo studio

Il lavoro non introduce un nuovo algoritmo di apprendimento né un nuovo modo di prevedere il tempo. Offre invece un quadro chiaro e didattico di un principio condiviso: sia l'apprendimento profondo per rinforzo sia la data assimilation variazionale eseguono ripetutamente un modello in avanti, misurano quanto bene ha fatto e poi inviano quell'informazione a ritroso per migliorare un insieme di quantità aggiustabili. In Snake, queste quantità sono i pesi della rete neurale che codificano una strategia; nella previsione meteorologica sono gli stati atmosferici che innescano una previsione. Rendendo visibile il flusso retrogrado dell'informazione in un sistema piccolo e completamente osservabile, l'articolo dà agli scienziati atmosferici un sentimento più intuitivo della dinamica dell'apprendimento automatico moderno e aiuta i ricercatori di IA ad apprezzare la lunga storia di idee simili nelle geoscienze.

Citazione: Wang, KY. Visualising backward information propagation in deep reinforcement learning from a variational data assimilation perspective. Sci Rep 16, 11581 (2026). https://doi.org/10.1038/s41598-026-42086-x

Parole chiave: apprendimento per rinforzo, data assimilation, reti neurali, previsione meteorologica, ottimizzazione