Clear Sky Science · fr

Visualisation de la propagation rétrospective de l’information en apprentissage par renforcement profond depuis une perspective d’assimilation variationnelle des données

Pourquoi cela compte au-delà de l’informatique

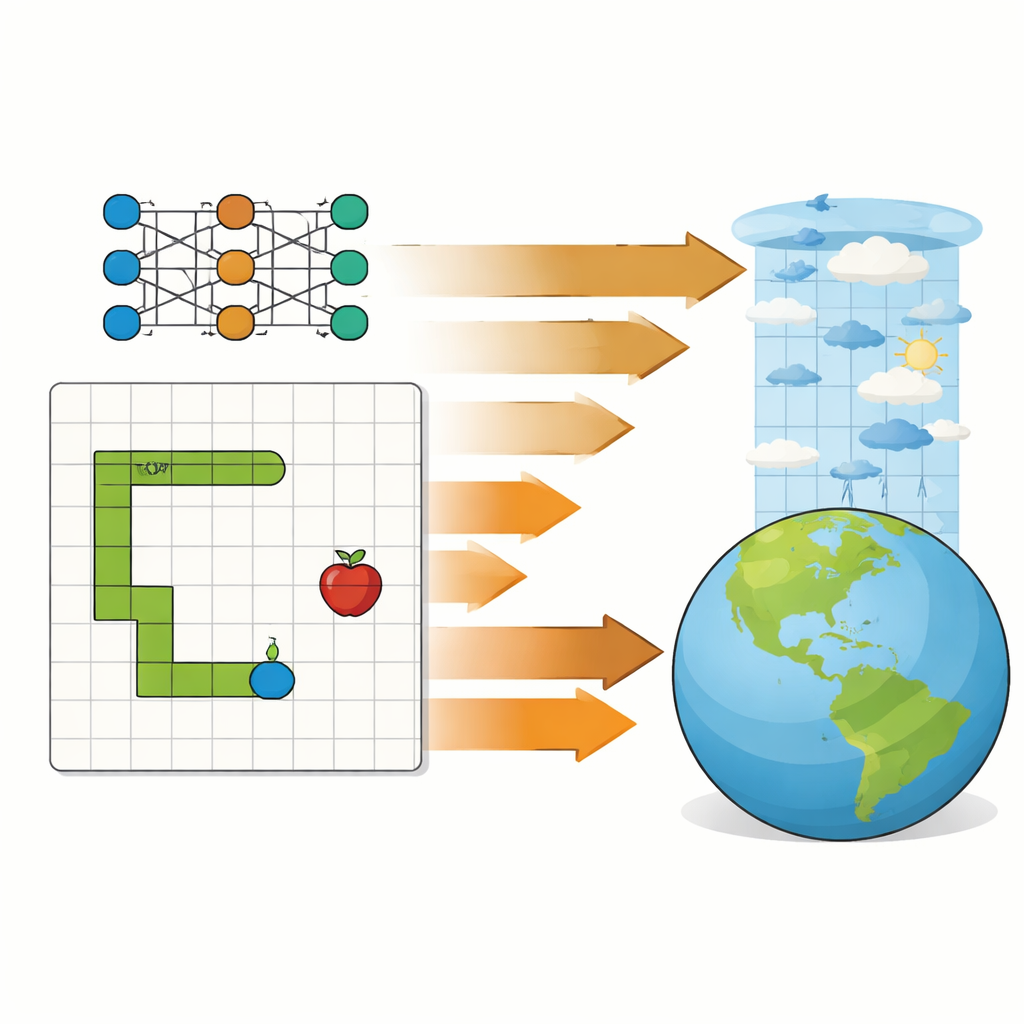

Les prévisions météorologiques, les modèles climatiques et l’intelligence artificielle pour jeux peuvent sembler appartenir à des mondes différents, et pourtant ils reposent sur le même moteur caché : ajuster à plusieurs reprises un modèle afin qu’il corresponde mieux à ce qui se produit réellement. Cet article ouvre cette boîte noire. En utilisant comme banc d’essai un simple jeu vidéo Snake, l’auteur montre — visuellement et pas à pas — que la manière dont un algorithme d’apprentissage améliore son jeu reflète étroitement la façon dont les météorologues affinent les prévisions en utilisant des observations. Le résultat est un pont clair et intuitif entre l’IA moderne et des méthodes bien établies en sciences de l’atmosphère.

Deux mondes partageant un même moteur caché

En prévision numérique du temps, l’assimilation variationnelle des données sert à combiner un modèle physique de l’atmosphère avec des observations réelles. Les scientifiques font fonctionner le modèle de prévision vers l’avant dans le temps, le comparent aux mesures, puis propagent l’information issue de ces écarts en arrière pour ajuster les conditions initiales du modèle. L’apprentissage par renforcement profond, qui alimente des systèmes capables d’apprendre à jouer ou à piloter des robots, fait également tourner un modèle vers l’avant : un agent prend des actions, reçoit des récompenses ou des pénalités, puis renvoie de l’information en arrière à travers un réseau neuronal pour modifier ses paramètres internes. L’article soutient que, sous des jargons différents, les deux processus accomplissent le même type de travail : minimiser un score unique qui mesure la qualité du système sur une séquence entière d’événements.

Un jeu simple comme laboratoire propre

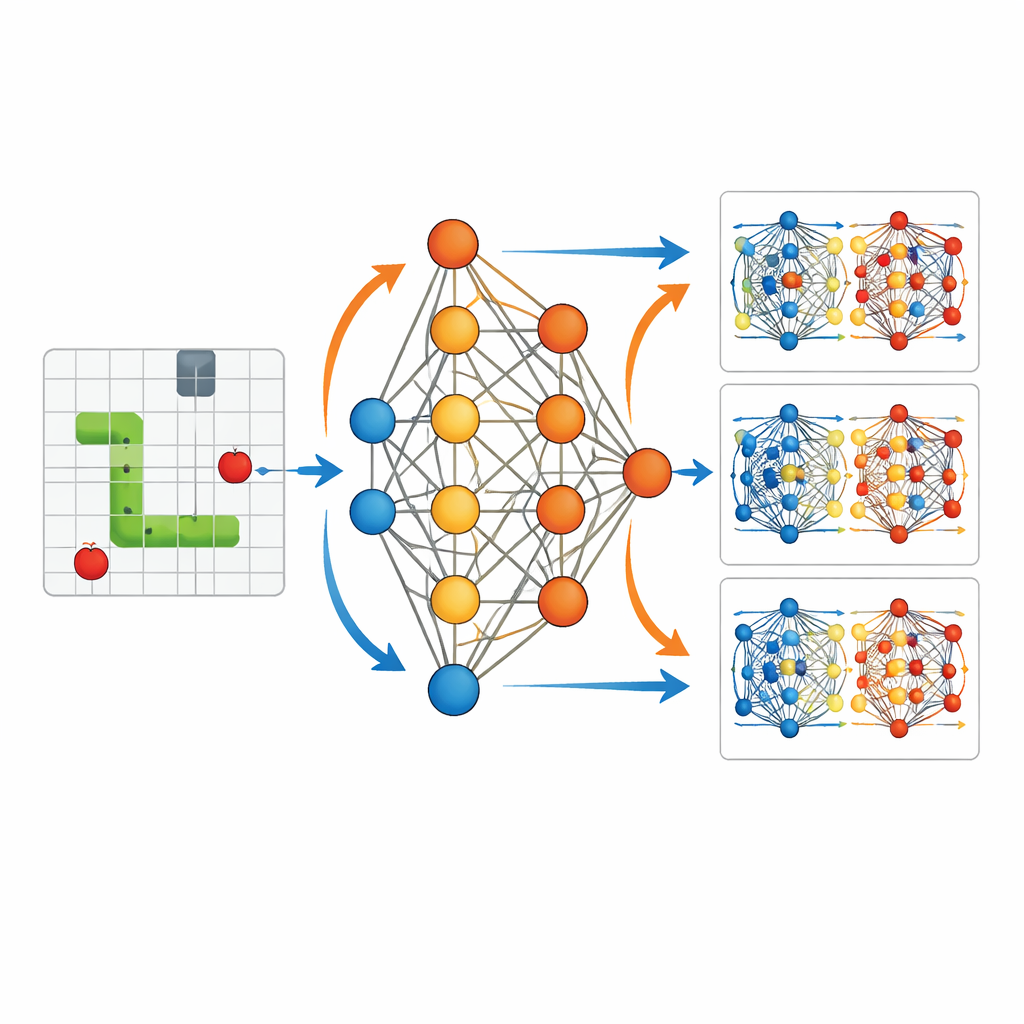

Pour rendre cette connexion concrète, l’étude utilise un cadre épuré : un agent d’IA apprenant à jouer au Snake classique. L’agent voit une description compacte de son environnement — où se trouvent la nourriture, les murs et son propre corps par rapport à sa tête — et transmet ces 11 bits d’information à un petit réseau neuronal à une couche cachée. Le réseau propose trois options : tourner à gauche, aller tout droit ou tourner à droite. Chaque fois que le serpent mange de la nourriture, l’agent reçoit une récompense positive ; s’il heurte un mur ou son propre corps, il obtient une récompense négative et la partie se termine. De façon cruciale, l’auteur enregistre chaque paramètre de ce réseau — 3 584 au total — à chaque étape d’entraînement, de sorte que l’ensemble du processus d’apprentissage puisse être rejoué et inspecté en détail.

Observer l’apprentissage de l’intérieur

Avec cet enregistrement complet, l’article visualise comment les « poids » internes du réseau évoluent au fur et à mesure que le serpent apprend. Au début, les actions sont presque aléatoires et les mises à jour des poids sont éparses et faibles. Au fil de nombreuses parties, à mesure que l’agent explore la grille et accumule succès et échecs, ces mises à jour commencent à former des motifs structurés. Les trajectoires du serpent deviennent plus longues et plus orientées vers la nourriture. L’étude montre que chaque petit sursaut d’apprentissage après un mouvement ressemble à une correction à courte portée : l’information provenant des récompenses immédiates se propage en arrière pour ajuster les paramètres qui ont produit ce mouvement. Périodiquement, le système réutilise aussi des expériences de parties précédentes, recomputant la qualité de ces anciens choix au regard des paramètres récents. Cela ressemble à la manière dont les centres météorologiques linéarisent et ré-optimisent à plusieurs reprises autour d’une prévision mise à jour dans l’assimilation variationnelle des données en quatre dimensions.

Du vagabondage aléatoire au mouvement intentionnel

Le contraste entre agents entraînés et non entraînés rend l’effet de ces mises à jour cachées facile à voir. Sans entraînement, le serpent erre près de son point de départ, heurtant des murs ou lui-même sans stratégie apparente. Après entraînement, la même architecture de réseau produit des trajectoires fluides et ciblées qui se dirigent activement vers la nourriture tout en évitant le danger. Les visualisations des changements de paramètres montrent que les récompenses à des instants précis renforcent ou affaiblissent sélectivement certaines connexions du réseau, organisant ainsi son comportement. Cela reflète la manière dont l’information d’observation en assimilation de données remodèle progressivement les conditions initiales d’un modèle pour que les prévisions suivent des trajectoires plus cohérentes avec la réalité.

Ce que l’étude montre réellement

Ce travail n’introduit pas un nouvel algorithme d’apprentissage ni une nouvelle méthode de prévision météorologique. Il propose plutôt une image claire et didactique d’un principe partagé : tant l’apprentissage par renforcement profond que l’assimilation variationnelle des données exécutent à plusieurs reprises un modèle vers l’avant, évaluent sa performance, puis renvoient cette information en arrière pour améliorer un ensemble de quantités ajustables. Dans Snake, ces quantités sont des poids de réseau neuronal qui codent une stratégie ; en prévision météorologique, ce sont les états atmosphériques qui servent de semence à la prévision. En rendant visible le flux inverse d’information dans un système petit et entièrement observable, l’article donne aux climatologues une intuition plus directe des dynamiques de l’apprentissage automatique moderne et aide les chercheurs en IA à apprécier la longue histoire d’idées similaires en géoscience.

Citation: Wang, KY. Visualising backward information propagation in deep reinforcement learning from a variational data assimilation perspective. Sci Rep 16, 11581 (2026). https://doi.org/10.1038/s41598-026-42086-x

Mots-clés: apprentissage par renforcement, assimilation de données, réseaux neuronaux, prévision météorologique, optimisation