Clear Sky Science · sv

Visualisering av bakåtgående informationspropagering i djup förstärkningsinlärning ur ett variationalt dataassimilationsperspektiv

Varför detta spelar roll bortom datavetenskap

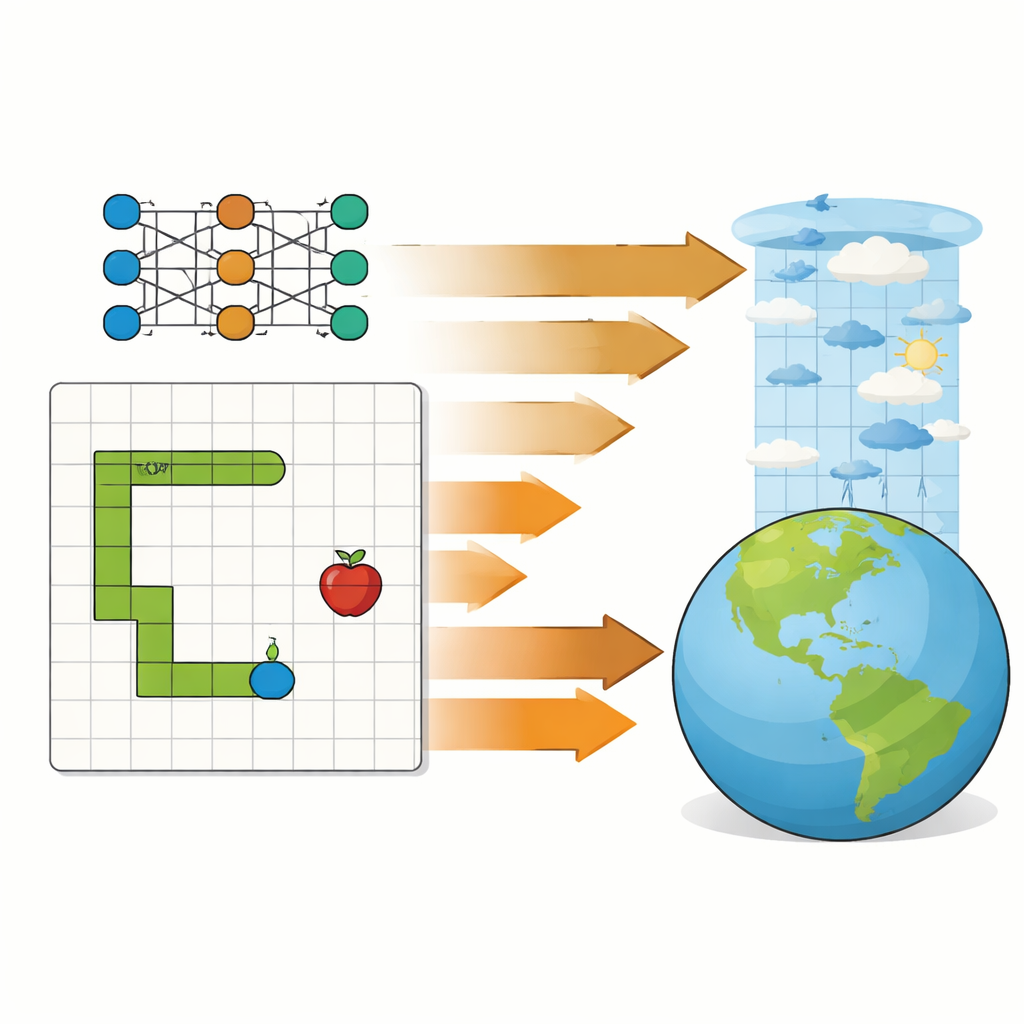

Väderprognoser, klimatmodeller och spelande artificiell intelligens kan verka vara vitt skilda områden, men de bygger på samma dolda motor: att upprepade gånger justera en modell så att den bättre överensstämmer med vad som faktiskt händer. Denna artikel öppnar den svarta lådan. Med det enkla spelet Snake som testbädd visar författaren—visuellt och steg för steg—att sättet ett inlärningsalgoritm förbättrar sitt spel på i hög grad speglar hur meteorologer förfinar väderprognoser med observationsdata. Resultatet är en tydlig, intuitiv brygga mellan modern AI och långvariga metoder inom atmosfärvetenskapen.

Två världar med en gemensam dold motor

I numerisk väderprognos används variational dataassimilation för att kombinera en fysisk atmosfärmodell med verkliga observationer. Forskare kör prognosmodellen framåt i tiden, jämför den med mätningar och propagerar sedan informationen från dessa mismatch bakåt för att justera modellens startvillkor. Djup förstärkningsinlärning, som driver system som lär sig spela spel eller styra robotar, kör också en modell framåt: en agent utför handlingar, får belöningar eller straff och skickar sedan information bakåt genom ett neuronätverk för att finjustera sina interna parametrar. Artikeln hävdar att, under den olika terminologin, utför båda processerna samma slags arbete—minimerar en enda poäng som mäter hur väl systemet presterar över en hel sekvens av händelser.

Ett enkelt spel som ett rent laboratorium

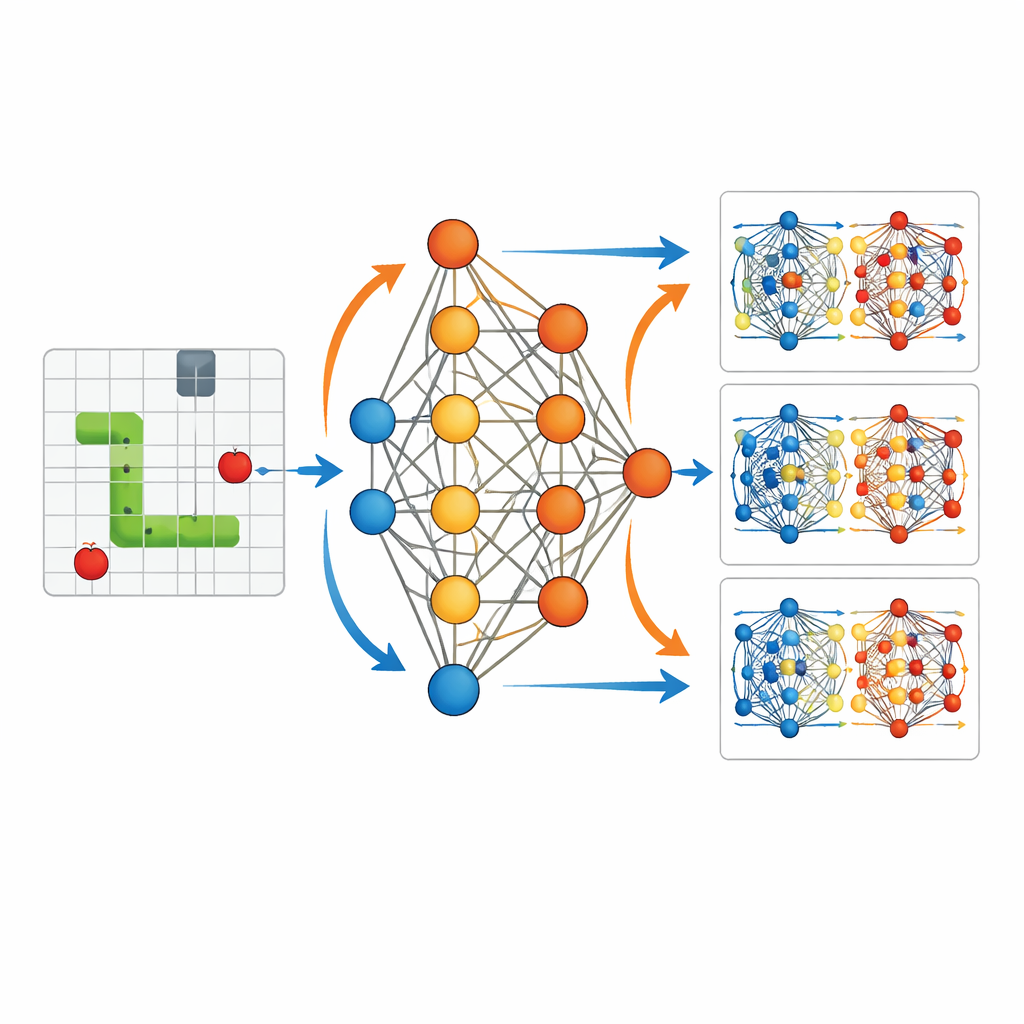

För att göra denna koppling konkret använder studien en avskalad miljö: en AI-agent som lär sig spela det klassiska spelet Snake. Agenten ser en kompakt beskrivning av sin omgivning—var mat, väggar och dess egen kropp ligger i förhållande till huvudet—och matar in dessa 11 informationsbitar i ett litet neuronätverk med ett dolt lager. Nätverket ger tre utgångsalternativ: sväng vänster, gå rakt fram eller sväng höger. Varje gång ormen äter mat får agenten en positiv belöning; om den kraschar in i en vägg eller i sig själv får den en negativ belöning och spelet avslutas. Avgörande är att författaren spelar in varje enskild parameter i detta nätverk—3 584 totalt—vid varje träningssteg, så att hela inlärningsprocessen kan spelas upp och inspekteras i detalj.

Att se inlärning ske inifrån

Med denna fullständiga inspelning visualiserar artikeln hur nätverkets interna "vikter" förändras när ormen lär sig. Tidigt är handlingarna nästan slumpmässiga och viktuppdateringarna är utspridda och små. Efter många spel, när agenten utforskar rutan och upplever många framgångar och misslyckanden, börjar dessa uppdateringar bilda strukturerade mönster. Ormens banor blir längre och mer riktade mot maten. Studien visar att varje liten inlärningsstöt efter ett drag är som en kortdistanskorrektur: information från omedelbara belöningar drar sig bakåt för att justera de parametrar som producerade det draget. Periodvis återanvänder systemet också tidigare spela erfarenheter och beräknar om hur bra eller dåliga de gamla valen ser ut under de senaste parametrarna. Detta liknar hur vädercenter upprepade gånger lineariserar och re-optimerar kring en uppdaterad prognos i fyrdimensionell variational dataassimilation.

Från slumpartat irrande till målinriktad rörelse

Kontrasten mellan tränade och otränade agenter gör effekten av dessa dolda uppdateringar lätt att se. Utan träning rör sig ormen kring startpunkten, stöter i väggar eller i sig själv utan någon uppenbar strategi. Efter träning producerar samma nätverksstruktur släta, målmedvetna banor som aktivt söker upp maten samtidigt som den undviker faror. Visualiseringar av parameterförändringar visar att belöningar vid specifika tidpunkter selektivt förstärker eller försvagar särskilda kopplingar i nätverket och organiserar dess beteende. Detta speglar hur observationsinformation i dataassimilation gradvis omformar modellens initiala tillstånd så att prognoser följer banor mer förenliga med verkligheten.

Vad studien egentligen visar

Arbetet introducerar inte en ny inlärningsalgoritm eller ett nytt sätt att förutsäga vädret. I stället erbjuder det en tydlig, didaktisk bild av en gemensam princip: både djup förstärkningsinlärning och variational dataassimilation kör upprepade gånger en modell framåt, mäter hur väl den presterade och skickar sedan den informationen bakåt för att förbättra någon uppsättning justerbara storheter. I Snake är dessa storheter neuronätverksvikter som kodar en strategi; i väderprognoser är de de atmosfäriska tillstånd som utgör en prognos initialisering. Genom att göra det bakåtriktade informationsflödet synligt i ett litet, fullt observerbart system ger artikeln atmosfärforskare en mer intuitiv känsla för modern maskininlärningsdynamik och hjälper AI-forskare att uppskatta den långa historien av liknande idéer inom geovetenskaperna.

Citering: Wang, KY. Visualising backward information propagation in deep reinforcement learning from a variational data assimilation perspective. Sci Rep 16, 11581 (2026). https://doi.org/10.1038/s41598-026-42086-x

Nyckelord: förstärkningsinlärning, dataassimilering, neuronätverk, väderprognoser, optimering