Clear Sky Science · tr

Çift asimetrik momentum, uç sistemlerde federated sınıf unutmayı geliştiriyor

Makinelere unutmayı öğretmenin önemi

Telefonlarımız, saatlerimiz ve ev cihazlarımız bize verdiğimiz verilerden—fotoğraflardan ses kayıtlarına, sağlık ölçümlerine kadar—sürekli öğrenir. Peki ya yasalar veya kullanıcılar belirli verilerin sadece depolamadan değil, ilgili yapay zeka modellerinin davranışından da silinmesini isterse ne olur? Bu modelleri en baştan yeniden eğitmek yavaş, pahalı ve milyonlarca küçük aygıtta bazen gerçekçi olmayabilir. Bu makale, büyük, dağıtık öğrenme sistemlerinin seçilmiş bilgileri “unutmasını” daha hafif bir yöntemle sağlamayı ve geri kalan her şeyde iyi çalışmayı sürdürmeyi araştırıyor.

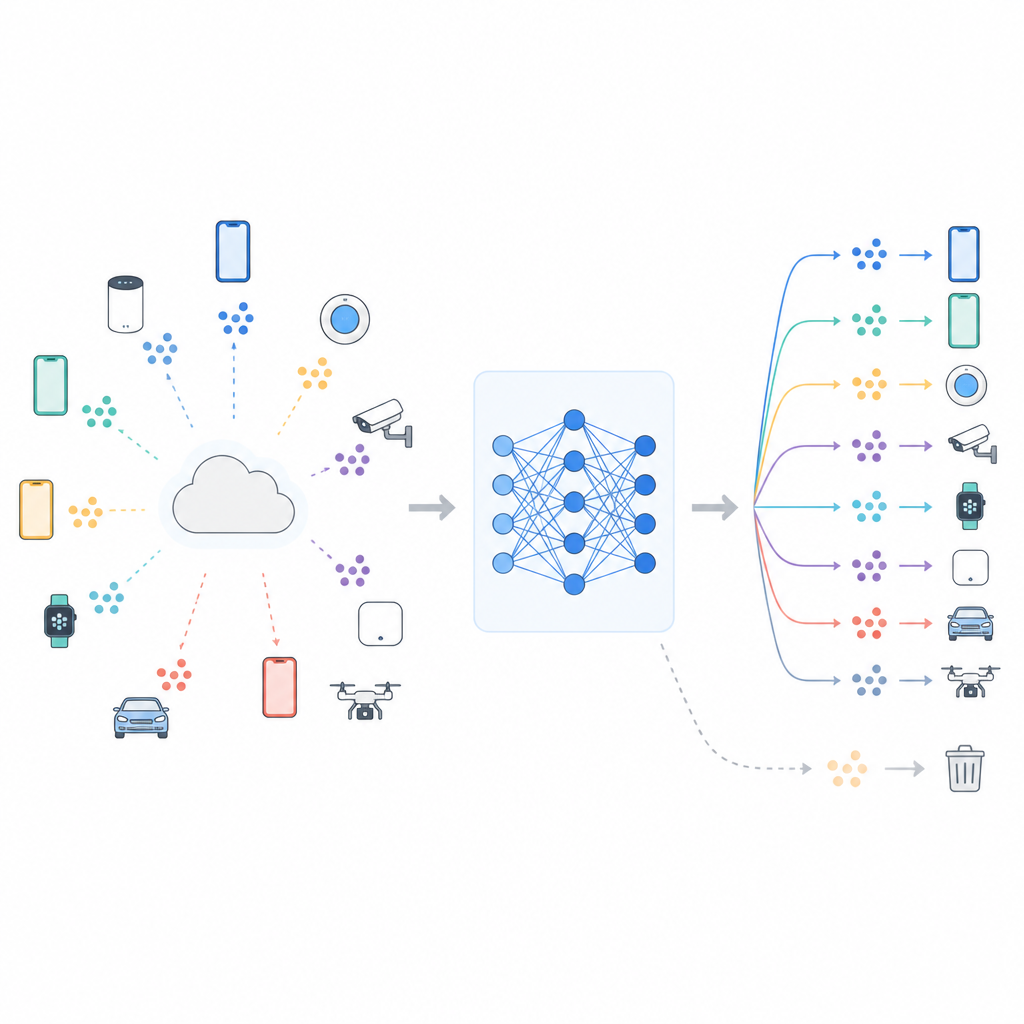

Verinizi paylaşmadan birlikte öğrenmek

Birçok modern sistem, ham verinin her aygıtta kaldığı ve merkezi bir sunucunun eğitimi koordine ettiği federated learning kullanır. Telefonlar veya sensörler yerel verileriyle paylaşılan bir modeli günceller, sonra yalnızca model değişikliklerini geri gönderir. Bu düzen gizliliği korumaya ve bant genişliğinden tasarruf etmeye yardımcı olur, ama tüm riski ortadan kaldırmaz. Model hâlâ neleri gördüğüne dair izler taşıyabilir ve araştırmalar akıllıca saldırıların bazen belirli verilerin eğitimde kullanılıp kullanılmadığını tespit edebildiğini gösteriyor. Avrupa’nın unutulma hakkı gibi büyüyen gizlilik kuralları bu nedenle, bir modelin belirli verilere, örneğin bir görüntü sınıfına veya belirli bir kullanıcı grubuna olan bağımlılığını azaltan “makine unutma” prosedürlerine baskı oluşturdu.

Gerçekte unutmanın neden zor olduğu

Teoride, en temiz çözüm istenmeyen verileri atmak ve modeli yalnızca kalan bilgilerle baştan yeniden eğitmektir. Pratikte ise tam yeniden eğitim büyük iletişim maliyetleri, çok sayıda istemci arasında tekrarlanan koordinasyon ve özellikle veriler aygıtlar arasında düzensiz dağıldığında uzun çalışma süreleri demektir. Buna ek olarak, bir bilgiyi unutturmaya çalışmak diğer her şeyde performansı zedeleyebilir; çünkü aynı model parametreleri her ikisini de destekler. Yazarlar, iç eğitim mekanizmasının—özellikle zaman içinde güncellemeleri düzelten optimizasyon momentum durumunun—unutma ve koruma sinyallerini karıştırabileceğini ve bir sınıfı silme çabalarının modelin diğer becerileriyle çatışabildiğini gösteriyor.

Unutma için daha hafif bir ek başlık

Önerilen yöntem FedDAM, zaten eğitilmiş modelin yalnızca küçük bir kısmını değiştirerek bu zorluklarla başa çıkıyor. Verilerden özellik çıkaran ana ağ ve orijinal sınıflandırıcı yerinde dondurulur. Bunların üzerine, nihai tahminleri kontrollü şekilde ayarlamakla görevli yeni ve küçük bir “yardımcı başlık” eklenir. Unlearning sırasında yalnızca bu yardımcı başlık güncellenir ve aygıtlar arasında paylaşılıp, tam modeli yeniden eğitmeye kıyasla iletişim ve hesaplama ihtiyaçlarını büyük ölçüde azaltır. Nihai skor düzeyinde çalışarak yöntem hedef sınıf için karar sınırlarını kaydırabilirken derin özellik çıkarıcıyı dokunulmamış bırakır; bu da kaynak kısıtlı telefonlar ve uç aygıtlar için cazip kılar.

Koruma ve unutma için iki bellek akışı

FedDAM’deki temel teknik fikir, unutmayı isteyen kuvvetleri korumayı isteyenlerden ayırmaktır. Her katılımcı istemci yerel verilerini “koru” ve “unut” setlerine böler ve ardından her birine dayalı güncellemeleri sırayla uygular. Her ikisini tek bir momentum durumuna vermek yerine yöntem iki ayrı momentum tamponu tutar: biri koruma için, diğeri unutma için; ve yardımcı başlık güncellenirken bunları asimetrik şekilde birleştirir. Unutma güncellemelerine daha kısa bir bellek ve biraz daha yüksek ağırlık verilir; böylece model silinmesi gereken verileri gördüğünde hızlı tepki verirken korunan verilerin daha sessiz çekişini de dinlemeye devam eder. Deneylerle yazarlar bu çift akışın iki hedef arasındaki doğrudan çatışmayı azalttığını ve güncellemeleri istenen unutma davranışına daha yakın hale getirdiğini gösteriyor.

Seçici unutmanın pratikteki performansı

Takım FedDAM’i CIFAR-10, CIFAR-100 ve orta ölçekli ImageNet-100 dahil standart görüntü koleksiyonları üzerinde, her istemcinin verinin yalnızca bir dilimine sahip olduğu ve bazı istemcilerin unutulması gereken örneklerin hiçbirine sahip olmayabileceği gerçekçi federated koşullar altında test ediyor. Yöntemlerini tek paylaşılan momentum kullananlar, çelişen gradyanları projekte edenler veya çakışan yönleri temizleyenler gibi birkaç alternatife ve sıkıştırılmış tam model yeniden eğitimine karşı karşılaştırıyorlar. Bu çalışmalarda FedDAM, benzer unutma düzeylerinde korunan sınıflarda tutarlı şekilde daha iyi doğruluk sağlıyor; daha zor, daha çeşitli veri kümelerinde yaklaşık 7–9 puanlık kazançlar görüyorlar. Aynı zamanda tam yeniden eğitime göre, hatta o agresifçe sıkıştırılmış olsa bile, çok daha az iletişim ve çalışma süresi kullanıyor.

Günlük aygıtlar için bunun anlamı

Uzman olmayanlar için ana mesaj, öğrenme sistemlerinin belirli veri kategorilerini daha esnek biçimde sonradan “unutabilecek” şekilde tasarlanmasının mümkün olduğudur; yeniden başlamaya gerek kalmadan ve diğer her şeyde performansı aşırı zedelemeden. FedDAM, modeli büyük ölçüde dondurarak, yalnızca küçük bir yardımcı başlığı ayarlayarak ve saklamak istediğimiz verilerin etkilerini unutmak istediğimiz verilerden dikkatlice ayırarak federated ve uç ortamlarda bunu yapmanın pratik bir tarifini sunuyor. Her ne kadar resmi gizlilik garantileri sağlamıyor ve her türlü silme isteğini karşılayamıyor olsa da, yaklaşım hiçbir şey yapmamak ile yeniden eğitmenin tüm maliyetini ödemek arasında yararlı bir orta yol sunarak makine unutma fikrini gerçek dünya dağıtımına daha yakınlaştırıyor.

Atıf: Patra, A., Mayaluri, Z.L., Sahoo, P.K. et al. Dual asymmetric momentum improves federated class unlearning in edge systems. Sci Rep 16, 14748 (2026). https://doi.org/10.1038/s41598-026-45631-w

Anahtar kelimeler: federated öğrenme, makine unutma, uç bilişim, Yapay zekada gizlilik, sinir ağları