Clear Sky Science · ja

エッジシステムにおけるフェデレーテッドクラス消去を改善する二重非対称モーメンタム

機械に忘れさせることが重要な理由

私たちのスマートフォン、時計、家庭用機器は、写真や音声、健康データなど、与えたデータから常に学習しています。しかし、法律やユーザーの要請で特定のデータを単に保存から消すだけでなく、AIモデルの振る舞いそのものから消去する必要が生じたらどうなるでしょうか?モデルを最初から再訓練するのは時間がかかり、高価で、数百万台の小さなデバイスでは現実的でないこともあります。本稿は、大規模で分散した学習システムが選択された情報を“忘れる”ための、より軽量な手法を検討します。それによって他の性能を維持できます。

データを共有せずに一緒に学ぶ

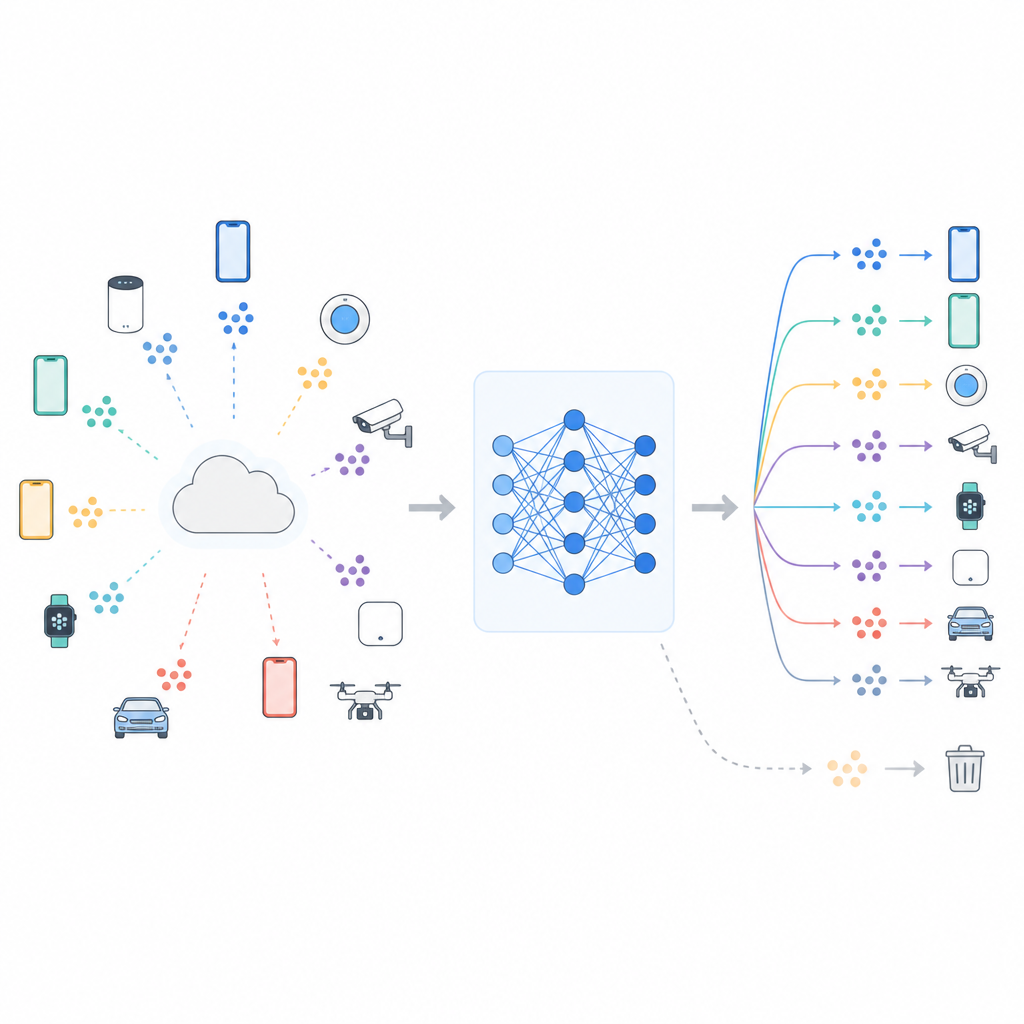

多くの現代的なシステムはフェデレーテッドラーニングを用いており、中央サーバーが学習を調整する一方で生データは各デバイスに残ります。携帯やセンサーはローカルデータで共有モデルを更新し、モデルの変化だけを送信します。この仕組みはプライバシー保護と帯域節約に寄与しますが、リスクが完全になくなるわけではありません。モデルには何を見たかの痕跡が残り得て、巧妙な攻撃により特定のデータが学習に使われたかどうかを推定されることが示されています。欧州の「忘れられる権利」のような厳格化するプライバシー規則は、画像のあるクラスや特定ユーザー群など、指定データへのモデル依存を減らす“機械的消去”手続きへの圧力を生んでいます。

現実世界での消去が難しい理由

理論的には、最もきれいな解は不要なデータを捨てて、残った情報だけでモデルを最初から再訓練することです。しかし実際には、完全な再訓練は膨大な通信コスト、複数クライアント間の繰り返し調整、長い実行時間を意味し、とくにデータがデバイス間で偏在している場合は問題が深刻になります。さらに、ある知識を忘れさせようとすると、同じモデルパラメータが残りの能力も支えているため、他の性能が損なわれることがあります。著者らは、特に更新を時間で平滑化するオプティマイザのモーメンタム状態のような内部学習メカニズムが「忘却」と「保持」の信号を混同させ、あるクラスを消去しようとする試みがモデルの他の技能と干渉することを示しています。

忘却のための軽量な追加ヘッド

提案手法FedDAMは、既に訓練済みのモデルの一部だけを変更することでこれらの課題に対処します。データから特徴を抽出する主要ネットワークと元の分類器は固定されます。その上に、小さな“補助ヘッド”を追加し、最終出力を制御された形で調整する役割を与えます。消去処理中に更新・共有されるのはこの補助ヘッドのみであり、モデル全体を再訓練する場合に比べて通信と計算を大幅に削減します。最終スコアのレベルで直接働くことで、対象クラスの判定境界を移動させつつ深い特徴抽出器をそのままにしておけるため、資源制約のある携帯やエッジデバイスに向いた手法です。

保持と忘却のための二つの記憶の流れ

FedDAMの重要な技術的アイデアは、忘れたい力と保持したい力を分離することです。各クライアントはローカルデータを“保持”と“忘却”のセットに分け、交互に更新を行います。両者を一つのモーメンタム状態に流し込むのではなく、保持用と忘却用の二つの異なるモーメンタムバッファを維持し、補助ヘッドを更新する際に非対称に組み合わせます。忘却側の更新は記憶を短くしやや重みを大きく与えるため、消去すべきデータに触れたときにモデルが素早く反応し、一方で保持側の穏やかな引力も聞き続けます。実験を通じて、二重の流れは両目標間の直接的な衝突を減らし、更新を意図した忘却挙動により整合させることを示しています。

選択的忘却は実際にどれほど有効か

研究チームはFedDAMを、CIFAR-10、CIFAR-100、そして中規模のImageNet-100構成など標準的な画像データセットで評価しました。各クライアントがデータの一断片しか持たない現実的なフェデレーテッド条件下で、忘却対象の例を持たないクライアントが存在する場合も含みます。単一の共有モーメンタムを使う手法、矛盾する勾配を射影する手法、重複方向を消す手法、さらには圧縮したフルモデル再訓練と比較しました。これらの比較で、FedDAMは同等の忘却レベルで保持クラスの精度を一貫して高め、より難しく多様なデータセットでは約7〜9ポイントの改善を示しました。同時に、フル再訓練(たとえ強く圧縮した場合でも)よりはるかに少ない通信と実行時間で済みます。

日常的なデバイスにとっての意味

専門外の読者に向けた主なメッセージは、学習済みシステムが特定カテゴリのデータを後からより柔軟に“消去”でき、作り直すことなく他の性能を過度に損なわないように設計できる可能性がある、ということです。FedDAMは、モデルの大部分を固定し、補助ヘッドだけを調整し、保持したいデータと忘れたいデータの影響を慎重に分離することで、フェデレーテッドおよびエッジ環境でこれを実現する実用的な手法を提供します。正式なプライバシー保証を与えるものではなく、すべての削除要求に対処できるわけではありませんが、何もしないことと再訓練の全コストを支払うことの中間にある有用な選択肢を提示し、機械的消去を現実の運用に近づける助けになります。

引用: Patra, A., Mayaluri, Z.L., Sahoo, P.K. et al. Dual asymmetric momentum improves federated class unlearning in edge systems. Sci Rep 16, 14748 (2026). https://doi.org/10.1038/s41598-026-45631-w

キーワード: フェデレーテッドラーニング, 機械的消去, エッジコンピューティング, AIにおけるプライバシー, ニューラルネットワーク