Clear Sky Science · tr

SARS-CoV-2 virüs proteinlerinin adlandırılmış varlık tanıması için uyarlanabilir modülerleştirme BERT-SPAN modelinin optimizasyonu ve karşılaştırmalı araştırması

Makale içindeki protein adlarını bulmanın önemi

Her hafta COVID-19 ve onu oluşturan SARS-CoV-2 virüsüyle ilgili binlerce yeni bilimsel makale çevrimiçi olarak yayımlanıyor. Bu yoğun makalelerin içinde, virüsün hücrelerimizi enfekte etmesine yardımcı olan ve ilaçlar ile aşılar için başlıca hedefler olan proteinleri hakkında kritik ipuçları gizlenmiş durumda. Ancak hiçbir insan tümünü okuyamaz. Bu çalışma basit ama güçlü bir soruyu ele alıyor: bilgisayarlara metin içinde virüsün proteinlerini otomatik olarak, araştırmacıların yetişebilmesine yetecek hız ve doğrulukla tespit etmeyi öğretebilir miyiz?

Kalabalık metni kullanılabilir verilere dönüştürmek

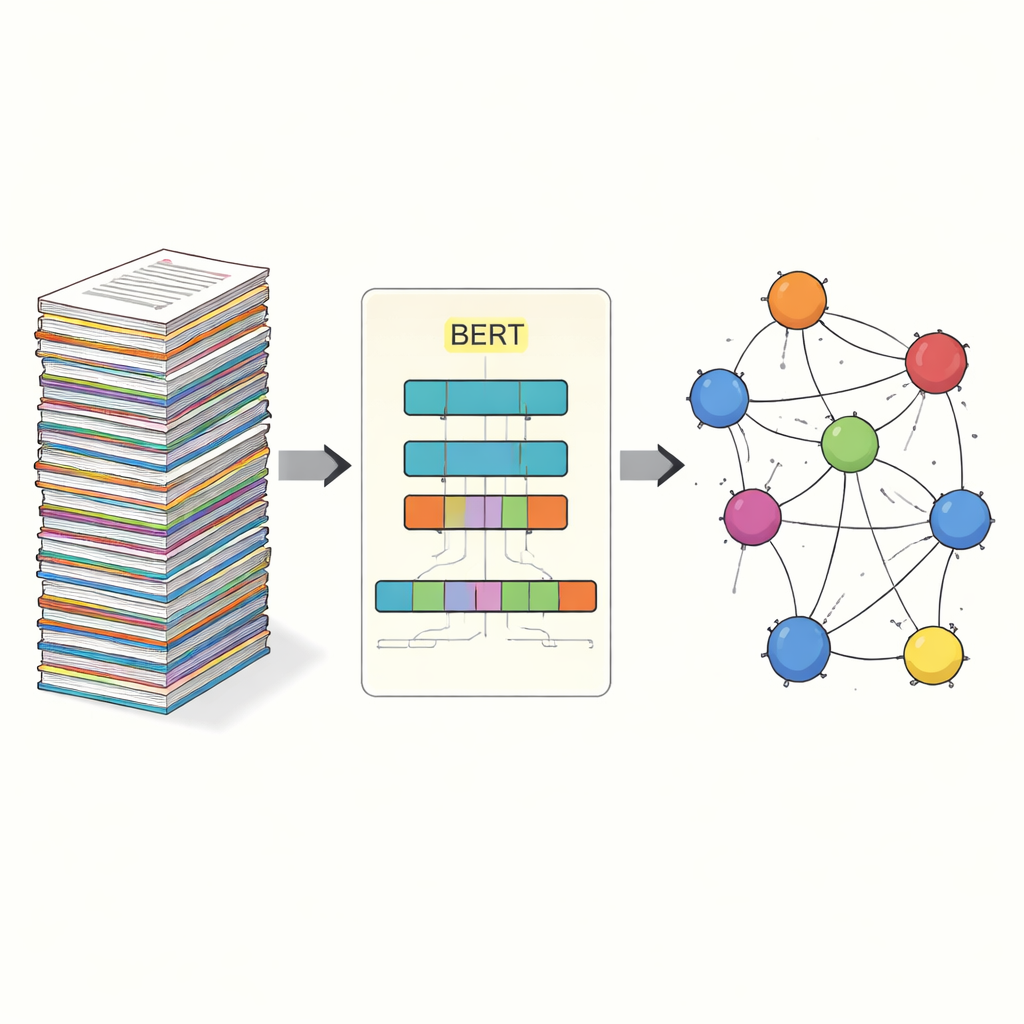

Bilim insanları SARS-CoV-2 hakkında yazarken, proteinlerinin tam adları, kısaltmaları ve takma adlarının kafa karıştırıcı bir karışımını kullanıyorlar. Aynı protein “spike protein”, “S” veya “spike’ın reseptör-bağlayıcı bölgesi” gibi ifadeler içinde görünebilir. Bu tür dili ölçeklendirilmiş şekilde anlamlandırmak için bilgisayarların önce bir “korpus”a—uzmanların her protein bahsini işaretlediği özenle etiketlenmiş cümle koleksiyonuna—ihtiyacı var. Yazarlar, PubMed’den yaklaşık 200.000 koronavirüs özetini tarayarak ve ilgili cümlelerdeki her SARS-CoV-2 protein bahsini elle etiketleyerek böyle bir kaynak oluşturdular. Temizleme ve çapraz doğrulama sonrasında eğitim ve test için yer doğruluğu sağlayan 7.159 cümle ve 12.660 etiketli protein bahsinden oluşan bir veri seti elde ettiler.

Makinelere virüs protein adlarını okumayı öğretmek

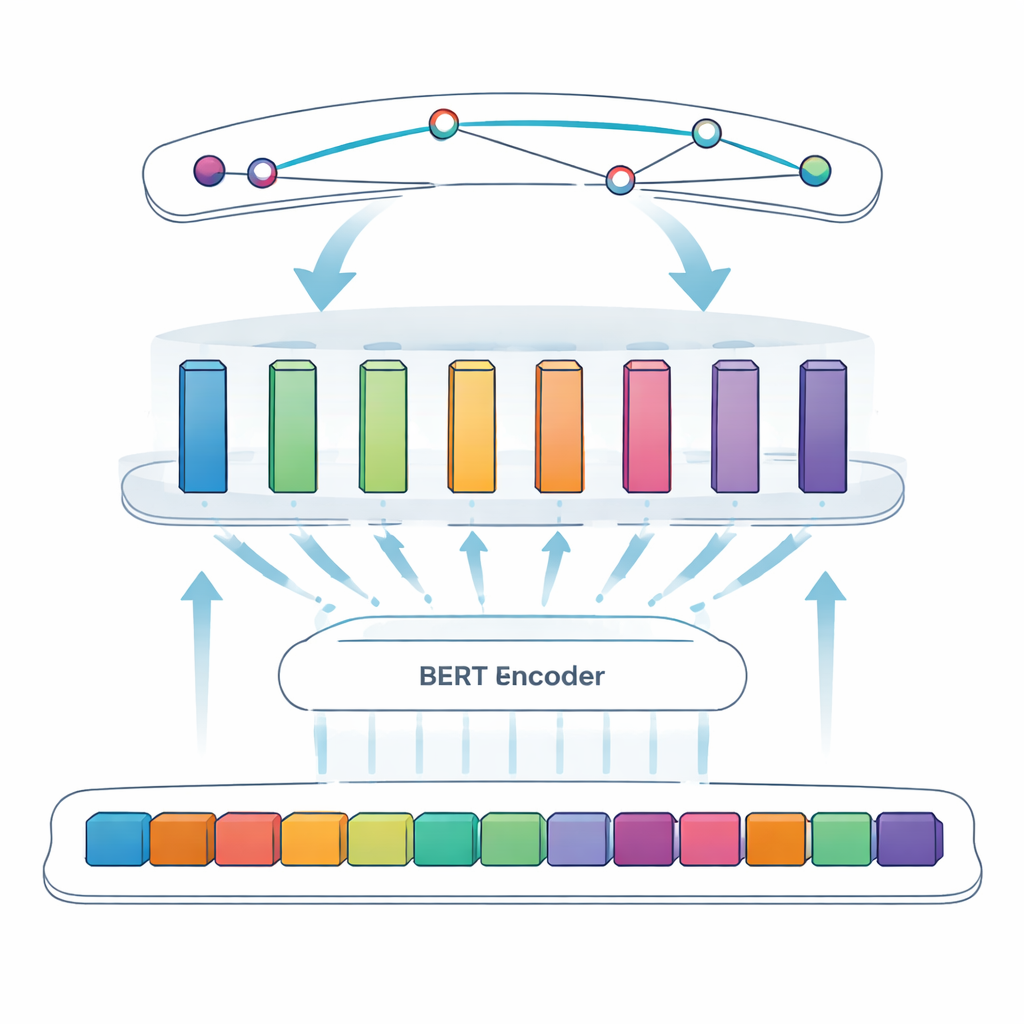

Bu çalışmadaki temel görev adlandırılmış varlık tanıma: serbest biçimli metinden belirli öğeleri—bu durumda viral proteinleri—seçebilecek bir bilgisayar sağlamak. Önceki yaklaşımlar elle hazırlanmış kurallara veya bilinen terim listelerine dayanıyordu ve adlandırma düzensiz olduğunda veya evrildiğinde başarısız oluyorlardı. Yeni sistemler derin öğrenmeyi kullanıyor; model örneklerden doğrudan kalıpları öğreniyor. Ekip, metni iki yönden birden okuyan ve kelimelerin bağlamına dayalı zengin temsil öğrenen BERT üzerine inşa ediyor. BERT’in üstüne bir “SPAN” yaklaşımı koyuyorlar: her token için tek tek içinde mi değil mi diye karar vermek yerine model doğrudan her protein bahsinin başlangıç ve bitiş pozisyonlarını tahmin ediyor. Bu, iç içe geçmiş veya çok kelimeli adlar gibi zor durumları ele almayı kolaylaştırıyor.

Modele akıllı yapı taşları eklemek

Sistemi daha da keskinleştirmek için yazarlar, BERT ile son span algılayıcısı arasına yerleşen birkaç küçük uzman modülden oluşan bir uyarlanabilir modüler ileri beslemeli katman tanıtıyorlar. Farklı modüller, kısa harfler gibi yüzeysel özellikler ya da bir “S” harfinin gerçekten bir protein adı olduğuna işaret eden ince bağlamsal ipuçları gibi farklı kalıplarda uzmanlaşıyor. Ardından uyarlanabilir ağırlıklandırma mekanizması, her cümle için hangi modüllere daha fazla güvenileceğine karar vererek onların çıktısını span tahmin aşamasından önce daha güçlü bir genel sinyale dönüştürüyor. Bu tasarım modele, her metin parçası için en bilgilendirici ipuçlarına esnekçe odaklanma olanağı sağlıyor.

Yöntemi teste sokmak

Araştırmacılar uyarlanabilir modüler BERT–SPAN modellerini popüler bir BiLSTM–CRF modeli ve modüler iyileştirmeler olmadan standart bir BERT–SPAN sürümü dahil olmak üzere birkaç yerleşik sistemle titizce karşılaştırdı. Doğruluk için standart ölçütleri kullanarak, geleneksel BiLSTM–CRF modelinin SARS-CoV-2 protein veri setlerinde yaklaşık %80.8 F1 puanına (kesinlik ve hatırlamanın dengesi) ulaştığını buldular. Sadece BERT–SPAN’e geçmek performansı %91.85’e çıkardı. Uyarlanabilir modüler katmanı eklemek F1 puanını daha da %93.66’ya yükseltti; bu, olgun bir alanda anlamlı bir kazanç. Mimarinin parçalarını tek tek kaldırarak yapılan dikkatli “ablation” deneyleri, modülerleştirmenin ve uyarlanabilir ağırlıklandırmanın gelişmeye katkıda bulunduğunu, özellikle sınır hatalarını ve benzer kısaltmalar arasındaki karışıklığı azalttığını gösterdi.

Bu çalışmanın gelecekteki araştırmalara katkısı

Günlük okuyucu için kilit sonuç, yazarların hem yüksek kaliteli bir veri seti hem de bilimsel metinde SARS-CoV-2 proteinlerini güvenilir şekilde tanıyabilen daha akıllı bir okuma motoru inşa etmiş olmaları. Dağınık dili yapılandırılmış varlık listelerine dönüştürerek sistem, bilgi grafikleri oluşturmayı, hangi viral proteinlerin hangi konak moleküllerle etkileştiğini eşleştirmeyi ve belirli hedeflere dair kanıtların nasıl biriktiğini izlemeyi çok daha kolay hale getiriyor. Pratik açıdan bu, bilgisayarların sıkıcı metin madenciliği işinin büyük kısmını üstlenebileceği ve insan uzmanların sonuçları yorumlamaya ve deney tasarlamaya odaklanabileceği anlamına geliyor. Çalışma, güçlü dil modellerini modüler, uyarlanabilir bileşenlerle eşleştirmenin biyomedikal literatürdeki bilgi selini ayıklamak için—yalnızca koronavirüs araştırmaları değil, bilimin okuma yeteneğimizi aştığı birçok gelecek zorluğunda—umut verici bir reçete olduğunu gösteriyor.

Atıf: Shi, X., Fei, Z., Nkhata, A. et al. Optimization and comparison research on adaptive modularization BERT-SPAN model for named entity recognition of SARS-CoV-2 virus proteins. Sci Rep 16, 14207 (2026). https://doi.org/10.1038/s41598-026-44317-7

Anahtar kelimeler: SARS-CoV-2 proteinleri, adlandırılmış varlık tanıma, biyomedikal metin madenciliği, BERT dil modeli, bilgi grafikleri