Clear Sky Science · sv

Optimerings- och jämförande forskning om adaptiv modulär BERT-SPAN-modell för namngivningsigenkänning av SARS-CoV-2-virusproteiner

Varför det är viktigt att hitta proteinnamn i artiklar

Varje vecka publiceras tusentals nya vetenskapliga artiklar om COVID-19 och dess virus, SARS-CoV-2. Dolda i dessa täta texter finns viktiga ledtrådar om virusets proteiner—molekylära maskiner som hjälper det att infektera våra celler och som är centrala mål för läkemedel och vacciner. Men ingen människa kan läsa allt. Denna studie tar sig an en enkel men kraftfull fråga: kan vi lära datorer att automatiskt hitta och lista virusets proteiner i text, tillräckligt snabbt och noggrant för att hjälpa forskare att följa utvecklingen?

Att göra trängd text till användbar data

När forskare skriver om SARS-CoV-2 använder de en förvirrande blandning av fullständiga namn, förkortningar och smeknamn för dess proteiner. Samma protein kan dyka upp som ”spike protein”, ”S” eller inne i fraser som ”receptor-binding domain of spike”. För att förstå sådan språkbruk i stor skala behöver datorer först ett korpus—en noggrant märkt samling meningar där experter markerat varje proteinomnämnande. Författarna byggde en sådan resurs genom att granska omkring 200 000 coronavirusabstract från PubMed och sedan manuellt märka varje SARS-CoV-2-proteinomnämnande i relevanta meningar. Efter rensning och korskontroll slutade de med 7 159 meningar och 12 660 märkta proteinomnämnanden som utgör referensdata för träning och testning av algoritmer.

Att lära maskiner att läsa virusproteinnamn

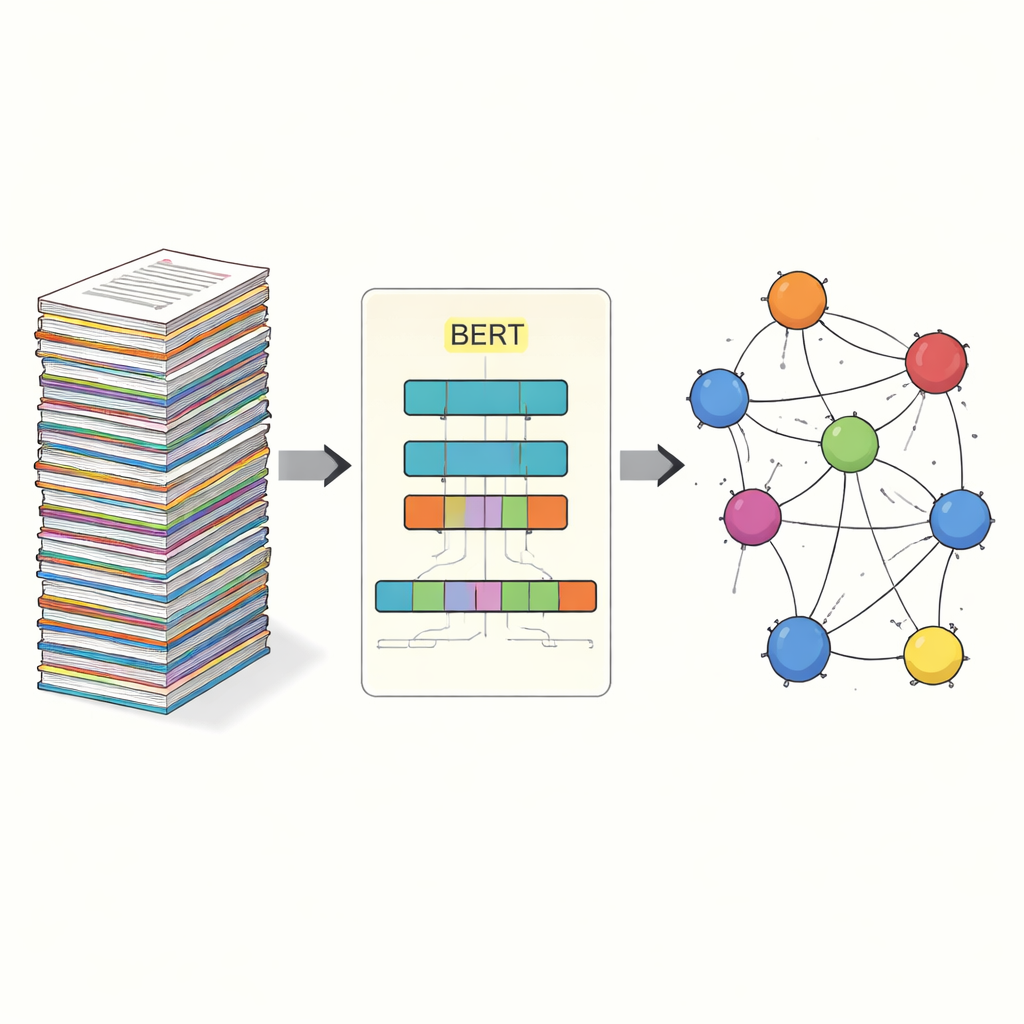

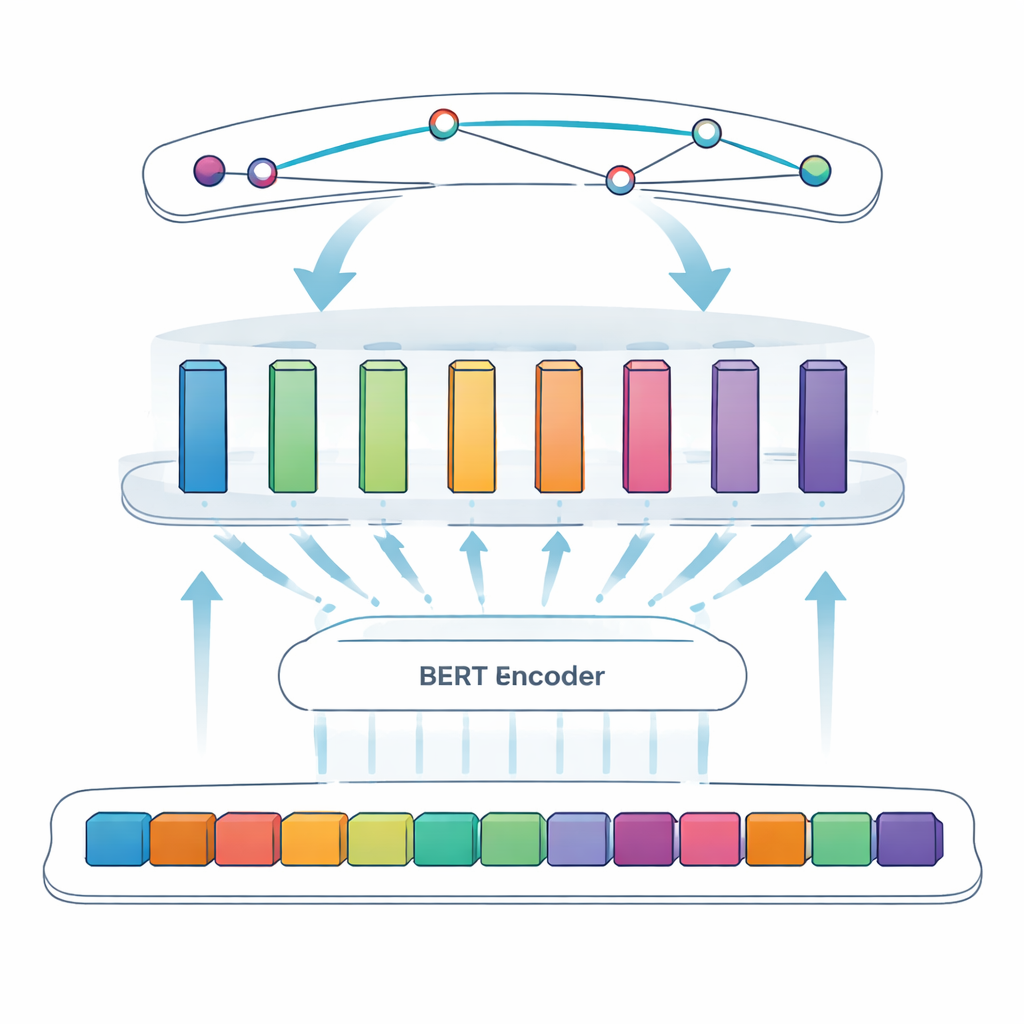

Kärnuppgiften i denna studie kallas named entity recognition: att få en dator att plocka ut specifika objekt—i detta fall virusproteiner—från fri text. Tidigare tillvägagångssätt byggde på manuellt utformade regler eller listor över kända termer, vilket fallerar när namngivningen är oregelbunden eller förändras. Nyare system använder djupinlärning, där en modell lär sig mönster direkt från exempel. Teamet bygger vidare på BERT, en språkmodell som läser text i båda riktningarna samtidigt och lär sig rika representationer av ord utifrån deras kontext. Ovanpå BERT använder de en ”SPAN”-metod: istället för att token-för-token avgöra om varje del ingår i en enhet, förutspår modellen direkt start- och slutpositionerna för varje proteinomnämnande. Det gör det lättare att hantera knepiga fall som nästlade eller flerdelade namn.

Att lägga till smarta byggstenar i modellen

För att ytterligare skärpa systemet introducerar författarna ett adaptivt modulärt feedforward-lager, som kan betraktas som flera små expertmoduler som sitter mellan BERT och den slutliga span-detektorn. Olika moduler specialiserar sig på olika typer av mönster—till exempel ytliga drag som bindestreck och blandning av bokstäver och siffror, eller subtila kontextuella ledtrådar som signalerar när en kort bokstav som ”S” faktiskt är ett protein. En adaptiv viktning mekanism avgör sedan, för varje mening, vilka moduler som ska litas mer på och kombinerar deras utgångar till en starkare samlad signal innan span-förutsägelsen. Denna utformning låter modellen flexibelt fokusera på de mest informativa ledtrådarna för varje specifika textstycke.

Att pröva metoden

Forskarna jämförde noggrant sin adaptiva modulära BERT–SPAN-modell med flera etablerade system, inklusive en populär BiLSTM–CRF-modell och en standard BERT–SPAN-version utan modulära förbättringar. Med standardmått för noggrannhet fann de att den traditionella BiLSTM–CRF-modellen nådde ett F1-värde (en balans mellan precision och recall) på cirka 80,8 procent på deras SARS-CoV-2-proteindataset. Att byta till BERT–SPAN ensam höjde prestandan till 91,85 procent. Att lägga till det adaptiva modulära lagret pressade F1 ytterligare till 93,66 procent, en meningsfull förbättring i ett redan moget område. Omsorgsfulla ablationsstudier—där delar av arkitekturen tas bort en i taget—visade att både modularisering och adaptiv viktning bidrog till förbättringen, särskilt genom att minska gränsfel och förväxlingar mellan liknande förkortningar.

Hur detta hjälper framtida forskning

För en icke-specialist är huvudresultatet att författarna byggt både ett högkvalitativt dataset och en smartare läsmotor som pålitligt kan känna igen SARS-CoV-2-proteiner i vetenskaplig text. Genom att omvandla rörigt språk till strukturerade listor av entiteter underlättar deras system kraftigt för att bygga kunskapsgrafer, kartlägga vilka virusproteiner som interagerar med vilka värdmolekyler och följa hur bevis för specifika mål samlas. I praktiska termer innebär detta att datorer kan axla mer av det tråkiga textutvinningsarbetet, så att mänskliga experter kan fokusera på att tolka resultat och designa experiment. Studien visar att att para ihop kraftfulla språkmodeller med modulära, adaptiva komponenter är ett lovande recept för att sålla i den biomedicinska litteraturens flod—inte bara för coronavirusforskning utan för många framtida utmaningar där vetenskapen överstiger vår förmåga att läsa.

Citering: Shi, X., Fei, Z., Nkhata, A. et al. Optimization and comparison research on adaptive modularization BERT-SPAN model for named entity recognition of SARS-CoV-2 virus proteins. Sci Rep 16, 14207 (2026). https://doi.org/10.1038/s41598-026-44317-7

Nyckelord: SARS-CoV-2-proteiner, namngivningsigenkänning, biomedicinsk textutvinning, BERT-språkmodell, kunskapsgrafer