Clear Sky Science · de

Optimierungs- und Vergleichsstudie zum adaptiven modularen BERT‑SPAN‑Modell für die Named‑Entity‑Recognition von SARS‑CoV‑2‑Virusproteinen

Warum das Auffinden von Proteinnamen in Artikeln wichtig ist

Wöchentlich erscheinen online Tausende neuer wissenschaftlicher Arbeiten zu COVID‑19 und seinem Virus SARS‑CoV‑2. In diesen dichten Artikeln verbergen sich wichtige Hinweise zu den Proteinen des Virus – molekulare Maschinen, die ihm helfen, Zellen zu infizieren und die als vorrangige Ziele für Medikamente und Impfstoffe dienen. Doch niemand kann alles lesen. Diese Studie geht einer einfachen, aber wirkungsvollen Frage nach: Lassen sich Computer so trainieren, dass sie automatisch und schnell Proteinnamen im Text erkennen und auflisten, präzise genug, um Forschende zu unterstützen?

Wie man dicht gedrängten Text in nutzbare Daten verwandelt

Wenn Forschende über SARS‑CoV‑2 schreiben, verwenden sie eine verwirrende Mischung aus ausgeschriebenen Namen, Abkürzungen und Spitznamen für seine Proteine. Dasselbe Protein kann als „Spike‑Protein“, „S“ oder eingebettet in Formulierungen wie „receptor‑binding domain of spike“ erscheinen. Um solche Sprache im großen Maßstab zu verstehen, benötigen Computer zunächst ein Korpus – eine sorgfältig markierte Sammlung von Sätzen, in denen Expertinnen und Experten jede Proteinnennung hervorgehoben haben. Die Autoren erstellten eine solche Ressource, indem sie rund 200.000 Coronavirus‑Abstracts aus PubMed durchsuchten und anschließend alle relevanten Sätze per Hand auf SARS‑CoV‑2‑Proteinnennungen markierten. Nach Bereinigung und Kontrolle blieben 7.159 Sätze und 12.660 markierte Proteinnennungen übrig, die als Goldstandard für das Training und Testen von Algorithmen dienen.

Maschinen das Lesen von Virusproteinnamen beibringen

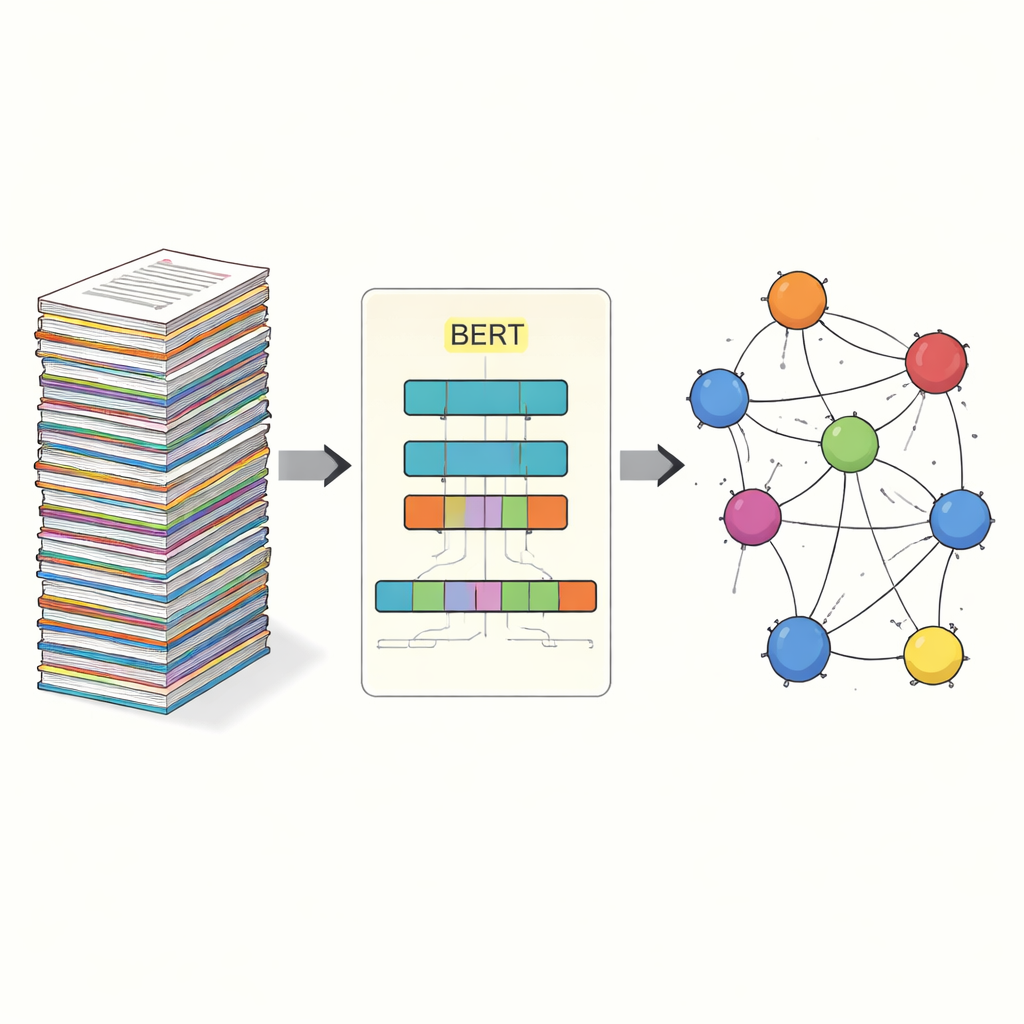

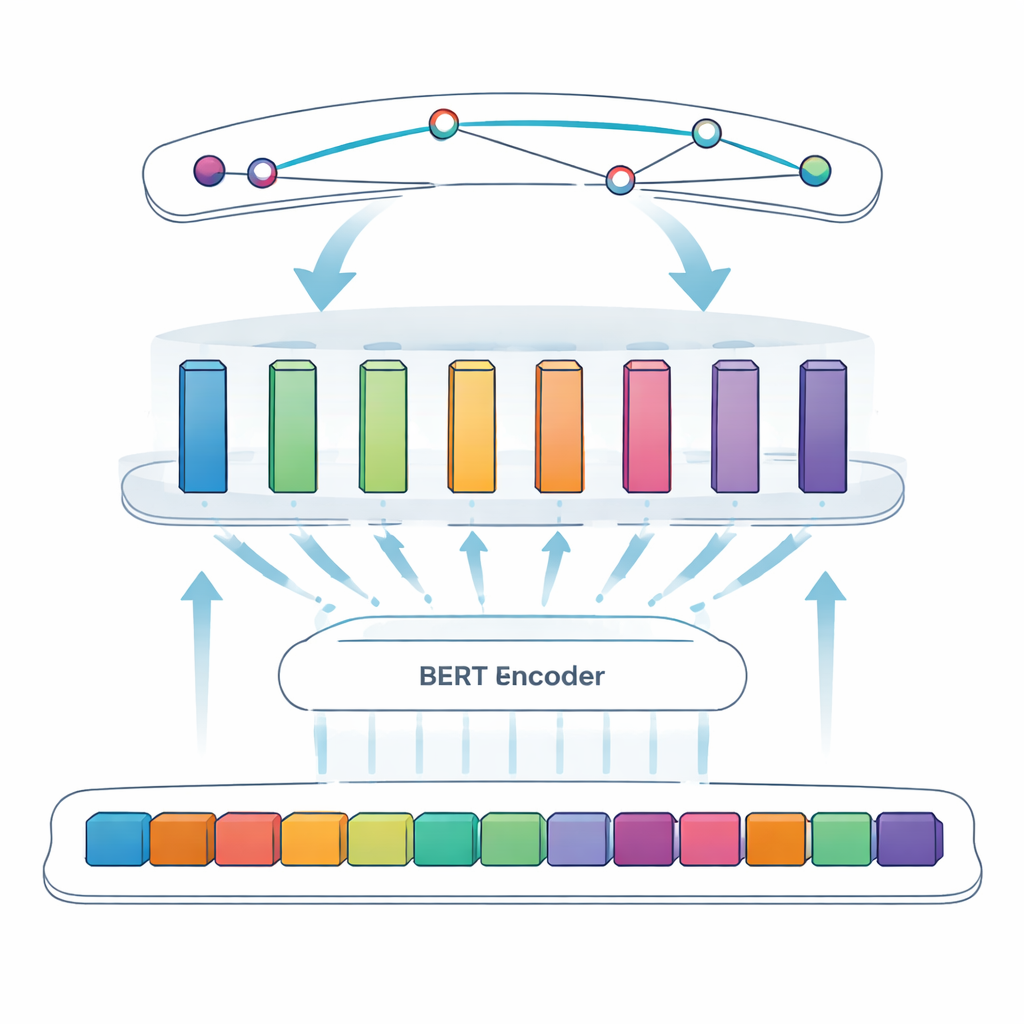

Die zentrale Aufgabe dieser Studie heißt Named‑Entity‑Recognition: einem Computer beibringen, bestimmte Elemente – hier virale Proteine – im freien Text auszuwählen. Frühere Ansätze beruhten auf manuell erstellten Regeln oder Lexika, die versagen, wenn die Benennung inkonsistent ist oder sich ändert. Neuere Systeme nutzen Deep Learning, wobei ein Modell Muster direkt aus Beispielen lernt. Das Team baut auf BERT auf, einem Sprachmodell, das Text kontextuell in beide Richtungen erfasst und so reichhaltige Wortrepräsentationen lernt. Auf BERT setzen sie einen SPAN‑Ansatz: Anstatt für jedes Token einzeln zu entscheiden, ob es zu einer Entität gehört, sagt das Modell direkt Start‑ und Endpositionen jeder Proteinnennung voraus. Das erleichtert den Umgang mit schwierigen Fällen wie verschachtelten oder mehrwortigen Namen.

Smartere Bausteine zum Modell hinzufügen

Um das System weiter zu schärfen, führen die Autoren eine adaptive modulare Feedforward‑Schicht ein, die man sich als mehrere kleine Expertenmodule zwischen BERT und dem finalen Span‑Detektor vorstellen kann. Verschiedene Module spezialisieren sich auf unterschiedliche Muster – etwa Oberflächenmerkmale wie Bindestriche oder gemischte Buchstaben‑Zahlen‑Sequenzen, oder subtile Kontexthinweise, die signalisieren, dass ein kurzes Zeichen wie „S“ tatsächlich ein Proteinname ist. Ein adaptiver Gewichtungsmechanismus entscheidet dann für jeden Satz, welchen Modulen mehr zu vertrauen ist, und kombiniert deren Ausgaben zu einem stärkeren Gesamtsignal vor dem Span‑Vorhersageschritt. Dieses Design erlaubt dem Modell, flexibel die informativsten Hinweise für jeden konkreten Textabschnitt zu nutzen.

Den Ansatz einem Härtetest unterziehen

Die Forschenden verglichen ihr adaptives modulares BERT–SPAN‑Modell systematisch mit mehreren etablierten Systemen, darunter ein verbreitetes BiLSTM–CRF‑Modell und eine Standard‑BERT–SPAN‑Variante ohne modulare Erweiterung. Anhand gängiger Genauigkeitsmaße stellten sie fest, dass das traditionelle BiLSTM–CRF‑Modell auf ihrem SARS‑CoV‑2‑Protein‑Datensatz eine F1‑Score (Balance aus Präzision und Rückruf) von etwa 80,8 Prozent erreichte. Der Umstieg auf BERT–SPAN allein erhöhte die Leistung auf 91,85 Prozent. Mit der adaptiven modularen Schicht stieg die F1‑Score weiter auf 93,66 Prozent – ein bedeutsamer Gewinn in einem bereits ausgereiften Feld. Sorgfältige Ablations‑Experimente – bei denen Architektur‑Teile nacheinander entfernt wurden – zeigten, dass sowohl Modularisierung als auch adaptive Gewichtung zur Verbesserung beitrugen, insbesondere indem sie Randfehler und Verwechslungen zwischen ähnlichen Abkürzungen reduzierten.

Wie das künftige Forschung unterstützt

Für Nicht‑Fachleute ist das wichtigste Ergebnis, dass die Autoren sowohl einen hochwertigen Datensatz als auch eine intelligentere Lese‑Engine gebaut haben, die SARS‑CoV‑2‑Proteine in wissenschaftlichem Text zuverlässig erkennt. Indem unklare Sprache in strukturierte Entitätslisten überführt wird, erleichtert ihr System das Erstellen von Wissensgraphen, das Kartieren, welche viralen Proteine mit welchen Wirtsmolekülen interagieren, und das Verfolgen, wie sich die Evidenz zu bestimmten Targets ansammelt. Praktisch bedeutet das, dass Computer einen größeren Teil der mühsamen Text‑Mining‑Arbeit übernehmen können, sodass menschliche Expertinnen und Experten sich auf die Interpretation der Ergebnisse und die Planung von Experimenten konzentrieren. Die Studie zeigt, dass die Kombination mächtiger Sprachmodelle mit modularen, adaptiven Komponenten ein vielversprechendes Rezept ist, um die Flut biomedizinischer Literatur zu durchforsten – nicht nur für Coronavirus‑Forschung, sondern für viele künftige Herausforderungen, bei denen die Wissenschaft schneller wächst als unsere Lesekapazität.

Zitation: Shi, X., Fei, Z., Nkhata, A. et al. Optimization and comparison research on adaptive modularization BERT-SPAN model for named entity recognition of SARS-CoV-2 virus proteins. Sci Rep 16, 14207 (2026). https://doi.org/10.1038/s41598-026-44317-7

Schlüsselwörter: SARS‑CoV‑2‑Proteine, Named‑Entity‑Recognition, biomedizinische Textanalyse, BERT‑Sprachmodell, Wissensgraphen