Clear Sky Science · sv

SciCUEval: En omfattande datamängd för att utvärdera vetenskaplig kontextförståelse i stora språkmodeller

Varför smartare vetenskaps-AI är viktigt

Forskare börjar förlita sig på stora språkmodeller — samma familj verktyg som ligger bakom populära chattbotar — för att läsa artiklar, granska databaser och till och med föreslå nya experiment. Men vetenskaplig information är tät, varierad och ofta ofullständig, och dagens modeller kan låta självsäkra även när de har fel. Denna artikel presenterar SciCUEval, en ny publik datamängd skapad för att rigoröst testa hur väl sådana modeller verkligen förstår vetenskaplig kontext, med målet att göra framtida AI-assistenter mer pålitliga i verkliga laboratorier och kliniker.

En ny testbädd för vetenskapskunniga maskiner

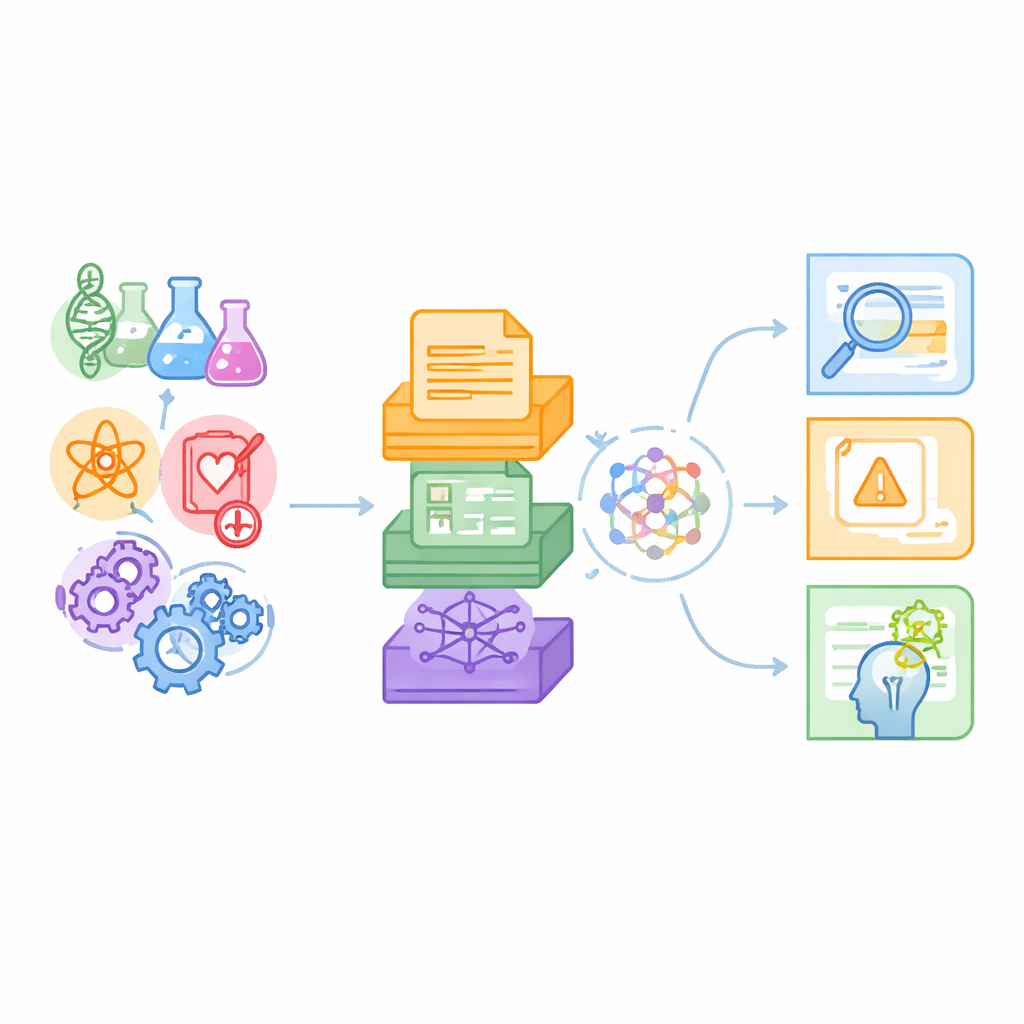

Författarna hävdar att befintliga benchmarks mestadels testar vardagsspråksuppgifter eller enskilda vetenskapliga nischer, såsom kemi-fråge-svar, och vanligtvis förlitar sig enbart på ren text. Verklig vetenskap sträcker sig däremot över många discipliner och blandar tidskriftsavsnitt med datatabeller och komplexa relationskartor. SciCUEval är utformat för att spegla denna verklighet. Det paketet ihop tio del-datamängder som täcker biologi, kemi, fysik, biomedicin och materialvetenskap, vardera hämtade från betrodda källor som arXiv-preprints, internationella nukleardatakollektioner, materialdatabaser och biomedicinska kunskapsbaser. Resultatet är mer än 11 000 noggrant uppbyggda frågor som stress-testar vad språkmodeller faktiskt förstår, snarare än hur väl de bluffar.

Att förena text, siffror och nätverk

En nyckelfunktion i SciCUEval är dess blandning av dataformat. Vissa frågor stöds av ostrukturerad text — utdrag från artiklar och experimentprotokoll. Andra förlitar sig på strukturerade tabeller som listar till exempel nuklearmätningar eller materialegenskaper. Ytterligare några använder ”kunskapsgrafer”, där entiteter som gener, läkemedel eller sjukdomar är förbundna med typade länkar. Varje problem inkluderar frågan, det korrekta svaret, de verkligen relevanta stödelementen och en större bakgrundskontext kryddad med extra, potentiellt förvillande poster. Frågor förekommer i flera bekanta former — öppna svar, flervalsfrågor, sant-eller-falskt och fyll-i-tomrummet — vilket gör benchmarket flexibelt för många utvärderingsstilar.

Fyra sätt att pröva vetenskaplig förståelse

För att gå utöver enkel faktasökning är datamängden organiserad kring fyra kärnkompetenser som forskare rutinmässigt behöver och som AI-system måste lära sig efterlikna. Först är det att hitta relevant information: kan en modell fokusera på den enda avgörande tabellraden eller grafposten som faktiskt besvarar frågan, samtidigt som den ignorerar liknande distraktioner? För det andra är att känna igen när informationen saknas eller är opålitlig, och uttryckligen vägra svar i stället för att hallucinera. För det tredje är att kombinera bitar från flera källor — till exempel länka en mätningstabell till en separat beskrivning av experimentella förhållanden. Slutligen testar kontextmedveten inferens om en modell kan dra en logisk slutsats som inte uttalas rakt ut men som tydligt impliceras av den tillhandahållna evidensen. Tillsammans bildar dessa färdigheter en strukturerad checklista för vad ”förståelse” bör betyda i vetenskapliga sammanhang.

Hur frågorna byggdes och granskades

Att konstruera ett sådant benchmark krävde en egen miniatyr vetenskaplig arbetsflöde. Teamet provade först små, koherenta stycken från källkollektionerna — korta textpassager, enskilda tabellrader eller uppsättningar länkade poster. De använde sedan en kraftfull språkmodell, styrd av detaljerade prompts, för att utarbeta kandidat-fråga-och-svar-par förankrade i varje stycke och matchade till en av de fyra färdigheterna. För att göra livet svårare för testande modeller lade författarna till ”brus” genom att infoga extra poster som ser liknande ut i betydelse men som faktiskt är irrelevanta, med hjälp av avancerad likhetssökning och överlappningsfilter. Slutligen säkerställde en tvåstegs kvalitetskontroll stringens: en annan stark modell bedömde huruvida varje svar verkligen följde av den stödjande kontexten, och fem doktorsexperter granskade därefter manuellt tusentals objekt och underkände alla som var oklara, vilseledande eller inte fullt understödda av bevisen.

Vad dagens modeller gör rätt och fel

Med SciCUEval i handen utvärderade författarna systematiskt 18 ledande språkmodeller, inklusive vida använda proprietära system och öppen-källkods allmänna samt vetenskapsfokuserade modeller. De fann att modeller utrustade med explicita resonemangsstrategier och stora parametrar tenderade att prestera bäst, ofta överträffande mindre eller mer snävt tränade vetenskapsmodeller. De flesta system hanterade grundläggande relevanssökning hyfsat och presterade bättre på fri text än på täta tabeller eller graf-strukturerade data. Däremot hade nästan alla svårt att medge när de saknade tillräcklig information, och erbjöd ofta självsäkra men ogrundade svar. Specialiserade vetenskapsmodeller, trots att de tränats på fältspecifikt material, låg ofta efter de starkaste allmänna modellerna vad gäller övergripande resonemang och hantering av flera datamodaliteter.

Vad detta betyder för säkrare vetenskaps-AI

För icke-specialister som ser AI röra sig in i laboratorier, sjukhus och materialdesign erbjuder SciCUEval både en varning och en färdplan framåt. Varningen är att dagens imponerande språkmodeller fortfarande är benägna till överdriven självsäkerhet, särskilt när vetenskapliga bevis är ofullständiga eller spridda över format. Färdplanen är ett transparent, utmanande benchmark som blottlägger dessa svagheter och hjälper utvecklare mäta verkliga framsteg. Genom att ge gemenskapen ett delat, öppet test av vetenskaplig kontextförståelse, syftar författarna till att styra framtida modeller mot att inte bara låta kunniga om vetenskap, utan att agera som försiktiga, evidensdrivna samarbetspartner.

Citering: Yu, J., Tang, Y., Feng, K. et al. SciCUEval: A Comprehensive Dataset for Evaluating Scientific Context Understanding in Large Language Models. Sci Data 13, 530 (2026). https://doi.org/10.1038/s41597-026-06594-9

Nyckelord: vetenskaplig benchmark, stora språkmodeller, kontextförståelse, multimodala vetenskapliga data, AI-utvärdering