Clear Sky Science · nl

SciCUEval: Een uitgebreide dataset voor het evalueren van wetenschappelijk contextbegrip in grote taalmodellen

Waarom slimmer wetenschappelijke AI’s ertoe doen

Wetenschappers gaan steeds vaker gebruikmaken van grote taalmodellen—dezelfde gereedschappen achter populaire chatbots—om artikelen te lezen, databases te doorzoeken en zelfs nieuwe experimenten voor te stellen. Wetenschappelijke informatie is echter compact, gevarieerd en vaak onvolledig, en de huidige modellen kunnen zelfverzekerd klinken terwijl ze het bij het verkeerde eind hebben. Dit artikel introduceert SciCUEval, een nieuwe openbare dataset die is opgezet om op rigoureuze wijze te testen hoe goed zulke modellen werkelijk de wetenschappelijke context begrijpen, met als doel toekomstige AI-hulpen betrouwbaarder te maken in echte laboratoria en klinieken.

Een nieuw testveld voor wetenschapvaardige machines

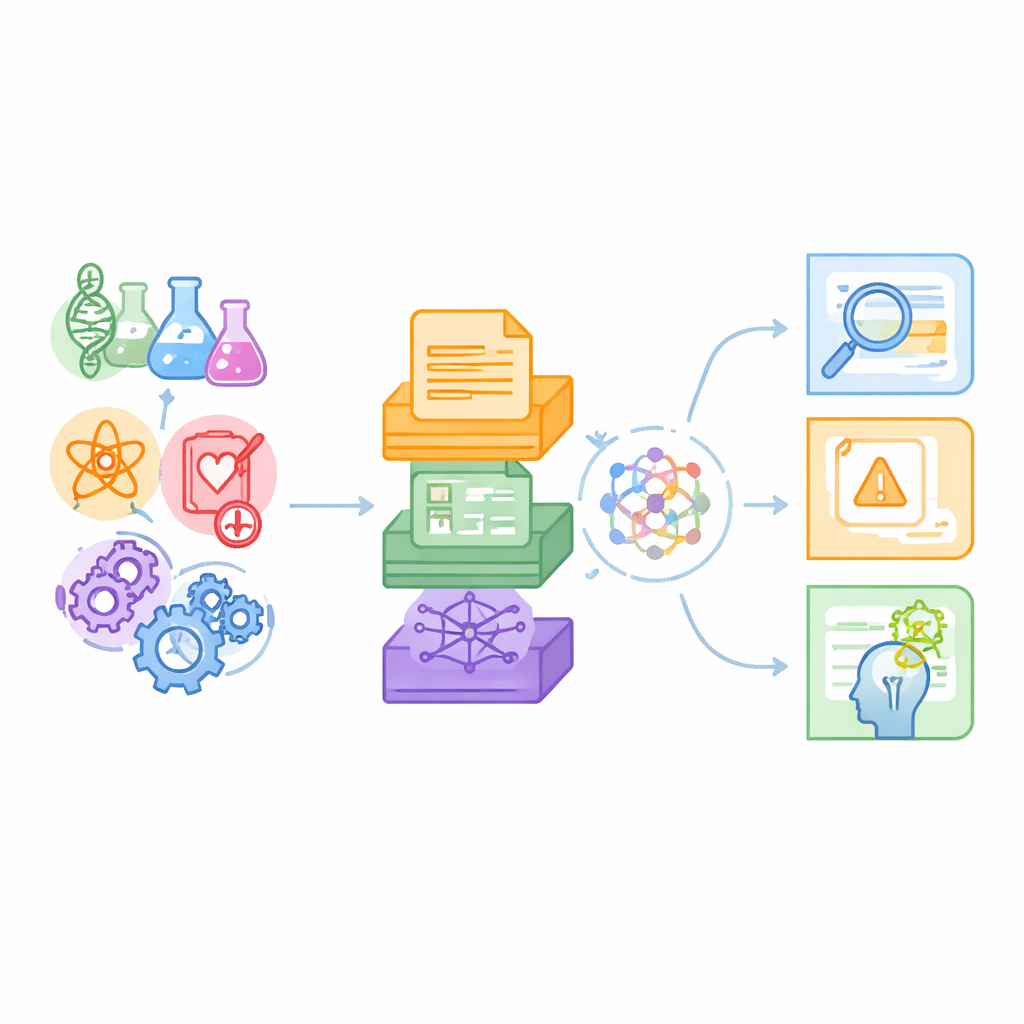

De auteurs stellen dat bestaande benchmarks meestal alledaagse taalopgaven of enkele wetenschappelijke niches onderzoeken, zoals vraag-en-antwoord in de scheikunde, en meestal alleen op platte tekst vertrouwen. Echte wetenschap daarentegen overspant vele disciplines en combineert tijdschriftparagrafen met datatabellen en complexe relatiekaarten. SciCUEval is ontworpen om deze realiteit te weerspiegelen. Het bundelt tien subdatasets die biologie, scheikunde, natuurkunde, biomedische wetenschappen en materiaalkunde bestrijken, elk afkomstig van betrouwbare bronnen zoals arXiv-preprints, internationale nucleaire gegevensverzamelingen, materiaaldatabases en biomedische kennisbanken. Het resultaat is meer dan 11.000 zorgvuldig opgebouwde vragen die testen wat taalmodellen daadwerkelijk begrijpen, in plaats van hoe goed ze kunnen bluffen.

Tekst, cijfers en netwerken samenbrengen

Een kernkenmerk van SciCUEval is de mengvorm van gegevenstypen. Sommige vragen worden ondersteund door ongestructureerde tekst—fragmenten uit artikelen en experimentele protocollen. Andere zijn gebaseerd op gestructureerde tabellen met bijvoorbeeld nucleaire metingen of materiaaleigenschappen. Weer andere maken gebruik van “kennisgrafen”, waarin entiteiten zoals genen, geneesmiddelen of ziektes verbonden zijn door getypeerde koppelingen. Elk probleem bevat de vraag, het correcte antwoord, de écht relevante ondersteunende onderdelen en een bredere achtergrondcontext die is aangevuld met extra, mogelijk verwarrende items. Vragen verschijnen in meerdere bekende vormen—open antwoorden, meerkeuze, waar/niet waar en invuloefeningen—waardoor de benchmark flexibel is voor verschillende evaluatiestijlen.

Vier manieren om wetenschappelijk begrip te bevragen

Om verder te gaan dan eenvoudige feitenopslag is de dataset georganiseerd rond vier kernvaardigheden die wetenschappers routinematig nodig hebben en die AI-systemen moeten leren nabootsen. De eerste is het vinden van relevante informatie: kan een model de ene cruciale tabelrij of grafiekeenheid aanwijzen die de vraag beantwoordt, terwijl het sterk gelijkende afleiders negeert? De tweede is het herkennen wanneer informatie ontbreekt of onbetrouwbaar is, en expliciet weigeren te antwoorden in plaats van te hallucineren. De derde is het combineren van onderdelen uit meerdere bronnen—bijvoorbeeld het koppelen van een tabel met metingen aan een afzonderlijke beschrijving van experimentele omstandigheden. Ten slotte test contextbewuste redenering of een model een logische conclusie kan trekken die niet expliciet is vermeld maar wel duidelijk volgt uit het geboden bewijsmateriaal. Samen vormen deze vaardigheden een gestructureerde checklist voor wat ‘begrip’ zou moeten betekenen in wetenschappelijke contexten.

Hoe de vragen zijn gemaakt en gecontroleerd

Het opbouwen van zo’n benchmark vereiste een eigen verkleinde wetenschappelijke workflow. Het team nam eerst kleine, coherente fragmenten uit de bronverzamelingen—korte tekstpassages, individuele tabelrijen of sets gekoppelde items. Vervolgens gebruikten ze een krachtig taalmodel, gestuurd door gedetailleerde prompts, om kandidaat-vraag-en-antwoordparen op te stellen die in elk fragment verankerd waren en aansloten bij een van de vier vaardigheden. Om het de testmodellen moeilijker te maken voegden de auteurs ‘ruis’ toe door extra items in te voegen die qua betekenis sterk op elkaar lijken maar in feite irrelevant zijn, met behulp van geavanceerde gelijkeniszoekmethoden en overlapfilters. Tot slot zorgde een tweefasige kwaliteitscontrole voor grondigheid: een ander sterk model beoordeelde of elk antwoord echt uit de ondersteunende context volgde, en vijf promovendi controleerden vervolgens handmatig duizenden items, waarbij zij alles afwezen dat onduidelijk, misleidend of niet volledig door het bewijsmateriaal gedragen was.

Wat huidige modellen goed en fout doen

Met SciCUEval in handen evalueerden de auteurs systematisch 18 toonaangevende taalmodellen, waaronder veelgebruikte propriëtaire systemen en open-source algemene en wetenschapgerichte modellen. Ze ontdekten dat modellen die expliciete redeneervaardigheden hadden en veel parameters bevatten doorgaans het beste presteerden, en vaak kleinere of nauwer getrainde wetenschapsmodellen overtroffen. De meeste systemen gingen redelijk om met het vinden van relevantie en deden het beter op vrije tekst dan op dichte tabellen of graf-gestructureerde data. Toch hadden bijna alle modellen moeite om toe te geven wanneer er onvoldoende informatie was, en boden ze vaak zelfverzekerde maar ongefundeerde antwoorden. Gespecialiseerde wetenschappelijke modellen, ondanks training op vakgebiedspecifiek materiaal, bleken vaak achter te blijven bij de sterkste algemene modellen in algeheel redeneren en in het verwerken van meerdere datamodaliteiten.

Wat dit betekent voor veiligere wetenschappelijke AI

Voor niet-specialisten die AI zien doordringen in laboratoria, ziekenhuizen en materiaalkunde biedt SciCUEval zowel een waarschuwing als een route vooruit. De waarschuwing is dat de huidige indrukwekkende taalmodellen vatbaar blijven voor overmoed, vooral wanneer wetenschappelijk bewijs onvolledig is of verspreid over verschillende formaten staat. De route vooruit is een transparante, veeleisende benchmark die deze zwaktes blootlegt en ontwikkelaars helpt echte vooruitgang te meten. Door de gemeenschap een gedeelde, open test van begrip van wetenschappelijke context te geven, willen de auteurs toekomstige modellen sturen naar niet alleen slim klinken over wetenschap, maar zich gedragen als zorgvuldige, bewijsgedreven samenwerkingspartners.

Bronvermelding: Yu, J., Tang, Y., Feng, K. et al. SciCUEval: A Comprehensive Dataset for Evaluating Scientific Context Understanding in Large Language Models. Sci Data 13, 530 (2026). https://doi.org/10.1038/s41597-026-06594-9

Trefwoorden: wetenschappelijke benchmark, grote taalmodellen, begrip van context, multimodale wetenschappelijke gegevens, AI-evaluatie