Clear Sky Science · he

SciCUEval: מאגר נתונים מקיף להערכת הבנת הקשר מדעי במודלי שפה גדולים

למה בינה מלאכותית חכמה יותר במדע חשובה

מדעניות ומדענים מתחילים להסתמך על מודלי שפה גדולים — אותה משפחת כלים שמאחוריה בוטים שיחה פופולריים — כדי לקרוא מאמרים, לסנן מאגרי נתונים ואפילו להציע ניסויים חדשים. אבל המידע המדעי צפוף, מגוון ולעתים קרובות חסר, ומודלים כיום עלולים להישמע בטוחים בעוד שהם טועים. מאמר זה מציג את SciCUEval, מאגר ציבורי חדש שנוצר כדי לבדוק בקפדנות עד כמה מודלים כאלה מבינים באמת הקשר מדעי, במטרה להפוך את העוזרים הממוכנים הבאים לאמינים יותר במעבדות וטיפולים קליניים אמיתיים.

סביבת בחינה חדשה למכונות רזות מדע

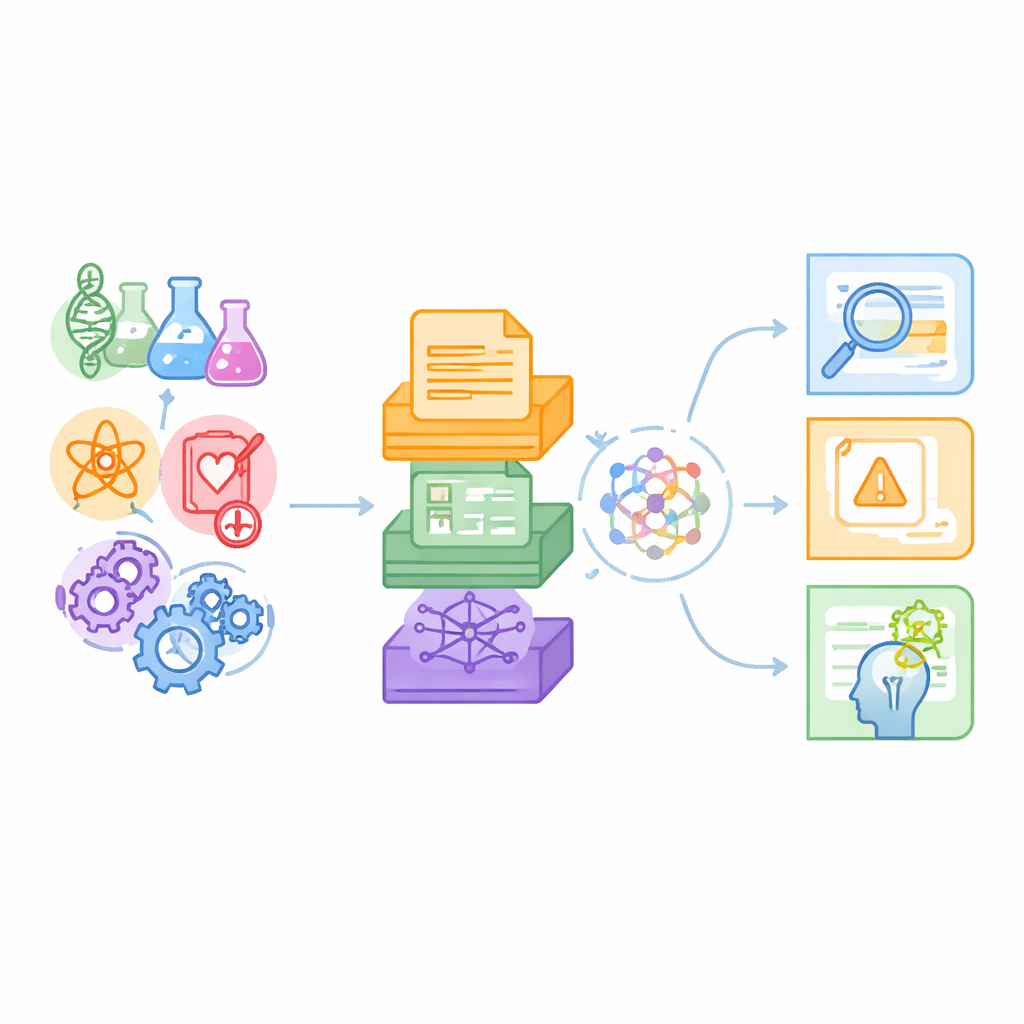

המחברים טוענים שמדדים קיימים בודקים בעיקר משימות שפה יומיומיות או נישות מדעיות בודדות, כמו מענה על שאלות בכימיה, ובדרך כלל מסתמכים רק על טקסט פשוט. המדע האמיתי, לעומת זאת, חוצה דיסציפלינות רבות ומשלב פסקאות מכתבי עת עם טבלאות נתונים ומפות יחסים מורכבות. SciCUEval תוכנן כדי לשקף מציאות זו. הוא מצרף עשרה תתי-מאגרי נתונים המכסים ביולוגיה, כימיה, פיזיקה, ביו-רפואה ומדעי החומרים, כל אחד שנבחר ממקורות מהימנים כמו פרי-פרינטים ב-arXiv, אוספי נתונים גרעיניים בינלאומיים, מאגרי חומרים ובסיסי ידע ביורפואיים. התוצאה היא יותר מ-11,000 שאלות שבנו בקפידה שמטרתן לבחון באופן מעמיק מה מודלי השפה באמת מבינים, במקום עד כמה הם מצליחים לבלף.

לאחד טקסט, מספרים ורשתות

מאפיין מרכזי של SciCUEval הוא התערובת של פורמטי נתונים. חלק מהשאלות נתמכות בטקסט לא-מובנה — קטעים ממאמרים ופרוטוקולי ניסוי. אחרות מסתמכות על טבלאות מובנות שמפורטות, למשל, מדידות גרעיניות או תכונות של חומרים. עוד אחרות משתמשות ב"גרפי ידע", שבהם ישויות כמו גנים, תרופות או מחלות מקושרות בקישורים מתויגים. כל בעיה כוללת את השאלה, התשובה הנכונה, מקטעי התמיכה הרלוונטיים באמת והקשר רקע רחב יותר שמכיל גם פריטים מבלבלים אפשריים. השאלות מופיעות בכמה צורות מוכרות — תשובות פתוחות, רב-ברירה, אמת-שקר ומילוי החסר — מה שהופך את המדד לגמיש עבור סגנונות הערכה שונים.

ארבע דרכים לבחינת הבנה מדעית

כדי להתקדם מעבר לחיפוש עובדות פשוט, המאגר מאורגן סביב ארבע מיומנויות ליבה שמדענים זקוקים להן באופן שגרתי ושמערכות בינה מלאכותית חייבות ללמוד לחקות. הראשונה היא מציאת מידע רלוונטי: האם המודל יכול למצוא את שורת הטבלה הקריטית או את נקודת הגרף שממש עונה על השאלה, תוך התעלמות מהסחות דומות? השנייה היא הכרה מתי המידע חסר או לא מהימן, והכחשה מפורשת למתן תשובה במקום להשטות (hallucinate). השלישית היא שילוב מקטעים ממקורות מרובים — למשל, חיבור בין טבלת מדידות לתיאור נפרד של תנאי הניסוי. לבסוף, הסקה בהכרה הקונטקסטואלית בודקת האם מודל מסוגל להסיק מסקנה לוגית שאינה מוצגת במפורש אך נגזרת בבירור מהראיות שסופקו. ביחד, מיומנויות אלה יוצרות רשימת בדיקה מסודרת למה ש"הבנה" צריכה להיות בהקשרים מדעיים.

כיצד נבנו ונבדקו השאלות

בניית מדד כזה דרשה זרימת עבודה מדעית מוקטנת משל עצמה. הצוות דגם תחילה קטעים קטנים וקוהרנטיים ממאגרי המקור — קטעי טקסט קצרים, שורות טבלה בודדות או קבוצות ערכים מקושרים. לאחר מכן השתמשו במודל שפה חזק, מונחה על ידי הנחיות מפורטות, כדי לנסח זוגות שאלה־תשובה מבוססים על כל קטע ומתאימים לאחת מארבע המיומנויות. כדי להקשות על דגמי הבחינה, המחברים הוסיפו "רעש" על ידי הכנסת ערכים נוספים שנראים דומים במשמעות אך חסרי רלוונטיות, באמצעות חיפוש דמיון מתקדם ומסנני חפיפה. לבסוף, בדיקת איכות בשני שלבים הבטיחה קפדנות: מודל חזק נוסף שפט האם כל תשובה נובעת באמת מהקונטקסט התומך, וחמישה מומחי PhD סקרו ידנית אלפים מהפריטים, ודחו כל פריט שהיה לא ברור, מטעה או שאינו מגובה כהלכה בראיות.

מה המודלים של היום עושים נכון ושגוי

עם SciCUEval בידיהם, המחברים העריכו באופן שיטתי 18 ממודלי השפה המובילים, כולל מערכות קנייניות נפוצות ומודלים פתוחים כלליים וממוקדי-מדע. הם מצאו שמודלים המצוידים באסטרטגיות חשיבה מפורשות ובמספר פרמטרים גדול נטו להציג ביצועים טובים יותר, לעיתים עולים על מודלים קטנים יותר או מאומנים בצמצום על תחום מדעי ספציפי. רוב המערכות התמודדו היטב עם מציאת רלוונטיות בסיסית והסתדרו טוב יותר בטקסט חופשי מאשר בטבלאות צפופות או בנתונים במבנה גרף. עם זאת, כמעט כולן נאבקו להודות כאשר לא היה בידיהן מספיק מידע, ולעתים קרובות הציעו תשובות בטוחות אך בלתי מבוססות. מודלים מדעיים מיוחדים, אף שהוכשרו על חומר ספציפי לתחום, לעתים נותרו מאחור ביחס לחוזק הכללי של המודלים החזקים ביותר בהיגיון ובהתמודדות עם מודאליות נתונים מרובות.

מה זה אומר עבור בינה מדעית בטוחה יותר

עבור לא-מומחים הצופים בבינה מלאכותית נכנסת למעבדות, בתי חולים ועיצוב חומרים, SciCUEval מציע גם אזהרה וגם נתיב קדימה. האזהרה היא שמודלי השפה המרשימים של היום עדיין נוטים לבטחון-יתר, במיוחד כאשר הראיות המדעיות חסרות או מפוזרות בפורמטים שונים. הנתיב קדימה הוא מדד שקוף ומאתגר שמחשף את חולשות אלו ועוזר למפתחים למדוד התקדמות אמיתית. על ידי מתן מבחן משותף ופתוח להבנת הקשר המדעי, המחברים שואפים לכוון מודלים עתידיים לא רק להישמע חכמים לגבי מדע, אלא להתנהג כמו שותפים זהירים ומונחי ראיות.

ציטוט: Yu, J., Tang, Y., Feng, K. et al. SciCUEval: A Comprehensive Dataset for Evaluating Scientific Context Understanding in Large Language Models. Sci Data 13, 530 (2026). https://doi.org/10.1038/s41597-026-06594-9

מילות מפתח: מצפן מדעי, מודלים לשוניים גדולים, הבנת הקשר, נתונים מדעיים מולטימודליים, הערכת בינה מלאכותית