Clear Sky Science · pl

SciCUEval: Kompleksowy zbiór danych do oceny rozumienia kontekstu naukowego przez duże modele językowe

Dlaczego inteligentniejsze AI dla nauki mają znaczenie

Naukowcy zaczynają polegać na dużych modelach językowych — tej samej rodzinie narzędzi stojących za popularnymi chatbotami — do czytania artykułów, przeszukiwania baz danych, a nawet sugerowania nowych eksperymentów. Jednak informacje naukowe są gęste, zróżnicowane i często niekompletne, a współczesne modele potrafią brzmieć przekonująco, będąc w błędzie. W tym artykule przedstawiono SciCUEval, nowy publiczny zbiór danych stworzony, by rygorystycznie testować, jak dobrze takie modele rzeczywiście rozumieją kontekst naukowy — z celem zwiększenia niezawodności przyszłych asystentów AI w rzeczywistych laboratoriach i klinikach.

Nowe pole testowe dla maszyn rozumiejących naukę

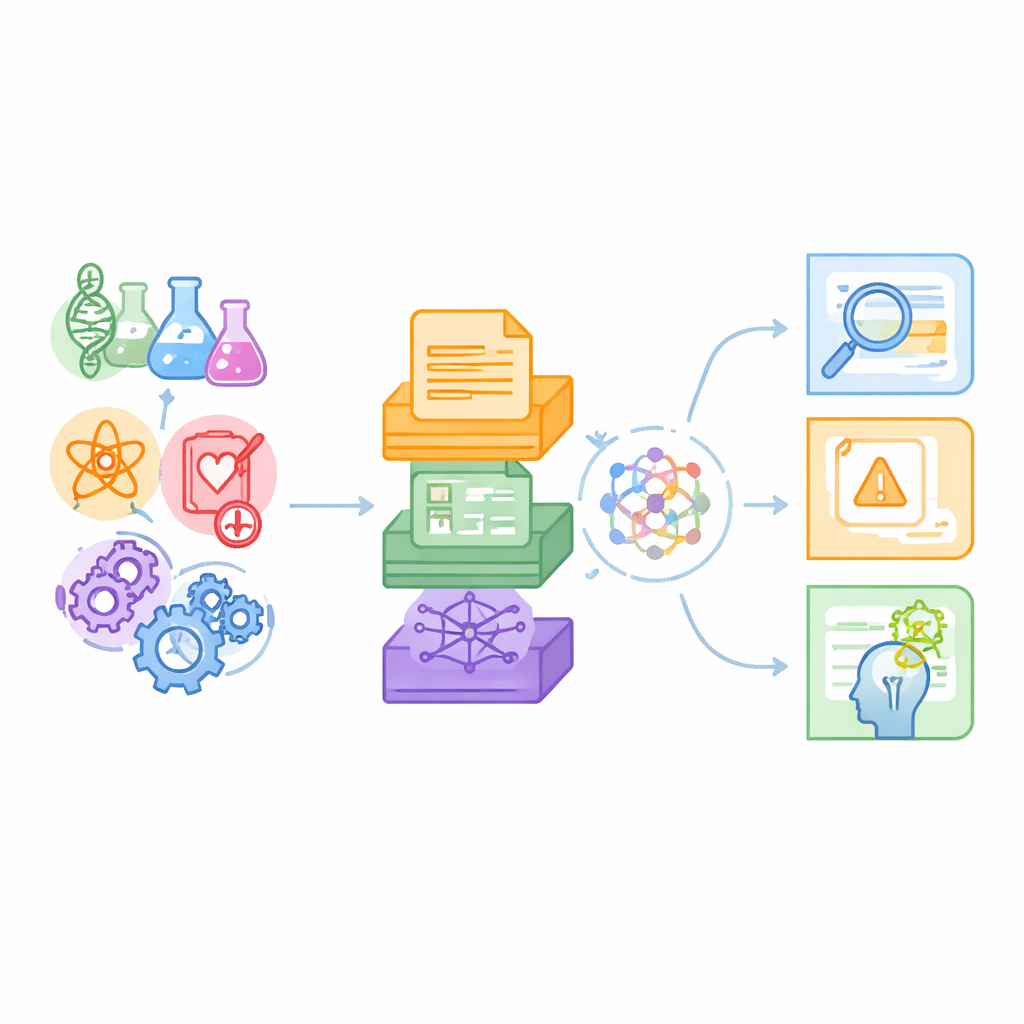

Autorzy argumentują, że istniejące benchmarki w przeważającej mierze badają zadania języka codziennego lub pojedyncze nisze naukowe, takie jak odpowiadanie na pytania z chemii, i zazwyczaj opierają się wyłącznie na tekście. Prawdziwa nauka obejmuje natomiast wiele dyscyplin i łączy akapity z czasopism, tabele danych oraz złożone mapy związków. SciCUEval zostało zaprojektowane tak, by odzwierciedlać tę rzeczywistość. Zawiera dziesięć podzbiorów obejmujących biologię, chemię, fizykę, biomedycynę i naukę o materiałach, każdy pozyskany z zaufanych źródeł, takich jak preprinty arXiv, międzynarodowe zbiory danych jądrowych, bazy danych materiałów oraz bazy wiedzy biomedycznej. W efekcie powstało ponad 11 000 starannie skonstruowanych pytań, które testują, co modele językowe faktycznie rozumieją, zamiast tego, jak dobrze potrafią się mądrzyć.

Łączenie tekstu, liczb i sieci

Kluczową cechą SciCUEval jest mieszanka formatów danych. Niektóre pytania wspierane są przez nieustrukturyzowany tekst — fragmenty artykułów i protokołów eksperymentalnych. Inne opierają się na ustrukturyzowanych tabelach zawierających na przykład pomiary jądrowe lub właściwości materiałów. Jeszcze inne wykorzystują „grafy wiedzy”, w których byty takie jak geny, leki czy choroby są połączone typowanymi powiązaniami. Każde zadanie zawiera pytanie, poprawną odpowiedź, rzeczywiście istotne elementy wspierające oraz szerszy kontekst tła przesycony dodatkowymi, potencjalnie mylącymi wpisami. Pytania występują w kilku znanych formach — odpowiedzi otwarte, wielokrotnego wyboru, prawda-fałsz i uzupełnianie luk — co czyni benchmark elastycznym dla różnych stylów oceny.

Cztery sposoby badania rozumienia naukowego

Aby wyjść poza proste wyszukiwanie faktów, zbiór danych jest zorganizowany wokół czterech kluczowych umiejętności, których rutynowo potrzebują naukowcy i które systemy AI muszą nauczyć się naśladować. Pierwsza to znajdowanie istotnych informacji: czy model potrafi skupić się na jednym kluczowym wierszu tabeli lub elemencie wykresu, który faktycznie odpowiada na pytanie, ignorując zwodnicze podobieństwa? Druga to rozpoznawanie, kiedy informacji brakuje lub są one niewiarygodne, oraz wyraźne odmówienie odpowiedzi zamiast wytwarzania halucynacji. Trzecia to łączenie fragmentów z wielu źródeł — na przykład powiązanie tabeli pomiarów z oddzielnym opisem warunków eksperymentalnych. Wreszcie, wnioskowanie uwzględniające kontekst sprawdza, czy model potrafi wyprowadzić logiczny wniosek, który nie jest wyrażony wprost, lecz jest wyraźnie implikowany przez dostarczone dowody. Razem te umiejętności tworzą uporządkowaną listę kontrolną tego, co „rozumienie” powinno oznaczać w warunkach naukowych.

Jak pytania były tworzone i sprawdzane

Skonstruowanie takiego benchmarku wymagało własnego, miniaturowego procesu naukowego. Zespół najpierw losowo pobierał małe, spójne fragmenty ze zbiorów źródłowych — krótkie fragmenty tekstu, pojedyncze wiersze tabel lub zestawy powiązanych wpisów. Następnie użyto potężnego modelu językowego, sterowanego szczegółowymi poleceniami, do szkicowania kandydatów pytań i odpowiedzi osadzonych w każdym fragmencie i dopasowanych do jednej z czterech umiejętności. Aby utrudnić zadanie modelom testowym, autorzy dodawali „szum” poprzez wstawianie dodatkowych wpisów podobnych znaczeniowo, lecz w istocie nieistotnych, wykorzystując zaawansowane wyszukiwanie po podobieństwie i filtry nakładania się. W końcowym etapie dwuetapowa kontrola jakości zapewniła rygor: inny silny model ocenił, czy każda odpowiedź faktycznie wynikała z kontekstu wspierającego, a następnie pięciu ekspertów na poziomie doktoratu ręcznie przejrzało tysiące pozycji, odrzucając te, które były niejasne, mylące lub nie w pełni poparte dowodami.

Co współczesne modele robią dobrze, a co źle

Dysponując SciCUEval, autorzy systematycznie ocenili 18 wiodących modeli językowych, w tym szeroko stosowane systemy własnościowe oraz otwarte modele ogólnego i naukowego zastosowania. Stwierdzili, że modele wyposażone w jawne strategie rozumowania i duże liczby parametrów osiągały najlepsze wyniki, często przewyższając mniejsze lub wężej trenowane modele naukowe. Większość systemów radziła sobie rozsądnie z podstawowym odnajdywaniem istotności i lepiej wypadała przy odpowiedziach tekstowych niż przy gęstych tabelach czy danych w strukturze grafu. Jednak prawie wszystkie miały trudności z przyznaniem, że brakuje im informacji, często proponując pewne, lecz bezpodstawne odpowiedzi. Specjalistyczne modele naukowe, mimo że trenowano je na materiałach z danej dziedziny, często pozostawały w tyle za najsilniejszymi modelami ogólnymi w zakresie rozumowania i obsługi wielomodalnych danych.

Co to oznacza dla bezpieczniejszego AI w nauce

Dla osób spoza specjalizacji obserwujących wejście AI do laboratoriów, szpitali i projektowania materiałów, SciCUEval stanowi zarówno ostrzeżenie, jak i drogę naprzód. Ostrzeżenie polega na tym, że dzisiejsze imponujące modele językowe wciąż mają skłonność do przesadnej pewności siebie, zwłaszcza gdy dowody naukowe są niekompletne lub rozproszone w różnych formatach. Droga naprzód to przejrzysty, wymagający benchmark, który ujawnia te słabości i pomaga deweloperom mierzyć rzeczywisty postęp. Dostarczając społeczności wspólny, otwarty test rozumienia kontekstu naukowego, autorzy dążą do skierowania przyszłych modeli nie tylko ku temu, by brzmiały mądrze o nauce, lecz by zachowywały się jak uważni, dowodowo zorientowani współpracownicy.

Cytowanie: Yu, J., Tang, Y., Feng, K. et al. SciCUEval: A Comprehensive Dataset for Evaluating Scientific Context Understanding in Large Language Models. Sci Data 13, 530 (2026). https://doi.org/10.1038/s41597-026-06594-9

Słowa kluczowe: naukowy benchmark, duże modele językowe, rozumienie kontekstu, multimodalne dane naukowe, ocena AI