Clear Sky Science · pt

Clusterização fuzzy multivista guiada por âncoras para imagens hiperespectrais e LiDAR

Vendo a Terra com Mais Clareza

Da saúde das lavouras ao crescimento urbano, satélites agora observam nosso planeta com detalhes impressionantes. Mas sensores diferentes enxergam o mesmo lugar de maneiras muito distintas: alguns registram as sutis cores da vegetação, outros capturam a forma exata de edifícios e do relevo. Este estudo apresenta uma nova forma de agrupar automaticamente áreas da terra em categorias significativas combinando essas visões contrastantes, para que máquinas possam interpretar melhor nosso mundo em mudança sem depender de rótulos humanos caros.

Por que Muitos Olhos São Melhores que Um

Missões modernas de observação da Terra raramente dependem de um único tipo de sensor. Sensores hiperespectrais medem dezenas ou até centenas de bandas de cor, revelando impressões químicas do solo, das culturas e de materiais artificiais. Sensores LiDAR, por outro lado, disparam pulsos a laser para construir uma imagem tridimensional do terreno, capturando alturas de edifícios, copas de árvores e estruturas superficiais sutis. Sobre o mesmo quarteirão, ambos os sensores são alinhados pixel a pixel, mas codificam informações muito diferentes. O desafio é agrupar, ou clusterizar, esses pixels em tipos de cobertura do solo — como edifícios, estradas ou pomares — de modo a usar as vantagens de cada sensor e ainda assim chegar a uma decisão compartilhada e consistente sobre o que há no terreno.

Âncoras: Pontos Representativos em um Mar de Dados

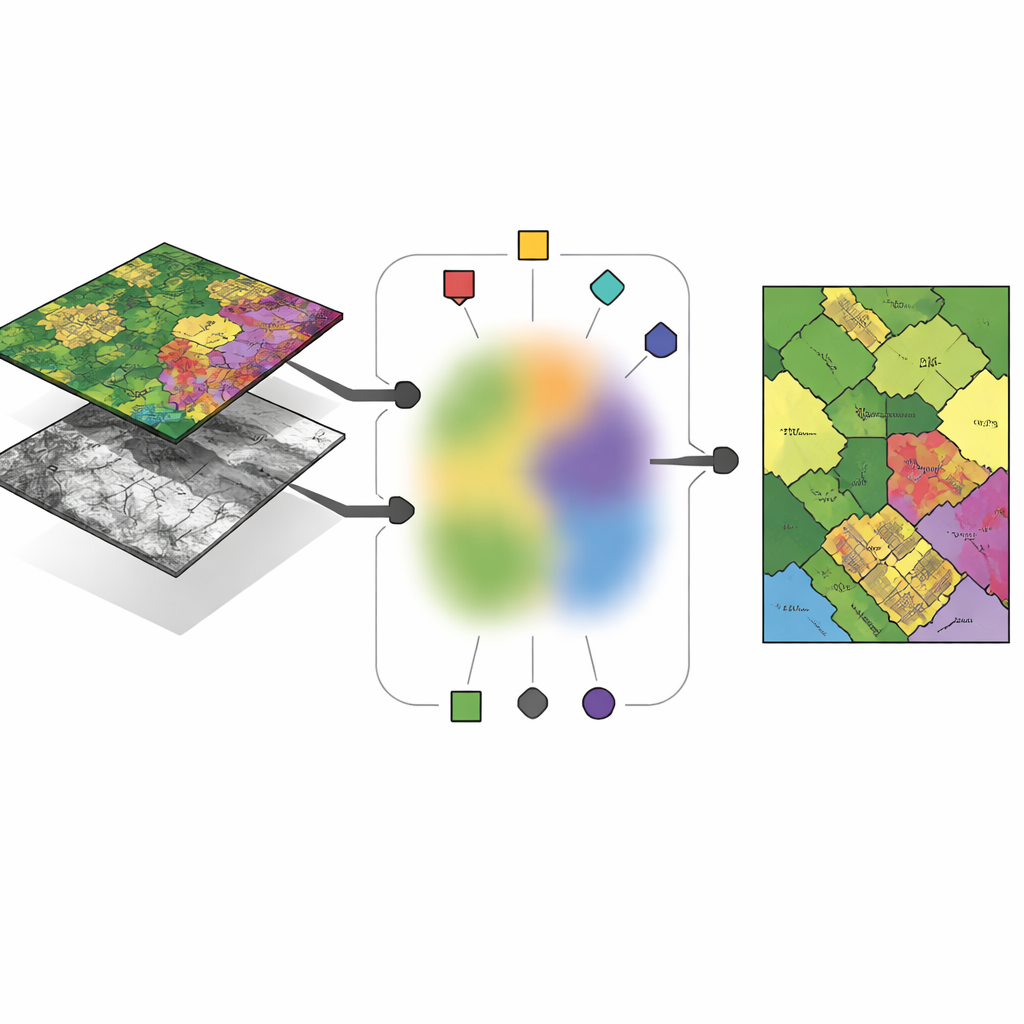

Em vez de permitir que o algoritmo invente “centros” totalmente livres para cada cluster em cada sensor, os autores propõem construir esses centros a partir de um pequeno conjunto de pixels cuidadosamente escolhidos chamados âncoras. Essas âncoras funcionam como exemplos típicos que resumem os principais padrões em cada imagem. Cada centro de cluster em um dado sensor é expresso como uma mistura ponderada de suas âncoras, o que força os centros a permanecer próximos a dados reais observados e evita soluções instáveis ou sem sentido. Esse desenho reduz o número de parâmetros livres que o método precisa aprender e torna os resultados mais fáceis de interpretar: um centro de cluster passa a ser “algo entre estes poucos pixels concretos de âncora” em vez de um ponto abstrato flutuando em um espaço de alta dimensionalidade.

Compartilhando Associação aos Grupos entre Sensores

A ideia-chave do novo arcabouço, chamada clusterização fuzzy multivista guiada por âncoras (AMVFC), é separar “onde os clusters estão” de “quão fortemente cada pixel pertence a eles”. Cada sensor — hiperespectral e LiDAR — mantém seus próprios centros de cluster, adaptados à sua forma particular de ver o mundo, mas todos os sensores compartilham uma única tabela de associações fuzzy. Essa tabela compartilhada registra, para cada pixel, graus suaves de pertencimento a cada grupo de cobertura do solo em vez de uma atribuição binária. Porque as duas imagens estão alinhadas espacialmente, o mesmo pixel em ambas as visões deve compartilhar esses valores de associação, vinculando os sensores ao nível da decisão. O método então ajusta em alternância as misturas de âncoras e as associações compartilhadas, buscando reconstruir os dados de cada sensor o mais fielmente possível enquanto preserva esse acordo entre sensores.

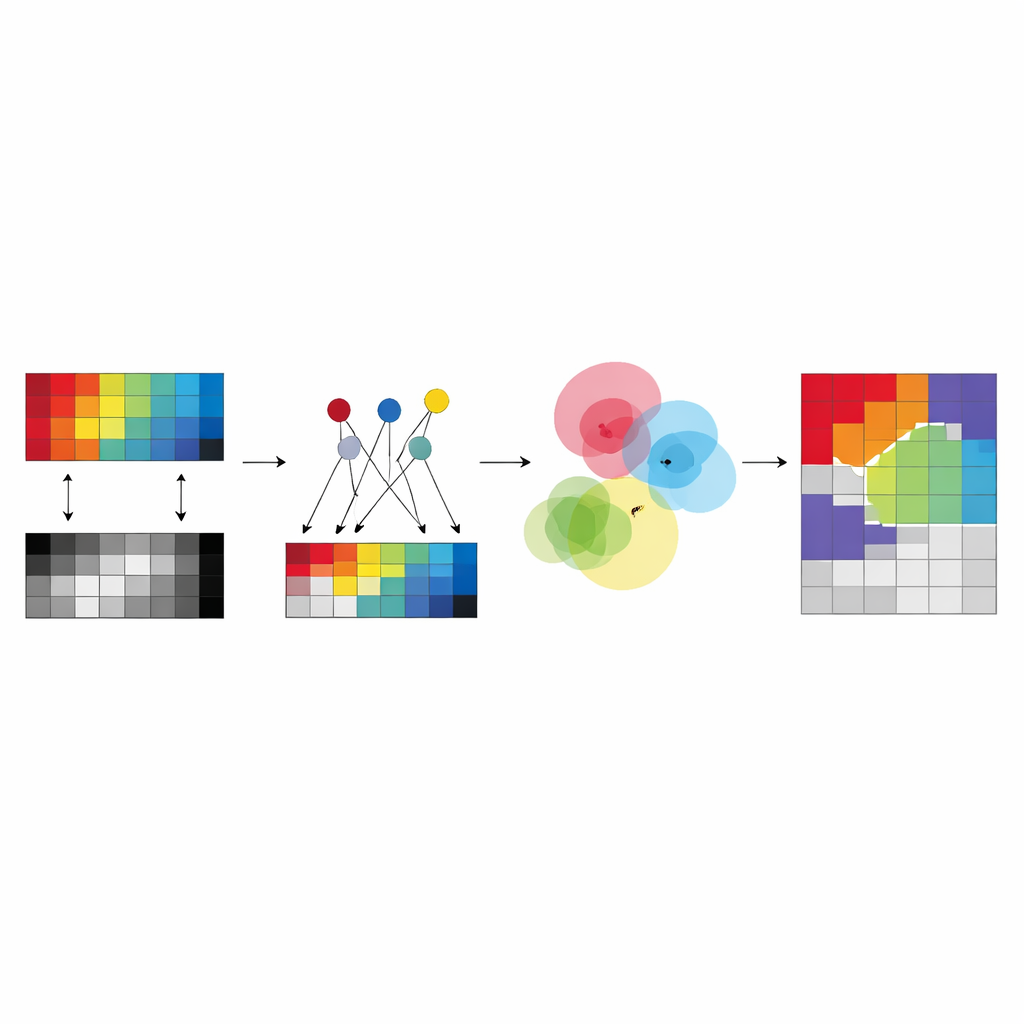

Indo Mais Fundo para Padrões Não Lineares

Para lidar melhor com relacionamentos complexos e não lineares nos dados, os autores estendem sua abordagem para uma versão profunda chamada ADMVFC. Aqui, um autoencoder convolucional compartilhado primeiro comprime as entradas hiperespectrais e LiDAR em uma representação latente comum. Um adaptador leve alinha os canais LiDAR com os canais hiperespectrais reduzidos antes da codificação, de modo que ambas as modalidades alimentem a mesma rede. Nesse espaço latente, aplica-se o mesmo esquema de clusterização fuzzy guiada por âncoras: âncoras resumem as características, centros de cluster são misturas de âncoras, e uma tabela compartilhada de associações fuzzy une as modalidades. O treinamento equilibra dois objetivos ao mesmo tempo — reconstruir cada sensor com precisão e encontrar uma clusterização conjunta no espaço latente que se ajuste a ambas as visões.

Submetendo o Método ao Teste

Os pesquisadores avaliam AMVFC e sua contraparte profunda em três áreas de referência: campos agrícolas perto de Trento, na Itália; cenas urbanas em Gulfport, Mississippi; e uma região complexa de cidade e subúrbio em Houston, Texas. Em cada caso, combinam imagens hiperespectrais com dados LiDAR correspondentes e comparam seus métodos com nove técnicas multimodais de clusterização já estabelecidas. A versão profunda, ADMVFC, entrega o melhor desempenho geral nos sítios de Trento e Gulfport, alcançando maior acurácia e melhor concordância com mapas rotulados por humanos, enquanto permanece mais rápida que muitos concorrentes baseados em grafos. Na cena mais intrincada de Houston, a AMVFC mais simples supera ligeiramente sua versão profunda, provavelmente porque a rede profunda tem dificuldade com o extremo desbalanceamento entre pixels de fundo e pixels rotulados do conjunto de dados. Em todos os testes, ambas as versões escalam quase linearmente com o número de amostras, tornando-as práticas para grandes coleções de sensoriamento remoto.

O Que Isso Significa para Mapear o Planeta

Em termos simples, este trabalho oferece uma maneira para diferentes “olhos” de satélite alcançarem uma compreensão comum do que enxergam na Terra, sem exigir supervisão humana. Ao fundamentar centros de cluster em pixels de âncora reais e forçar que dados hiperespectrais e LiDAR compartilhem atribuições fuzzy de grupos, os métodos produzem mapas de cobertura do solo mais confiáveis e interpretáveis do que muitas ferramentas existentes. A extensão profunda adiciona poder extra em cenas moderadamente complexas, enquanto o modelo original baseado em âncoras permanece robusto quando os dados são escassos ou ruidosos. Juntos, eles apontam para um mapeamento automático da superfície do planeta mais rápido, escalável e confiável.

Citação: Xiao, L., Liu, S. & Liu, Y. Anchor-guided multi-view fuzzy clustering for hyperspectral and LiDAR images. Sci Rep 16, 10175 (2026). https://doi.org/10.1038/s41598-026-40213-2

Palavras-chave: sensoriamento remoto, imagens multimodais, clusterização não supervisionada, hiperespectral e LiDAR, mapeamento de cobertura do solo