Clear Sky Science · pl

Klasteryzacja wielowidokowa prowadzona przez kotwice dla obrazów hiperspektralnych i LiDAR

Widzieć Ziemię Wyraźniej

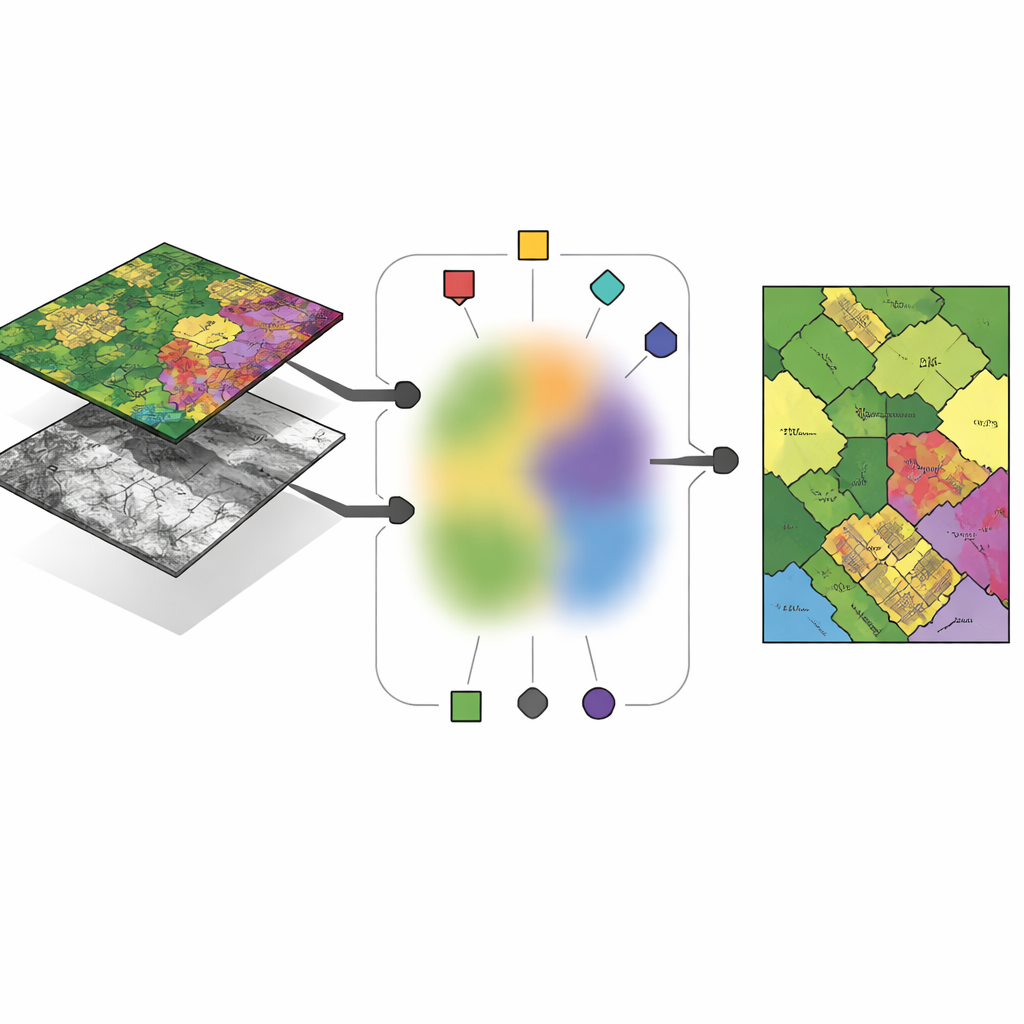

Od kondycji upraw po rozwój miast — satelity obserwują naszą planetę z niespotykaną dotąd szczegółowością. Różne czujniki jednak inaczej postrzegają ten sam obszar: jedne rejestrują subtelne barwy roślinności, inne uchwytują dokładny kształt budynków i ukształtowanie terenu. W tej pracy przedstawiono nowy sposób automatycznego grupowania obszarów lądowych w sensowne kategorie poprzez łączenie tych kontrastujących widoków, dzięki czemu systemy mogą lepiej rozumieć zmieniający się świat bez polegania na kosztownych, ręcznych etykietach.

Dlaczego Wiele Oczu Jest Lepsze niż Jedno

Współczesne misje obserwacji Ziemi rzadko korzystają tylko z jednego rodzaju kamery. Imager hiperspektralny mierzy dziesiątki, a nawet setki pasm kolorystycznych, ujawniając chemiczne „odciski palców” gleby, upraw i materiałów sztucznych. Czujniki LiDAR natomiast wysyłają impulsy laserowe, by zbudować trójwymiarowy obraz terenu, rejestrując wysokości budynków, korony drzew i subtelną strukturę powierzchni. Nad tym samym kwartałem miasta oba sensory są wyrównane piksel do piksela, lecz kodują bardzo różne informacje. Wyzwanie polega na pogrupowaniu tych pikseli w typy pokrycia terenu — takie jak budynki, drogi czy sady — w sposób wykorzystujący zalety każdego sensora, a jednocześnie prowadzący do wspólnej, spójnej decyzji o tym, co znajduje się na ziemi.

Kotwice: Reprezentatywne Punkty w Oceanie Danych

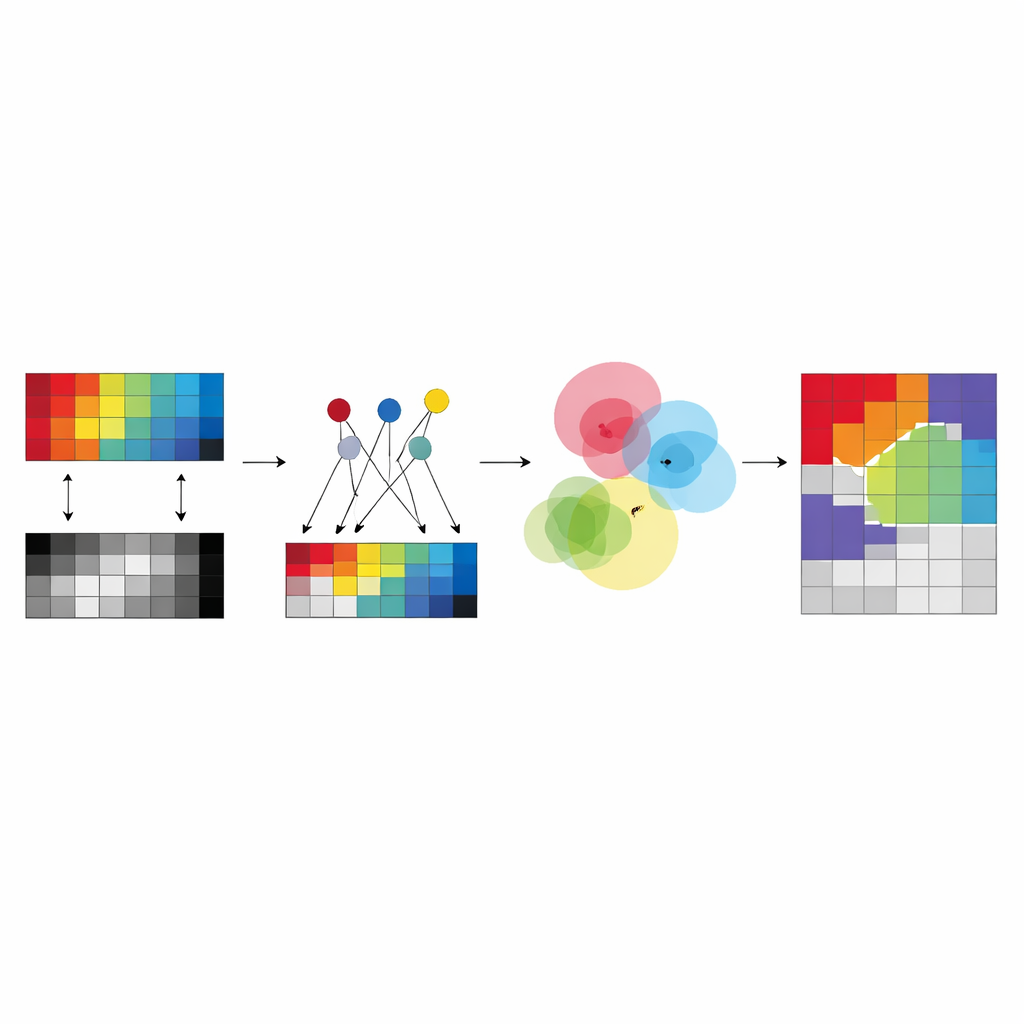

Zamiast pozwalać algorytmowi tworzyć całkowicie swobodne „centra” klastrów dla każdego sensora, autorzy proponują budowanie tych centrów z małego zbioru starannie wybranych pikseli zwanych kotwicami. Kotwice działają jak typowe przykłady podsumowujące główne wzorce w każdym obrazie. Każde centrum klastra w danym sensorze jest wyrażone jako ważona mieszanka jego kotwic, co zmusza centra do pozostawania blisko rzeczywistych, zaobserwowanych danych i zapobiega niestabilnym lub bezsensownym rozwiązaniom. Takie rozwiązanie redukuje liczbę swobodnych parametrów, które metoda musi wyuczyć, i ułatwia interpretację wyników: centrum klastra staje się „gdzieś pomiędzy tymi kilkoma konkretnymi pikselami-kotwicami” zamiast abstrakcyjnym punktem unoszącym się w przestrzeni o wysokim wymiarze.

Wspólne Członkostwo Grup Między Sensorami

Kluczową ideą nowego schematu, nazwanego anchor-guided multi-view fuzzy clustering (AMVFC), jest rozdzielenie „gdzie są klastry” od „jak silnie każdy piksel do nich należy”. Każdy sensor — hiperspektralny i LiDAR — zachowuje własne centra klastrów, dostosowane do jego specyficznego sposobu obserwacji, ale wszystkie sensory dzielą jedną tabelę rozmytych przynależności. Ta wspólna tabela zapisuje dla każdego piksela miękkie stopnie przynależności do każdej grupy pokrycia terenu zamiast twardego przydziału tak/nie. Ponieważ oba obrazy są wyrównane przestrzennie, ten sam piksel w obu widokach musi dzielić te wartości przynależności, łącząc sensory na poziomie decyzji. Metoda następnie kolejno koryguje mieszanki kotwic i wspólne przynależności, dążąc do jak najwierniejszego odtworzenia danych każdego sensora przy zachowaniu tej między-sensorowej zgodności.

Głębiej dla Nieliniowych Wzorów

Aby lepiej poradzić sobie ze złożonymi, nieliniowymi zależnościami w danych, autorzy rozszerzają swoje podejście do wersji głębokiej, nazwanej ADMVFC. Tutaj wspólny splotowy autoenkoder najpierw kompresuje zarówno wejścia hiperspektralne, jak i LiDAR do wspólnego reprezentacji utajonej. Lekki adapter wyrównuje kanały LiDAR z zredukowanymi kanałami hiperspektralnymi przed kodowaniem, tak by obie modalności trafiały do tej samej sieci. W tej przestrzeni utajonej stosuje się ten sam schemat klasteryzacji rozmytej prowadzonej przez kotwice: kotwice podsumowują cechy, centra klastrów są mieszankami kotwic, a wspólna tabela rozmytych przynależności łączy modalności. Trening równoważy jednocześnie dwa cele — wierne odtworzenie danych każdego sensora oraz znalezienie wspólnej klasteryzacji w przestrzeni utajonej, która pasuje do obu widoków.

Testowanie Metody

Naukowcy ocenili AMVFC i jego głębokiego odpowiednika na trzech obszarach referencyjnych: polach uprawnych w pobliżu Trydentu we Włoszech, scenach miejskich w Gulfport w Missisippi oraz złożonym obszarze miasta i przedmieść w Houston w Teksasie. W każdym przypadku łączyli obrazy hiperspektralne z odpowiadającymi danymi LiDAR i porównywali swoje metody z dziewięcioma ustalonymi technikami klasteryzacji multimodalnej. Wersja głęboka, ADMVFC, osiągnęła najlepsze wyniki ogólnie na stronach w Trydencie i Gulfport, uzyskując wyższą dokładność i lepszą zgodność z mapami oznaczonymi przez ludzi, przy jednoczesnym byciu szybszą niż wiele konkurencyjnych metod opartych na grafach. W bardziej skomplikowanej scenie w Houston prostszy AMVFC nieznacznie przewyższył swojego głębokiego brata, prawdopodobnie dlatego, że sieć głęboka miała trudności z ekstremalnym niezrównoważeniem zestawu danych między tłem a pikselami z etykietami. We wszystkich testach obie wersje skalują się niemal liniowo wraz z liczbą próbek, co czyni je praktycznymi dla dużych zbiorów teledetekcyjnych.

Co To Znaczy dla Mapowania Planety

Mówiąc prosto, praca ta oferuje sposób, aby różne «oczy» satelitarne osiągnęły wspólne rozumienie tego, co widzą na Ziemi, bez wymagania nadzoru człowieka. Poprzez osadzenie centrów klastrów w rzeczywistych pikselach-kotwicach i wymuszenie, by dane hiperspektralne i LiDAR dzieliły rozmyte przypisania grupowe, metody te generują bardziej wiarygodne, interpretowalne mapy pokrycia terenu niż wiele istniejących narzędzi. Rozszerzenie głębokie dodaje dodatkową moc w umiarkowanie złożonych scenach, podczas gdy pierwotny model oparty na kotwicach pozostaje odporny, gdy dane są skąpe lub zaszumione. Razem wskazują one drogę ku szybszemu, bardziej skalowalnemu i bardziej zaufanemu automatycznemu mapowaniu powierzchni naszej planety.

Cytowanie: Xiao, L., Liu, S. & Liu, Y. Anchor-guided multi-view fuzzy clustering for hyperspectral and LiDAR images. Sci Rep 16, 10175 (2026). https://doi.org/10.1038/s41598-026-40213-2

Słowa kluczowe: teledetekcja, obrazowanie multimodalne, klasteryzacja bez nadzoru, hiperspektralne i LiDAR, mapowanie pokrycia terenu