Clear Sky Science · it

Clustering fuzzy multi-visione guidata da ancore per immagini iperspettrali e LiDAR

Vedere la Terra più chiaramente

Dalla salute delle colture alla crescita urbana, i satelliti ora osservano il nostro pianeta con dettagli notevoli. Ma sensori diversi guardano lo stesso luogo in modi molto diversi: alcuni registrano colori sottili della vegetazione, altri catturano la forma esatta di edifici e terreno. Questo studio introduce un nuovo modo per raggruppare automaticamente aree di territorio in categorie significative combinando queste viste contrastanti, così che le macchine possano comprendere meglio il nostro mondo in cambiamento senza dipendere da costose etichette create dall’uomo.

Perché molti occhi sono meglio di uno solo

Le missioni moderne di osservazione della Terra raramente si affidano a un unico tipo di sensore. Gli strumenti iperspettrali misurano dozzine o persino centinaia di bande di colore, rivelando impronte chimiche di suolo, colture e materiali artificiali. I sensori LiDAR, al contrario, emettono impulsi laser per ricostruire un quadro tridimensionale del terreno, catturando altezze degli edifici, chiome degli alberi e strutture superficiali sottili. Sullo stesso isolato, entrambi i sensori sono allineati pixel per pixel, ma codificano informazioni molto diverse. La sfida è raggruppare, o clusterizzare, questi pixel in tipi di copertura del suolo — come edifici, strade o frutteti — in modo da sfruttare i punti di forza di ciascun sensore ma arrivare comunque a una decisione condivisa e coerente su ciò che è presente a terra.

Ancore: punti rappresentativi in un mare di dati

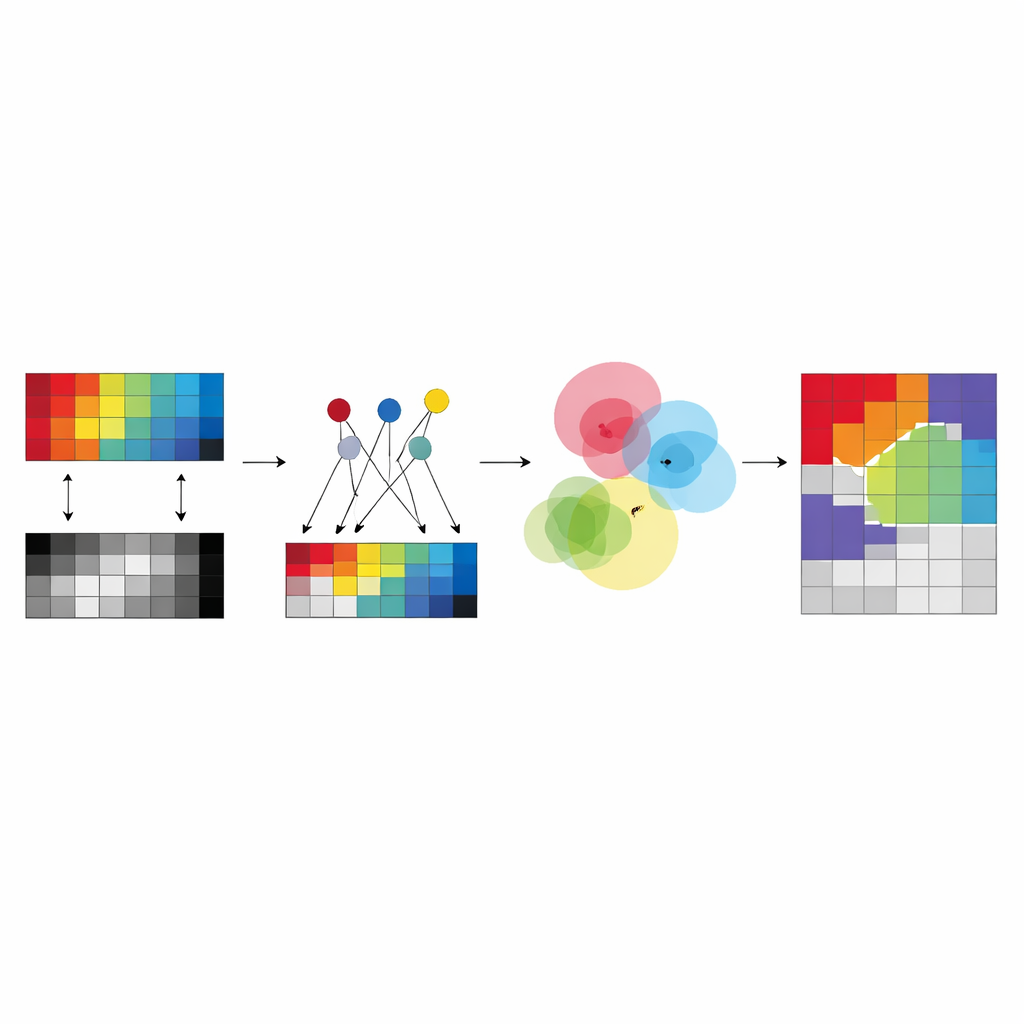

Invece di lasciare che l’algoritmo inventi liberamente «centri» per ogni cluster in ciascun sensore, gli autori propongono di costruire questi centri a partire da un piccolo insieme di pixel scelti con cura, chiamati ancore. Queste ancore funzionano come esempi tipici che riassumono i principali schemi in ogni immagine. Ogni centro di cluster in un dato sensore è espresso come una miscela pesata delle sue ancore, il che costringe i centri a restare vicini a dati reali osservati ed evita soluzioni instabili o prive di significato. Questa progettazione riduce il numero di parametri liberi che il metodo deve apprendere e rende i risultati più facili da interpretare: un centro di cluster diventa «da qualche parte tra questi pochi pixel ancorati concreti» invece di un punto astratto che fluttua in uno spazio ad alta dimensionalità.

Condividere l’appartenenza ai gruppi tra i sensori

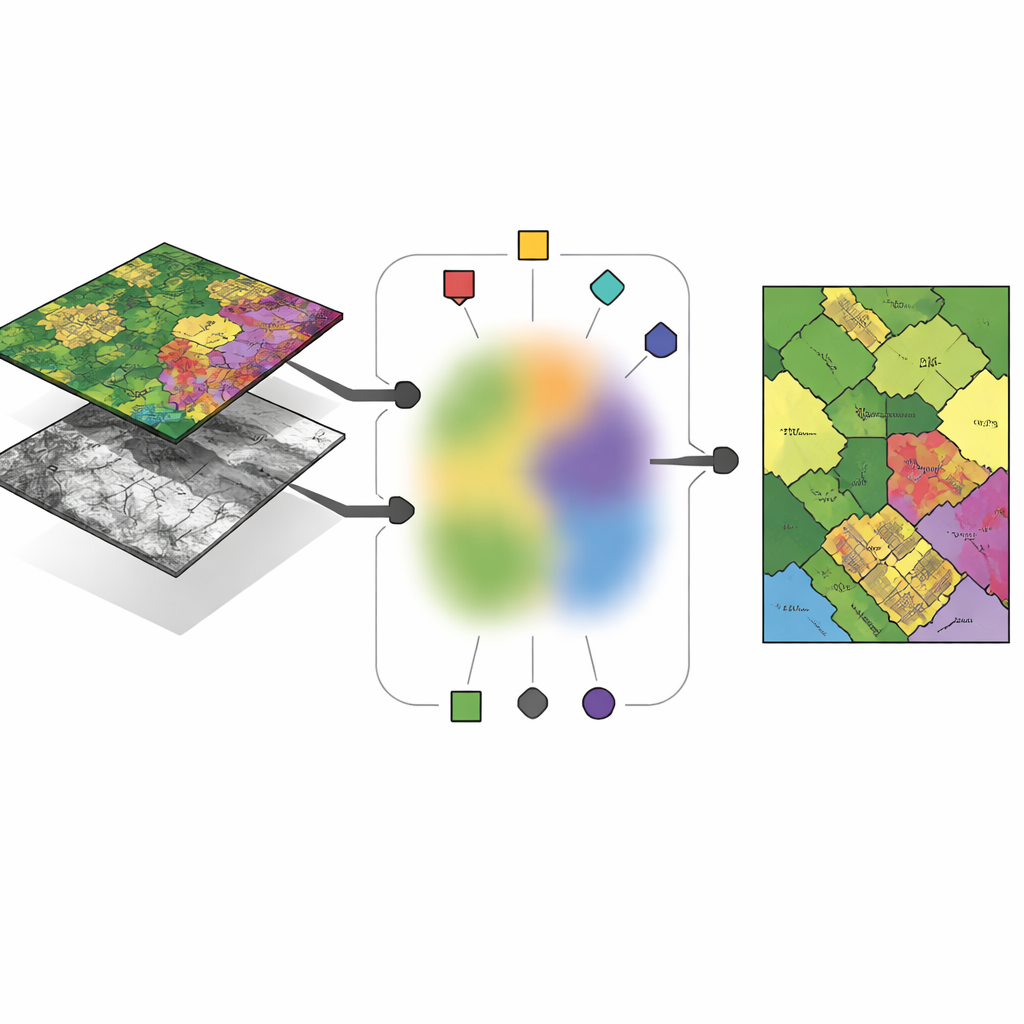

L’idea chiave del nuovo quadro, chiamato anchor-guided multi-view fuzzy clustering (AMVFC), è separare «dove si trovano i cluster» da «quanto fortemente ogni pixel vi appartiene». Ogni sensore — iperspettrale e LiDAR — mantiene i propri centri di cluster, adattati al suo particolare modo di osservare il mondo, ma tutti i sensori condividono un’unica tabella di appartenenze fuzzy. Questa tabella condivisa registra, per ogni pixel, gradi morbidi di appartenenza a ciascun gruppo di copertura del suolo invece di una assegnazione netta sì/no. Poiché le due immagini sono allineate spazialmente, lo stesso pixel in entrambe le viste deve condividere questi valori di appartenenza, legando i sensori a livello decisionale. Il metodo quindi aggiusta a turno le miscele di ancore e le appartenenze condivise, cercando di ricostruire i dati di ciascun sensore il più accuratamente possibile preservando questo accordo cross-sensore.

Approfondire per catturare pattern non lineari

Per gestire meglio relazioni complesse e non lineari nei dati, gli autori estendono il loro approccio in una versione profonda chiamata ADMVFC. Qui, un autoencoder convoluzionale condiviso comprime prima gli input iperspettrali e LiDAR in una rappresentazione latente comune. Un adattatore leggero allinea i canali LiDAR con i canali iperspettrali ridotti prima della codifica, in modo che entrambe le modalità vengano alimentate nella stessa rete. In questo spazio latente, si applica lo stesso schema di clustering fuzzy guidato da ancore: le ancore riassumono le caratteristiche, i centri dei cluster sono miscele di ancore e una tabella di appartenenza fuzzy condivisa lega le modalità insieme. L’addestramento bilancia contemporaneamente due obiettivi — ricostruire accuratamente ciascun sensore e trovare un clustering congiunto nello spazio latente che si adatti a entrambe le viste.

Mettere il metodo alla prova

I ricercatori valutano AMVFC e la sua controparte profonda su tre aree di benchmark: campi agricoli vicino a Trento in Italia, scene urbane a Gulfport, Mississippi, e una regione complessa città‑periferia a Houston, Texas. In ogni caso combinano immagini iperspettrali con dati LiDAR corrispondenti e confrontano i loro metodi con nove tecniche consolidate di clustering multimodale. La versione profonda, ADMVFC, fornisce le migliori prestazioni complessive nei siti di Trento e Gulfport, raggiungendo maggiore accuratezza e migliore concordanza con mappe etichettate dall’uomo pur rimanendo più veloce di molti concorrenti pesanti sui grafi. Sulla scena più intricata di Houston, l’AMVFC più semplice supera leggermente la sua versione profonda, probabilmente perché la rete profonda fatica con l’estrema sbilanciamento del dataset tra sfondo e pixel etichettati. In tutti i test, entrambe le versioni scalano quasi linearmente con il numero di campioni, rendendole pratiche per collezioni di telerilevamento di grandi dimensioni.

Cosa significa per la mappatura del pianeta

In termini chiari, questo lavoro offre un modo perché diversi «occhi» satellitari raggiungano una comprensione comune di ciò che vedono sulla Terra, senza richiedere supervisione umana. Radicando i centri dei cluster in pixel ancorati reali e costringendo i dati iperspettrali e LiDAR a condividere assegnazioni di gruppo fuzzy, i metodi producono mappe di copertura del suolo più affidabili e interpretabili rispetto a molti strumenti esistenti. L’estensione profonda aggiunge potenza extra su scene moderatamente complesse, mentre il modello originale basato su ancore rimane robusto quando i dati sono scarsi o rumorosi. Insieme, indicano una direzione verso una mappatura automatica della superficie terrestre più veloce, scalabile e affidabile.

Citazione: Xiao, L., Liu, S. & Liu, Y. Anchor-guided multi-view fuzzy clustering for hyperspectral and LiDAR images. Sci Rep 16, 10175 (2026). https://doi.org/10.1038/s41598-026-40213-2

Parole chiave: telerilevamento, imaging multimodale, clustering non supervisionato, iperspettrale e LiDAR, mappatura della copertura del suolo