Clear Sky Science · de

Ankergeführte Multi-View-Fuzzy-Clustering für Hyperspektral- und LiDAR-Bilder

Die Erde klarer sehen

Von der Gesundheit von Nutzpflanzen bis zum Wachstum von Städten beobachten Satelliten unseren Planeten heute in bemerkenswerter Detailtiefe. Unterschiedliche Sensoren erfassen denselben Ort jedoch auf sehr verschiedene Weise: Einige registrieren feine Farbnuancen der Vegetation, andere erfassen die genaue Form von Gebäuden und Gelände. Diese Studie stellt eine neue Methode vor, um Landflächen automatisch in sinnvolle Kategorien zu gruppieren, indem sie diese kontrastierenden Blickwinkel kombiniert, sodass Maschinen unsere sich wandelnde Welt besser ohne teure, menschliche Beschriftungen verstehen können.

Warum mehrere Augen besser sind als eines

Moderne Erdbeobachtungsmissionen verlassen sich selten auf nur eine Kameratechnologie. Hyperspektrale Sensoren messen Dutzende bis Hunderte von Farbkanälen und offenbaren chemische Signaturen von Boden, Nutzpflanzen und künstlichen Materialien. LiDAR-Sensoren hingegen senden Laserpulse aus, um ein dreidimensionales Bild des Geländes zu erstellen und Gebäudehöhen, Baumkronen sowie feine Oberflächenstrukturen zu erfassen. Über demselben Stadtblock sind beide Sensoren pixelgenau ausgerichtet, liefern jedoch sehr unterschiedliche Informationen. Die Aufgabe besteht darin, diese Pixel in Landbedeckungstypen — etwa Gebäude, Straßen oder Plantagen — zu clustern, so dass die Stärken jedes Sensors genutzt werden und dennoch eine einheitliche, konsistente Entscheidung darüber entsteht, was sich am Boden befindet.

Anker: Repräsentative Punkte in einem Datenmeer

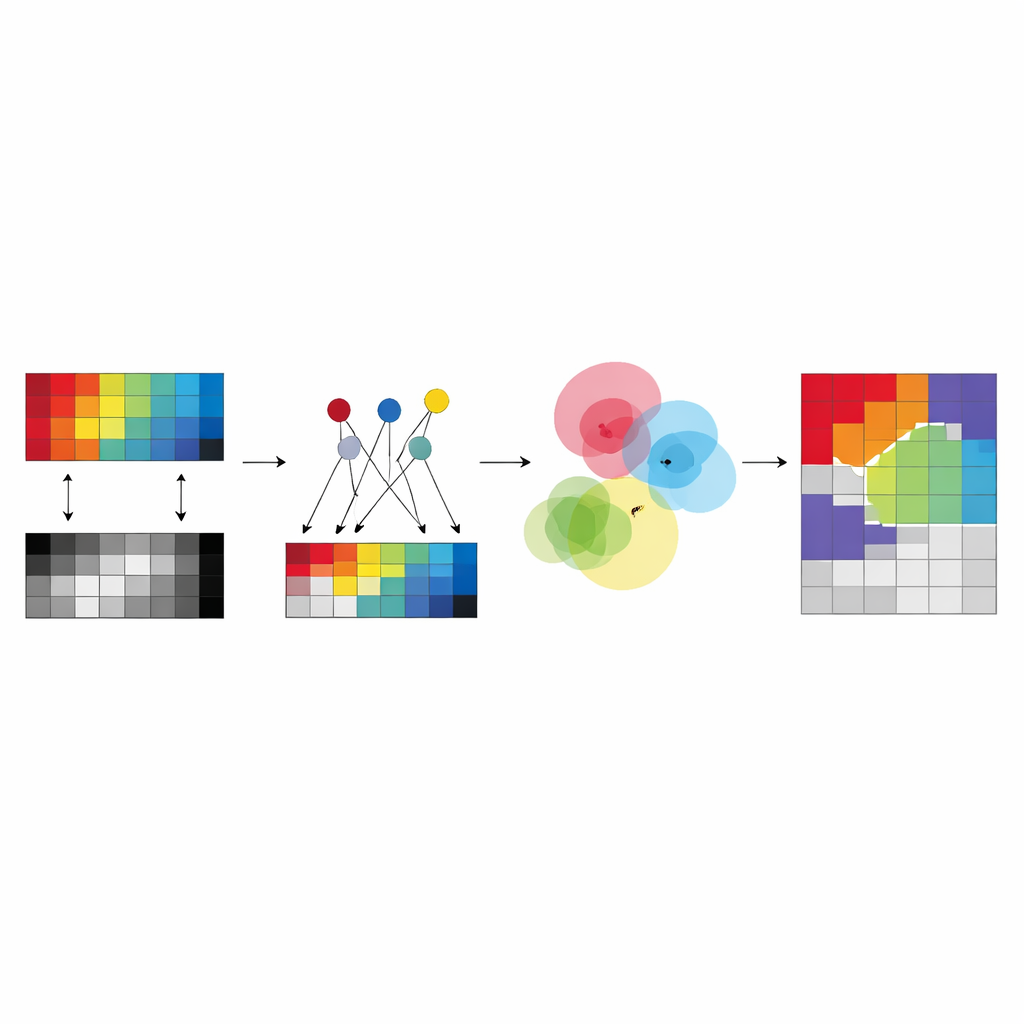

Anstatt dem Algorithmus völlig freie „Zentren" für jedes Cluster in jedem Sensor zu erlauben, schlagen die Autoren vor, diese Zentren aus einer kleinen Menge sorgfältig ausgewählter Pixel zu bilden, die Anker genannt werden. Diese Anker fungieren wie typische Beispiele, die die Hauptmuster in jedem Bild zusammenfassen. Jedes Clusterzentrum in einem gegebenen Sensor wird als gewichtete Mischung seiner Anker ausgedrückt, wodurch die Zentren nahe an realen, beobachteten Daten bleiben und instabile oder bedeutungslose Lösungen vermieden werden. Dieses Design reduziert die Anzahl freier Parameter, die das Verfahren lernen muss, und macht die Ergebnisse leichter interpretierbar: Ein Clusterzentrum wird zu „etwas zwischen diesen wenigen konkreten Ankerpixeln“ statt zu einem abstrakten Punkt in einem hochdimensionalen Raum.

Geteilte Gruppenzugehörigkeit über Sensoren hinweg

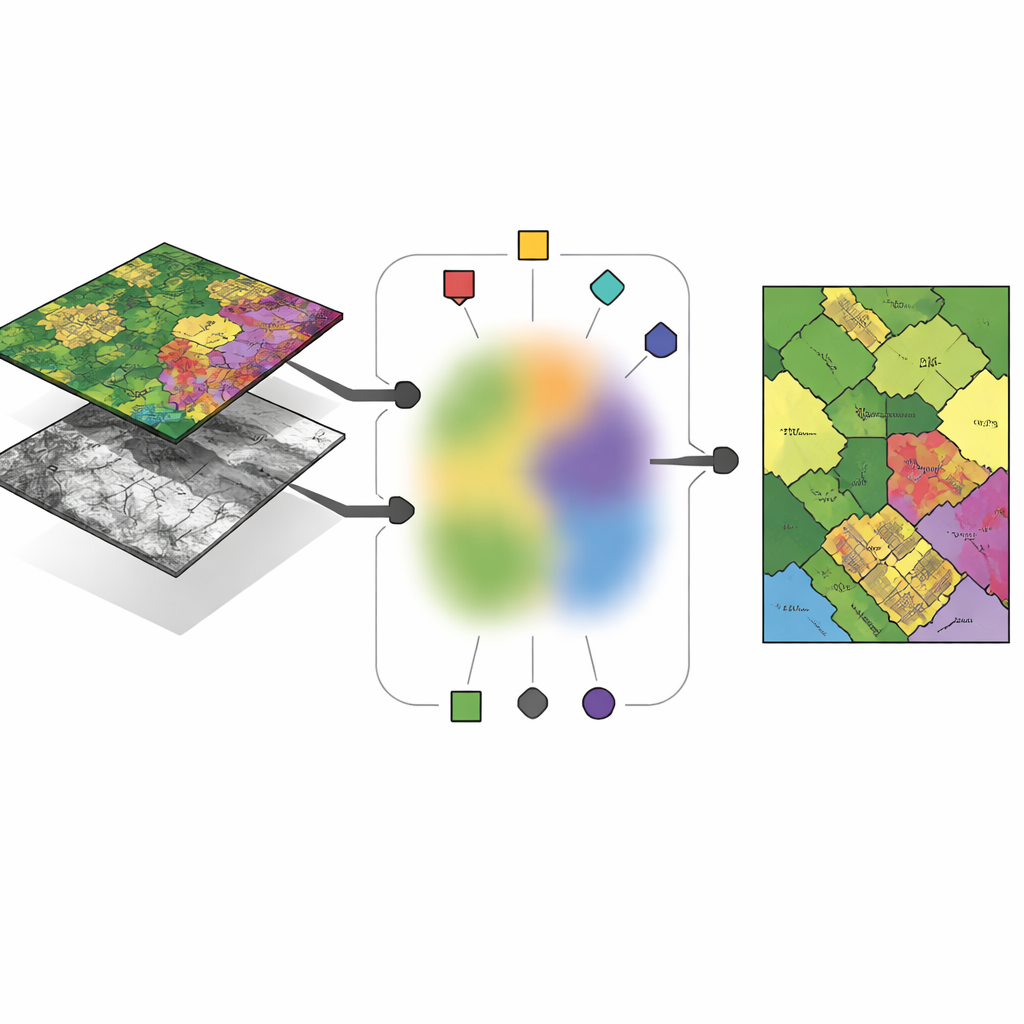

Die Schlüsselidee des neuen Rahmens, genannt anchor-guided multi-view fuzzy clustering (AMVFC), ist, „wo die Cluster liegen" von „wie stark jedes Pixel zu ihnen gehört" zu trennen. Jeder Sensor — Hyperspektral und LiDAR — behält seine eigenen Clusterzentren bei, abgestimmt auf seine jeweilige Sichtweise, aber alle Sensoren teilen eine einzige Tabelle mit fuzzy Zugehörigkeiten. Diese gemeinsame Tabelle verzeichnet für jedes Pixel weiche Zugehörigkeitsgrade zu jeder Landbedeckungsgruppe statt einer harten Ja‑oder‑Nein‑Zuteilung. Da die beiden Bilder räumlich ausgerichtet sind, muss dasselbe Pixel in beiden Ansichten diese Zugehörigkeitswerte teilen und verbindet so die Sensoren auf der Entscheidungsebene. Die Methode passt dann abwechselnd die Ankermischungen und die gemeinsamen Zugehörigkeiten an, mit dem Ziel, die Daten jedes Sensors möglichst genau zu rekonstruieren und gleichzeitig diese sensorsübergreifende Übereinstimmung zu bewahren.

Den Nichtlinearitäten tiefer nachgehen

Um komplexe, nichtlineare Zusammenhänge in den Daten besser zu handhaben, erweitern die Autoren ihren Ansatz zu einer tiefen Version namens ADMVFC. Hier komprimiert ein gemeinsamer konvolutionaler Autoencoder zunächst sowohl Hyperspektral- als auch LiDAR-Eingaben in eine gemeinsame latente Repräsentation. Ein leichter Adapter gleicht die LiDAR-Kanäle mit den reduzierten Hyperspektralkanälen vor der Kodierung ab, sodass beide Modalitäten in dasselbe Netzwerk eingespeist werden. In diesem latenten Raum wird dasselbe ankergeführte fuzzy Clustering angewandt: Anker fassen die Merkmale zusammen, Clusterzentren sind Mischungen von Ankern und eine gemeinsame Fuzzy‑Zugehörigkeitstabelle verbindet die Modalitäten. Das Training balanciert zwei Ziele zugleich — die genaue Rekonstruktion jedes Sensors und das Finden eines gemeinsamen Clusterings im latenten Raum, das zu beiden Ansichten passt.

Die Methode auf die Probe stellen

Die Forschenden bewerten AMVFC und seine tiefe Entsprechung in drei Benchmark-Gebieten: landwirtschaftliche Felder bei Trento in Italien, städtische Szenen in Gulfport, Mississippi, und eine komplexe Stadt‑und‑Vorstadt‑Region in Houston, Texas. In jedem Fall kombinieren sie hyperspektrale Bilder mit passenden LiDAR‑Daten und vergleichen ihre Methoden mit neun etablierten multimodalen Clustering‑Techniken. Die tiefe Version, ADMVFC, erzielt die beste Gesamtleistung in den Gebieten Trento und Gulfport, erreicht höhere Genauigkeit und bessere Übereinstimmung mit menschlich beschrifteten Karten und bleibt dabei schneller als viele graphlastige Konkurrenten. In der komplexeren Houston‑Szene übertrifft das einfachere AMVFC leicht seinen tiefen Bruder, wahrscheinlich weil das tiefe Netzwerk mit der extremen Ungleichverteilung zwischen Hintergrund- und beschrifteten Pixeln des Datensatzes zu kämpfen hat. In allen Tests skalieren beide Versionen nahezu linear mit der Stichprobengröße, was sie praktisch für große Fernerkundungsbestände macht.

Was das für die Kartierung des Planeten bedeutet

Einfach gesagt bietet diese Arbeit eine Möglichkeit, wie verschiedene „Augen" von Satelliten zu einem gemeinsamen Verständnis dessen gelangen können, was sie auf der Erde sehen, ohne menschliche Aufsicht zu benötigen. Indem Clusterzentren in reale Ankerpixel verankert werden und Hyperspektral‑ und LiDAR‑Daten gezwungen werden, fuzzy Gruppen-Zuweisungen zu teilen, liefern die Methoden zuverlässigere, besser interpretierbare Landbedeckungskarten als viele bestehende Werkzeuge. Die tiefe Erweiterung bringt zusätzliche Leistungsfähigkeit in mäßig komplexen Szenen, während das ursprüngliche, ankerbasierte Modell robust bleibt, wenn Daten spärlich oder verrauscht sind. Zusammen deuten sie auf schnellere, skalierbarere und vertrauenswürdigere automatische Kartierungen der Erdoberfläche hin.

Zitation: Xiao, L., Liu, S. & Liu, Y. Anchor-guided multi-view fuzzy clustering for hyperspectral and LiDAR images. Sci Rep 16, 10175 (2026). https://doi.org/10.1038/s41598-026-40213-2

Schlüsselwörter: Fernerkundung, multimodale Bildgebung, unüberwachtes Clustering, Hyperspektral und LiDAR, Landbedeckungskartierung