Clear Sky Science · it

Filtraggio adattivo multi-scala e sinergia AtRes_SRU–trasformatore per la classificazione istopatologica del cancro al seno

Perché è importante per pazienti e medici

Individuare il cancro al seno precocemente può fare la differenza tra un trattamento semplice e una malattia potenzialmente letale, tuttavia l’esame dei tessuti al microscopio è un lavoro lento e soggettivo. Questo articolo presenta un nuovo sistema informatico che aiuta i patologi a classificare le immagini di tessuto mammario in casi innocui o pericolosi con maggiore accuratezza ed efficienza. Pulendo con cura le immagini e combinando diversi tipi di intelligenza artificiale, il sistema mira a favorire diagnosi più precoci, meno tumori mancati e meno falsi allarmi.

Pulire l’immagine prima di decidere

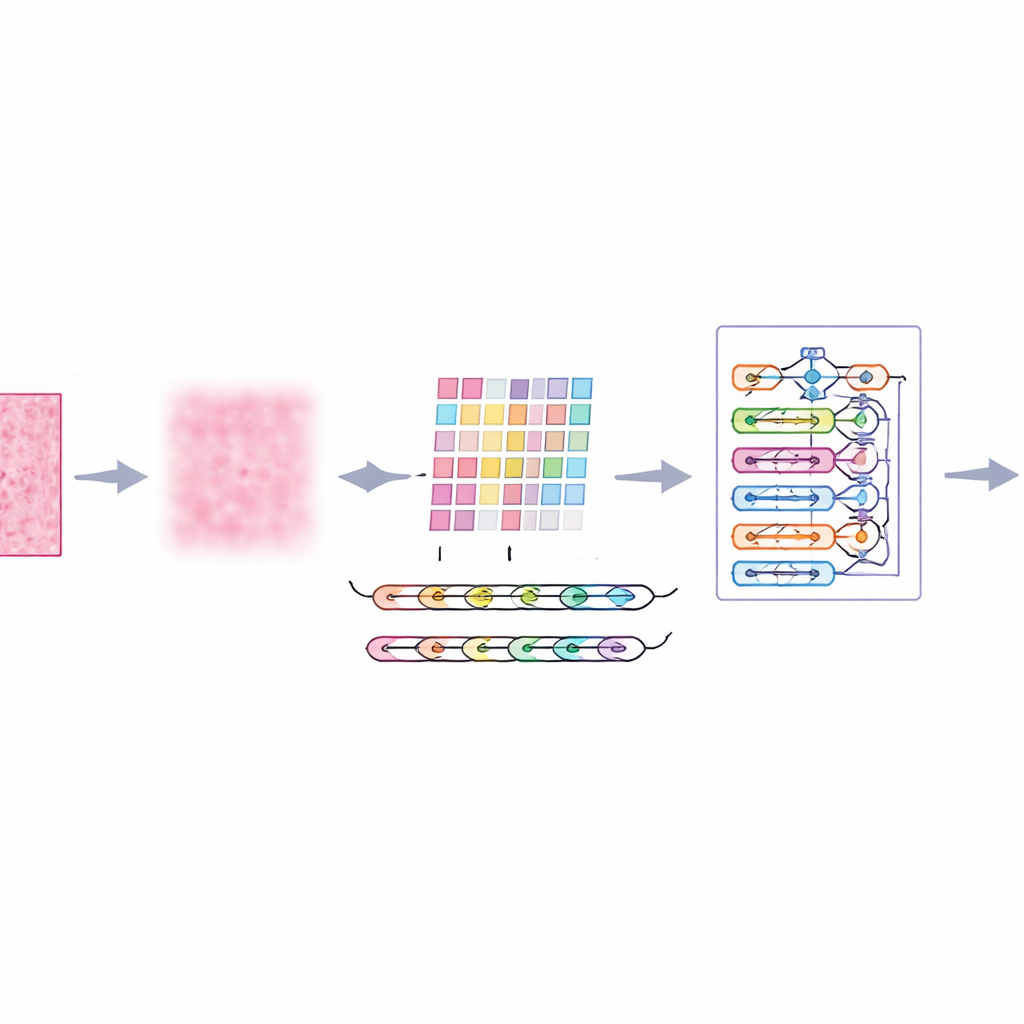

Le immagini al microscopio del tessuto mammario sono lontane dall’essere perfette. Contengono puntini casuali, illuminazione non uniforme e variazioni di colore dovute alla colorazione, elementi che possono confondere anche algoritmi avanzati. Gli autori introducono una fase iniziale chiamata filtraggio adattivo multi-scala, che agisce come un filtro intelligente e delicato contro il rumore. Invece di sfocare tutto allo stesso modo, analizza l’immagine a diversi livelli di dettaglio e si adatta al contrasto locale e alla texture. Il risultato è la riduzione del rumore distraente e degli artefatti di colorazione, preservando invece i bordi importanti — come i confini tra gruppi di cellule. Questo offre alle fasi successive del sistema una vista più chiara e affidabile di ciascuna porzione di tessuto.

Insegnare al computer a seguire i pattern tissutali

Il tessuto mammario non racconta la sua storia un pixel alla volta; il significato emerge da come le regioni vicine si relazionano tra loro. Per catturare questo, il sistema suddivide ogni immagine filtrata in piccole porzioni e le invia a un estrattore di caratteristiche chiamato AtRes_SRU. Questa componente combina una rete residua profonda, efficace nell’individuare forme e texture, con un’unità ricorrente leggera che tratta le porzioni adiacenti come passi di una sequenza. Pur non essendoci movimento nel tempo, disporre le porzioni in ordine permette al modello di apprendere come le strutture si estendono attraverso il vetrino — dove iniziano e finiscono gli ammassi cellulari, come le ghiandole si curvano o si rompono, e come le regioni anomale si inseriscono in tessuto più regolare. Un meccanismo di attenzione spinge ulteriormente il sistema a concentrarsi sulle regioni più sospette, come nuclei irregolari o ammassi cellulari insolitamente densi.

Vedere l’intero vetrino, non solo piccoli pezzi

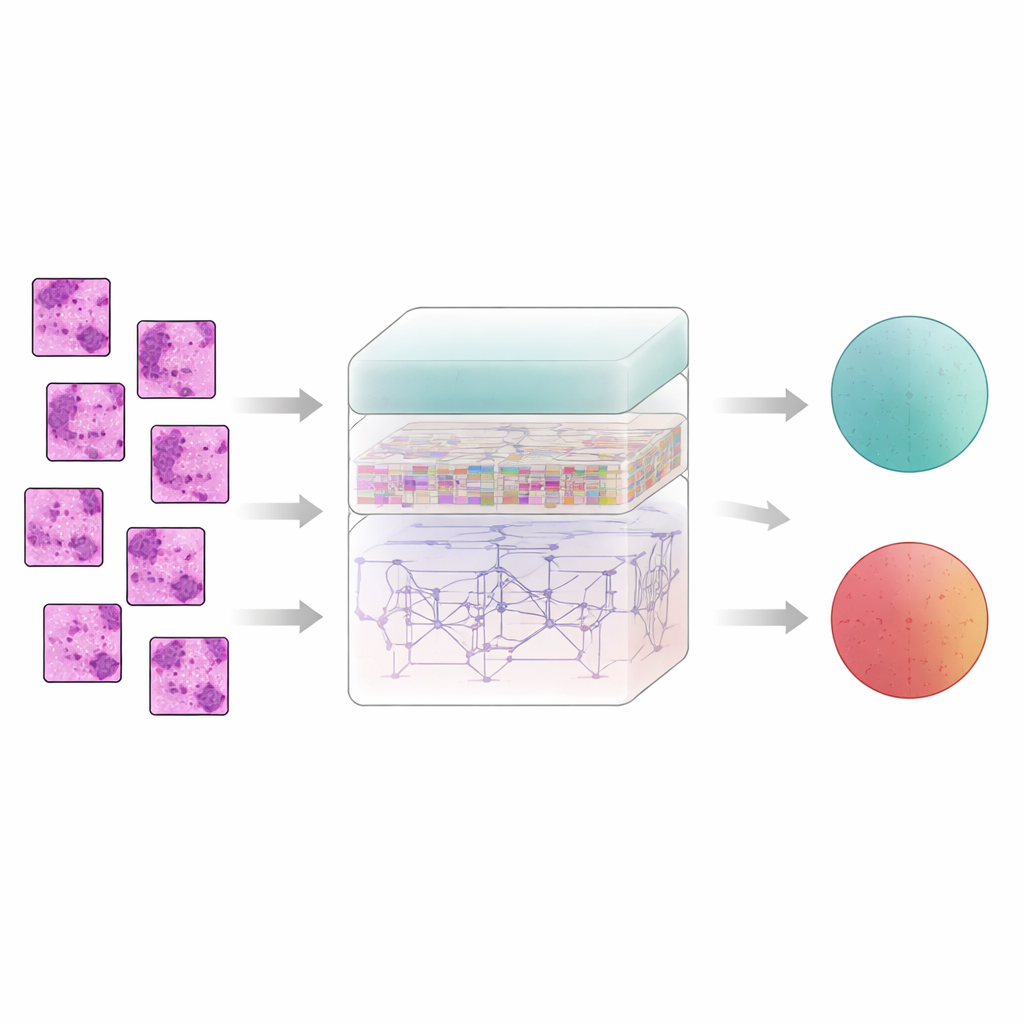

Se i pattern locali contano, il cancro spesso si rivela anche attraverso l’organizzazione a scala più ampia: quanto sono disseminate le zone anomale, quanto si estendono e come interagiscono con il tessuto circostante. Per cogliere questo quadro più ampio, gli autori aggiungono un modulo trasformatore, una tecnologia sviluppata inizialmente per i modelli linguistici. Qui ogni porzione diventa un token e il trasformatore impara come ogni porzione si relaziona con tutte le altre. Una forma di codifica della posizione assoluta indica al modello esattamente da dove proviene ciascuna porzione nel vetrino originale, preservando la disposizione spaziale. Su questo si innesta uno strato decisionale densamente connesso che riutilizza caratteristiche provenienti da molte profondità della rete, aiutando il sistema a mantenere sia i dettagli fini sia il contesto globale quando decide infine se un campione è benigno o maligno.

Mettere il sistema alla prova

I ricercatori hanno addestrato e valutato il loro framework “ImTranNet‑TriCore” su una vasta raccolta pubblica di immagini istopatologiche mammarie, che include oltre un quarto di milione di piccole porzioni provenienti da pazienti reali, scansionate a diversi livelli di ingrandimento. Il dataset è impegnativo: l’aspetto dei tessuti varia molto tra i vetrini e le aree maligne possono essere sottili o occupare solo una piccola parte dell’immagine. Nonostante ciò, il nuovo sistema ha raggiunto circa il 98% di accuratezza nel distinguere porzioni cancerose da quelle non cancerose e ha mantenuto prestazioni solide su tutti i livelli di ingrandimento. Ha sistematicamente superato una gamma di metodi largamente usati, incluse reti convoluzionali convenzionali, modelli con attenzione e design ibridi che mescolano deep learning con machine learning tradizionale.

Dai numeri alla fiducia nelle cliniche reali

Un’elevata accuratezza da sola non basta in medicina; i medici hanno bisogno di capire perché un sistema prende determinate decisioni. Gli autori hanno quindi esaminato quali regioni dell’immagine influenzano maggiormente le scelte del modello usando mappe di calore e strumenti di importanza delle caratteristiche. Hanno osservato che il sistema tende a evidenziare le stesse strutture su cui i patologi si concentrano: le forme e i confini dei nuclei cellulari, l’organizzazione delle ghiandole e gli ammassi densi di tessuto anomalo. Allo stesso tempo, il modello mantiene bassi i falsi allarmi e mostra punteggi di confidenza ben calibrati, importanti per evitare sia tumori mancati sia biopsie non necessarie. Pur avendo ancora difficoltà con alcune differenze molto sottili a ingrandimenti estremi, lo studio suggerisce che combinare una pulizia attenta dell’immagine, il tracciamento dei pattern locali e il contesto dell’intero vetrino può avvicinare notevolmente la valutazione automatizzata del cancro al seno all’affidabilità richiesta dai clinici.

Citazione: Saravana Kumar, N.M., Kandala, M.K., Kaveri, P.R. et al. A multi-scale adaptive filtering and AtRes_SRU–transformer synergy for breast cancer histopathology classification. Sci Rep 16, 14387 (2026). https://doi.org/10.1038/s41598-026-41153-7

Parole chiave: istopatologia del cancro al seno, analisi di immagini mediche, apprendimento profondo, modelli trasformatore, diagnosi assistita da computer