Clear Sky Science · fr

Filtrage adaptatif multi-échelle et synergie AtRes_SRU–transformer pour la classification histopathologique du cancer du sein

Pourquoi cela compte pour les patientes et les médecins

Détecter le cancer du sein précocement peut faire la différence entre un traitement simple et une maladie potentiellement mortelle, pourtant l'examen des tissus au microscope reste un travail lent et subjectif. Cet article présente un nouveau système informatique qui aide les pathologistes à classer les images de tissus mammaires en cas bénins ou dangereux de façon plus précise et plus efficace. En nettoyant soigneusement les images et en combinant plusieurs types d'intelligence artificielle, le système vise à soutenir un diagnostic plus précoce, à réduire les cancers manqués et à limiter les fausses alertes inutiles.

Nettoyer l'image avant de trancher

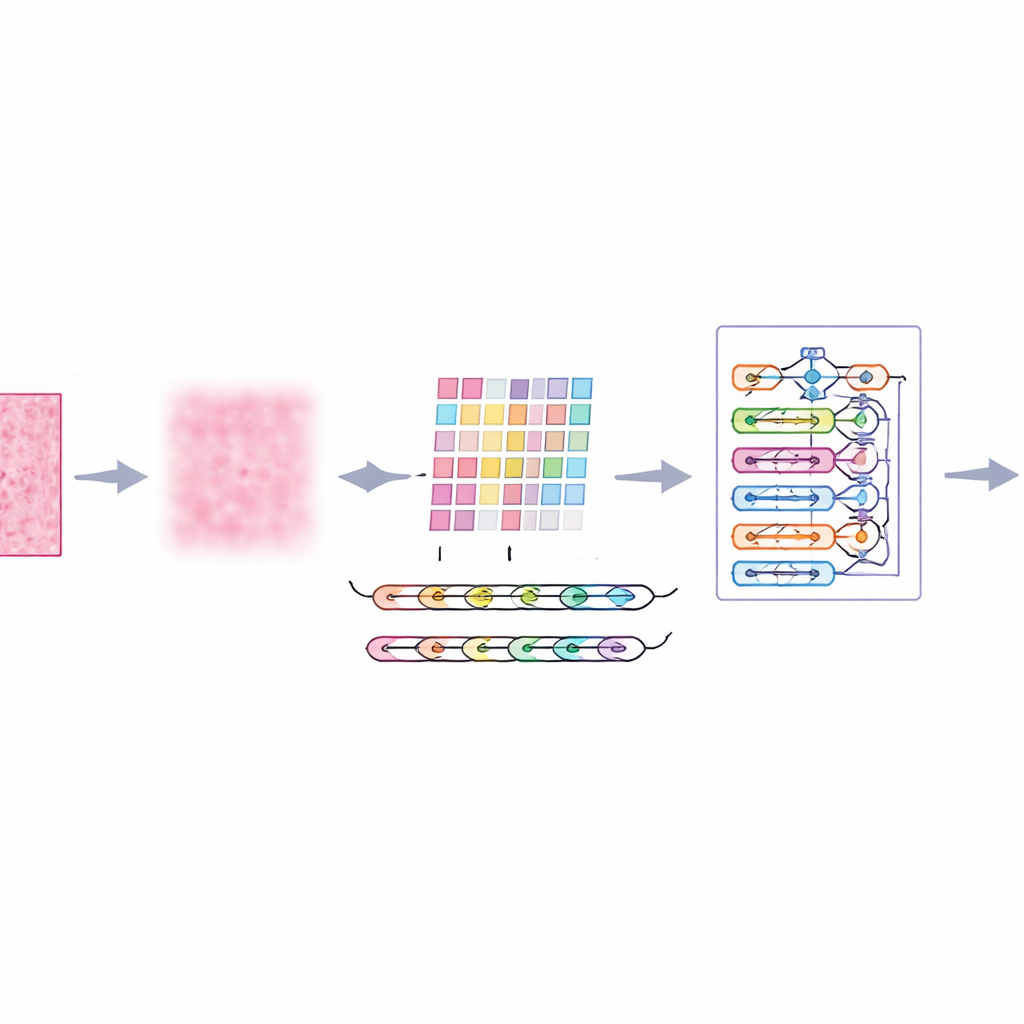

Les images microscopiques des tissus mammaires sont loin d'être parfaites. Elles contiennent des points aléatoires, un éclairage inégal et des variations de couleur liées à la coloration, autant d'éléments qui peuvent perturber même des algorithmes avancés. Les auteurs introduisent une étape de prétraitement appelée filtrage adaptatif multi‑échelle, qui agit comme un filtre intelligent et doux contre le bruit. Plutôt que de tout flouter de manière uniforme, il analyse l'image à plusieurs niveaux de détail et s'adapte au contraste local et à la texture. Le résultat est une réduction du bruit distrayant et des artefacts de coloration, tout en préservant les bords importants — par exemple les limites entre groupes cellulaires. Cela offre aux étapes suivantes une vue plus claire et plus fiable de chaque patch de tissu.

Apprendre à l'ordinateur à suivre les motifs tissulaires

Le tissu mammaire ne raconte pas son histoire pixel par pixel ; le sens émerge des relations entre régions voisines. Pour capturer cela, le système découpe chaque image filtrée en petits patches et les alimente dans un extracteur de caractéristiques appelé AtRes_SRU. Cette partie combine un réseau résiduel profond, efficace pour repérer formes et textures, avec une unité récurrente légère qui traite les patches adjacents comme des étapes d'une séquence. Bien que rien ne se déplace dans le temps, ordonner les patches permet au modèle d'apprendre comment les structures se déploient sur la lame — où commencent et finissent les amas cellulaires, comment les glandes se courbent ou se rompent, et comment les régions anormales s'insèrent dans un tissu plus régulier. Un mécanisme d'attention incite en outre le système à se concentrer sur les régions les plus suspectes, comme des noyaux irréguliers ou des amas cellulaires anormalement denses.

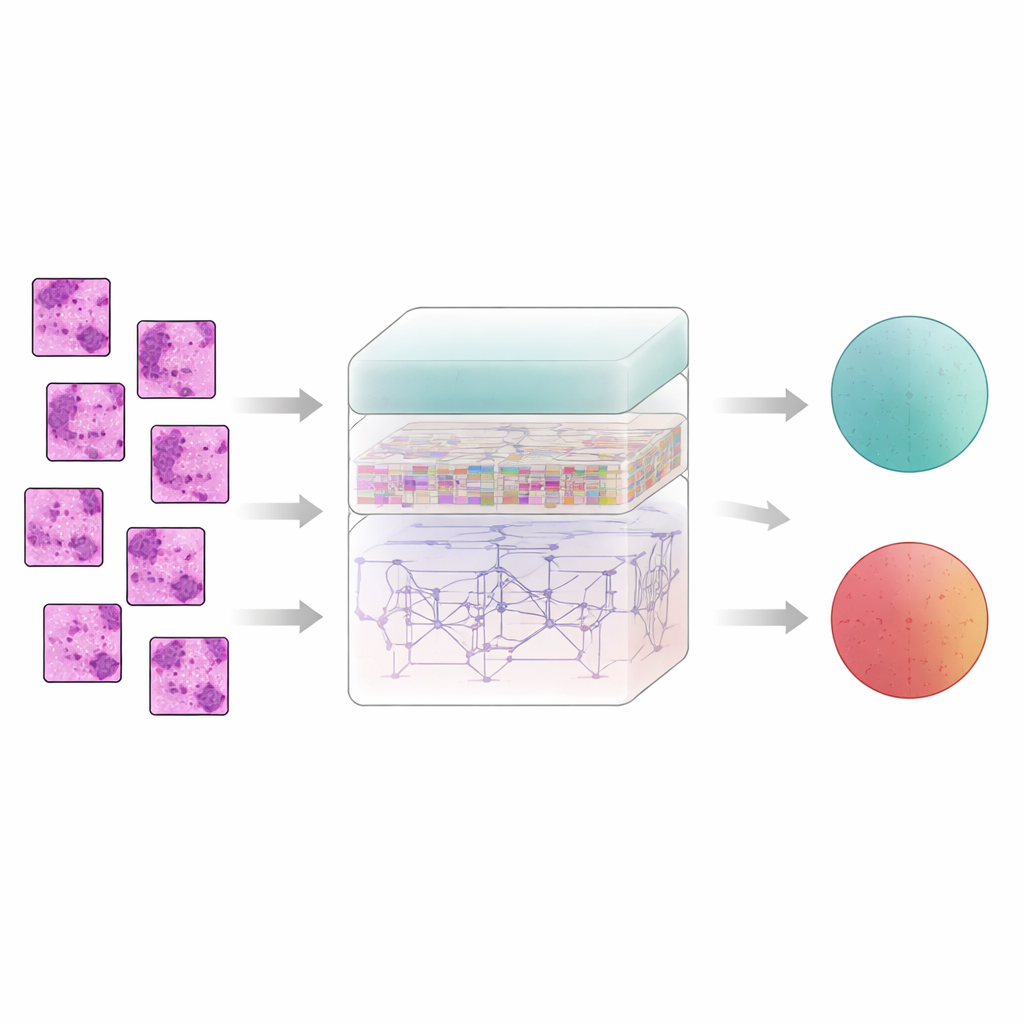

Voir la lame entière, pas seulement de petits morceaux

Si les motifs locaux sont importants, le cancer se manifeste souvent par une organisation à plus grande échelle : la dispersion des zones anormales, leur étendue et leurs interactions avec le tissu environnant. Pour appréhender ce tableau plus large, les auteurs ajoutent un module transformer, une technologie développée à l'origine pour les modèles de langage. Ici, chaque patch devient un token, et le transformer apprend comment chaque patch se relie à tous les autres. Une forme d'encodage de position absolue indique au modèle la position exacte de chaque patch sur la lame originale, préservant la disposition spatiale. Par-dessus cela, une couche de décision densément connectée réutilise des caractéristiques provenant de plusieurs profondeurs du réseau, aidant le système à conserver à la fois les détails fins et le contexte global au moment de décider si un échantillon est bénin ou malin.

Évaluer le système

Les chercheurs ont entraîné et évalué leur cadre « ImTranNet‑TriCore » sur une vaste collection publique d'images histopathologiques mammaires, qui comprend plus d'un quart de million de petits patches issus de patientes réelles, numérisés à plusieurs niveaux de grossissement. Le jeu de données est difficile : l'apparence des tissus varie fortement d'une lame à l'autre, et les régions malignes peuvent être subtiles ou n'occuper qu'une petite partie d'une image. Malgré cela, le nouveau système a obtenu environ 98 % de précision pour distinguer les patches cancéreux des non‑cancéreux et a maintenu des performances solides sur tous les niveaux de zoom. Il a régulièrement surpassé une gamme de méthodes largement utilisées, y compris les réseaux convolutionnels conventionnels, des modèles améliorés par attention et des architectures hybrides mêlant apprentissage profond et apprentissage automatique traditionnel.

Des chiffres à la confiance en clinique

Une haute précision ne suffit pas en médecine ; les médecins ont besoin de comprendre pourquoi un système prend ses décisions. Les auteurs ont donc examiné quelles régions d'image influençaient le plus les choix du modèle à l'aide de cartes de chaleur et d'outils d'importance des caractéristiques. Ils ont constaté que le système a tendance à mettre en évidence les mêmes structures que regardent les pathologistes : la forme et les limites des noyaux cellulaires, l'organisation des glandes et les amas denses de tissu anormal. En parallèle, le modèle garde un faible taux de fausses alertes et affiche des scores de confiance bien calibrés, ce qui est important pour éviter à la fois les cancers manqués et les biopsies inutiles. Si la méthode rencontre encore des difficultés sur certaines différences très fines à des grossissements extrêmes, l'étude suggère que combiner un nettoyage d'image soigné, le suivi des motifs locaux et le contexte de la lame entière peut rapprocher l'évaluation automatisée du cancer du sein de la fiabilité requise par les cliniciens.

Citation: Saravana Kumar, N.M., Kandala, M.K., Kaveri, P.R. et al. A multi-scale adaptive filtering and AtRes_SRU–transformer synergy for breast cancer histopathology classification. Sci Rep 16, 14387 (2026). https://doi.org/10.1038/s41598-026-41153-7

Mots-clés: histopathologie du cancer du sein, analyse d'images médicales, apprentissage profond, modèles transformer, diagnostic assisté par ordinateur