Clear Sky Science · es

Filtrado adaptativo multiescala y sinergia AtRes_SRU–transformer para la clasificación histopatológica del cáncer de mama

Por qué esto importa para pacientes y médicos

Detectar el cáncer de mama de forma temprana puede marcar la diferencia entre un tratamiento sencillo y una enfermedad potencialmente mortal, pero examinar tejido al microscopio es un trabajo lento y subjetivo. Este artículo presenta un nuevo sistema informático que ayuda a los patólogos a clasificar las imágenes de tejido mamario en casos inocuos o peligrosos de manera más precisa y eficiente. Mediante una limpieza cuidadosa de las imágenes y la combinación de varios tipos de inteligencia artificial, el sistema pretende favorecer diagnósticos más tempranos, reducir cánceres no detectados y disminuir alarmas innecesarias.

Limpiar la imagen antes de tomar una decisión

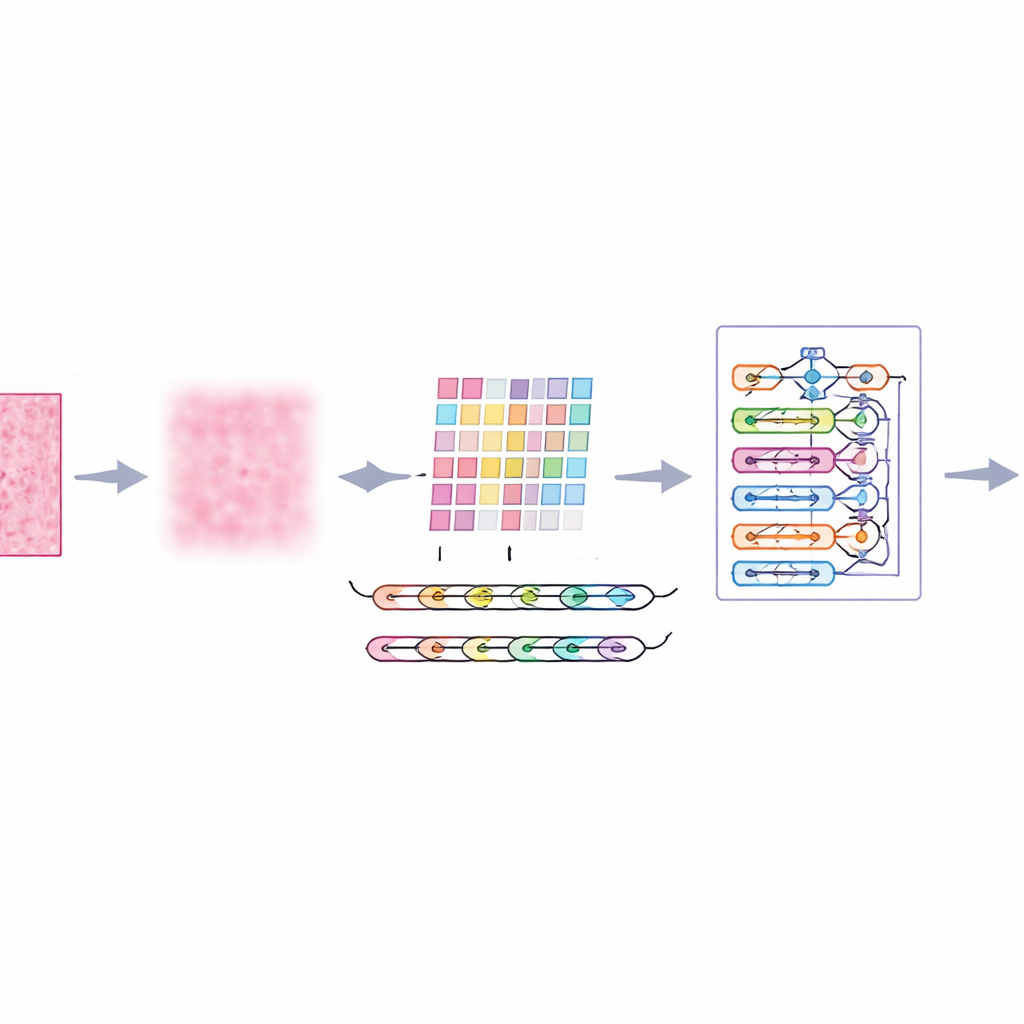

Las imágenes microscópicas del tejido mamario están lejos de ser perfectas. Contienen salpicaduras aleatorias, iluminación desigual y variaciones de color por el tinción, todo lo cual puede confundir incluso a algoritmos avanzados. Los autores introducen un paso previo llamado filtrado adaptativo multiescala, que actúa como un filtro de ruido inteligente y suave. En vez de difuminarlo todo por igual, analiza la imagen en varios niveles de detalle y se adapta al contraste y la textura locales. El resultado es que se reducen el ruido molesto y los artefactos de tinción, mientras se preservan bordes importantes —como las fronteras entre agrupaciones celulares—. Esto proporciona a las etapas posteriores del sistema una visión más clara y fiable de cada parche de tejido.

Enseñar al ordenador a seguir los patrones del tejido

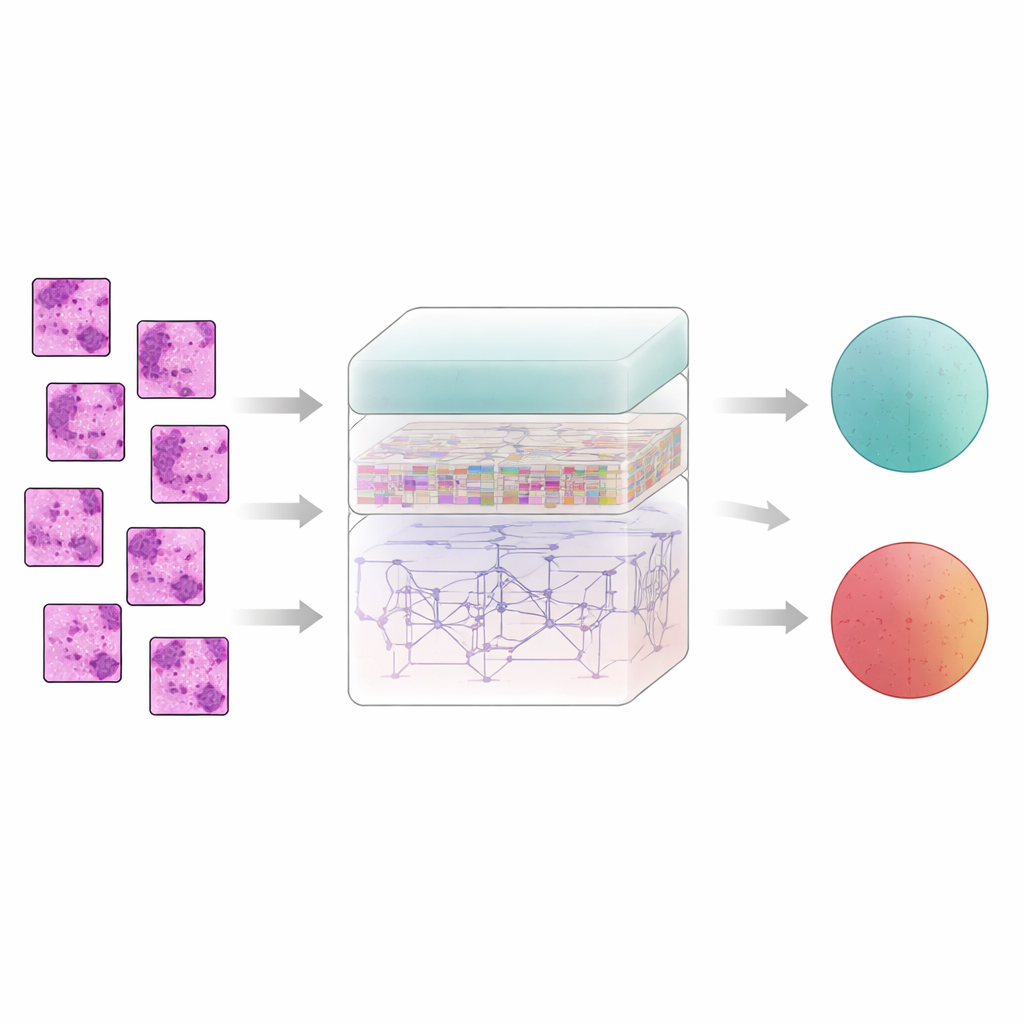

El tejido mamario no cuenta su historia pixel a pixel; el significado surge de cómo se relacionan las regiones vecinas. Para captar esto, el sistema divide cada imagen filtrada en pequeños parches y los introduce en un extractor de características llamado AtRes_SRU. Esta parte combina una red residual profunda, que es buena detectando formas y texturas, con una unidad recurrente ligera que trata los parches adyacentes como pasos en una secuencia. Aunque nada se mueve en el tiempo, ordenar los parches permite al modelo aprender cómo fluyen las estructuras a lo largo del portaobjetos —dónde comienzan y terminan los cúmulos celulares, cómo se curvan o rompen las glándulas y cómo las regiones anómalas se sitúan dentro de tejido más regular. Un mecanismo de atención orienta además al sistema a centrarse en las zonas más sospechosas, como núcleos irregulares o conglomerados celulares inusualmente densos.

Ver el portaobjetos completo, no solo piezas diminutas

Si bien los patrones locales importan, el cáncer a menudo se revela por la organización a mayor escala: cómo están dispersas las zonas anormales, hasta qué punto se extienden y cómo interactúan con el tejido circundante. Para captar esta visión más amplia, los autores añaden un módulo transformer, una tecnología desarrollada originalmente para modelos de lenguaje. Aquí, cada parche se convierte en un token y el transformer aprende cómo se relaciona cada parche con todos los demás. Una forma de codificación de posición absoluta informa al modelo exactamente de dónde procede cada parche en el portaobjetos original, preservando la disposición espacial. Sobre esto, una capa de decisión densamente conectada reutiliza características de distintas profundidades de la red, ayudando al sistema a conservar tanto los detalles finos como el contexto global cuando finalmente decide si una muestra es benigna o maligna.

Poner el sistema a prueba

Los investigadores entrenaron y evaluaron su marco "ImTranNet‑TriCore" en una gran colección pública de imágenes histopatológicas mamarias, que incluye más de un cuarto de millón de pequeños parches procedentes de pacientes reales, escaneados a varios niveles de aumento. El conjunto de datos es exigente: la apariencia del tejido varía ampliamente entre portaobjetos y las zonas malignas pueden ser sutiles o ocupar solo una pequeña parte de la imagen. A pesar de ello, el nuevo sistema alcanzó aproximadamente un 98 % de precisión al distinguir parches cancerosos de no cancerosos y mantuvo un rendimiento sólido en todos los niveles de zoom. Superó de forma consistente a una variedad de métodos ampliamente usados, incluidas redes convolucionales convencionales, modelos con atención mejorada y diseños híbridos que mezclan aprendizaje profundo con aprendizaje automático tradicional.

De los números a la confianza en clínicas reales

La alta precisión por sí sola no es suficiente en medicina; los médicos necesitan entender por qué un sistema llega a sus decisiones. Por ello, los autores examinaron qué regiones de la imagen influenciaron más las elecciones del modelo usando mapas de calor y herramientas de importancia de características. Encontraron que el sistema tiende a resaltar las mismas estructuras que observan los patólogos: las formas y los límites de los núcleos celulares, la organización de las glándulas y los cúmulos densos de tejido anómalo. Al mismo tiempo, el modelo mantiene bajas las falsas alarmas y muestra puntuaciones de confianza calibradas de forma suave, lo cual es importante para evitar tanto cánceres no detectados como biopsias innecesarias. Aunque el método aún tiene dificultades con algunas diferencias muy sutiles a aumentos extremos, el estudio sugiere que combinar una limpieza cuidadosa de la imagen, seguimiento de patrones locales y contexto de todo el portaobjetos puede acercar mucho la evaluación automatizada del cáncer de mama a la fiabilidad que necesitan los clínicos.

Cita: Saravana Kumar, N.M., Kandala, M.K., Kaveri, P.R. et al. A multi-scale adaptive filtering and AtRes_SRU–transformer synergy for breast cancer histopathology classification. Sci Rep 16, 14387 (2026). https://doi.org/10.1038/s41598-026-41153-7

Palabras clave: histopatología del cáncer de mama, análisis de imágenes médicas, aprendizaje profundo, modelos transformer, diagnóstico asistido por ordenador