Clear Sky Science · de

Ein multiskaliges adaptives Filter und AtRes_SRU–Transformer‑Synergie zur Klassifikation der histopathologischen Brustkrebsdiagnostik

Warum das für Patientinnen und Ärztinnen wichtig ist

Brustkrebs früh zu erkennen kann den Unterschied zwischen einer einfachen Behandlung und einer lebensbedrohlichen Erkrankung ausmachen, doch die mikroskopische Begutachtung von Gewebe ist zeitaufwendig und subjektiv. Dieser Artikel stellt ein neues Computersystem vor, das Pathologen dabei unterstützt, Brustgewebeaufnahmen genauer und effizienter in ungefährliche und gefährliche Fälle zu sortieren. Durch sorgfältige Bildbereinigung und die Kombination mehrerer Arten künstlicher Intelligenz soll das System frühere Diagnosen ermöglichen, weniger übersehene Krebserkrankungen und weniger unnötige Alarme bewirken.

Das Bild sauber machen, bevor ein Urteil fällt

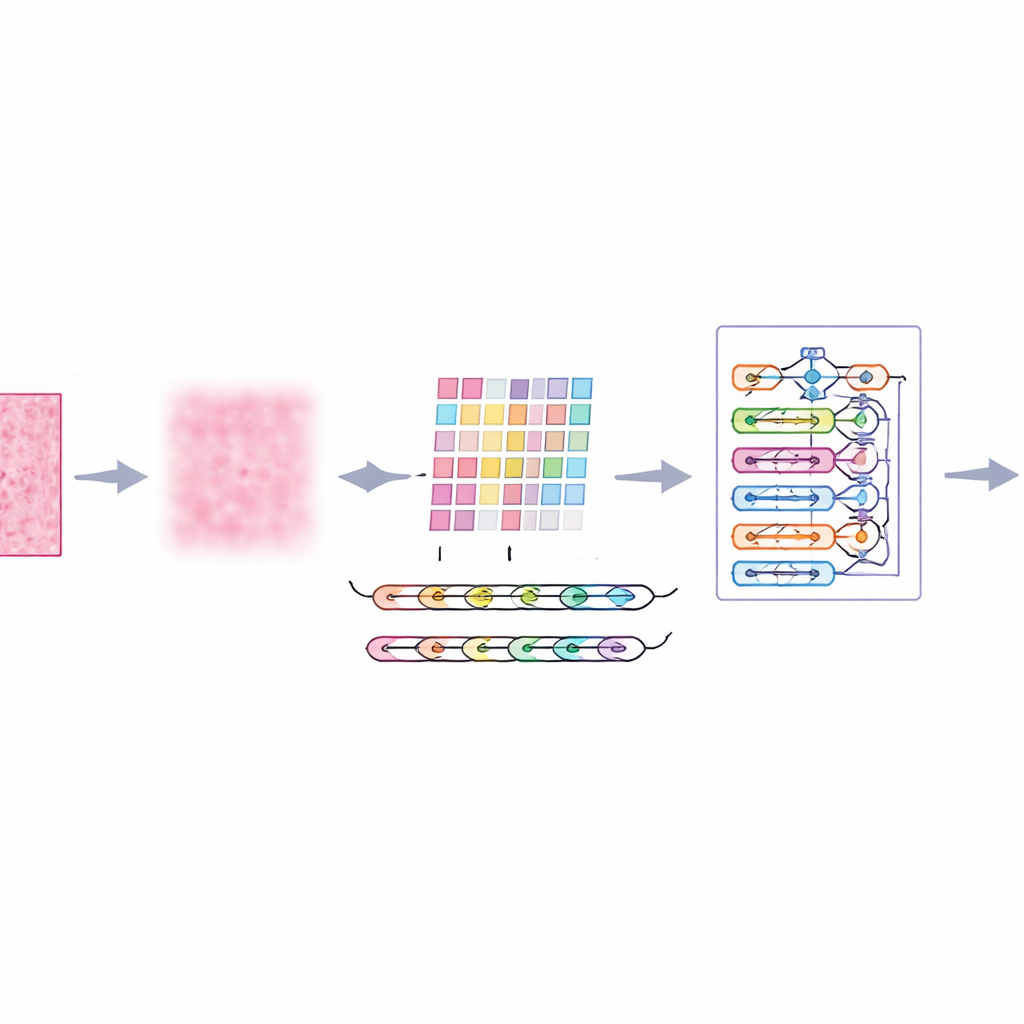

Mikroskopaufnahmen von Brustgewebe sind alles andere als perfekt. Sie enthalten zufällige Körnigkeit, ungleichmäßige Beleuchtung und Farbvariationen durch Färbungen, die selbst fortgeschrittene Algorithmen verwirren können. Die Autoren führen einen Vorverarbeitungsschritt namens multiskaliges adaptives Filtern ein, der wie ein intelligenter, schonender Rauschfilter wirkt. Anstatt alles gleichermaßen zu verwischen, betrachtet er das Bild auf mehreren Detailebenen und passt sich lokal an Kontrast und Textur an. Dadurch werden störendes Rauschen und Färbungsartefakte reduziert, während wichtige Kanten — etwa die Grenzen zwischen Zellgruppen — erhalten bleiben. Das gibt den nachfolgenden Systemstufen eine klarere, verlässlichere Sicht auf jedes Gewebefeld.

Dem Computer das Folgen von Gewebemustern beibringen

Brustgewebe erzählt seine Geschichte nicht Pixel für Pixel; die Bedeutung ergibt sich daraus, wie benachbarte Bereiche zueinanderstehen. Um dies zu erfassen, unterteilt das System jedes gefilterte Bild in kleine Patches und führt sie einem Merkmalsextraktor namens AtRes_SRU zu. Dieser Teil kombiniert ein tiefes Residualnetz, das gut darin ist, Formen und Texturen zu erkennen, mit einer leichten rekurrenten Einheit, die benachbarte Patches wie Schritte in einer Sequenz behandelt. Obwohl sich zeitlich nichts bewegt, erlaubt die Anordnung der Patches das Erlernen des Flusses von Strukturen über den Objektträger — wo Zellansammlungen beginnen und enden, wie Drüsen sich biegen oder unterbrechen und wie abnorme Bereiche in regulärem Gewebe liegen. Ein Aufmerksamkeitsmechanismus lenkt das System zusätzlich auf die verdächtigsten Regionen, etwa unregelmäßige Zellkerne oder ungewöhnlich dichte Zellansammlungen.

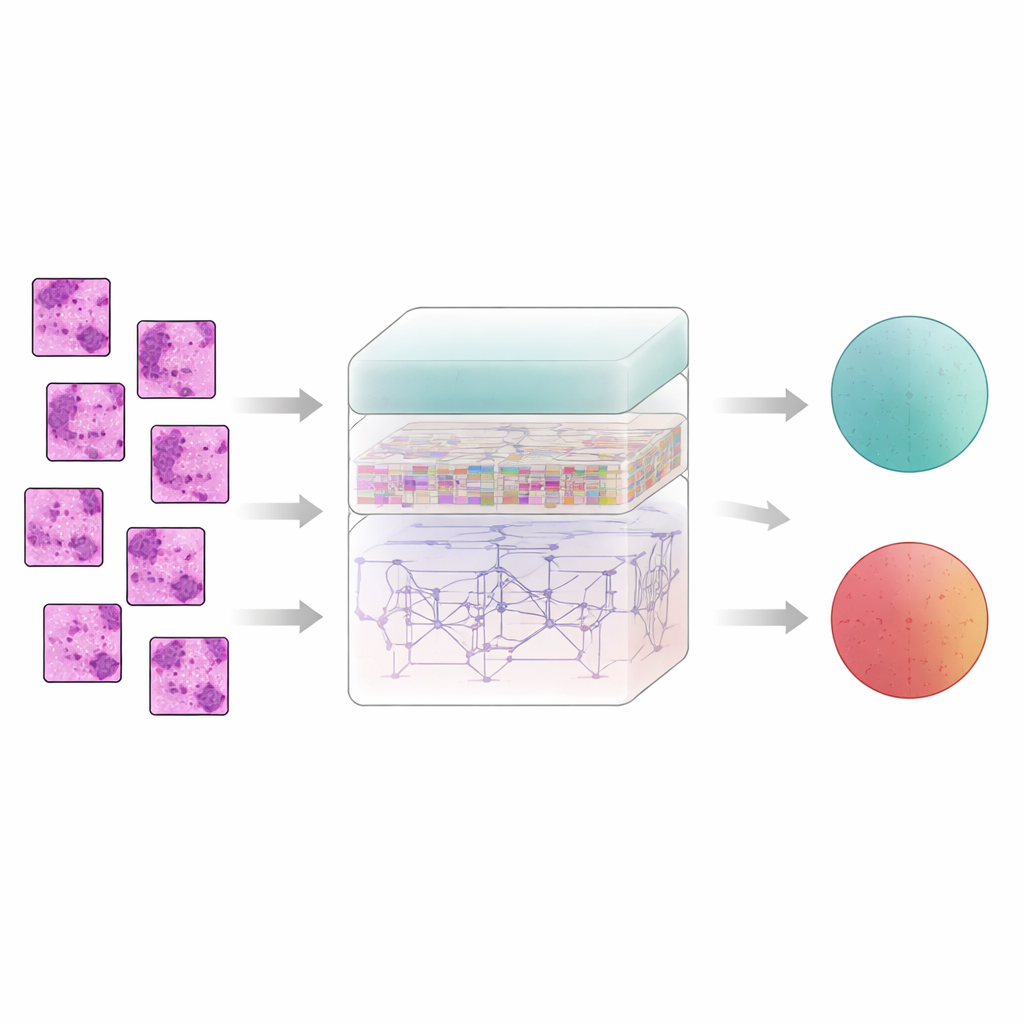

Das ganze Objektträgerbild sehen, nicht nur winzige Teile

Während lokale Muster wichtig sind, offenbart sich Krebs oft durch großräumige Organisation: wie verstreut abnorme Zonen sind, wie weit sie sich ausdehnen und wie sie mit umliegendem Gewebe interagieren. Um dieses breitere Bild zu erfassen, fügen die Autoren ein Transformer‑Modul hinzu, eine Technologie, die ursprünglich für Sprachmodelle entwickelt wurde. Hier wird jeder Patch zu einem Token, und der Transformer lernt, wie jeder Patch zu jedem anderen in Beziehung steht. Eine Form der absoluten Positionskodierung teilt dem Modell genau mit, woher jeder Patch auf dem ursprünglichen Objektträger stammt und bewahrt so das räumliche Layout. Darauf aufbauend nutzt eine dicht verbundene Entscheidungsschicht Merkmale aus vielen Netzwerktiefen wieder, sodass das System sowohl feine Details als auch den globalen Kontext berücksichtigt, wenn es schließlich darüber entscheidet, ob eine Probe gutartig oder bösartig ist.

Das System auf die Probe stellen

Die Forschenden trainierten und evaluierten ihr "ImTranNet‑TriCore"‑Framework an einer großen öffentlichen Sammlung histopathologischer Brustbilder, die mehr als ein Viertel Million kleiner Patches von realen Patientinnen enthält, bei mehreren Vergrößerungsstufen eingescannt. Der Datensatz ist herausfordernd: Das Erscheinungsbild des Gewebes variiert stark zwischen den Objektträgern, und maligne Bereiche können subtil sein oder nur einen kleinen Teil eines Bildes einnehmen. Dennoch erreichte das neue System eine Genauigkeit von etwa 98 % bei der Unterscheidung von krebsverdächtigen und nicht‑krebsverdächtigen Patches und zeigte über alle Vergrößerungsstufen hinweg starke Leistung. Es übertraf durchweg eine Reihe weit verbreiteter Methoden, darunter konventionelle Faltungsnetzwerke, aufmerksamkeitsverstärkte Modelle und hybride Ansätze, die Deep Learning mit traditionellen Machine‑Learning‑Methoden mischen.

Von Zahlen zu Vertrauen in der realen Klinik

Hohe Genauigkeit allein reicht in der Medizin nicht; Ärztinnen und Ärzte müssen verstehen, warum ein System zu seinen Entscheidungen kommt. Die Autoren untersuchten deshalb, welche Bildregionen die Modellentscheidungen am meisten beeinflussen, mithilfe von Heatmaps und Werkzeugen zur Merkmalswichtigkeit. Sie fanden heraus, dass das System tendenziell dieselben Strukturen hervorhebt, auf die Pathologen achten: Formen und Grenzen der Zellkerne, die Organisation der Drüsen und dichte Cluster abnormen Gewebes. Gleichzeitig hält das Modell die Anzahl falscher Alarme gering und zeigt glatt kalibrierte Vertrauenswerte, was wichtig ist, um sowohl übersehene Krebserkrankungen als auch unnötige Biopsien zu vermeiden. Zwar hat die Methode noch Schwierigkeiten bei einigen sehr feinkörnigen Unterschieden bei extremen Vergrößerungen, doch die Studie legt nahe, dass die Kombination aus sorgfältiger Bildbereinigung, Verfolgung lokaler Muster und Kontext auf Objektträgerebene die automatisierte Beurteilung von Brustkrebs der Zuverlässigkeit, die Kliniker benötigen, deutlich näherbringen kann.

Zitation: Saravana Kumar, N.M., Kandala, M.K., Kaveri, P.R. et al. A multi-scale adaptive filtering and AtRes_SRU–transformer synergy for breast cancer histopathology classification. Sci Rep 16, 14387 (2026). https://doi.org/10.1038/s41598-026-41153-7

Schlüsselwörter: Histopathologie von Brustkrebs, Analyse medizinischer Bilder, Deep Learning, Transformer‑Modelle, Computerunterstützte Diagnose