Clear Sky Science · de

Verbesserte Erkennung von Cyberbedrohungen durch neuartige tri-metaheuristische Verlustfunktionen in generativen gegnerischen Netzen mit adaptiver Erhaltung von Aufmerksamkeit für die Netzwerkverkehrsaugmentation

Warum klügere Cyberverteidigung wichtig ist

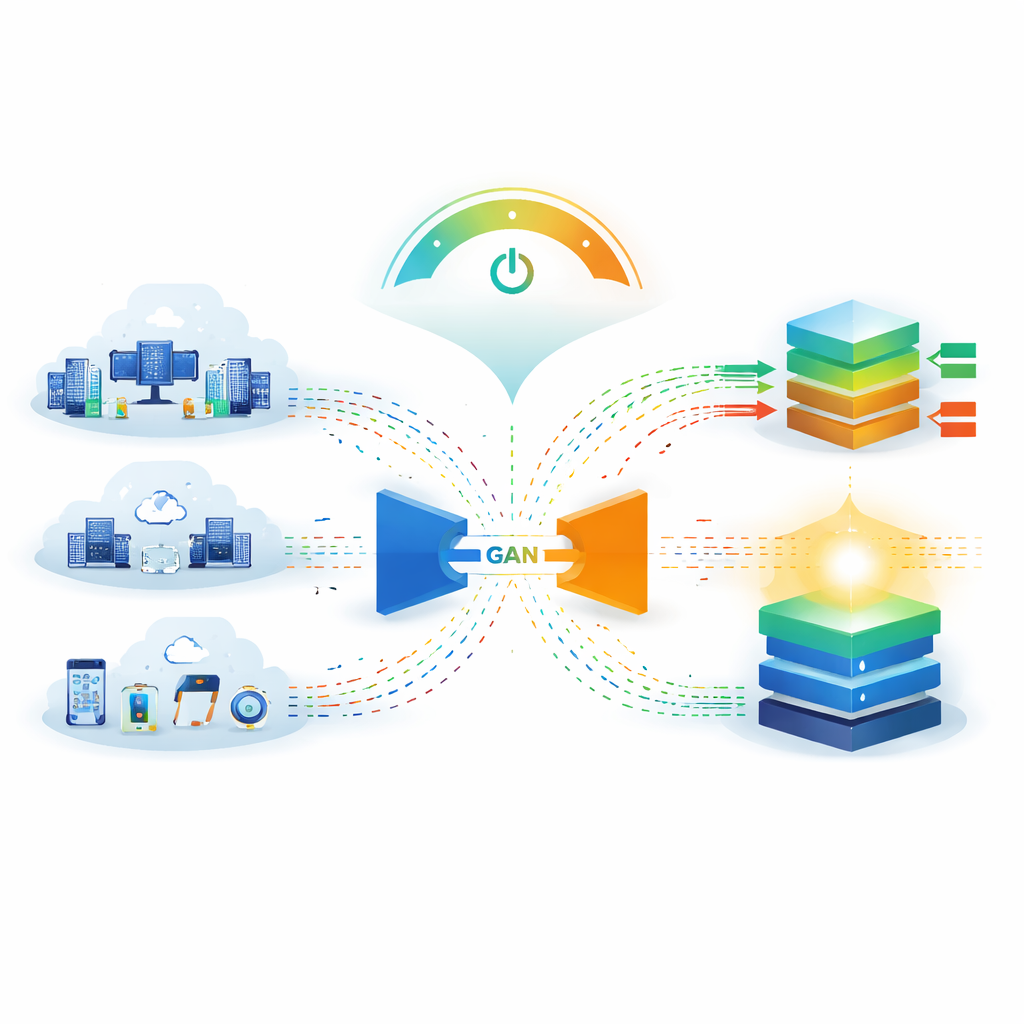

Jedes Mal, wenn Sie im Web surfen, online einkaufen oder ein Gerät zu Hause verbinden, finden im Hintergrund stille Kämpfe statt, während Sicherheitssysteme versuchen, bösartigen Verkehr unter Milliarden harmloser Verbindungen zu erkennen. Angreifer erfinden ständig neue Tricks, während Verteidiger mit wenigen Beispielen realer Angriffe und steigenden Energiekosten durch immer größere KI‑Modelle kämpfen. Diese Arbeit untersucht einen Weg, digitale Abwehr zu stärken und gleichzeitig den Strombedarf fürs Training zu senken, indem ein spezialisiertes generatives Modell darauf trainiert wird, realistische, vielfältige „Übungsangriffe“ für Intrusion‑Detection‑Systeme zu erzeugen – ohne ganz neue Algorithmen zu erfinden, sondern durch die Kombination und Anpassung bewährter Ideen in sorgfältiger Ausführung.

Realistischere Übungsdaten erzeugen

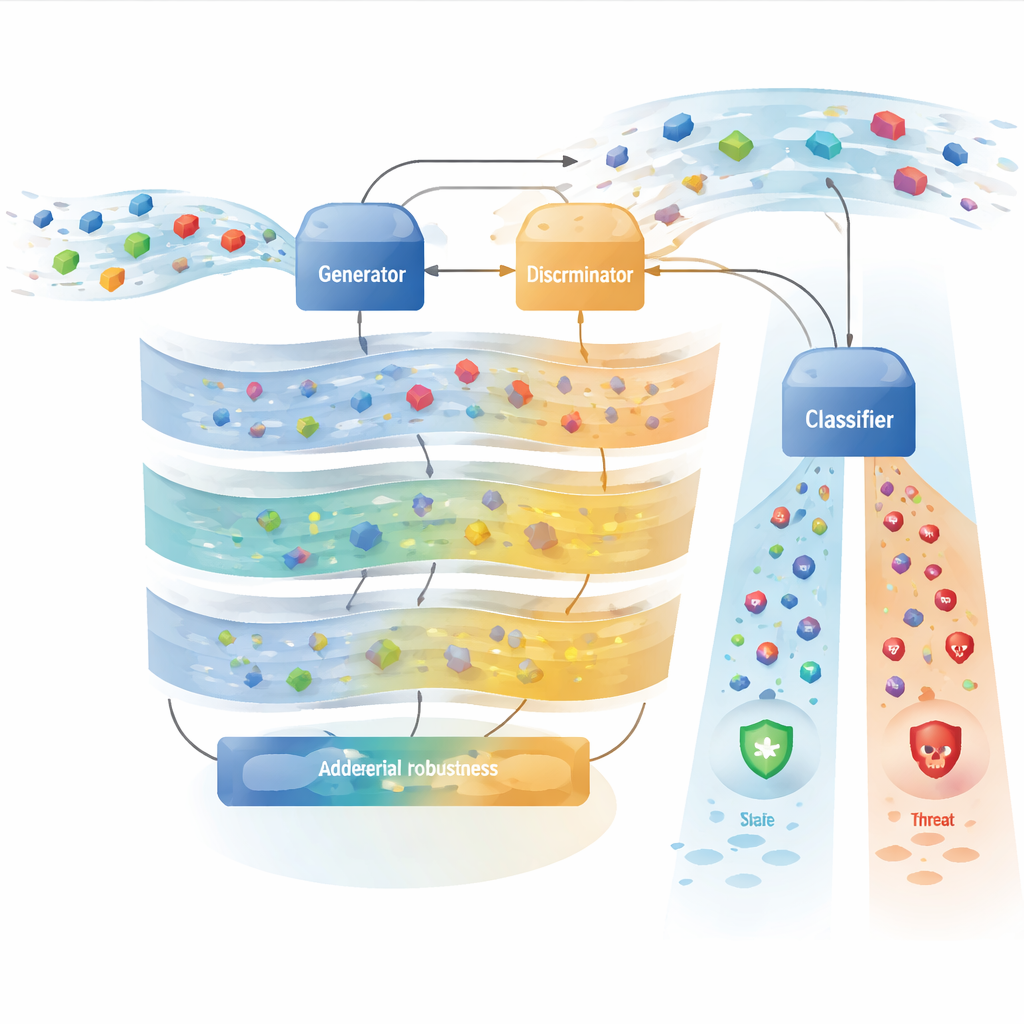

Moderne Cyberverteidigung stützt sich oft auf Deep‑Learning‑Systeme, die Netzwerkverkehr nach Einbruchszeichen scannen. Diese Systeme arbeiten am besten, wenn sie mit vielen Beispielen sowohl normalen Verhaltens als auch Angriffen trainiert werden. In der Praxis überwiegt normaler Verkehr deutlich gegenüber gefährlichem Verkehr, und manche Angriffstypen sind extrem selten, weshalb Modelle dazu neigen, diese zu vernachlässigen. Die Autoren verwenden eine Art generatives Modell, ein Generative Adversarial Network (GAN), um synthetischen Angriffsverkehr zu produzieren, der echten Angriffen in Aussehen und Verhalten ähnelt. Anstatt sich auf eine einzige Loss‑Regel beim Lernen zu verlassen, entwerfen sie ein dreiteiliges Verlust‑Framework, das den Generator dazu anregt, Merkmale zu bewahren, die wirklich wichtig sind, die Gesamtstatistik des Verkehrs realistisch zu halten und eine große Vielfalt an Angriffsmustern zu wahren. Das Ergebnis ist ein reichhaltigerer, ausgewogenerer Trainingssatz für nachgelagerte Intrusion‑Detection‑Systeme.

Ideen aus der Natur, mathematisch umgesetzt

Das Framework ist von drei Familien so genannter metaheuristischer Optimierungsmethoden inspiriert, die nach Glühwürmchen, Quallen und Fangschreckenkrebsen benannt sind. Klassische Versionen dieser Algorithmen sind populationsbasiert und nicht differenzierbar, was sie für modernes Deep Learning ungeeignet macht. Die Autoren führen diese Algorithmen hier nicht direkt aus. Stattdessen übersetzen sie die zugrundeliegenden Designideen in glatte, differenzierbare Verlustkomponenten, die mit standardmäßiger Backpropagation optimiert werden können. Eine Gruppe von Komponenten, beeinflusst vom Verhalten der „Glühwürmchen“, fördert, dass der synthetische Verkehr mit wichtigen Angriffsmerkmalen übereinstimmt und die statistische Verteilung realer Daten annimmt. Eine andere, von „Quallen“ inspirierte Gruppe bringt interne Repräsentationen ähnlicher Angriffe dazu, zusammenzuklumpen, und trennt verschiedene Angriffe voneinander, während die Schwierigkeit der Aufgabe im Training schrittweise steigt. Eine dritte Gruppe, konzeptionell mit der Präzision des „Fangschreckenkrebses“ verbunden, fokussiert auf Robustheit – sie stellt sicher, dass erzeugte Angriffe auch dann erkennbar bleiben, wenn kleine, adversariale Veränderungen angewandt werden.

Energie sparen durch fokussierte Aufmerksamkeit

Über die Genauigkeit hinaus adressieren die Autoren ein zunehmend drängendes Problem: die Energie, die zum Trainieren großer Sicherheitsmodelle benötigt wird. Rechenzentren verbrauchen bereits 1–2 % des weltweiten Stroms, und Sicherheitsüberwachung läuft rund um die Uhr. Um diese Kosten zu senken, integriert das Framework einen energie‑bewussten Aufmerksamkeitsmechanismus. Anstatt in jedem Netzwerkfluss dieselbe Rechenleistung zu investieren, schätzt ein leichtgewichtiges Bewertungsmodul, wie verdächtig jede Probe ist. Stark verdächtige Flüsse erhalten volle, hochauflösende Aufmerksamkeit und arithmetische Genauigkeit; mäßig verdächtige Flüsse mittelgroße Aufmerksamkeit; klar harmlose Verbindungen werden mit weniger Attention‑Heads, kürzeren Sequenzen und geringerer numerischer Genauigkeit verarbeitet. Zusätzliche Techniken vernichten (sparsifizieren) Aufmerksamkeitsgewichte und verkürzen das Kontextfenster für benignen Verkehr. Diese Designentscheidungen reduzieren den Trainingsenergiebedarf in den Experimenten der Autoren um etwa 40 %, während die Erkennungsleistung bei Angriffsverkehr erhalten bleibt.

Das System auf die Probe gestellt

Das Team bewertet seinen Ansatz auf sieben weit verbreiteten Intrusion‑Detection‑Datensätzen, die Unternehmensnetzwerke, Cloud‑Testbeds und Internet‑of‑Things‑Umgebungen abdecken und alles von Denial‑of‑Service‑Fluten bis zu heimlichen Infiltrationsversuchen umfassen. Sie trainieren mehrere Deep‑Learning‑Klassifikatoren auf drei Datenarten: den ursprünglichen unausgewogenen Daten, durch Standardmethoden wie SMOTE augmentierten Daten und mit ihrem GAN‑basierten Verfahren angereicherten Daten. Mit dem neuen Framework erreicht ein transformerbasiertes Intrusion‑Detektionsmodell etwa 98,7 % Genauigkeit und einen F1‑Score von 0,987 auf dem NSL‑KDD‑Benchmark und übertrifft frühere GAN‑Varianten sowie energiefokussierte Baselines. Sorgfältige Ablationsstudien zeigen, dass etwa die Hälfte der Verbesserung von grundlegender Klassen‑Ausbalancierung und traditioneller Augmentation stammt, während die andere Hälfte auf die spezifische Kombination aus Verlustkomponenten und Aufmerksamkeitsmechanismen zurückzuführen ist. Das System zeigt zudem verbesserte Widerstandsfähigkeit gegenüber gängigen adversarialen Angriffsmethoden und lässt sich ohne vollständiges Retraining relativ gut zwischen Datensätzen übertragen.

Wo es wirkt und wo es noch kämpft

Trotz dieser Fortschritte ist die Methode kein Allheilmittel. Die Autoren machen deutlich, dass manche Angriffstypen weiterhin sehr schwer zu erkennen sind – insbesondere langsame, heimliche Infiltrationsangriffe, bei denen die Recall‑Rate selbst mit Augmentation unter 30 % fallen kann. Außerdem stützen sich reale Einsatztests in fünf Organisationen auf verifizierte Ground‑Truth‑Daten für nur etwa 1,8 % des gesammelten Verkehrs, sodass betriebliche Genauigkeitsschätzungen weiterhin unsicher sind. Das Framework hängt außerdem von vergleichsweise leistungsfähiger Hardware wie NVIDIA A100‑GPUs ab, die kleineren Organisationen möglicherweise nicht zur Verfügung stehen. Diese Vorbehalte unterstreichen, dass die Ergebnisse vielversprechend, aber durch die untersuchten Datensätze, Hardware und Verifikationsverfahren begrenzt sind.

Was das für alltägliche Sicherheit bedeutet

Einfach gesagt legt diese Arbeit nahe, dass die sorgfältige Integration mehrerer bekannter Deep‑Learning‑Tricks – statt völlig neuer Erfindungen – ein Cybersicherheitsnetz hervorbringen kann, das mehr Angriffe erkennt und zugleich weniger Energie für das Training verbraucht. Indem realistische synthetische Angriffe erzeugt werden, die kritische Muster bewahren, der Lernprozess mit mehreren komplementären Verlustkomponenten gesteuert wird und Rechenleistung dynamisch dort fokussiert wird, wo Bedrohungen am wahrscheinlichsten sind, bietet das vorgeschlagene Framework einen daten‑effizienteren und umweltbewussteren Weg zum Training von Intrusion‑Detektoren. Es verbessert die Erkennung in Benchmark‑Datensätzen und zeigt ermutigende Robustheit gegenüber Evasionsmanövern von Angreifern, während es offen Schwachstellen bei seltenen, stark verschleierten Angriffen benennt. Für Nutzer und Organisationen rücken Ansätze wie dieser näher an Sicherheitswerkzeuge, die nicht nur intelligenter und robuster, sondern auch grüner sind.

Zitation: Khalil, H.M., Elrefaiy, A., Elbaz, M. et al. Enhanced cybersecurity threat detection using novel tri-metaheuristic loss functions in generative adversarial networks with adaptive attention preservation for network traffic augmentation. Sci Rep 16, 12074 (2026). https://doi.org/10.1038/s41598-026-46375-3

Schlüsselwörter: Intrusion Detection, generative gegnerische Netze, Netzwerkverkehrsaugmentation, Adversarial Robustheit, energieeffiziente KI