Clear Sky Science · de

Adaptives, leichtgewichtiges Mask R-CNN-Modell für die Instanzsegmentierung und Klassifizierung von Unterwasserabfällen zur nachhaltigen Meeresmüll-Bewirtschaftung

Warum das Aufräumen von Müll unter Wasser wichtig ist

Tief unter der Wasseroberfläche sammeln sich Plastikflaschen, Tüten, Fischernetze und anderer Abfall am Meeresboden und treiben in Küstengewässern. Dieser verborgene Müll schadet der Meeresfauna und erschwert die Überwachung des Zustands der Ozeane. Taucher, Unterwasserroboter und Fernkameras können helfen, doch dafür müssen sie Abfall in trübem, eingefärbtem Wasser zunächst klar erkennen können. Diese Studie stellt ein neues Computer-Vision-System vor, das Unterwasserrobotern erlaubt, Müll in Echtzeit zu entdecken, zu umreißen und zu klassifizieren — selbst bei schlechter Sicht — und bietet damit ein leistungsfähiges Werkzeug für künftige Meeresreinigungsmaßnahmen.

Probleme beim klaren Sehen unter Wasser

Unterwasserszenen sind deutlich schwerer zu interpretieren als Fotos an der Luft. Wenn Licht durch Wasser reist, verschwinden zuerst Rottöne, dann weitere Farben, sodass Bilder von blau-grünen Farbtönen dominiert werden. Schwebstoffe streuen das Licht, verringern den Kontrast und legen einen dunstigen Schleier über die Szenerie. Für eine Kamera oder einen Roboter, der versucht, eine blasse Plastiktüte vor einem hellen, sich verändernden Meeresboden zu finden, ist das eine erhebliche Herausforderung. Traditionelle Bildkorrekturen wie einfache Kontrastanpassungen helfen nur begrenzt und versagen oft, wenn sich Tiefe, Trübung oder Beleuchtung ändern. Viele bestehende Deep-Learning-Detektoren haben entweder Schwierigkeiten, Abfälle genau zu umreißen, oder sind zu rechenintensiv, um auf den kleinen Rechnern zu laufen, die gewöhnlich in autonomen Unterwasserfahrzeugen eingesetzt werden.

Ein schnellerer, leichterer Weg, Unterwassermüll zu erkennen

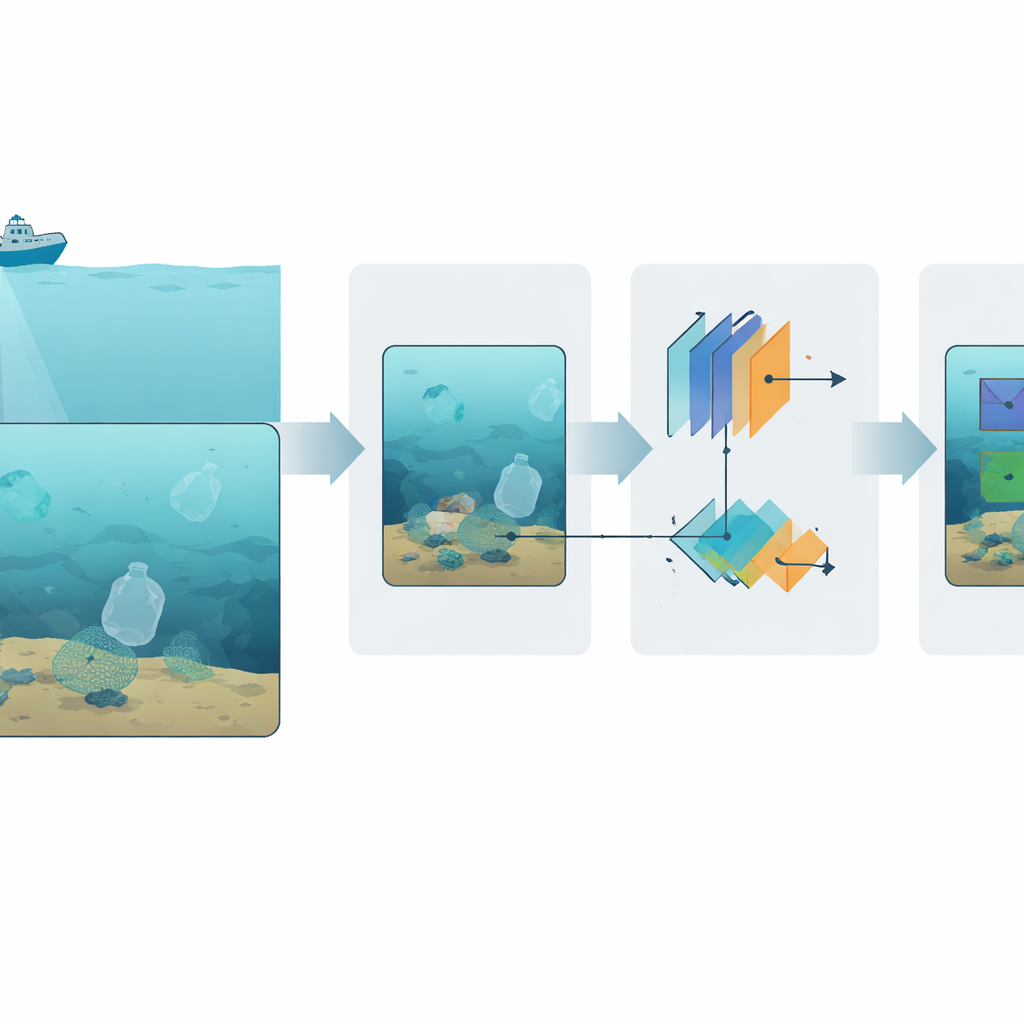

Die Autorinnen und Autoren schlagen ein „adaptives, leichtgewichtiges Mask R-CNN“-System vor, das speziell für diese harte Umgebung ausgelegt ist. Auf hoher Ebene folgt das System einer einfachen Kette: Zuerst wird das rohe Unterwasserbild bereinigt, dann werden zentrale visuelle Merkmale extrahiert, anschließend werden wahrscheinliche Müllregionen vorgeschlagen und schließlich werden präzise Silhouetten um jedes Stück Müll gezeichnet und es wird einer Kategorie wie Flasche, Tüte oder Netz zugewiesen. Um das System für die Echtzeitanwendung schnell genug zu halten, setzt es auf MobileNetV3 — ein kompaktes, aber leistungsfähiges neuronales Netzwerk — als hauptsächlichen Merkmalsextraktor. Dieses Backbone wird mit einem verbesserten Region-Proposal-Modul kombiniert, das darauf abgestimmt ist, kleine, unregelmäßige und teilweise verdeckte Abfälle zu finden, wie sie häufig auf überfüllten Meeresböden vorkommen.

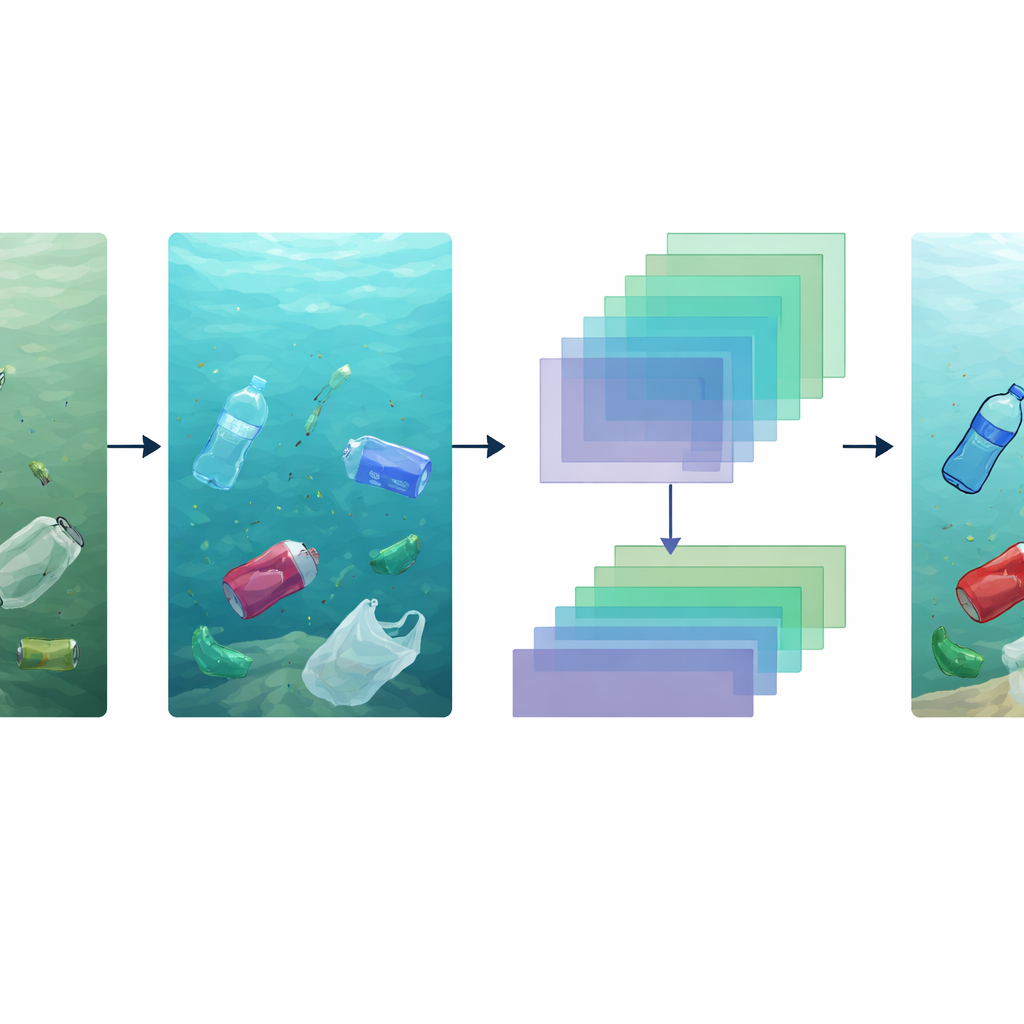

Trübe Bilder natürlicher aussehen lassen

Ein zentrales Element ist ein spezielles Enhancements-Modul, das vor der Detektion arbeitet. Dieses Modul wird darauf trainiert, die physikalischen Effekte des Wassers auf das Licht umzukehren, gesteuert von einem Modell, das beschreibt, wie verschiedene Farben mit der Tiefe verblassen. Ein Faltungsneuronales Netzwerk schätzt, wie weit das Licht durch das Wasser gereist ist und wie stark jede Farbkomponente absorbiert wurde, und rekonstruiert dann eine klarere, natürlicher wirkende Version der Szene. Zusätzliche Schritte passen Helligkeit an, strecken den Kontrast und reduzieren sanft das Rauschen, sodass Bilder schärfere Kanten und realistischere Farben erhalten. Diese Korrekturen erleichtern es den nachfolgenden Systemstufen erheblich, Flaschen, Tüten und andere Gegenstände vor unruhigen, kontrastarmen Hintergründen zu erkennen.

Wie das System lernt, Abfall zu umreißen

Nachdem das Bild verbessert wurde, wandelt MobileNetV3 es in Stapel von Feature-Maps um, die Formen, Texturen und Farbmuster auf mehreren Skalen zusammenfassen. Ein verbessertes Proposal-Modul fusioniert Informationen aus mehreren dieser Skalen, sodass es sowohl große Netze als auch winzige Plastikstücke verarbeiten kann. Anstatt sich auf handverlesene Vorlagengrößen zu verlassen, lernt es Ankerformen aus den Trainingsdaten und gewichtet jene stärker, die am besten zur Szene passen, wodurch Fehlalarme reduziert werden. Für jede vielversprechende Region verfeinert ein finaler Zweig die Begrenzungen mit einer präzisen Abtastmethode, die feine Details an Kanten erhält. Das Ergebnis ist eine Maske, die die Kontur jedes Objekts nachzeichnet — nicht nur eine grobe Begrenzungsbox — was entscheidend ist, wenn es darum geht, die Menge an vorhandenem Müll abzuschätzen oder robotische Greif- und Sammeloperationen zu planen.

Leistungsnachweis unter realistischen Bedingungen

Das Team trainierte und testete das System an mehreren Datensätzen mit Unterwasserabfallbildern, darunter anspruchsvolle Szenen mit starkem Dunst, schwacher Beleuchtung und Farbverzerrungen. Um reale Tauchbedingungen zu simulieren, verwendeten sie außerdem Data-Augmentation-Tricks wie Kontraständerungen, Spiegelungen und Unschärfen. Das verbesserte Modell erreichte eine mittlere durchschnittliche Genauigkeit von etwa 88 % und einen Überlappungswert von über 83 %, übertraf damit sowohl ein Standard-Mask R-CNN als auch schnellere One-Shot-Detektoren wie Varianten von YOLO und lief trotzdem mit etwa 30 Bildern pro Sekunde. Es erzielte gute Ergebnisse über verschiedene Kunststoffarten hinweg — von Flaschen und Tüten bis hin zu Mikroplastik — und behielt auch bei bisher ungesehenen Datensätzen und in stark trübem Wasser eine gute Genauigkeit, was darauf hindeutet, dass es sich an unterschiedliche Feldbedingungen anpassen kann.

Was das für gesündere Ozeane bedeutet

Vereinfacht zeigt die Studie, dass es heute möglich ist, kompakte Vision-Systeme zu bauen, die nicht nur Unterwassermüll finden, sondern ihn auch in Echtzeit an Bord kleiner Unterwasserfahrzeuge genau umreißen und klassifizieren. Durch die Kombination physikbewusster Bildbereinigung mit einer effizienten Detektions- und Segmentierungspipeline findet der vorgeschlagene Ansatz ein praktisches Gleichgewicht zwischen Geschwindigkeit und Präzision. Solche Systeme könnten künftige Flotten autonomer Fahrzeuge antreiben, die Müll-Hotspots kartieren, verfolgen, wie sich Abfälle mit Strömungen bewegen, und bei gezielten Reinigungsaktionen helfen. Zwar sind weitere Arbeiten nötig, um mit seltenen Müllarten und einer größeren Bandbreite an Wasserbedingungen umzugehen, doch markiert diese Forschung einen konkreten Schritt hin zu intelligenterem, nachhaltigerem Meeresmüll-Management.

Zitation: Deluxni, N., Sudhakaran, P., Alroobaea, R. et al. Adaptive lightweight mask R-CNN model for underwater debris instance segmentation and classification towards sustainable marine waste management. Sci Rep 16, 14057 (2026). https://doi.org/10.1038/s41598-026-44542-0

Schlüsselwörter: Erkennung von Unterwasserabfällen, Meeresverschmutzung, Computer Vision, autonome Unterwasserfahrzeuge, Plastikmüll