Clear Sky Science · ar

ميزة الارتفاع-في-الإنتروبيا في قابلية التعميم لشبكات العصب الاصطناعية

لماذا يهم هذا في الذكاء الاصطناعي اليومي

أنظمة الذكاء الاصطناعي الحديثة قادرة على التعرف على الوجوه وترجمة اللغات والتنبؤ بأسعار المنازل بدقة مدهشة — ومع ذلك لا نزال لا نفهم تمامًا لماذا تعمل جيدًا على بيانات جديدة وغير مرئية. تتناول هذه الورقة ذلك اللغز مستخدمة أفكارًا مُستعارة من الفيزياء. يبين المؤلفون أن الشبكات العصبية الأكثر موثوقية ليست فقط تلك التي توافق بيانات التدريب، بل تلك التي تقيم في مناطق "فسيحة" من فضاء معلماتها الداخلية، وهي خاصية يسمونها ميزة الارتفاع-في-الإنتروبيا.

طريقة جديدة للنظر داخل الشبكات العصبية

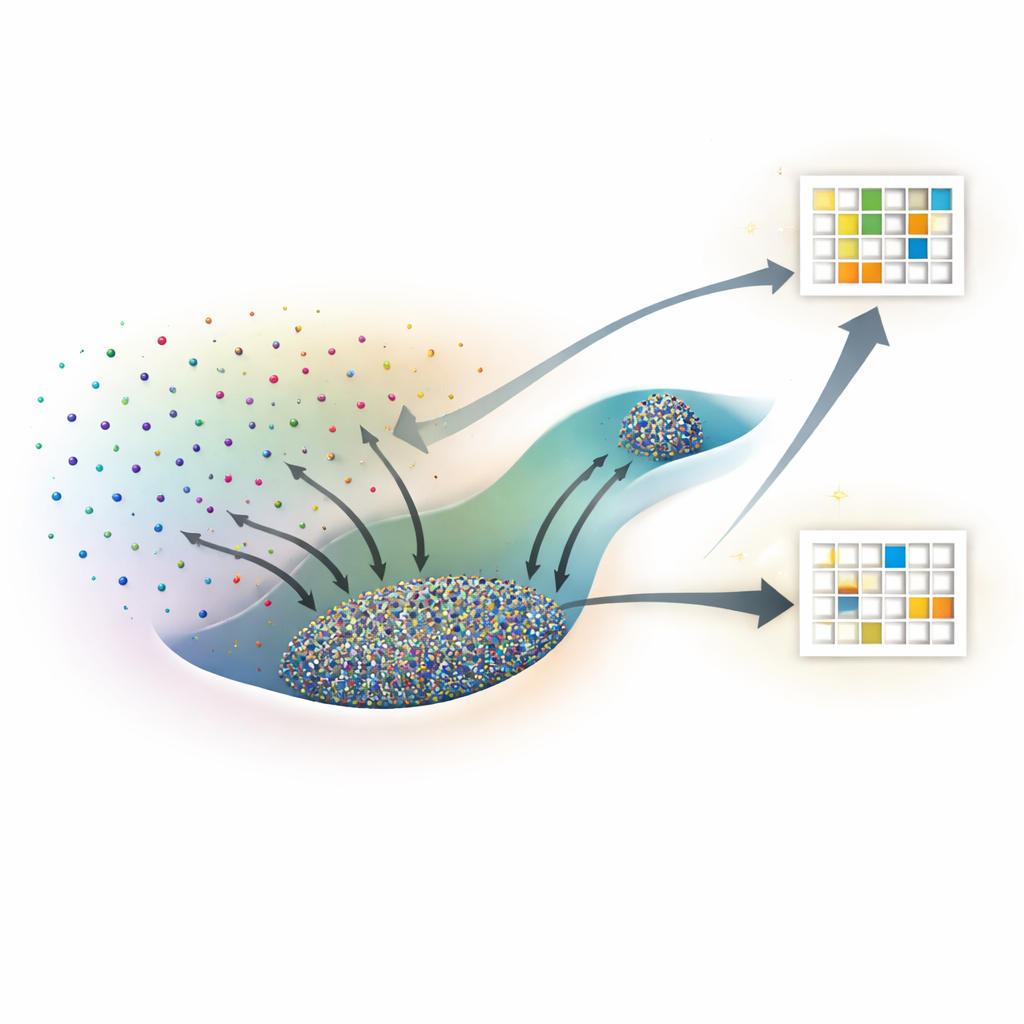

بدلاً من اعتبار الشبكة العصبية صندوقًا أسود، يتخيل الباحثون كل إعداد ممكن لأوزانها الداخلية كنقطة في منظر شاسع. نقاط كثيرة مختلفة يمكن أن تتناسب مع بيانات التدريب بنفس الدرجة، لكن بعض هذه الحلول يعمم إلى بيانات جديدة وبعضها لا يفعل. مستفيدين من الفيزياء الإحصائية، يعاملون كل تكوين وزني محدد كحالة ميكروية وادائه الكلي — مثل خسارة التدريب ودقة الاختبار — كخواص كبرى. الكمية المحورية التي يدرسونها هي الإنتروبيا، التي تقيس هنا مدى اتساع منطقة فضاء المعلمات المناظرة لمستوى معين من أداء التدريب والاختبار.

استعارة أدوات من محاكيات الجزيئات

العد المباشر لعدد تكوينات الشبكة التي تحقق أداءً معينًا مستحيل، لأن هناك عددًا لا نهائيًا من إعدادات الأوزان المستمرة. لتجاوز ذلك، يتبنى المؤلفون خوارزميات طورت أصلاً لدراسة الجزيئات، معروفة باسم مونت كارلو وانغ–لانداو والديناميكا الجزيئية وانغ–لانداو. في تشبيههم، يعمل كل وزن في الشبكة كإحداثية ذرية، وتلعب دالة الخسارة دور طاقة الكمون. تتيح لهم أساليب العينة هذه رسم "منظر الإنتروبيا" الذي يظهر، لكل تركيبة من خسارة التدريب ودقة الاختبار (أو خسارة الاختبار)، مقدار فضاء المعلمات المشغول.

الحالات عالية الإنتروبيا تتفوق في مهام متعددة

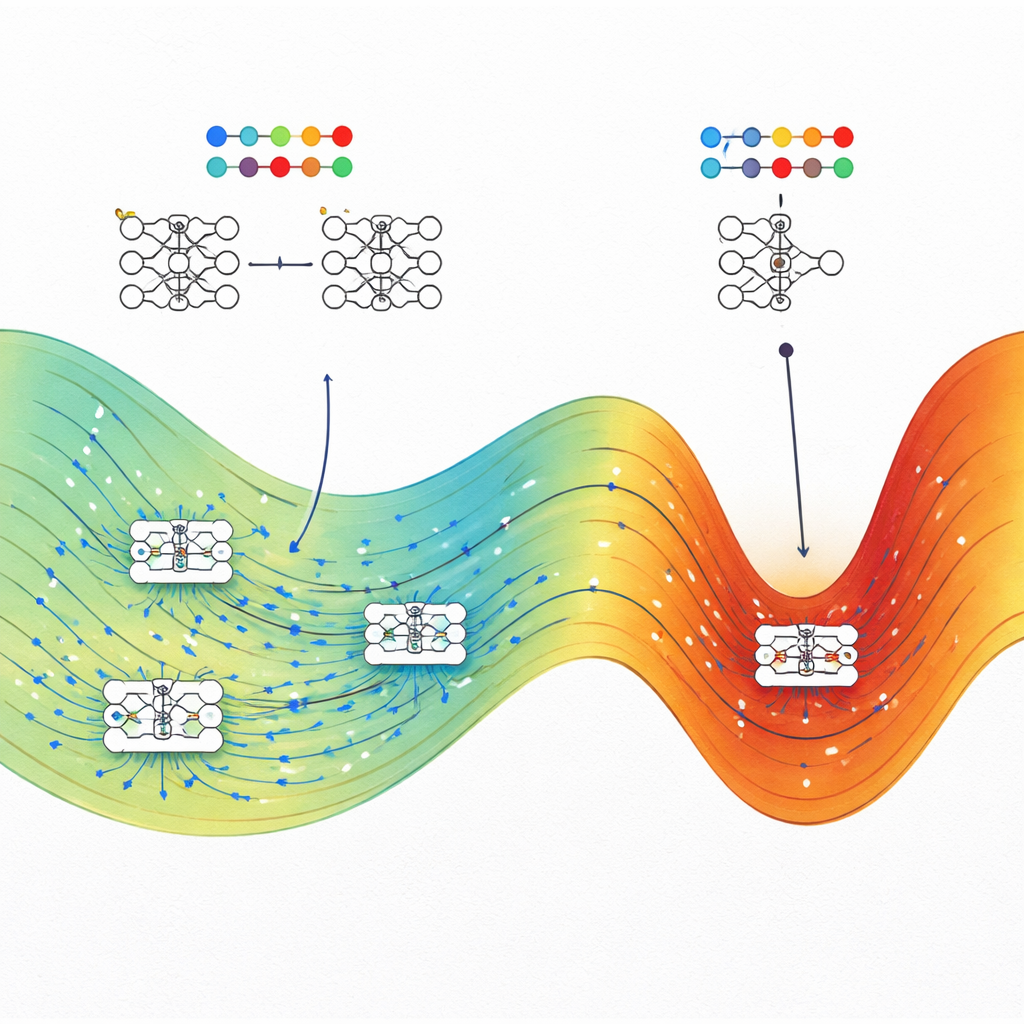

يطبق الفريق هذا الإطار على أربعة مشاكل مختلفة جدًا: مهمة تصنيف حلزونية مبسطة، التنبؤ بأسعار المنازل من بيانات جدوليّة، التعرف على الأرقام المكتوبة يدويًا من مجموعة MNIST مخفضة، والتنبؤ بطاقات فجوة البوليمر من سلاسل كيميائية. في كل حالة، يقارنون الشبكات النموذجية المدربة بموائمات قياسية، مثل الانحدار العشوائي المتدرج (أو آدم في إحدى مهام الانحدار)، مع الحالات ذات الإنتروبيا الأعلى الموجودة عند نفس خسارة التدريب. باستمرار، تطابق الحالات عالية الإنتروبيا أو تتفوق على الشبكات المدربة تقليديًا على بيانات الاختبار، غالبًا بفارق كبير عندما تكون خسارة التدريب منخفضة. في مشكلات التصنيف، تتصرف الحالات عالية الإنتروبيا عند خسارة عالية كمخمنين عشوائيين، بينما عند خسارة منخفضة تتركز قرب أفضل دقة قابلة للتحقيق، ما يعزز الاتساق الفيزيائي لهذا النهج.

لماذا تظهر هذه الظاهرة أقوى في الشبكات الأصغر

لفهم متى تكون هذه الميزة أكثر وضوحًا، يغيّر المؤلفون عرض الشبكات العصبية في مهمة انحدار حلزونية ومعايير مرجعية ذات صلة. يجدون أنه مع اتساع الشبكات — واقترابها من النطاق الذي تقول النظرية إنها تتصرف فيه كعمليات غاوسية — تتضاءل ميزة الارتفاع-في-الإنتروبيا تدريجيًا وقد تختفي حتى للنماذج الواسعة جدًا. تظهر الشبكات الأضيق، رغم أنها مزودة بعدد معاملات أكبر من اللازم، فجوة واضحة: تعمم الحالات عالية الإنتروبيا بشكل ملحوظ أفضل من الحالات التي تصل إليها طرق التدريب التقليدية. هذا يشير إلى أنه في الشبكات الواقعية ذات العرض المحدود، بنية فضاء المعلمات وطريقة استكشافه بواسطة خوارزميات التدريب كلاهما مهمان لقابلية التعميم.

ما الذي يعنيه هذا لبناء ذكاء اصطناعي أفضل

الرسالة المركزية لغير المتخصصين هي أن التعميم الجيد في الشبكات العصبية ليس صدفة. يبين المؤلفون أن، عند مستوى معين من أداء التدريب، تشغل الحلول التي تعمم جيدًا عادة "حجمًا" أكبر بكثير من إعدادات المعلمات الممكنة مقارنة بالحلول الهشة والمتأقلمة بشكل مفرط. تميل طرق التدريب مثل الانحدار العشوائي المتدرج إلى التوطن في هذه المناطق الكبيرة، مما يفسر لماذا يمكن لنماذج اليوم ذات المعاملات المفرطة أن تظل مؤدية جيدًا دون تنظيم شديد. كما يلقي العمل تلميحًا لإستراتيجيات عملية: من خلال توجيه التدريب عمداً نحو مناطق ذات إنتروبيا قصوى — باستخدام طرق تحسين مستوحاة من الفيزياء — قد يتمكن المهندسون من جعل أنظمة الذكاء الاصطناعي أكثر متانة وموثوقية دون إعادة تصميم هياكلها من الصفر.

الاستشهاد: Yang, E., Zhang, X., Shang, Y. et al. High-entropy advantage in neural networks' generalizability. npj Artif. Intell. 2, 44 (2026). https://doi.org/10.1038/s44387-026-00100-7

الكلمات المفتاحية: قابلية تعميم الشبكات العصبية, الإنتروبيا في تعلم الآلة, مناظر الخسارة, النماذج ذات المعاملات المفرطة, الفيزياء الإحصائية للذكاء الاصطناعي