Clear Sky Science · zh

大型语言模型提供医学解释对放射科诊断准确性的影响

为何这项研究重要

现代医院正迅速采用强大的文本型人工智能工具来帮助医生理解复杂的医学信息。负责解读 CT 和 MRI 等医学影像的放射科医生,面临着迅速且准确给出结论的持续压力。本研究提出了一个简单但重要的问题:如果 AI 系统不仅给出诊断还解释其推理,这是否真正能帮助医生做出更好的决策——以及哪种解释风格最有效?

AI 与医生交流的不同方式

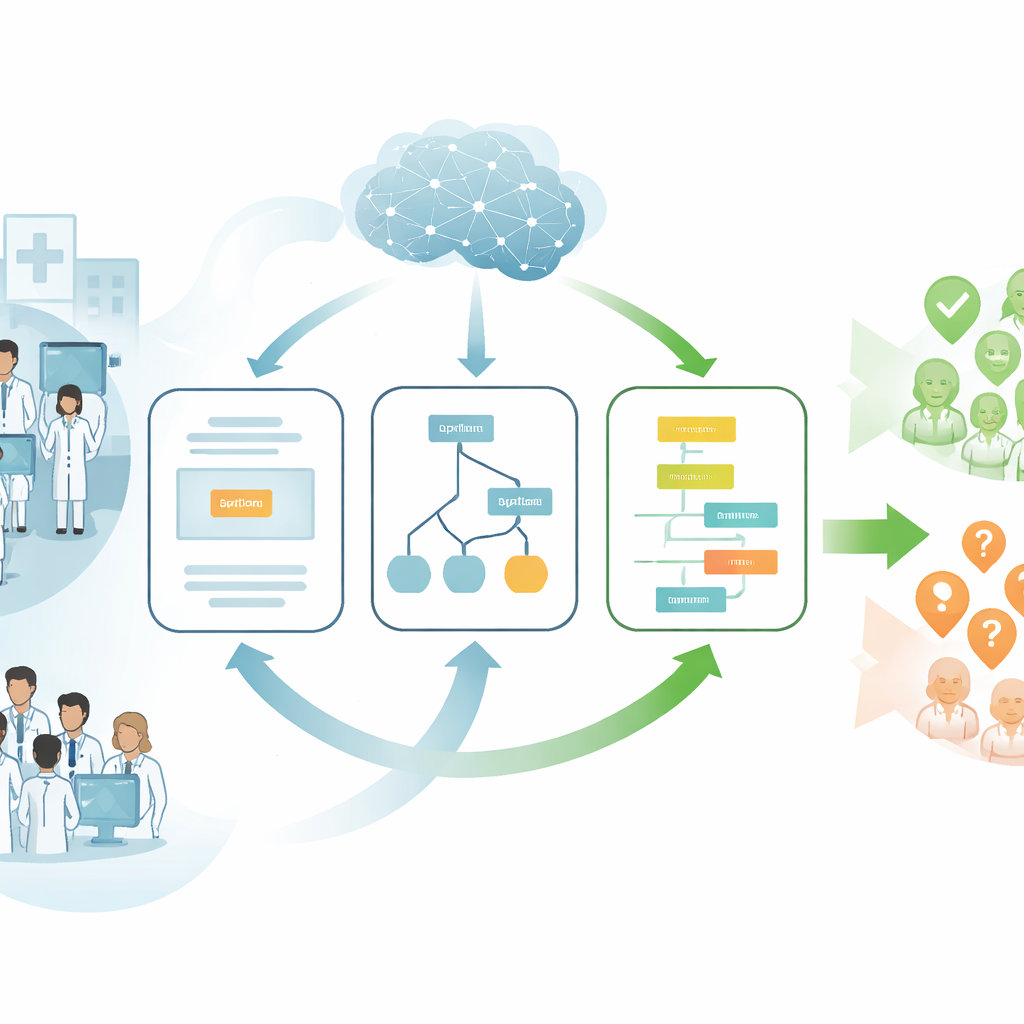

研究者关注大型语言模型(LLM)——能够阅读和生成自然语言、并在本研究中也能处理医学影像的 AI 系统。研究者并非将 AI 视为只输出单一答案的黑盒,而是测试了三种不同的建议呈现方式。在一种格式中,AI 仅给出其最佳猜测的诊断。另一种格式列出多个可能诊断,类似于医生的心理清单。第三种格式则逐步展示推理过程,说明影像细节和病史如何导向结论。团队想知道哪种解释风格能最好地支持而非取代人工判断。

基于真实放射病例的大规模测试

为此,作者进行了一项随机实验,共有 101 名在职美国放射科医生参加。每位放射科医生评审 20 个来自一家领先医学期刊教育系列的真实病人病例。每个病例包含简短的临床描述和一张或多张 CT 或 MRI 影像,医生需像现实中一样以自由文本输入诊断。部分医生未获得任何 AI 协助;另一些医生则看到三种 AI 建议中的一种:单一诊断、按优先级排列的五项可能诊断列表,或详细的逐步推理说明。所用 AI 是可处理文本和图像的多模态 GPT-4。为模拟真实使用场景,AI 的所有输出(包括错误)都原样显示给医生。

逐步推理能提升准确性

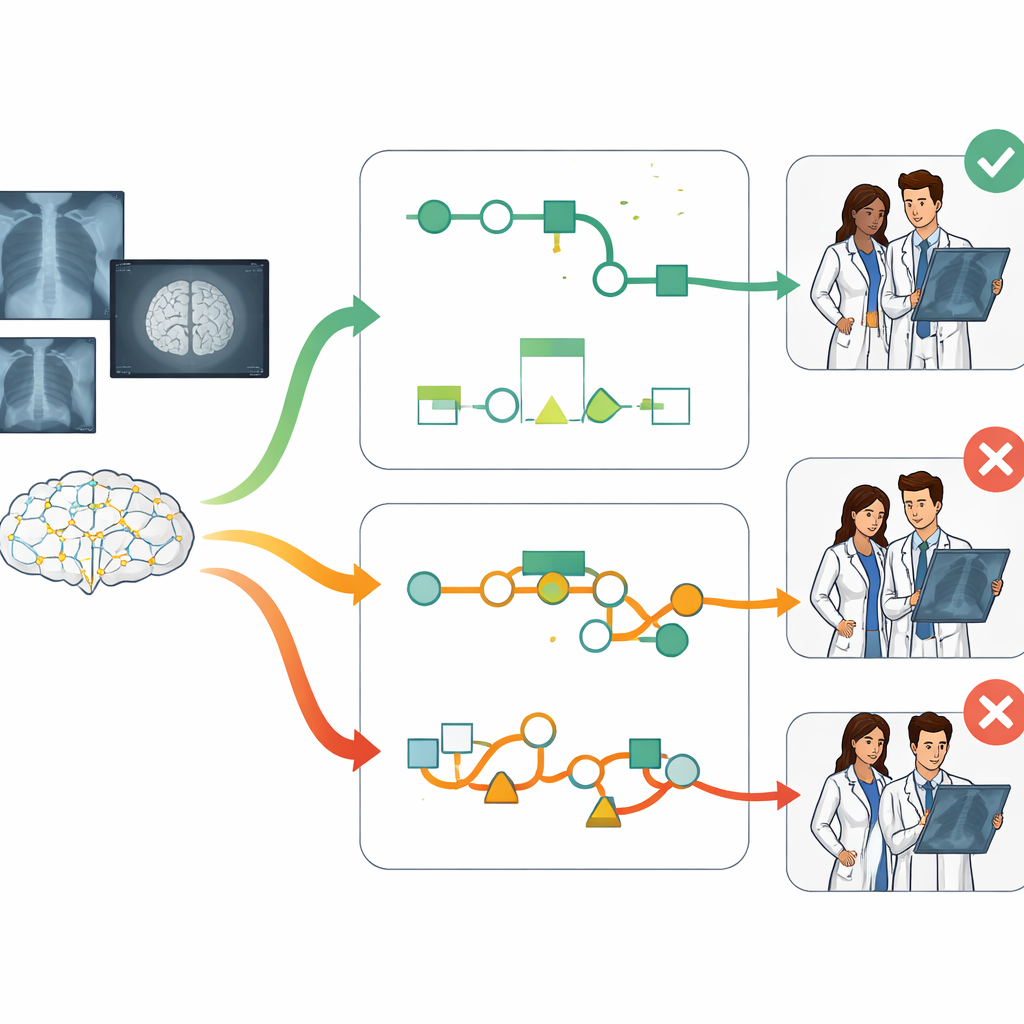

核心发现明确:解释风格差异显著。看到链式思维风格——即逐步推理——的放射科医生,其诊断准确性明显高于未使用 AI 的医生,也优于仅看到单一诊断或诊断列表的医生。平均而言,链式思维支持比无 AI 帮助将诊断准确率提升了超过 12 个百分点,相较于其他 AI 格式提升了 7 到 10 个百分点。即便在控制了执业年限、专科训练及医生在每个病例上花费的时间等因素后,这些收益仍然存在,表明信息呈现方式能实质性地改变医生的表现。

采纳正确建议并拒绝错误建议

研究还分析了当 AI 正确或错误时医生的反应。在差异诊断列表情形下,放射科医生倾向于跟随 AI 的首选建议,即便该建议不正确,这是一种被称为自动化偏差的过度信任模式。相较之下,链式思维格式鼓励更有选择性的依赖——当 AI 的诊断正确时,医生很可能采纳;但当逐步推理中的某些环节显得不妥时,他们更愿意否决 AI 并选择不同的答案。换言之,详细的推理帮助医生判断何时依赖机器、何时信任自身专业知识。

在不同技能和专科间的稳健结果

逐步解释的优势在多种情境中均有体现。无论是职业生涯较短还是较长的放射科医生,具备基础或高级计算机技能者,均从中受益。该模式在简单与复杂病例、普通放射科医生与神经放射学或腹部影像等专科医生中均成立。作者还进行了大量统计检验——控制 AI 本身的正确率、输出长度及不同建模假设——发现链式思维解释的优越性非常稳定。

对患者和未来 AI 工具的意义

对患者而言,结论可谓审慎乐观:AI 能辅助放射科医生,但其沟通推理的方式至关重要。仅列出可能性或给出自信的结论并不足够,甚至可能促使医生倾向于错误选择。在这项受控实验中,以清晰、逐步方式“说出思路”的 AI 帮助医生更好地辨别机器何时正确、何时错误,从而总体减少诊断错误。随着医院持续将 AI 整合进临床工作流,设计以透明、以推理为中心的解释为优先的系统,可能在提升医学诊断的安全性与可靠性方面发挥关键作用。

引用: Spitzer, P., Hendriks, D., Rudolph, J. et al. The effect of medical explanations from large language models on diagnostic accuracy in radiology. npj Digit. Med. 9, 333 (2026). https://doi.org/10.1038/s41746-026-02619-0

关键词: 放射学诊断, 医学人工智能, 大型语言模型, 链式思维解释, 临床决策支持