Clear Sky Science · fr

L'effet des explications médicales fournies par de grands modèles de langage sur la précision diagnostique en radiologie

Pourquoi cette étude est importante

Les hôpitaux modernes adoptent rapidement des outils d'intelligence artificielle textuels puissants pour aider les médecins à interpréter des informations médicales complexes. Les radiologues, qui analysent des examens d'imagerie médicale tels que les scanners et les IRM, sont soumis à une pression constante pour fournir des réponses rapides et précises. Cette étude pose une question simple mais cruciale : si un système d'IA non seulement propose un diagnostic mais explique aussi son raisonnement, cela aide-t-il réellement les médecins à prendre de meilleures décisions — et quel style d'explication fonctionne le mieux ?

Différentes manières pour une IA de "parler" aux médecins

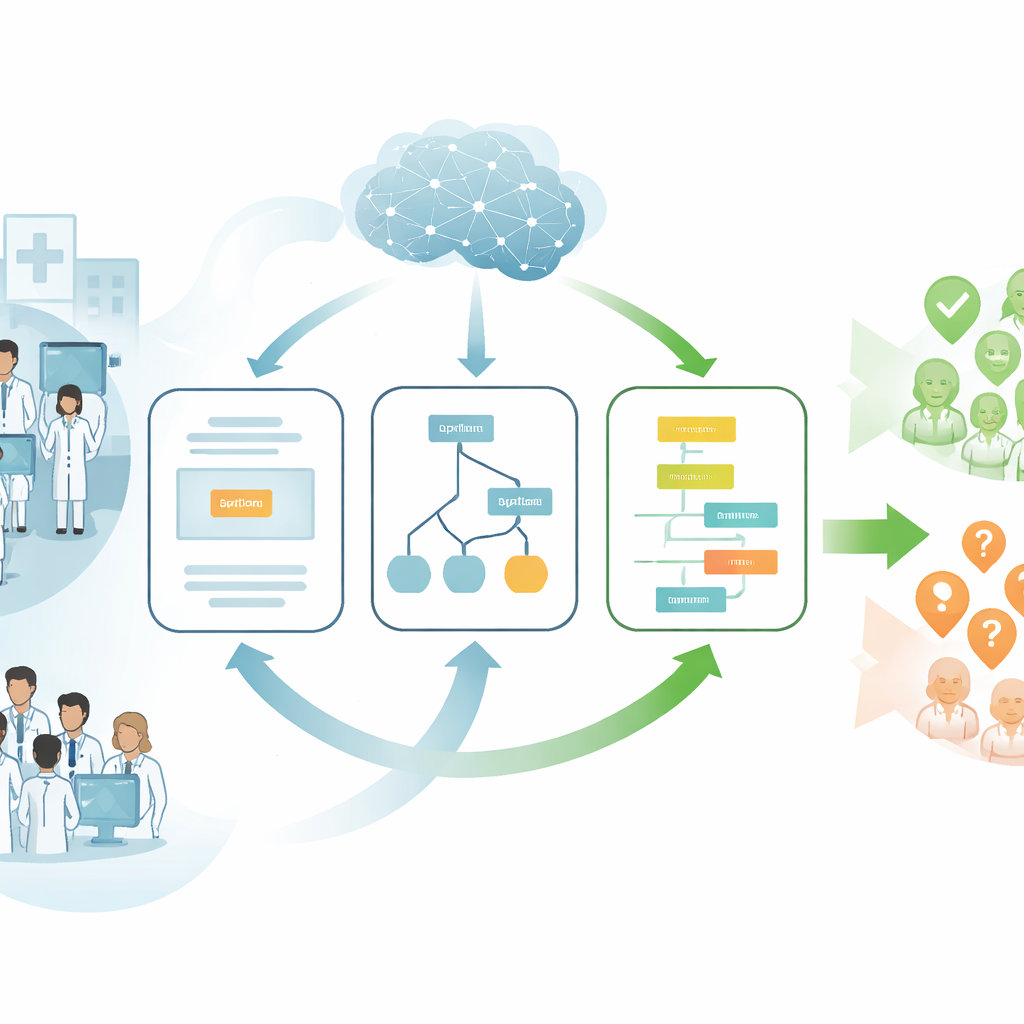

Les chercheurs se sont concentrés sur les grands modèles de langage (LLM) — des systèmes d'IA capables de lire et d'écrire en langage naturel et, dans ce cas, aussi d'analyser des images médicales. Plutôt que de traiter l'IA comme une boîte noire qui délivre une seule réponse, ils ont testé trois façons différentes dont elle pouvait présenter ses conseils aux radiologues. Dans un format, l'IA se contentait d'indiquer son diagnostic le plus probable. Dans un autre, elle listait plusieurs diagnostics possibles, à la manière d'une check-list mentale d'un médecin. Dans le troisième, elle décrivait son raisonnement étape par étape, expliquant comment les détails de l'imagerie et l'histoire du patient conduisaient à sa conclusion. L'équipe voulait savoir lequel de ces styles d'explication soutiendrait le mieux le jugement humain plutôt que de le remplacer.

Un large test avec des cas de radiologie réels

Pour explorer cela, les auteurs ont mené une expérience randomisée impliquant 101 radiologues en exercice aux États-Unis. Chaque radiologue a examiné 20 cas patients réels issus d'une série pédagogique publiée par une revue médicale de premier plan. Chaque cas comprenait une brève description clinique et une ou plusieurs images CT ou IRM, et les médecins devaient saisir un diagnostic en texte libre, comme dans la pratique réelle. Certains radiologues n'ont reçu aucune aide de l'IA. D'autres ont vu les conseils de l'IA sous l'un des trois formats : un diagnostic nu, une liste classée de cinq diagnostics possibles, ou une explication détaillée pas à pas. L'IA utilisée était une version multimodale de GPT-4 capable de traiter à la fois le texte et les images. Toutes ses sorties — y compris les erreurs — ont été affichées telles quelles pour reproduire l'utilisation en conditions réelles.

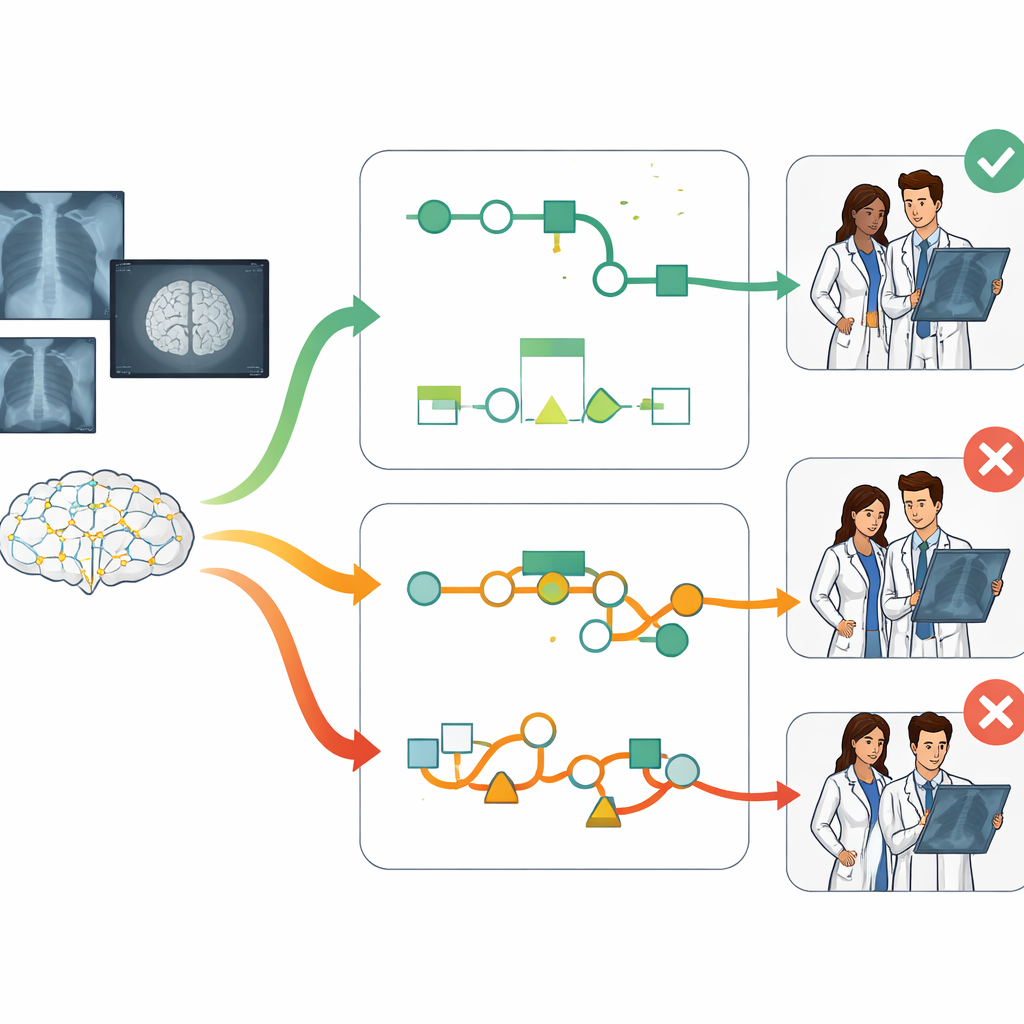

Le raisonnement pas à pas améliore la précision

La conclusion principale est nette : le style d'explication compte beaucoup. Les radiologues qui ont vu le format en chaîne de raisonnement — le raisonnement pas à pas — étaient nettement plus précis que ceux qui ont travaillé sans IA et aussi plus précis que ceux qui n'ont vu qu'un diagnostic unique ou une liste d'alternatives. En moyenne, le soutien par chaîne de raisonnement a amélioré la précision diagnostique de plus de 12 points de pourcentage par rapport à l'absence d'aide de l'IA et de 7 à 10 points par rapport aux autres formats d'IA. Ces gains se sont maintenus après prise en compte de facteurs tels que les années d'expérience, la formation en sous-spécialité et le temps passé par les médecins sur chaque cas, ce qui suggère que la façon dont l'information est présentée peut modifier de manière significative la performance des médecins.

Suivre un bon conseil et rejeter un mauvais conseil

L'étude a également examiné la façon dont les médecins ont réagi lorsque l'IA avait raison ou tort. Avec la liste de diagnostics différentiels, les radiologues avaient tendance à suivre la première suggestion de l'IA même lorsqu'elle était incorrecte, un comportement de confiance excessive connu sous le nom de biais d'automatisation. En revanche, le format en chaîne de raisonnement favorisait une dépendance plus sélective. Lorsque le diagnostic de l'IA était correct, les médecins étaient très susceptibles de s'y rallier. Mais lorsque quelque chose dans le raisonnement pas à pas semblait erroné, ils étaient plus enclins à outrepasser l'IA et à choisir une autre réponse. Autrement dit, un raisonnement détaillé aidait les médecins à juger quand s'appuyer sur la machine et quand faire confiance à leur propre expertise.

Des résultats robustes selon les compétences et les spécialités

Les avantages des explications pas à pas ont été observés dans un large éventail de situations. Les radiologues, qu'ils aient des carrières courtes ou longues, en ont bénéficié, de même que ceux ayant des compétences informatiques de base ou avancées. Le schéma s'est maintenu pour les cas plus faciles comme pour les cas plus difficiles, et aussi bien chez les radiologues généralistes que chez ceux exerçant dans des domaines spécialisés, comme la neuroradiologie ou l'imagerie abdominale. Les auteurs ont également réalisé de nombreux contrôles statistiques — en contrôlant la précision propre de l'IA, la longueur de ses sorties et différentes hypothèses de modélisation — et ont constaté que la supériorité des explications en chaîne de raisonnement était remarquablement stable.

Ce que cela signifie pour les patients et les futurs outils d'IA

Pour les patients, le message est prudemment optimiste : l'IA peut aider les radiologues, mais la manière dont elle communique son raisonnement est cruciale. Se contenter d'énumérer des possibilités ou de donner une réponse qui semble assurée ne suffit pas et peut même pousser les médecins vers des choix incorrects. Dans cette expérience contrôlée, une IA qui « pense à voix haute » de façon claire et progressive a aidé les cliniciens à mieux repérer quand la machine avait raison et quand elle avait tort, réduisant ainsi globalement le nombre d'erreurs diagnostiques. À mesure que les hôpitaux intègrent l'IA dans les flux cliniques, concevoir des systèmes qui privilégient des explications transparentes et axées sur le raisonnement pourrait jouer un rôle clé pour rendre les diagnostics médicaux plus sûrs et plus fiables.

Citation: Spitzer, P., Hendriks, D., Rudolph, J. et al. The effect of medical explanations from large language models on diagnostic accuracy in radiology. npj Digit. Med. 9, 333 (2026). https://doi.org/10.1038/s41746-026-02619-0

Mots-clés: diagnostic en radiologie, IA médicale, grands modèles de langage, explications en chaîne de raisonnement, soutien à la décision clinique