Clear Sky Science · ru

Влияние медицинских объяснений от крупных языковых моделей на точность диагностики в радиологии

Почему это исследование важно

Современные больницы стремительно внедряют мощные текстовые инструменты искусственного интеллекта, чтобы помочь врачам разбираться в сложной медицинской информации. Радиологи, которые интерпретируют медицинские сканы, такие как КТ и МРТ, постоянно испытывают давление давать быстрые и точные ответы. Это исследование задаёт простой, но важный вопрос: если система ИИ не только выносит диагноз, но и объясняет свою логику, действительно ли это помогает врачам принимать более верные решения — и какой стиль объяснения работает лучше?

Разные способы, которыми ИИ может «говорить» с врачами

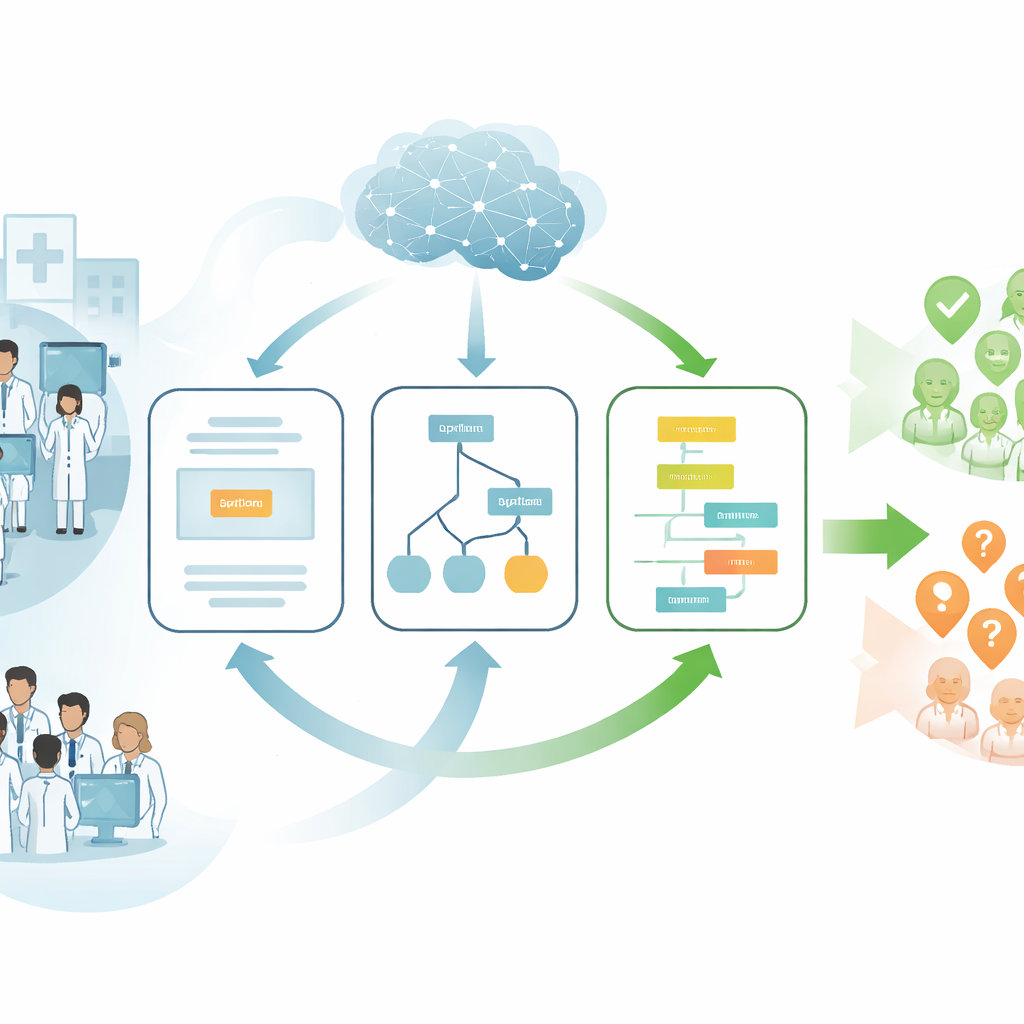

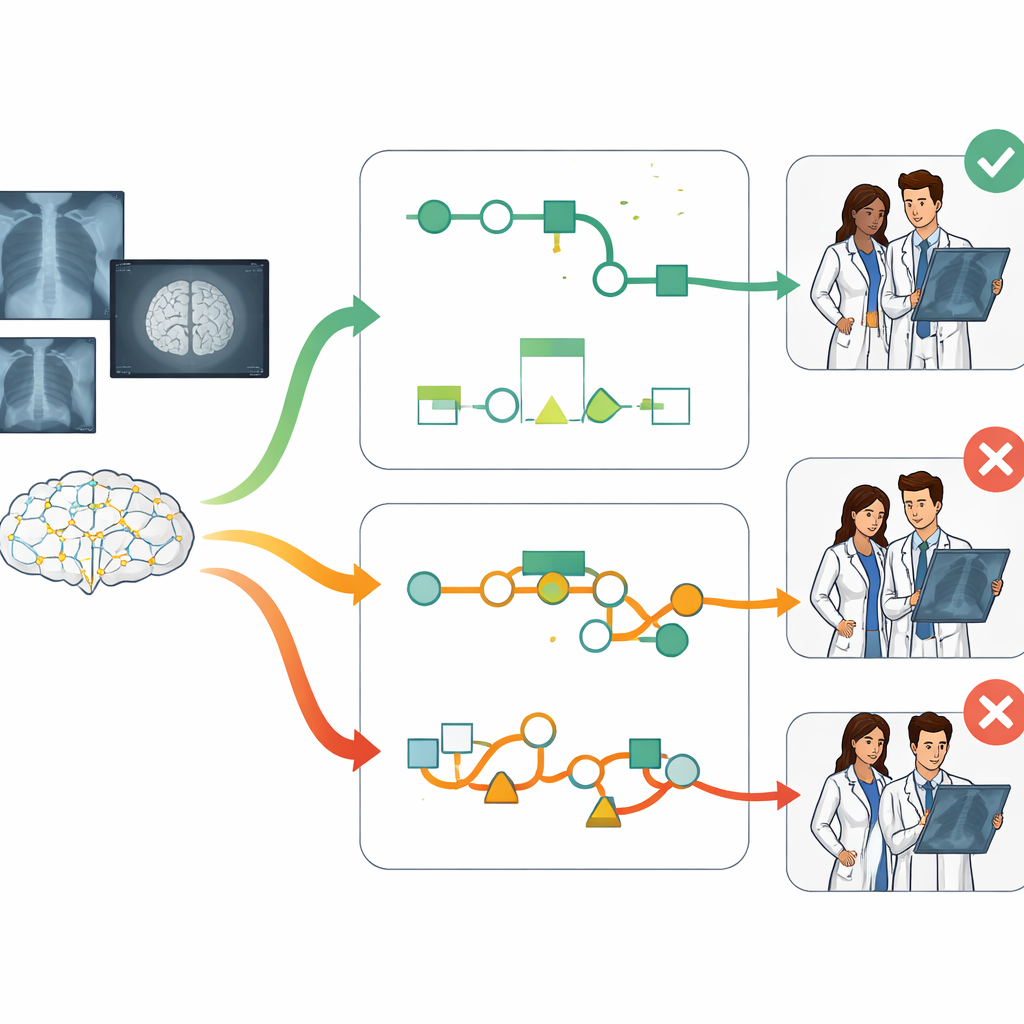

Исследователи сосредоточились на крупных языковых моделях (LLM) — системах ИИ, умеющих читать и писать на естественном языке и в данном случае также анализировать медицинские изображения. Вместо того чтобы воспринимать ИИ как «чёрный ящик», выдающий единый ответ, они протестировали три разных формата представления рекомендаций для радиологов. В одном формате ИИ просто называет самый вероятный диагноз. В другом он приводит несколько возможных диагнозов, словно мысленный чеклист врача. В третьем формате ИИ пошагово объясняет своё рассуждение, показывая, как детали скана и клиническая история пациента привели к выводу. Команда хотела выяснить, какой из этих стилей объяснений лучше поддерживает человеческое суждение, не заменяя его.

Крупный эксперимент на реальных случаях из радиологии

Чтобы изучить это, авторы провели рандомизированный эксперимент с 101 практикующим радиологом в США. Каждый радиолог рассмотрел 20 реальных клинических случаев из образовательной серии, опубликованной ведущим медицинским журналом. Каждый случай включал краткое клиническое описание и одно или несколько изображений КТ или МРТ, а врачам нужно было ввести диагноз в свободной форме, как в реальной практике. Некоторым радиологам помощь ИИ не предоставляли. Другие видели рекомендации ИИ в одном из трёх форматов: одиночный диагноз, ранжированный список из пяти возможных диагнозов или подробное пошаговое объяснение. Используемый ИИ был мультимодальной версией GPT-4, способной обрабатывать текст и изображения. Все её выводы — включая ошибки — показывали без правок, имитируя реальное использование.

Пошаговое рассуждение повышает точность

Ключевой вывод ясен: стиль объяснения имел большое значение. Радиологи, которые видели цепочку рассуждений — пошаговые объяснения — значительно точнее решали задачи по сравнению с теми, кто работал без ИИ, а также по сравнению с теми, кто видел лишь одиночный диагноз или список альтернатив. В среднем поддержка в формате пошагового мышления улучшала точность диагностики более чем на 12 процентных пунктов по сравнению с отсутствием ИИ и на 7–10 пунктов по сравнению с другими форматами ИИ. Эти улучшения сохранялись даже после учёта таких факторов, как годы практики, субспециализационная подготовка и время, затраченное врачами на каждый случай, что свидетельствует о том, что способ подачи информации может существенно влиять на результативность врачей.

Следовать хорошему совету и отвергать плохой

Исследование также проанализировало, как врачи реагировали, когда ИИ был прав или ошибался. При формате с дифференциальным списком радиологи tended to следовали верхнему предложению ИИ даже когда оно было неверным — это проявление чрезмерного доверия, известное как автоматизационное смещение. Напротив, формат с цепочкой рассуждений поощрял более избирательное использование подсказок ИИ. Когда диагноз ИИ был верным, врачи с большой долей вероятности соглашались с ним. Но когда в пошаговом объяснении что-то казалось неверным, они чаще отменяли предложение ИИ и выбирали другой ответ. Иными словами, подробные рассуждения помогали врачам решать, когда опираться на машину, а когда доверять собственному опыту.

Надёжные результаты в разных навыках и специализациях

Преимущества пошаговых объяснений наблюдались во множестве ситуаций. Пользу извлекали как радиологи с небольшим, так и с большим стажем, а также те, у кого базовые или продвинутые компьютерные навыки. Эффект сохранялся для более простых и более сложных случаев, а также для общих радиологов и специалистов в узких областях, таких как нейрорадиология или абдоминальная визуализация. Авторы также провели многочисленные статистические проверки — контролируя точность самого ИИ, длину его ответов и различные модельные допущения — и обнаружили, что превосходство пошаговых объяснений было удивительно устойчивым.

Что это значит для пациентов и будущих инструментов ИИ

Для пациентов вывод осторожно оптимистичен: ИИ может помочь радиологам, но критически важно, как он коммуницирует свою логику. Простое перечисление возможностей или уверенный ответ сам по себе недостаточны и даже могут склонять врачей к ошибочному выбору. В этом контролируемом эксперименте ИИ, который «думает вслух» ясно и последовательно, помогал врачам лучше распознавать, когда машина права, а когда ошибается, что в целом снижало число диагностических ошибок. По мере того как больницы продолжают интегрировать ИИ в клинические рабочие процессы, проектирование систем, уделяющих приоритет прозрачным объяснениям, ориентированным на рассуждение, может сыграть ключевую роль в повышении безопасности и надёжности медицинской диагностики.

Цитирование: Spitzer, P., Hendriks, D., Rudolph, J. et al. The effect of medical explanations from large language models on diagnostic accuracy in radiology. npj Digit. Med. 9, 333 (2026). https://doi.org/10.1038/s41746-026-02619-0

Ключевые слова: диагностика в радиологии, медицинский ИИ, крупные языковые модели, пошаговые объяснения, поддержка клинических решений