Clear Sky Science · ja

大型言語モデルによる医療的説明が放射線診断の精度に与える影響

なぜこの研究が重要か

現代の病院では、複雑な医療情報を医師が理解するのを助ける強力なテキストベースの人工知能ツールが急速に導入されています。CTやMRIなどの医用画像を解釈する放射線科医は、迅速かつ正確な回答を提供するという常時のプレッシャーにさらされています。本研究は単純だが重要な問いを投げかけます。AIシステムが診断を出すだけでなく、その思考を説明すると、実際に医師の意思決定が向上するのか—そしてどの説明スタイルが最も有効なのか、という点です。

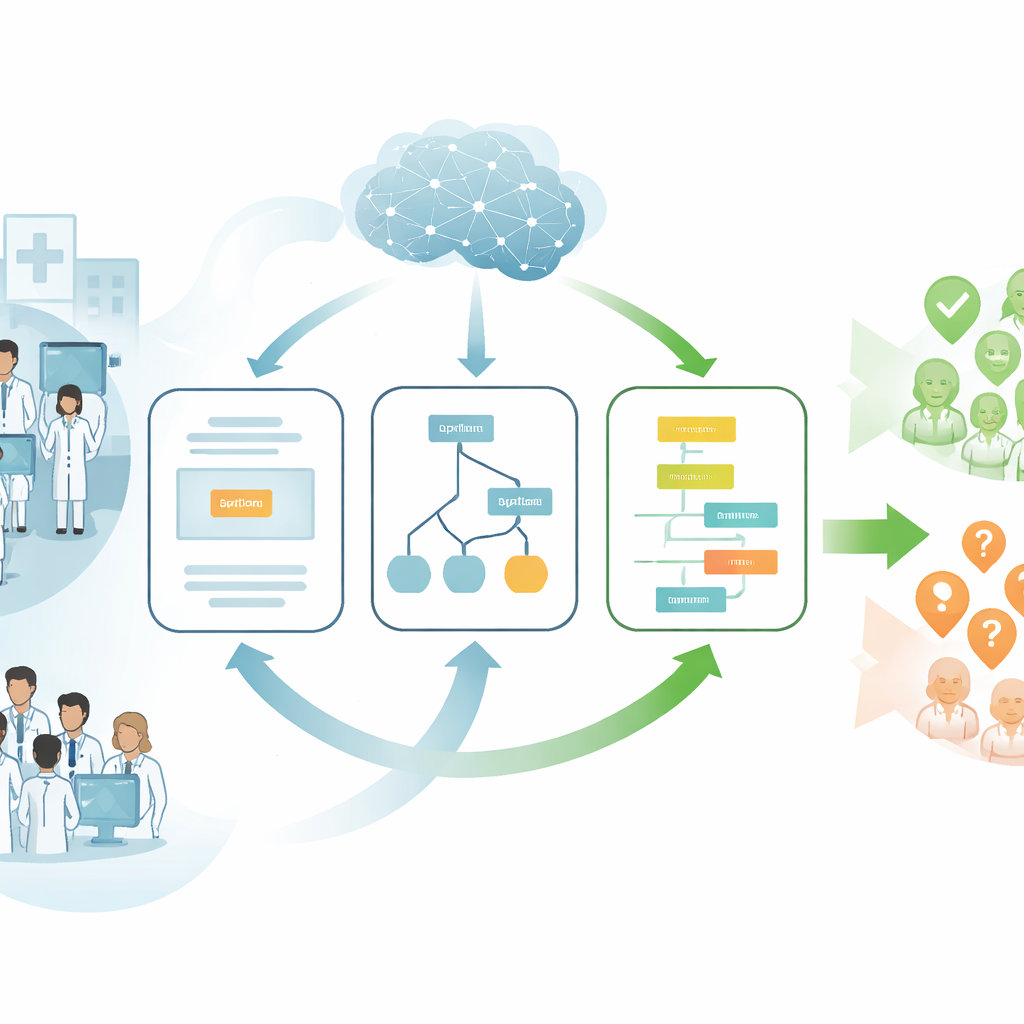

AIが医師に「話す」さまざまな方法

研究者たちは大型言語モデル(LLM)に注目しました。LLMは自然言語の読み書きができ、この研究では医用画像も扱えるようにしたAIです。AIを単一の答えを出すブラックボックスとして扱うのではなく、放射線科医に助言を提示する三つの異なる方法を検証しました。一つはAIが最良推定の診断名だけを示す形式、二つ目は医師の頭の中のチェックリストのように複数の可能性を列挙する形式、三つ目はスキャンの所見や患者の経緯がどのように結論につながったかを段階的に示す思考過程形式です。研究チームは、どの説明スタイルが人間の判断を支援し、単に置き換えるのではないかを明らかにしたいと考えました。

実臨床ケースを用いた大規模試験

この問いを探るために、著者らは米国の101名の現職放射線科医を対象に無作為化実験を実施しました。各放射線科医は主要な医学誌が公開する教育シリーズから抽出した20の実患者ケースを査読しました。各ケースには短い臨床記述と1枚以上のCTまたはMRI画像が含まれ、医師は実際と同じように自由記述で診断を入力する必要がありました。あるグループにはAI支援は全く与えられませんでした。他のグループは三つの形式のいずれかでAIの助言を見ました:単なる診断、5つの候補を順位付けした一覧、または詳細な段階的説明です。使用されたAIはテキストと画像の両方を扱えるマルチモーダル版のGPT-4で、実運用を模擬するために出力(誤りも含む)はそのまま提示されました。

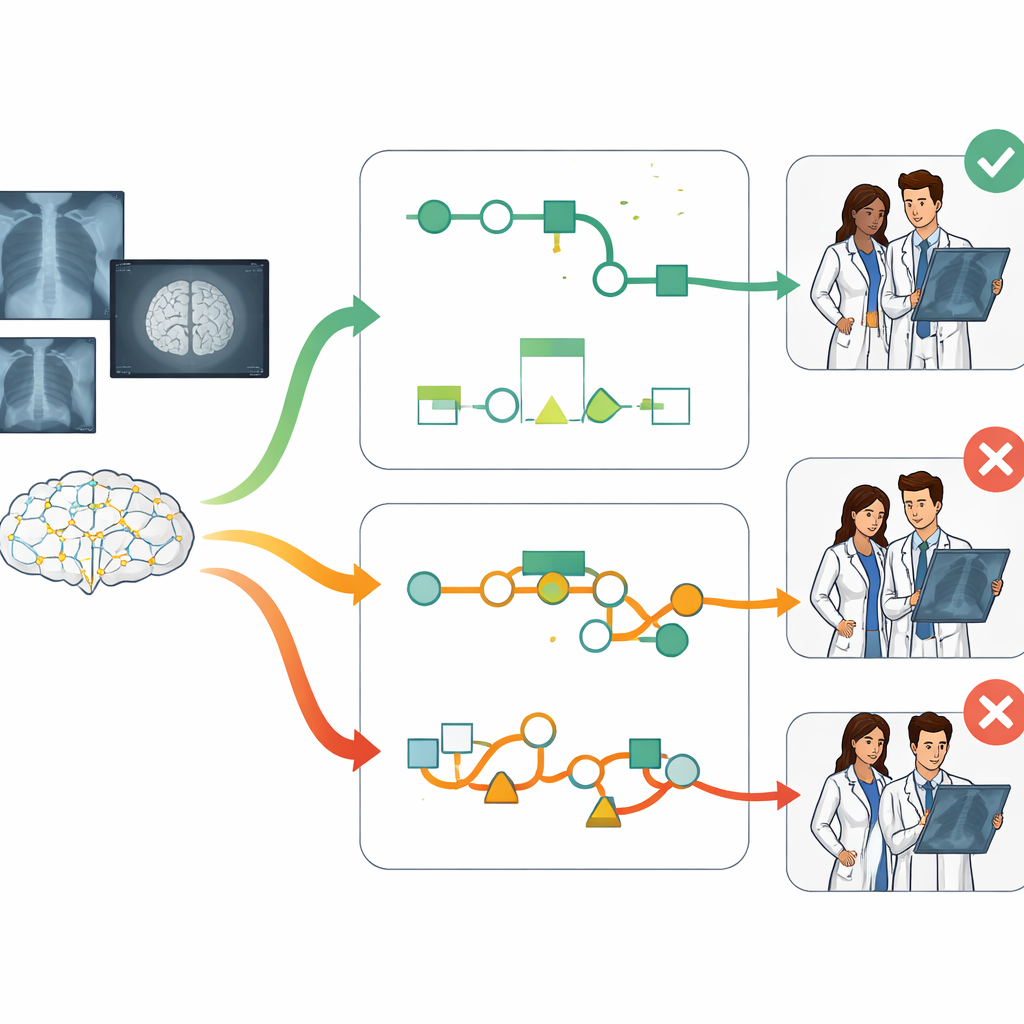

思考過程の提示が精度を高める

中心的な発見は明白です:説明のスタイルは大きな影響を与えました。思考過程スタイル(段階的な推論)を示された放射線科医は、AIなしで作業した医師よりも、また単一の診断や候補リストだけを見た医師よりも明らかに高い精度を示しました。平均して、思考過程による支援はAIなしに比べ診断精度を12ポイント以上向上させ、他のAI形式に比べても7〜10ポイントの改善が見られました。これらの向上は経験年数、専門分野、各ケースに費やした時間などの要因を考慮しても維持され、情報の提示方法が医師のパフォーマンスに実質的な影響を与えうることを示唆しています。

良い助言に従い、悪い助言を拒む

研究はまた、AIが正しい場合と間違っている場合に医師がどのように反応するかも詳しく調べました。差次的診断の一覧が示された場合、放射線科医はAIの最上位の提案に従う傾向があり、AIが誤っているときでもそうすることが多く、これは自動化バイアスとして知られる過信のパターンです。対照的に、思考過程の形式はより選択的な依存を促しました。AIの診断が正しいときは医師がそれに同意する可能性が高かった一方、段階的な推論のどこかに違和感があるときは、医師はAIを覆して別の答えを選ぶ意欲が高まりました。言い換えれば、詳細な推論は医師が機械に頼るべき場面と自身の専門知識を優先すべき場面を見極める助けとなったのです。

技能や専門性を超えた堅牢な結果

段階的な説明の利点はさまざまな状況で認められました。短いキャリアの放射線科医も長いキャリアの放射線科医も恩恵を受け、基礎的なコンピュータスキルの医師も高度なスキルを持つ医師も同様でした。簡単なケースでも難しいケースでも、一般診療放射線科医でも神経放射線や腹部画像診断のような専門領域の医師でもこの傾向は見られました。著者らはAI自身の正確さ、出力の長さ、さまざまなモデル化仮定を統制するなど多数の統計的検証も行い、思考過程の説明の優位性は極めて安定していると結論づけました。

患者と将来のAIツールにとっての意味

患者にとってのメッセージは慎重な楽観です:AIは放射線科医を助けうるが、その推論をどのように伝えるかが重要です。可能性を単に列挙したり、自信ありげな答えを示すだけでは不十分であり、場合によっては医師を誤った選択へと誘うことさえあります。この統制された実験では、AIが「声に出して考える」ように明確で段階的な形で示されたとき、医師は機械が正しい場面と誤っている場面をよりよく見分けられ、全体として診断ミスが減少しました。病院が臨床ワークフローにAIを統合し続ける中で、透明性が高く推論に焦点を当てた説明を優先するシステム設計が、医療診断の安全性と信頼性を高める上で重要な役割を果たし得るでしょう。

引用: Spitzer, P., Hendriks, D., Rudolph, J. et al. The effect of medical explanations from large language models on diagnostic accuracy in radiology. npj Digit. Med. 9, 333 (2026). https://doi.org/10.1038/s41746-026-02619-0

キーワード: 放射線科診断, 医療用AI, 大型言語モデル, 思考過程の説明, 臨床意思決定支援